ARTÍCULO ORIGINAL

BONATO, Isabelle Emy [1], GRANADO, Karina [2]

BONATO, Isabelle Emy. GRANADO, Karina. La responsabilidad de la justicia electoral frente a los anuncios electorales en las plataformas digitales. Revista Científica Multidisciplinar Núcleo do Conhecimento. Año 05, Ed. 03, Vol. 02, págs. 85-120. Marzo de 2020. ISSN: 2448-0959, enlace de acceso: https://www.nucleodoconhecimento.com.br/ley/anuncios-electorales

RESUMEN

El estudio cuestiona la confiabilidad de las plataformas de redes sociales digitales en los anuncios electorales y la responsabilidad de la justicia electoral en este contexto. Analiza la necesidad de justicia electoral para regular el uso de estas plataformas y pregunta si el uso de las redes sociales como plataforma de propaganda electoral perjudica a la democracia. Es notorio en los medios de comunicación de todo el mundo que existen medios digitales para obtener información personal y dirigir información, verdadera o no, a audiencias específicas. Por lo tanto, el uso de las redes sociales como plataforma de publicidad electoral puede no ser seguro, y puede ser fácilmente manipulado y, por lo tanto, el presente estudio analiza si el Tribunal Superior Electoral debe regular su uso observando el Principio de Suavidad de las Elecciones que garantiza la libre formación de la voluntad del votante y la igualdad entre los candidatos, asegurando la democracia brasileña.

Palabras clave: Democracia, redes sociales, elecciones.

1. INTRODUCCIÓN

Recientemente, se ha hablado mucho de la importancia de la democracia. Algunos hablan de “golpes” y toman las calles pidiendo la defensa de la democracia, otros creen que no hay nada que temer, ya que con las elecciones presidenciales de 2018, el proceso democrático permaneció intacto. Sin embargo, se planteó un nuevo problema: la confiabilidad del uso de plataformas digitales en los anuncios electorales que fue autorizado por el TSE – Tribunal Superior Electoral para estas elecciones. Cuando se trata de una cuestión tan importante como la democracia, es importante conocer el funcionamiento de las redes sociales y los métodos existentes de manipulación de datos y dirección de información para reflexionar sobre la libertad de voto y la defensa y protección de la democracia.

En marzo de 2018, The New York Times publicó algunos de los escándalos de Facebook. Junto con The Observer of London, el periódico examinó una consultora política llamada Cambrigde Analytica y reveló una posible nueva arma utilizada por la firma consultora. Según el periódico estadounidense, esta arma es un software capaz de mapear rasgos de personalidad basados en lo que la gente disfruta en Facebook. Cambridge tuvo acceso a los datos personales de millones de usuarios de esta red, pudiendo predecir, entre otras características personales, la capacidad receptiva de cada uno, la visión política, el coeficiente intelectual, la satisfacción personal, si la persona es sospechosa o no, si está abierta o no. Esta compañía fue responsable de la campaña electoral de Donald Trump en 2016 y planteó el tema de la seguridad de los datos personales en las redes sociales (ROSENBERG; CONFESSORE; CADWALLADR, 2018). En otro informe, hablamos de la existencia de bots[3] en el mundo cibernético, capaces de dirigir información específica a grupos específicos, influyendo en una Elección (PATTERSON, 2018). Con esta información, existe una creciente preocupación por la suavidad en las elecciones de todo el mundo. En Brasil, por ejemplo, hubo el escándalo del uso de un dispositivo llamado “servicio de refuerzo de contenidos” que habría sido utilizado por el entonces candidato presidencial Jair Bolsonaro en la difusión de Fake News (PERON; MARTINS, 2018), otro tema que se explorará en este trabajo.

Un principio inherente al Estado democrático de derecho es el Principio de Lisura Electoral, definido por Ramayana (2015, p.31) como: “La garantía de la suavidad de las elecciones alimenta un sentido especial de protección de los derechos fundamentales de la ciudadanía (ciudadano-votante), así como encuentra una base legal-constitucional en las artes. 1, punto II y 14, apartado 9, de la Ley Fundamental.” Este principio constitucional tiene por objeto garantizar la participación del pueblo en la elección de sus representantes con libertad y veracidad. La Justicia Electoral es responsable de permitir la expresión de la voluntad de los electores, operando todos los procedimientos electorales para que se desarrollen en armonía y transparencia, sin verse obstaculizados por la soberanía del pueblo (VELLOSO; AGRA, 2016). Por lo tanto, es extremadamente importante explorar los medios de manipulación de datos existentes en las plataformas digitales actuales para que pueda reflexionar sobre la responsabilidad de la Justicia Electoral en el uso de las redes sociales para la propaganda política. Con este fin, se estudiarán artículos recientes que discuten diversas formas de manipulación de datos y sus resultados en las elecciones y cómo otros países están discutiendo este tema con el fin de reflexionar sobre la fiabilidad de las plataformas digitales para su uso en anuncios políticos.

La obra partirá de la exposición de artículos y materiales científicos como libros e informes, que muestran la manipulación de datos personales en el mundo virtual, con el fin de mostrar la existencia de mecanismos capaces de dirigir información específica a un público objetivo con el potencial de influir en el resultado en las elecciones, lo que lesiona la garantía constitucional fundamental del derecho a la libre elección del voto. Basado en premisas básicas como la Democracia, los principios constitucionales del Derecho Electoral y las funciones de la Justicia Electoral Brasileña, la nueva redacción dada al arte. 57-C de la Ley No 9.504/1997 (Palabras dadas por la Ley No 13.488, 2017) que permitió el uso de plataformas digitales en anuncios electorales en las últimas elecciones, permitiendo reflexionar sobre la Responsabilidad de la Justicia Electoral en el uso de plataformas digitales y las consecuencias para las campañas electorales y la democracia brasileña.

2. PLATAFORMAS DIGITALES Y SUS PELIGROS

Las plataformas digitales han surgido con la promesa de reunir a las personas y promover más “formas igualitarias de reunirse y discutir [qualquer assunto]”. Los medios on-line han cambiado profundamente la forma en que las personas se comunican, debaten y forman opiniones. Las plataformas digitales se organizan a través de complejos procesos en cascada. Así, la noticia se propaga como “fuego salvaje en las redes sociales” a través de conexiones directas entre lectores y productores de noticias, lo que hace cada vez más difícil distinguir entre ellos. Sin embargo, este fenómeno ha cambiado la forma en que la sociedad compone sus narrativas sobre el mundo común (TÖRNBERG, 2018, p.1).

Peter Törnberg, del departamento de sociología de la Universidad de Amsterdam, explica:

A pesar del optimismo inicial sobre este lugar de encuentro ostensiblemente descentralizado y democrático, el mundo on-line parece cada vez menos una mesa común que nos une para discutir e identificar libremente los problemas de la sociedad en un nuevo tipo de esfera pública. En cambio, parece traer lo peor de los instintos humanos: nos agrupamos en tribus que nos consuelan con reafirmación y nos protegen de desacuerdos; son cámaras de echo chambers[4] refuerzan la perspectiva existente y fomentan los sesgos de confirmación. La tecnología que se hizo para ayudar a tejer aún más los lazos entre los seres humanos parece haber llevado a un desgaste de nuestro tejido social, ya que estamos divididos en grupos sociales con cosmovisión separadas. (TÖRNBERG, 2018, p.1).

Internet ha surgido como una fuente de conocimiento de fácil acceso, pero con el tiempo, la calidad y credibilidad de la información se está reduciendo drásticamente. Cada vez más, existe “un clima de información caracterizado por narrativas prejuiciosas, noticias falsas, teorías de conspiración, desconfianza y paranoia” (TÖRNBERG, 2018, p.2). El mundo digital se ha convertido en un terreno fértil para el crecimiento de la desinformación. Los estudios muestran que las noticias falsas se propagan más rápido y más lejos que las verdaderas noticias en las redes sociales. Según Törnberg, este fenómeno puede afectar a aspectos relevantes de la vida de un ciudadano en todas las áreas. Por lo tanto, esta desinformación puede incluso comprometer el resultado de una elección, siendo un riesgo no sólo para la sociedad humana, como afirma el autor, sino una amenaza para la democracia de un país.

Aparentemente, existe un vínculo entre las cámaras de echo chambers y la propagación de la desinformación, ya que estos grupos homogéneos de usuarios, con preferencia a la auto-confirmación, parecen proporcionar invernaderos para que el cambio de rumores y la desinformación se propaguen. Con un espacio digital polarizado, los usuarios tienden a promover sus narrativas favoritas, formando grupos polarizados y resistiendo información que no se ajusta a sus creencias (TÖRNBERG, 2018, p.2). Así formando ejércitos de partidarios de ciertos productos o marcas e incluso ejércitos de presidentes (o candidatos a) que se movilizan rápidamente. Esto puede significar que las cámaras de echo chambers hacen que las noticias falsas sean más virales, ya que la información que resuena con los grupos de usuarios sesgados es más probable que se propague a través de una red (TÖRNBERG, 2018, p.3).

Su estudio sugiere en su conclusión que la simple agrupación de usuarios con la misma visión del mundo es suficiente para afectar la viralidad de la información. Esto sugiere que no son sólo los algoritmos los que filtran las noticias, afectándolas, sino que el hecho de que las redes sociales permiten esta dinámica de agrupaciones, también cambia la dinámica de la viralidad. Esto es parte de la gran cuestión de cómo las redes sociales han afectado a los procesos políticos y sociales (TÖRNBERG, 2018, p.16-17).

2.1 INTELIGENCIA ARTIFICIAL EN PLATAFORMAS DIGITALES

Hay muchas formas de utilizar la inteligencia artificial, entre ellas dos son más adecuadas para este trabajo, que busca analizar la fiabilidad de las plataformas: software que identifica el perfil del usuario y bots que interactúan en el mundo virtual.

2.1.1 IDENTIFICACIÓN DEL PERFIL DEL USUARIO

En la era del algoritmo, el propio Facebook y Google hacen selecciones por personas, ya sea relacionadas con la elección de productos, viajes o candidatos presidenciales. Los algoritmos saben mucho sobre sus usuarios, y con la aparición de la inteligencia artificial, tienden a mejorar inmensamente. Aprenden y aprenden mucho sobre cada uno y serán, si ya no son, capaces de saber lo que cada persona quiere o lo que quiere, mejor que ellos mismos. Incluso conocerán sus emociones y podrán imitar las emociones humanas por sí solas (SUNSTEIN, 2017, p. 13). Actualmente, un algoritmo que aprende un poco acerca de una persona puede averiguar y decir lo que a la gente como ellos tiende a gustar. Robert Sunstein, profesor de la Facultad de Derecho de la Universidad de Harvard, explica:

En realidad, esto está sucediendo todos los días. Si el algoritmo sabe que te gustan ciertos tipos de música, puede saber, con alta probabilidad, qué tipos de películas y libros te gustan y qué candidatos políticos te complacerán. Y si sabes qué sitios web visitas, puedes saber qué productos es probable que compres y qué piensas sobre el cambio climático y la inmigración. Un pequeño ejemplo: Facebook probablemente conoce tus convicciones políticas y puede informar a otros, incluidos los candidatos a cargos públicos. Clasifica a sus usuarios como muy conservadores, conservadores, moderados, liberales y muy liberales (SUNSTEIN, 2017, p. 13).

Sunstein explica que Facebook clasifica a sus usuarios políticamente al ver las páginas que les gustan y afirma que es fácil crear un perfil político cuando al usuario le gustan ciertas opiniones, pero no de otras. Si el usuario menciona algunos candidatos de manera favorable o desfavorable, la categorización es aún más fácil. Y lo más aterrador es que Facebook no oculta lo que está haciendo. “En la página Preferencias de anuncios de Facebook, puedes buscar ‘Intereses’, luego ‘Más’, ‘Estilo de vida y cultura’ y finalmente ‘Política de EE.UU[5].Y aparecerá la categorización” (SUNSTEIN, 2017, p. 13). El aprendizaje automático se puede utilizar para producir distinciones refinadas, dice el profesor, como la opinión de los usuarios sobre temas con la seguridad pública, el medio ambiente, la inmigración y la igualdad. Y añade: “Para decirlo suavemente, esta información puede ser útil para otros : gerentes de campaña, anunciantes, recaudadores de fondos y mentirosos, incluidos los extremistas políticos” (SUNSTEIN, 2017, pág. 13).

Además, se pueden considerar los hashtags: #elenão, #partiu, #tbt, #lulalivre, #foratemer, #elesim #EuApoioaLavaJato. Usted puede encontrar un gran número de artículos que interesan al usuario o que encajan (e incluso fortalecen) sus convicciones. “La idea del hashtag es permitir que la gente encuentre tweets e información que les interese. Es un mecanismo de clasificación simple y rápido” (SUNSTEIN, 2017, p. 14). Hay un gran desempeño de los llamados “empresarios del hashtag“; que crean o difunden hashtags como una forma de promover ideas, perspectivas, productos, personas o supuestos hechos. Esto aumenta la comodidad, el aprendizaje y el entretenimiento. Después de todo, casi nadie quiere ver anuncios de productos que no les interesan. Sin embargo, la arquitectura de este control tiene una grave desventaja, planteando cuestiones fundamentales sobre la libertad y la democracia (SUNSTEIN, 2017, p. 14). De esto, el profesor cuestiona cuáles serían las condiciones sociales para la libertad individual y para que un sistema democrático funcione bien:

¿Podría ser importante la mera casualidad, incluso si los usuarios no la desean? ¿Podría un universo de comunicaciones perfectamente controlado – un feed personalizado – ser una especie de distopía en sí? ¿Cómo pueden las redes sociales, la explosión de las opciones de comunicación, el aprendizaje automático y la inteligencia artificial cambiar la capacidad de los ciudadanos para gobernarse a sí mismos? (SUNSTEIN, 2017, p. 14,).

Sunstein concluye que estas cuestiones están estrechamente relacionadas y aboga por una arquitectura digital de serendipity. Chance evitaría que la inteligencia artificial utilizara los datos personales de los usuarios para mejorar su experiencia on-line. Al no obtener esta información orientada al marketing, no habrá datos personales que se utilicen para manipular los intereses políticos. Esta medida sería “para el beneficio de la vida individual, los comportamientos grupales y la democracia misma” (SUNSTEIN, 2017, p. 16). En la medida en que los proveedores son capaces de crear algo como experiencias personalizadas o comunidades cerradas para cada usuario, o temas favoritos y grupos preferidos, es importante que se tenga cuidado. “El autoaislamiento y la personalización son soluciones a algunos problemas genuinos, pero también difunden falsedades y promueven la polarización y la fragmentación” (SUNSTEIN, 2017, pág. 17). Esta es una aclaración importante al analizar la naturaleza de la libertad, tanto personal como política, y el tipo de comunicación digital que mejor se adapte a un orden democrático.

2.1.2 INTERACTUAR CON EL USUARIO

En otro estudio, realizado en el Centro de Tecnologías de la Información y la Comunicación de la Fundación Bruno Kessler en Italia, se analizó, “a nivel microscópico, cómo las interacciones sociales pueden conducir a fenómenos globales emergentes como la segregación social, la difusión de la información y el comportamiento”(STELLA; FERRARA; DOMENICO, 2018, p.1). Los autores afirman que los sistemas digitales no sólo están poblados por seres humanos, sino también por bots, que son agentes controlados por software para fines específicos que van desde el envío de mensajes automatizados hasta incluso asumir comportamientos sociales o antisociales específicos. Por lo tanto, los bots pueden afectar a la estructura y función de un sistema social (STELLA; FERRARA, NUEVO 2010. DOMENICO, 2018, p.1).

Pero, ¿cómo pueden los bots interactuar con los usuarios? Grassi Amaro, profesor de doctorado en FGV explica:

Los robots se utilizan en las redes sociales para propagar información falsa y maliciosa, o generar un debate artificial. Para ello, necesitan tener tantos seguidores como sea posible (GRASSI et al., 2017, p.12) […]. De esta manera, los robots añaden un gran número de personas al mismo tiempo y siguen páginas reales de personas famosas, además de seguir y ser seguidos por un gran número de robots, para que terminen creando comunidades mixtas – que incluyen perfiles reales y falsos (FERRARA et al., 2016 apud GRASSI et al., 2017, p.12).

Algunos bots tienen mecanismos para imitar el comportamiento humano, para ser reconocidos como tales, tanto por los usuarios como por otros bots. Otros sólo tienen como objetivo desviar la atención a un tema dado (GRASSI et al., 2017, p.12). Con el aprendizaje automático, el sistema puede identificar humanos y robots a través del comportamiento del perfil, como tener en cuenta “que los usuarios reales pasan más tiempo en la red intercambiando mensajes y visitando el contenido de otros usuarios, como fotos y videos, mientras que las cuentas de robots pasan tiempo investigando perfiles y enviando solicitudes de amistad” (GRASSI et al. , 2017, p.14).

Conociendo el perfil de cada usuario y sabiendo cómo interactuar con ellos, los bots pueden ser utilizados para influir en pensamientos, acciones e incluso iniciar movimientos sociales y políticos. Por lo tanto, es importante entender el papel de la inteligencia artificial en los asuntos políticos y, en consecuencia, en el proceso electoral democrático.

2.2 NOTICIAS FALSAS

Fake News ya se ha convertido en un término conocido en Brasil, sin embargo, es importante destacar su definición y explicación. Según Ruediger y Grassi:

Las noticias falsas, o notícias falsas en portugués, se han convertido en una expresión comúnmente adoptada para identificar la divulgación de información falsa, especialmente en Internet. Sin embargo, las evoluciones de este fenómeno en la sociedad en red han demostrado que el término no es capaz de explicar la complejidad de sus prácticas, convirtiéndose, en numerosas ocasiones, en un instrumento de un discurso político que se beneficia de tal simplificación. (RUEDIGER; GRASSI, 2018a, p.8)

En Brasil, el estudio de FGV DAPPmuestra que los bots “buscan crear discusiones forjadas e interferir en los debates” mediante la creación de desinformación que puede interferir en los procesos electorales y democráticos. El estudio muestra que la aparición de cuentas automatizadas permitió estrategias de manipulación a través de rumores y difamación. Además de los robots, también se identificaron cyborgs (cuentas parcialmente automatizadas) (RUEDIGER; GRASSI, 2018, p.12).

Los estudios sobre la influencia de las Fake News en las elecciones estadounidenses han indicado que una de cada cuatro personas ha estado expuesta a rumores falsos. Sin embargo, estas noticias representaron sólo el 2,6% del universo noticioso y el 60% de las visitas a estos informes se transmitieron al electorado con un sesgo más conservador, que representó el 10% del electorado. A pesar de que las noticias falsas no tienen un número significativo dentro del corpus de las noticias electorales, ha sido capaz de influir en el sistema político y acentuar la polarización política. El uso de noticias falsas fabricadas es un fenómeno antiguo, pero las redes sociales y los avances tecnológicos han llevado la desinformación a un nivel nunca antes visto (DELMAZO; VALENTE, 2018 apud RUEDIGER; GRASSI, 2018, p.13).

Las fake news tienen un poder devastador, y ya han llamado la atención de la Justicia Electoral, que prefiere utilizar el término “desinformación”. Sin embargo, siempre se han producido noticias falsas, especialmente en los períodos electorales. El mayor peligro reside en el software y los programas que identifican los objetivos ideales para recibir esta desinformación. Así como bots, que ayudan en la formación de cámaras de echo chambers que permiten una mayor difusión de noticias falsas.

3. LA INTELIGENCIA ARTIFICIAL Y SU PAPEL INFLUYENTE EN LAS ELECCIONES

Según un experimento realizado en la Universidad de Oxford, en conjunto con el Instituto Alan Turing y el Departamento de Economía Política de la Universidad Kings en Londres en 2017, el comportamiento político ocurre cada vez más en plataformas digitales, donde se presenta a la gente una variedad de información social. (HALE et al, 2017, p.1).

Este experimento buscó entender cómo la “información social” da forma a la participación política de los votantes. Explica que la información social es lo que la gente está haciendo, o han hecho, tanto en el mundo digital como en el mundo real y tiene una larga historia en Psicología Social. Sin embargo, es difícil observar lo que un gran número de personas están haciendo off-line. Por otro lado, en el mundo digital, “muchas plataformas on-line indican claramente cuántas personas han gustado, seguido, retuiteado, firmado peticiones o tomado varias acciones”. (HALE et al, 2017, p.2)

El estudio concluye que la estructura de las plataformas digitales puede tener efectos significativos en los comportamientos políticos de los usuarios. Del mismo modo, el estudio sugiere que la información social puede “exacerbar las turbulencias en la movilización política” (HALE et al, 2017, p.16).

En 2012, otro estudio fue publicado por el Departamento de Ciencias Políticas de la Universidad de California (EE.UU.). El experimento se llevó a cabo de manera controlada a través de mensajes de movilización política entregados a 61 millones de usuarios de Facebook durante las elecciones al Congreso de Estados Unidos de 2010. (BOND, 2012, p.1):

“Los resultados muestran que los mensajes influyeron directamente en la autoexpresión política, la búsqueda de información y el comportamiento de voto en el mundo real de millones de personas. Además, los mensajes influyeron no sólo en los usuarios que los recibieron, sino también en los amigos de los usuarios y los amigos de los amigos. El efecto de la transmisión social en el voto en el mundo real fue mayor que el efecto directo de los propios mensajes, y casi toda la transmisión se produjo entre “amigos cercanos” que eran más propensos a tener una relación cara a cara. Estos resultados sugieren que los lazos fuertes son clave para difundir el comportamiento on-line y en el mundo real en las redes sociales humanas”. (BOND, 2012, p.1).

Los resultados de este estudio tienen muchas implicaciones. La movilización política en la red funciona provocando la autoexpresión política y también induciendo la recopilación de información social. También se ha demostrado que la movilización social en las redes on-line es significativamente más eficaz que la movilización informativa. El hecho de que la información vista on-line de rostros conocidos puede mejorar dramáticamente la eficacia de un mensaje de movilización. Además de los efectos directos de la movilización on-line, se demostró que la importancia de la influencia social afectaba al cambio en el comportamiento de los usuarios (BOND, 2012, p.5).

Por lo tanto, al tratar de influir en el comportamiento de un usuario fuera del mundo digital, uno debe prestar atención “no sólo al efecto que un mensaje tendrá en quienes lo reciben, sino también a la probabilidad de que el mensaje y el comportamiento que estimula se propaguen de persona a persona a través de la red social”. (BOND, 2012, p.5). Este experimento sugiere que la mensajería on-line puede influir en una variedad de comportamientos off-line, y sus autores ya estaban preocupados en 2012 con la comprensión del papel de las redes sociales en la sociedad. Recordando que:

Las sociedades son sistemas complejos que tienden a polarizarse en subgrupos de individuos con perspectivas dramáticamente opuestas. Este fenómeno se refleja – y a menudo amplificado – en las redes sociales on-line, donde, sin embargo, los seres humanos ya no son los únicos participantes y coexisten con los bots sociales – es decir, las cuentas controladas por software (STELLA; FERRARA, NUEVO 2010. DOMENICO, 2018, p.1,).

La información consolidada de datos obtenida por casi 4 millones de mensajes de Twitter generados por casi 1 millón de usuarios. En este análisis, se identificaron los dos grupos polarizados de Independientes y Constitucionalistas y se cuantificaron los roles estructurales y emocionales desempeñados por los bots sociales. Se ha demostrado que los bots actúan en áreas del sistema social para atacar a seres humanos influyentes de ambos grupos. En este referéndum, los independientes fueron bombardeados con contenido violento, aumentando su exposición a narrativas negativas e inflamatorias, exacerbando los conflictos sociales on-line. (SUNSTEIN, 2017, p. 7; STELLA; FERRARA; DOMENICO, 2018, p.1). Estos hallazgos enfatizan la importancia de desarrollar medidas para desenmascarar estas formas de manipulación social automatizada, ya que las redes sociales pueden afectar profundamente el comportamiento de voto de millones de personas:

Al interferir en el desarrollo de debates sobre las redes sociales, los bots están afectando directamente a los procesos políticos y democráticos a través de la influencia de la opinión pública. Su acción puede, por ejemplo, producir una opinión artificial, o una dimensión irreal de una opinión o figura pública dada, compartiendo versiones de un tema determinado, que se extendió en la red como si hubiera, entre la parte de la sociedad representada allí, una opinión muy fuerte sobre un tema dado (Davis et al., 2016 apud GRASSI et al., 2017, p.14).

Es posible que el lector piense que su opinión sobre un candidato en particular no cambiará debido a la influencia de los mensajes producidos por los bots. Sin embargo, el objetivo de esta piratería social son los votantes indecisos. Como explica Grassi et al., el intercambio coordinado de una cierta opinión, le da “un volumen irreal que influy[…]e en los usuarios indecisos sobre el tema y el fortalecimiento de los usuarios más radicales en el debate orgánico, dada la ubicación más frecuente de los robots en los polos del debate político”. (2017, p.14)

3.1 CONSECUENCIAS PARA LAS CAMPAÑAS ELECTORALES

Las Fake News, los bots y las cámaras de echo chambers pueden cambiar el curso de una elección, como se ha discutido y mostrado ampliamente en el capítulo anterior.Cambridge Analytics utilizó la siguiente línea en una presentación de ventas de sus servicios: “Somos una agencia de cambio de comportamiento. El santo grial de las comunicaciones es cuando empiezas a cambiar de comportamiento [das pessoas]”. (PRIVACIDAD…, 2019)

Las Cámaras De echo chambers pueden llevar a la gente a creer en las falsedades, y puede ser difícil o imposible corregirlas. Una ilustración, hecha por el profesor Sunstein, es la creencia de que el presidente Barack Obama no nació en los Estados Unidos. Como falsedades, esto no es lo más dañino, sino que refleja y contribuye a una política de sospecha, desconfianza y, a veces, de odio.

Otro ejemplo más dañino es el conjunto de falsedades que ayudaron a producir el voto para “Brexit”[6] en 2016. Las noticias falsas sobre Turquía supuestamente forman parte de la Unión Europea y, en consecuencia, la apertura del Reino Unido a la inmigración masiva de turcos en el país fueron esenciales para el resultado del referéndum. En la campaña presidencial de 2016 en los Estados Unidos, las falsedades se propagan rápidamente en Facebook y todavía están en todas partes. (SUNSTEIN, 2017, p.20; PRIVACIDADE…, 2019). Según Sunstein, “hasta el día de hoy, las redes sociales no han ayudado a producir una guerra civil, pero ese día probablemente llegará. Ya han ayudado a prevenir un golpe de Estado en Turquía en 2016” (SUNSTEIN, 2017, p.20):

Hay una pregunta sobre la libertad individual. Cuando las personas tienen múltiples opciones y la libertad de elegir entre ellas, tienen libertad de elección, y eso es extremadamente importante. La libertad requiere ciertas condiciones de fondo, permitiendo a las personas expandir sus propios horizontes y aprender lo que es verdad. Implica no sólo la satisfacción de las preferencias y valores que tienen las personas, sino también las circunstancias favorables a la libre formación de preferencias y valores. Pero si la gente califica en comunidades afines, su propia libertad está en riesgo. Viven en una prisión de su propia creación. (SUNSTEIN, 2017, p.20).

Cuando los electores indecisos no saben lo que es cierto, sus elecciones pueden verse comprometidas durante el proceso electoral, lo que afectaría directamente la democracia y el derecho a elegir votar, e incluso puede cambiar el resultado de una elección.

3.2 CONSECUENCIAS EN BRASIL

El proceso electoral que se produjo en 2018 constituye un plazo para entender el uso de plataformas digitales para la propaganda electoral, así como para combatir la difusión de la desinformación.

3.2.1 INTERACCIÓN CON BOTS

La Dirección de Análisis de Políticas Públicas de FGV [7](FGV-DAPP) realizó algunos estudios de caso para analizar la presencia de bots en situaciones políticas importantes en Brasil, tales como: el debate de Rede Globo el 2 de octubre de 2014 con los candidatos presidenciales en la primera ronda de elecciones; el debate de Rede Globo el 24 de octubre de 2014 con los candidatos presidenciales Dilma Rousseff y Aécio Neves, que competían para la segunda vuelta de las elecciones; las manifestaciones a favor del impeachment celebradas el 13 de marzo de 2016; el debate de Rede Globo con los candidatos a la alcaldía de São Paulo el 29 de septiembre de 2016; la huelga general el 28 de abril de 2017 y la votación sobre la Reforma Laboral en el Senado el 11 de julio de 2017 (GRASSI et al., 2017, p.16)

El profesor de FGV explica cómo se recopilan los datos:

Las masas de datos recopilados por FGV/DAPP se componen de metadatos —información sobre los datos en sí— y a través de ellos, exploramos las posibilidades de identificar cuentas que han actuado automáticamente durante los períodos de los análisis. Por lo tanto, identificamos que los metadatos llamados generator se refieren a la plataforma que genera el contenido del tweet, que es muy útil para detectar robots. (GRASSI et al., 2017, p.16)

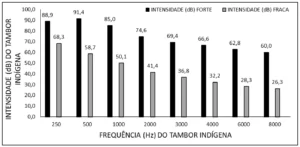

Con el fin de ilustrar el funcionamiento de los robots en cuestión, FGV elaboró un gráfico (FIG. 1), con los resultados obtenidos del análisis realizado durante la votación sobre la Reforma Laboral en el Senado. En el gráfico, los puntos rosados representan cuentas que utilizaban generadores sospechosos (GRASSI et al., 2017, p.17) y puntos verdes, cuentas que generaron al menos dos tweets consecutivos en menos de un segundo (p.18). En este caso, como en los demás, los robots están presentes en ambos extremos del debate, “estando en este análisis en mayor número en el polo contrario a la reforma” (pág. 23).

Figura 1: Votación por la reforma laboral

Estos análisis muestran que las acciones automatizadas de los bots han sido eficaces para llevar a cabo el debate público, “cada vez más presente en las redes, influyendo directamente en los momentos de inflexión y determinantes para el futuro”. (GRASSI et al., 2017, p.26).

Debido al éxito de este estudio, llamado Robôs, Redes Sociais e Política No Brasil, que detectó la presencia de robots en Twitter (GRASSI et al., 2017), FGV DAPP fue invitado a participar en el Consejo Asesor de Internet y Elecciones [9]del Tribunal Superior Electoral (TSE). (RUEDIGER; GRASSI, 2018, p.4). En julio de 2018 se puso en marcha en Rio de Janeiro la Sala de la Democracia Digital[10], que tenía como objetivo “monitorizar el debate público en la web e identificar acciones de desinformación, amenazas e intervenciones ilegítimas en el proceso político, con la publicación de análisis diarios y semanales”. FGV DAPP, a través de un hotsite[11] te y una aplicación #observa2018, diseccionó el análisis de las redes. (RUEDIGER; GRASSI, 2018, p.5).

Entre estas publicaciones, un análisis realizado durante la semana del 8 al 13 de agosto de 2018, FGV DAPP “detectó, a través de su propia metodología de identificación de robots, la presencia de 5.932 cuentas automatizadas en el debate sobre las elecciones y candidatos presidenciales. Estos perfiles generaron 19.826 publicaciones” (RUEDIGER, 2018, p.4) sólo en la red social Twiter:

En 2018, Facebook anunció acciones para proteger las elecciones en Brasil. Entre los compromisos se encontraba la lucha contra la desinformación; mayor transparencia de los anuncios en la plataforma; la eliminación de las cuentas de impostor; y la eliminación de los santinhos digitais utilizados para engañar a los votantes colocando la foto de un candidato y el número de partido de otro. Estas y otras medidas se han adoptado para garantizar la autenticidad de los contenidos publicados en la plataforma (RUEDIGER; GRASSI, 2018a, p.16)

Pero eso no parece ser suficiente. El análisis FGV-DAPP durante las campañas electorales de 2018 muestra que “las interferencias promovidas por los robots a menudo ocurrieron de manera articulada y sincronizada, a partir de botnets (redes robóticas)” (RUEDIGER; GRASSI, 2018a, p.27). Los siguientes son los resultados del análisis realizado:

En el período previo a la campaña, al menos tres redes de robots fueron responsables de publicar 1.589 tweets en una semana. Los mensajes buscaban, en general, impulsar y/o desmovilizar las candidaturas, especialmente en los centros de mayor polarización: Jair Bolsonaro-Lula/Haddad.

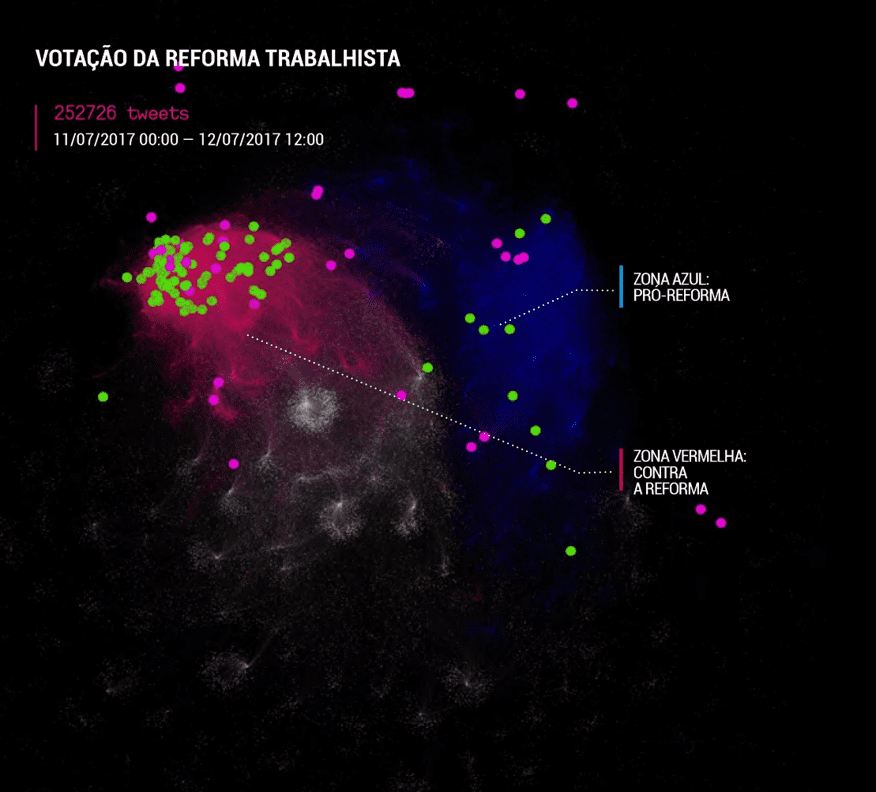

Las bases pro-Bolsonaro y pro-Fernando Haddad fueron también las que más interferencias presentaron robots durante el período de campaña. Del 12 al 18 de septiembre, por ejemplo, se recogieron 7.465.611 tweets y 5.285.575 retuitas con respecto a los candidatos. Dentro de esta base de datos, la metodología de detección de robots de FGV DAPP encontró 3.198 cuentas automatizadas, que generaron 681.980 interacciones, 12,9% del total de retweets gráficos a continuación.

A la derecha, las cuentas automatizadas representaron el 17,8% de los retweets del grupo favorables al diputado federal de la PSL; a la izquierda, representaron el 13,2% de las interacciones alineadas con la candidatura del PT y, en menor medida, la candidatura de Guilherme Boulos del PSol. (RUEDIGER; GRASSI, 2018a, p.28)

Figura 2: Interacciones con robots en las Elecciones de 2018

WhatsApp tiene una naturaleza de comunicación privada y no pudo ser analizado por FGV-DAPP, sin embargo, señaló lo siguiente:

Dadas las particularidades de la plataforma, como la naturaleza de la comunicación privada, la reducción del alcance social (familia, amigos, compañeros de trabajo) y la menor interacción directa entre los influencers y los ciudadanos de a pie, hubo un fenómeno diferente de dispersión y viralización de los contenidos políticos que el observado en otros escenarios recientes (nacionales e internacionales), en los que Facebook y Twitter estaban en mayor protagonismo. Las muchas redes sociales ahora populares entre los brasileños, ampliamente utilizadas para debatir las elecciones y la coyuntura política, presentan particularidades con respecto al proceso de producción e interacción con el contenido. Todas las estrategias de propagación de información, sin embargo, se adaptan a las propiedades de cada plataforma, y con esto hay múltiples formas de manifestar la desinformación y el intercambio de información falsa. No sólo a partir de enlaces o páginas que simulan la actividad periodística, sino con un uso intenso de vídeos, tutoriales, blogs, memes, textos apócrifos y publicaciones sensacionales; varios subtipos de Fake News, por lo tanto. (RUEDIGER; GRASSI, 2018a, p.29)

Aunque no se ha demostrado que las interacciones con los bots o la difusión de noticias falsas hayan alterado el resultado de las elecciones presidenciales de 2018 en Brasil, es necesario ser consciente de esta posibilidad. Como ya se ha demostrado, la ya desaparecida compañía Cambridge Analytics logró elegir al candidato de la agencia de campaña que la contrató en las elecciones presidenciales de Estados Unidos de 2016.

El actual Presidente de la República fue elegido con un pequeño tiempo de propaganda electoral en la televisión, lo que demuestra que habría sido elegido por su campaña en plataformas sociales. Ha habido un “cambio estructural en la forma en que se han organizado campañas exitosas— las redes sociales se han convertido en el principal eje de diálogo entre los votantes y los funcionarios electos” (RUEDIGER; GRASSI, 2018a, p.29).

Por otro lado, Ruediger y Grassi reportan consecuencias positivas en este escenario digital. Entre ellos destacan:

1) la mayor demanda de transparencia en las relaciones institucionales de la política; 2) la capacidad de actuar e interferir rápidamente en el proceso de toma de decisiones de los agentes estatales y representantes electos, a través del contacto directo con ellos a través de Internet;

3) y la expansión del papel potencial que el ciudadano puede desempeñar en la conducción de las políticas públicas y actos que le interesen. La retroalimentación acelerada y la velocidad de transmisión, intercambio y producción de contenidos, mejoras en la forma en que la actividad periodística y el debate político responden a estos nuevos paradigmas (2018a, p.29-30) también se vuelven imprescindibles.

3.2.2 DIFUSIÓN DE NOTICIAS FALSAS

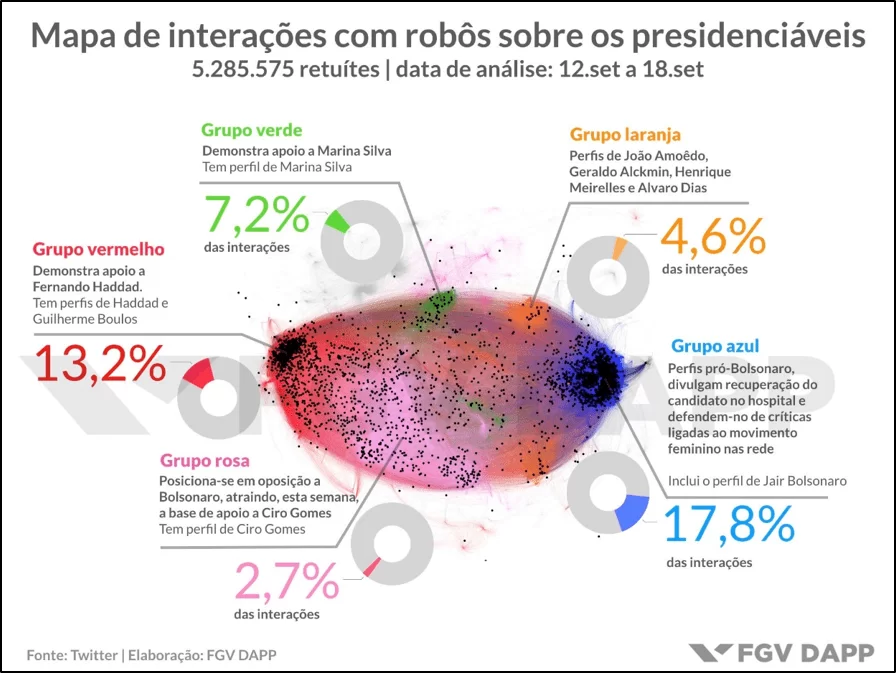

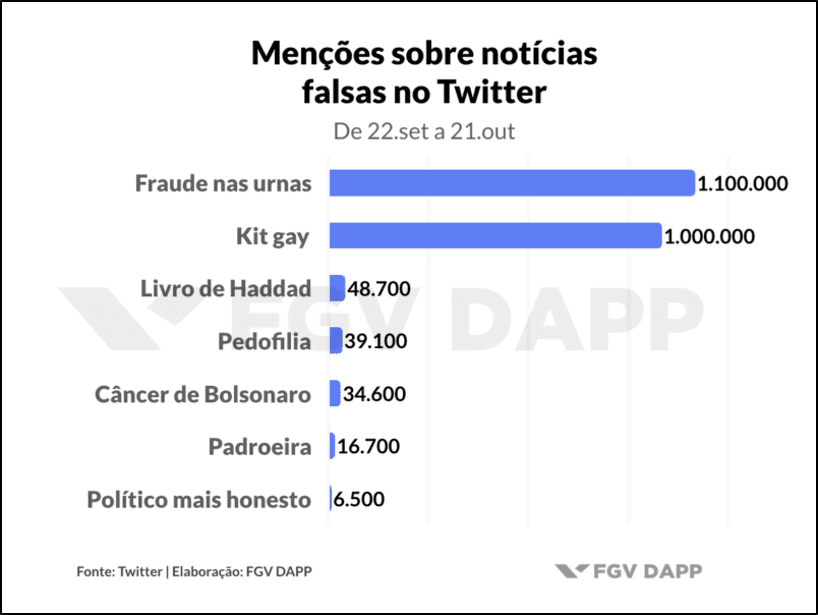

El análisis FGV-DAPP realizado durante el período electoral de 2018 concluyó que “no había distribución automatizada y masiva de noticias falsas”. Afirma que la desinformación estaba presente, “pero los robots no fueron los más responsables de su difusión”. En la semana del ataque con cuchillo contra Bolsonaro, por ejemplo, sólo el 0,9% de las interacciones fueron automatizadas a partir de robots (RUEDIGER; GRASSI, 2018a, p.29). Según el análisis, las noticias falsas que más destacaron eran las relacionadas en higo. 3:

Figura 3: Noticias falsas

3.3 CONSECUENCIAS PARA LA DEMOCRACIA

En 2016, las elecciones presidenciales de Estados Unidos llamaron la atención sobre nuevas formas de hacer campañas políticas y políticas a través de plataformas digitales. Las elecciones involucraron casos de fake news que tuvieron repercusiones en todo el mundo, como “la supuesta influencia de los hackers rusos que a través de la Internet Research Agency habrían generado contenido falso” y llegado a millones de votantes a través de Facebook y Twitter. (RUEDIGER; GRASSI, 2018, p.12)

Antes de eso hubo un referéndum en el Reino Unido sobre su retirada de la Unión Europea. En las investigaciones llevadas a cabo en el período de 2017 a principios de 2019 se demostró que la empresa Cambrigde Analytics junto con otras agencias influyó en el resultado de los votos, dirigiendo sus mensajes falsos a un cierto grupo de personas. La compañía fue capaz de perfilar a los votantes utilizando los datos de los usuarios de Facebook. El escándalo de Facebook fue reportado en todo el mundo a principios de 2018 con la publicación de datos encontrados por la periodista británica Carole Cadwalladr (ROSENBERG; CONFESSORE; CADWALLADR, 2018) que desde entonces ha estado hablando de esta nueva amenaza para la democracia. El Parlamento cerró finalmente sus investigaciones y publicó un informe a principios de 2019. Cabe destacar algunas conclusiones sobre el uso de estas plataformas:

La ley electoral no es apta para el propósito y necesita ser cambiada para reflejar los cambios en las técnicas de campañ[…]a. Debe haber: transparencia absoluta de las campañas políticas on-line, incluidas marcas claras y persistentes en todos los anuncios y vídeos políticos pagados, indicando la fuente y el anunciante; una categoría introducida para el gasto digital en campañas; y reglas explícitas en torno al papel y las responsabilidades de los defensores designados.

Los elementos publicitarios políticos deben ser accesibles públicamente en un repositorio con capacidad de búsqueda , quién paga por los anuncios, qué organizaciones patrocinan el anuncio, quién está siendo dirigido por anuncios, para que los miembros del público puedan comprender el comportamiento de los anunciantes individuales. Debe ejecutarse independientemente de la industria publicitaria y de los partidos políticos. (HOUSE…, 2019, p.24)

Se observa que “las sociedades democráticas de todo el mundo han experimentado en los últimos años el surgimiento de un nuevo actor de la comunicación para dar forma exitosa, con éxito o no, a la opinión pública en debates políticos, elecciones, referendos y crisis nacionales: desinformación” (RUEDIGER; GRASSI, 2018a, p.4). La difusión de campañas falsas basadas en fake news a través de plataformas digitales en momentos clave de la sociedad, junto con la acción de la inteligencia artificial en el control de los bots de cuentas automatizadas, “se ha convertido en una herramienta clave en la estrategia de ciertos grupos para atraer el tráfico digital, involucrar o incluso influir en debates, desmovilizar a los oponentes y generar falso apoyo político” (RUEDIGER; GRASSI, 2018a, p.4) convirtiéndose en una gran amenaza para las democracias de todo el mundo.

Otro peligro que las plataformas digitales presentan a la democracia es la facilidad que existe para la formación de cámaras de echo chambers, ya discutidas en este trabajo. Los grupos aislados aumentan la polarización política y el odio, dando aún más combustible al funcionamiento de los robots y la difusión de noticias falsas.

Pero la pregunta unificadora en la mayor medida serán los diversos problemas para una sociedad democrática que puede ser creada por el poder de filtrar. Las democracias pueden o no ser frágiles, pero la polarización puede ser un problema grave, y se incrementa si las personas residen en diferentes universos de comunicación – como, de hecho, a veces parecen hacer en los Estados Unidos, el Reino Unido, Francia, Alemania y otros lugares. No hay duda de que el entorno de comunicación moderno, incluidas las redes sociales, contribuye al auge del partidismo. (SUNSTEIN, 2018, p.36)

Cualquier grupo extremista, terrorista o cualquier partido político que tenga los medios para controlar las plataformas de medios sociales tendría entonces el poder de gobernar después de influir en una elección teóricamente democrática, que presentaría una serie de amenazas para el sistema democrático.

En este sentido, Carole Cadwalladr, en el documental Privacidade Hackeada, hace un atractivo conmovedor para reflexionar sobre cómo las redes sociales pueden ser utilizadas para propagar el mal y el odio, polarizando a los países:

Parece que estamos entrando en una nueva era. Podemos ver que los gobiernos autoritarios están en aumento. Y están usando esta política de odio y miedo en Facebook. Mira Brasil. Hay un extremista de derecha que fue elegido y sabemos que WhatsApp, que es parte de Facebook, estaba claramente implicado en la difusión de Fake News. Y mira lo que pasó en Myanmar. Hay evidencia de que Facebook fue utilizado para incitar al odio racial que causó genocidio. También sabemos que el gobierno ruso estaba usando Facebook en los Estados Unidos. Hay pruebas de que los rusos crearon memes falsos de Black Lives Matter, y cuando la gente hizo clic en ellos se dirigía a páginas donde en realidad fueron invitados a protestas organizadas por el gobierno ruso. Y al mismo tiempo estaban estableciendo páginas que apuntaban a grupos opuestos, como Blue Lives Matter. La cuestión es alimentar el miedo y el odio para volver al país contra sí mismo. Dividir y conquistar. Estas plataformas que fueron creadas para conectarnos ahora se utilizan como armas y es imposible saber qué es lo que está pasando en las mismas plataformas donde hablamos con nuestros amigos o compartimos fotos de bebés. Nada es lo que parece” (PRIVACIDADE …, 2019, 96 min)

4. JUSTICIA ELECTORAL EN BRASIL

La Justicia Electoral tiene como alcance llevar a cabo la “verdad electoral”, para la realización de la democracia (VELLOSO, 1996, p.9 apud VELLOSO; AGRA, 2016), esto significa que la Justicia Electoral es responsable de “permitir la expresión de la voluntad de los electores, poner en funcionamiento todos los procedimientos electorales para que se desarrollen en armonía y transparencia, sin ser perturbados por la soberanía popular” (VELLOSO; AGRA, 2016).

La Justicia Electoral es responsable de disciplinar y organizar el ejercicio del sufragio para lograr la soberanía popular. Es a través de las elecciones que se garantiza la libre formación de la voluntad del votante y la igualdad entre los candidatos, garantizando la democracia brasileña.

Arte. 105 de la Ley Electoral (9.504/97) dice que el Tribunal Superior Electoral tiene función normativa. “Puede dar todas las instrucciones necesarias para su ejecución fiel, escuchando, de antemano, en una audiencia pública, a los delegados o representantes de los partidos políticos.” Por lo tanto, el TSE puede editar reglas para controlar el uso de plataformas digitales para las campañas electorales.

4.1 RESPONSABILIDAD DE LA JUSTICIA ELECTORAL EN EL USO DE PLATAFORMAS DIGITALES

En 2017, el TSE modificó la Ley No 9.504/1997 (Wording dictada por la Ley No 13.488, 2017), dando una nueva redacción al arte. 57 para que plataformas digitales como Facebook, Twitter y otras puedan ser utilizadas en campañas electorales a partir de agosto del año electoral. Así, durante la campaña para las Elecciones Presidenciales en 2018 se dijo mucho a favor de este método que con poca inversión financiera, genera más resultados.

El gran análisis de los medios de comunicación, la contabilidad posterior de las encuestas, se centró en cómo el candidato presidencial con más tiempo en la televisión (SHALDERS, 2018), Geraldo Alckmin (PSDB) ni siquiera fue elegido para la segunda vuelta, mientras que el candidato electo, Jair Bolsonaro (PSL), que sólo tenía 8 segundos en tiempo de elecciones obtuvo resultados mucho más altos. El propio Presidente ha utilizado a menudo su espacio en las redes sociales para elogiar el hecho de que su campaña electoral costó mucho menos que la de otros candidatos de alto peso. Del mismo modo, el candidato João Amoedo (partido NOVO), hasta ahora desconocido para la mayoría de la población brasileña, también obtuvo resultados expresivos sin participar en ningún debate promovido por los canales de televisión y haciendo uso de las redes sociales, quedando en el 5o lugar en la primera ronda, por delante de otros candidatos más conocidos. Así, las elecciones de 2018 reflejaron los cambios en el escenario de campaña política que a partir de ese momento también ocurrieron a través de plataformas digitales.

Sin embargo, después del Escándalo de Facebook y la ahora desaparecida compañía británica Cambridge Analytica, el mundo se dio cuenta de lo rentable que puede ser el mercado de datos personales. En Brasil, existen leyes que prohíben y criminalizan la compra de votos[15], pero estas leyes ya no contienen la realidad actual de las campañas electorales. Puedes gastar cualquier cantidad de dinero en anuncios en Facebook, Google o YouTube, y nadie lo sabrá, porque esos datos son inaccesibles. Lo que tiene es responsabilidad con el TSE, lo que le permitiría saber cuánto se gastó en estos anuncios, pero el contenido del mismo nunca se revelará. Carole Cadwalladr, en su presentación en una conferencia TED en abril de este año, afirma:

… lo que sucede en Facebook se queda en Facebook, porque sólo vemos el contenido de nuestra página, que luego desaparece. Es imposible investigar nada. No tenemos idea de quién vio qué anuncios, cuál fue su impacto o qué datos se utilizaron para elegir el público objetivo. Ni siquiera quién colocó los anuncios, cuánto dinero se gastó o qué nacionalidad eran. (CADWALLADR, 2019)

El sorprendente número de estudios y datos existentes que muestran la relación entre la interacción de los bots que influyen en los usuarios durante los períodos electorales, muestran cuánto “las plataformas deben estar atentas al cumplimiento del marco legal para las campañas electorales en las redes sociales” (RUEDIGER; GRASSI, 2018, p.25). A tal fin, el TSE debe crear normas que supervisen mejor si las plataformas cumplen los límites ya previstos por la ley. Es responsabilidad de la Corte garantizar la suavidad de las elecciones y proteger la democracia. Ruediger sugiere además:

… el sorprendente volumen de interacciones de candidaturas, en Twitter, Facebook, YouTube e Instagram, indican que las plataformas deben estar atentas al cumplimiento del marco legal para las campañas electorales en las redes sociales para, en paralelo, mantener las llamadas de los usuarios a sus políticas y estándares (RUEDIGER; GRASSI, 2018, p.25).

El TSE no debe permitir campañas electorales en estas plataformas que sean inaccesibles e imposibles de monitorear. No hay manera de supervisar la posible manipulación de un público objetivo en particular mediante anuncios para este fin. Por lo tanto, es necesario establecer normas para obligar a las plataformas sociales a hacer lo que sugirió el informe del Parlamento británico citado anteriormente, identificando a los autores de publicaciones con contenido electoral.

Caldas e Caldas explican lo que se ha hecho, en relación con este tema, en otras partes del mundo:

En este sentido, la Unión Europea creó el 25 de mayo de 2018 el Reglamento General de Protección de Datos (Comisión Europea, 2018) tras estudios que indicaban que la difusión de fake news se realizaba a partir del análisis de los datos de los usuarios (MARTENS et al., 2018 apud CALDAS; CALDAS, p.214, 2019). En esta dirección, el 11 de junio de 2018, el Consejo Nacional de Derechos Humanos aprobó la Recomendación Núm. 04, de 11 de junio de 2018, que se ocupa de “las medidas para combatir las fake news y la garantía del derecho a la libertad de expresión” (BRASIL, 2018b apud CALDAS; CALDAS, p.214, 2019), que recomienda la aprobación de un proyecto de ley destinado a la protección de datos personales (BRASIL, 2018o apud CALDAS; CALDAS, p.214, 2019), considerando que “la producción y focalización de las llamadas fake news hoy están directamente relacionadas con la recopilación y tratamiento masivo e indiscriminado de datos personales” (BRASIL, 2018b apud CALDAS; CALDAS, p.214, 2019) (CALDAS; CALDAS, p.214, 2019).

5. CÓMO LA TSE HA TRATADO ESTE TEMA DESDE LAS ELECCIONES DE 2018

En mayo de 2019, el TSE celebró un Seminario Internacional sobre fake news y elecciones junto con la Unión Europea. El seminario tuvo lugar en Brasilia y contaba con varios oradores, entre ellos: la Ministra Rosa Weber, Presidenta del Tribunal Superior Electoral (TSE), el Ministro Luiz Fux, el Vicepresidente del Tribunal Supremo Federal (STF) y el Ministro Sergio Moro, Ministro de Justicia y Seguridad Pública.

Según el sitio web del TSE sobre el seminario:

Durante el año 2018, el Consejo Asesor de Internet y Elecciones, establecido por el Tribunal Superior Electoral (TSE) el 7 de diciembre de 2017, desarrolló numerosas actividades relacionadas con la influencia de Internet en las elecciones, en particular en lo que respecta al riesgo de fake news y el uso de robots en la difusión de información, acciones que contribuyeron a la expansión del conocimiento de la justicia electoral frente al tema , con el fin no sólo de prevenir, sino también de facilitar la confrontación del grave problema relacionado con la difusión de fake news durante las elecciones generales de 2018. (BRASIL, 2019f).

Todavía en el Seminario, el TSE reconoce su responsabilidad principal en la protección de la democracia brasileña cuando afirma:

Teniendo en cuenta la compleja ecuación del fenómeno conocido como Fake News, en todas las ramas de la sociedad, tanto en Brasil como en el extranjero, corresponde a la Justicia Electoral vigilar el problema, orientado a encontrar formas más efectivas de hacer frente a futuras elecciones. (BRASIL, 2019f).

El objetivo principal del seminario fue plantear formas de prevenir o minimizar la difusión de noticias falsas en las elecciones municipales de 2020, teniendo en cuenta la experiencia adquirida durante las elecciones de 2018. Por lo tanto, se pretendía recopilar los datos, compartir experiencias, dar la bienvenida a sugerencias, discutir sobre medidas viables para combatir las noticias falsas, así como promover una fuente de estudios y propuestas que se remitirán al Tribunal Electoral y al Congreso Nacional (BRASIL, 2019f).

En febrero de este año, se publicó la ordenanza No 115 en el portal del TSE, que “establece un grupo de trabajo responsable de realizar estudios para identificar conflictos en la norma actual derivados de las reformas electorales y proponer la respectiva sistematización” (BRASIL, 2019a). De esta ordenanza nacen Diálogos para a construção da Sistematização das Normas Eleitorais, estudos preliminares con el objetivo de:

… identificar y sistematizar la legislación pertinente, señalando incoherencias, omisiones y/o sobrerregulación, con la Constitución Federal como parámetro y a partir de los textos legislativos, resoluciones e incluso discusiones jurisprudenciales, a fin de tener como resultado un texto más conciso, coherente y completo a la realidad actual de la democracia brasileña.” (BRASIL, 2019, p.3).

También destaca la necesidad de “una atención especial, por ejemplo, a las cuestiones que requieren una convergencia entre el derecho electoral, la tecnología y el marketing digital”, citando también la “posibilidad de impulsos, utilizada por primera vez en las elecciones generales de 2018” (BRASIL, 2019, p.3). A través de este estudio se puede ver que el TSE ya está analizando el problema de los impulsos y bots utilizados por las redes sociales.

La Ley 9.504/97, que se sometió a una minirreasión en 2017 que autoriza el uso de plataformas digitales en los anuncios electorales, sigue presentando varias incoherencias. Según la ley, el impulso está prohibido a los individuos y limitado a los candidatos o coaliciones. Así, Caldas e Caldas (pág. 213, 2019) afirman:

… expertos en leyes electorales evalúan:

Con el impulso pagado, se abren lagunas para el abuso ilícito del poder económico, el abuso de poder político, el abuso de los medios de comunicación, la propaganda prohibida (realizada por iglesias, sindicatos y personas jurídicas en general), noticias falsas, entre otros posibles actos ilícitos. Algunos de estos ilegales pueden conducir a la impugnación del registro de la solicitud, diploma (si es elegido) y la pérdida del mandato. (ALMEIDA; LOURA JUNIOR, 2018 apud CALDAS e CALDAS)

El texto original tenía en su arte. 57-B, disposición n.o 6 que preveía medidas más efectivas para inhibir las fake news,durante las elecciones. Sin embargo, lo mismo fue vetado por el entonces Presidente de la República Michel Temer. El texto del n.o 6 originalmente previsto (CALDAS y CALDAS, p. 213, 2019):

La denuncia de incitación al odio, difusión de información falsa u ofensa en perjuicio de un partido o candidato, realizada por el usuario de una aplicación o red social en Internet, a través del canal puesto a disposición a tal efecto en el propio prestador, dará lugar a una suspensión máxima de la publicación reportada por un máximo de veinticuatro horas hasta que el prestador se asegure de que la identificación personal del usuario ha sido publicada , sin facilitar ningún dato del denunciante notificado, excepto por orden judicial. (BRASIL, 2017, Grifo nosso apud CALDAS e CALDAS).

La justificación del veto, según Caldas e Caldas es la existencia de “miedo a que una legislación para reprimir las noticias falsas pueda generar una restricción a la libertad de expresión” especialmente en un escenario de “intensa polarización política, en el que las pasiones políticas hacen que la frontera entre la verdad, el punto objetivo y subjetivo, se desvanezca”. (CALDAS e CALDAS, p. 214, 2019)

Concluye Caldas e Caldas que, a pesar del Arte. 25 de la Resolución No 23.551/2017 TSE contiene “dispositivo para tratar de evitar la difusión de fake news… la velocidad de la justicia probablemente no será suficiente para evitar este suceso… precisamente porque su característica es la velocidad de propagación.” (CALDAS e CALDAS, p. 214, 2019).

Se realiza un darse cuenta de que encontrar una solución plausible no será fácil. Cualquier medida más drástica de inhibir las fake news o prevenir ciertas formas de utilizar plataformas digitales posiblemente enfrentará la libertad de expresión. Una paradoja difícil de resolver. Sin embargo, el Tribunal de Justicia ha tomado algunas medidas.

El portal de la ETE y sus páginas en las redes sociales, tienen videos ilustrativos y educativos sobre “los mitos en las elecciones” e incluso consejos para que los votantes no pierdan el título de votante. Sin embargo, no hubo video hasta septiembre de este año, alertando y sensibilizando a los votantes sobre el peligro de las fake news. El TSE comenzó a emitirse a principios de septiembre, en su canal de YouTube[16], la serie de videos Coping with Deinformation”[17] (BRASIL, 2019b). Esta serie, hasta la fecha (21 de octubre de 2019), tiene 6 videos explicando lo eficaz y rápido que fue el TSE en la resolución del tema de noticias falsas sobre el funcionamiento de las máquinas de votación electrónica, y también enseñar al votante a no utilizar el término fake news, para tener un sentido peyorativo y no concreto, según los expertos entrevistados en los videos. Además, según ellos, el término es ambiguo, impreciso y descalifica a la prensa, siendo utilizado por los políticos para este fin. Por lo tanto, se recomienda utilizar el término “desinformación”.

Como puede verse, los vídeos producidos por la EHE elogian al propio tribunal afirmando la rapidez con la que la Corte ha actuado en la lucha contra la desinformación, además de explicar por qué el uso del término fake news es erróneo. Aunque tienen unos segundos de consejos sobre cómo reducir la desinformación, los videos no son puntuales al aclarar al votante sobre la existencia de cuentas automatizadas con potencial influencer en la opinión pública, explicando por ejemplo, el funcionamiento de los bots. En ningún momento los videos producidos por la Corte aclaran al votante sobre la consecuencia que la desinformación puede traer al resultado de una elección. Además de no estar disponible en un lugar de fácil conocimiento del votante. ¿Cuántos votantes verán estos videos? Hasta ahora, ni siquiera hay 500 vistas de ellos.

En otro intento de inhibir la propagación de las fake news, este año 2019, el Poder Legislativo añadió arte. 326-A a la Ley 4.737/65 (Código Electoral) in verbis:

Arte. 326a. Dar causa al inicio de la investigación policial, los procedimientos judiciales, la investigación administrativa, la investigación civil o la mala conducta administrativa, atribuyendo a alguien la comisión de un delito o una infracción de la que conoce inocente, con fines electorales:

Sanción – prisión, de 2 (dos) a 8 (ocho) años, y multa.

1 – La penalización se incrementa desde la sexta parte, si el agente utiliza el anonimato o el supuesto nombre.

2 – La pena se reduce a la mitad, si la imputación es una práctica de delito menor.

3 – Las mismas penas de este artículo serán incurridas por aquellos que, probados para ser conscientes de la inocencia del acusado y con fines electorales, divulguen o propongan, por cualquier medio o forma, el acto o hecho que se le atribuyó falsamente[18]. (BRASIL, 1965)

El Presidente de la República vetó el artículo 3 alegando que “la conducta de la calumnia con fines electorales ya está tipificada en otra disposición del Código [com] Electoral pena de seis meses a dos años”, lo que lesiona el “principio de proporcionalidad”. Sin embargo, el veto fue anulado por el Congreso en agosto de 2019, lo que tipificó otro crimen electoral. (Congresso…, 2019).

También en agosto, el TSE lanzó el Programa de Enfrentamento à Desinformação com Foco nas Eleições 2020. Como se explica en el sitio web del Tribunal:

El programa se organizó en seis ejes temáticos. La primera, “Organización Interna”, tiene como objetivo la integración y coordinación entre los niveles y áreas que conforman la estructura organizativa de la Justicia Electoral y la definición de las respectivas atribuciones contra la desinformación.

Otro eje en el que se trabajará es “Media and Information Literacy”, que tiene como objetivo capacitar a las personas para identificar y verificar una desinformación, además de estimular la comprensión sobre el proceso electoral.

Sobre el tema “Contención a la desinformación”, la idea es instituir medidas concretas para desalentar las acciones de proliferación de información falsa. Con el eje “Identificación y Verificación de la Desinformación”, el TSE tiene la intención de buscar la mejora y los nuevos métodos para identificar posibles prácticas de difusión de contenido falaz.

Los ejes “Mejora del Sistema Jurídico” y “Mejora de los Recursos Tecnológicos” también forman parte del programa puesto en marcha por el TSE.

Antes de la firma del período de adhesión, la Ministra Rosa Weber anunció el lanzamiento de un sitio web que recabar[19] á información sobre la desinformación y también un libro que es el resultado de los debates que tuvieron lugar en el Seminario Internacional de Noticias y Elecciones Falsas, celebrado en mayo de este año, en el TSE. El trabajo está disponible en el Portal de la Cort[20]e. (BRASIL, 2019e)

El 22 de octubre de este año, Google, Facebook, Twitter y WhatsApp se unieron al programa. En ese momento, la ministra Rosa Weber “clasificó como perjudicial el efecto causado por la desinformación a la democracia, el proceso electoral y la sociedad en general”. Y dijo que el enfoque del programa “es provocar la participación de todas las esferas sociales en la lucha contra la difusión de información engañosa en Internet”. (BRASIL, 2019c). También dijo que estas empresas tienen la capacidad de mejorar las tecnologías que identifican “el mal uso de los bots y otras herramientas automatizadas de difusión de contenido”. El Presidente de la ETE concluyó su discurso con el siguiente anhelo:

Espero que podamos llegar al final de las elecciones de 2020 convencidos de que el proceso electoral no ha sufrido mayores influencias por el fenómeno de la desinformación y que esto se debió, y mucho, a la contribución de los socios de nuestro programa. (BRASIL, 2019c).

El programa del Tribunal de Justicia parece estar aportando ya algunos resultados de las propias plataformas que se han unido a él. El 29 de octubre de 2019, la red social Twiter se reunió con el grupo de gestión del programa para “alinear estrategias conjuntas” (BRASIL, 2019d). Al día siguiente, la prensa anunció que la red social decidió prohibir todo tipo de propaganda política (TWITER…, 2019). Sin embargo, parece que la preocupación de la Justicia Electoral está dirigida a combatir la desinformación solamente, sin mencionar nada la capacidad que empresas como el ahora desaparecido Cambridge Analytics tienen para clasificar los perfiles políticos a través de los usuarios de los datos de votantes de las redes sociales.

6. CONCLUSIÓN

Analizar las redes sociales como influencers del debate político es fundamental para entender el escenario en el que se reúnen las democracias (RUEDIGER; GRASSI, 2018) y reflexionar sobre el futuro electoral brasileño.

Así, para que las redes sociales sigan siendo un espacio democrático de opinión e información, es necesario comprender la orgánicaidad de los debates, identificando a los responsables de acciones coordinadas para impulsar los mensajes. Las redes necesitan ser más transparentes, tratando de entender los intereses detrás de la contratación de estos servicios de automatización y difundir la desinformación. Ampliar la capacidad de identificar y reprimir la automatización maliciosa de los perfiles de redes sociales debe ser una prioridad. (GRASSI et al., 2017).

Mientras tanto, el Tribunal Electoral debe promover políticas de sensibilización para los electores que utilicen plataformas digitales, sobre los mecanismos utilizados para la manipulación, desde la formación de cámaras de echo chambers, hasta el uso de inteligencia artificial y bots, que dirigen intencionalmente sus mensajes a destinatarios específicos. Esto permite a las personas filtrar lo que ven, y también ser capaces de limitar el creciente poder de los proveedores para seleccionar a cada usuario individualmente, analizándolos en función de la información social adquirida en sus perfiles en estas plataformas.

Cass Sunstein tiene razón cuando insiste en que, en una sociedad diversa, el sistema de libertad de expresión y el derecho a la privacidad requiere mucho más que restricciones a la censura gubernamental y el respeto de las decisiones individuales. Si bien la censura es una amenaza para la democracia y la libertad, un sistema de libertad de expresión que funcione bien debe cumplir dos requisitos distintos: en primer lugar, las personas deben estar expuestas a materiales que no habrían elegido de antemano, evitando así la formación de cámaras de echo chambers. Y en segundo lugar, las cuestiones deben incluir temas y puntos de vista que los usuarios de plataformas digitales no han buscado, y pueden ni siquiera estar de acuerdo, pero que son importantes para evitar la polarización y el extremismo. El profesor de Harvard explica que no sugiere que el gobierno obligue a la gente a ver las cosas que quieren evitar. Pero dice que las reuniones imprevistas e imprevistas son fundamentales para la democracia, haciendo así su llamamiento a la serenidad (SUNSTEIN, 2017).

Según Caldas e Caldas (2019), las fake news, o desinformación, se propagan rápidamente y dejan consecuencias durante mucho tiempo. Para hacer frente a este fenómeno se requieren medidas eficientes y rápidas para reducir su propagación y efectos, ya que esta difusión puede interferir en el proceso democrático brasileño como se ve en este trabajo. También es necesario crear instrumentos para identificar a los agentes responsables de estos episodios y herramientas para medir el posible daño causado en una elección. Además de las medidas que permiten un mayor control de acceso a los datos de los usuarios, ya que la segmentación por contenido depende de la identificación de los perfiles de un público objetivo.

Es extremadamente urgente e importante que la Justicia Electoral, junto con el Poder Legislativo, cree medios de protección de datos digitales, con el fin de evitar que surjan nuevos Cambridge Analyticsy utilizar su análisis de perfiles para dirigir los mensajes a los objetivos elegidos con el fin de interferir en el proceso democrático de las elecciones.

Hasta que se tomen estas medidas, los votantes deben ser conscientes. Brasil vive la era de la polarización política. Es un hecho dicho. No importa si el individuo está a favor de una política de izquierda o derecha. La tendencia de esto no es apoyar una idea que ha surgido de un partido contrario a su visión, incluso si está de acuerdo con ella. De esta manera, parece fácil manipular un grupo objetivo para que el odio y el caos se propaguen. Y como se ve en este documento, incluso sería posible cambiar el resultado de una elección.

Así, se entiende que la acción de la Justicia Electoral es tímida en vista del recorte que se trae en este debate, es decir, educar a los votantes que utilizan estas plataformas sobre los peligros de la manipulación de datos en las redes sociales, además del enfoque que se ha dado a la conciencia sobre la desinformación.

Las Fake news siempre han existido, contrariamente a la capacidad que tiene algún software para analizar el perfil de cada usuario votante. Esta capacidad es una novedad de esta era digital y tiene un inmenso potencial para dirigirse a un grupo en particular e incluso puede manipular el resultado de un proceso electoral.

La Justicia Electoral debe apreciar la suavidad en las elecciones. Por lo tanto, es necesario concienciar a la población de estos medios de manipulación. Educar a las personas para proteger sus datos y la información de preguntas que reciben, especialmente en las redes sociales. Quién sabe, esta polarización disminuye un día, y con ella, el potencial de manipulación existente en las plataformas sociales.

REFERENCIAS

BECKER, Lauro. Site, blog, landing page, hotsite ou e-commerce? Entenda a diferença! Orgânica Digital, jul. 2016. Disponível em: https://www.organicadigital.com/blog/site-blog-landing-page-hotsite-ou-e-commerce-entenda-a-diferenca/. Acesso em: 20 out. 2019.

BITTAR, Eduardo C. B. Metodologia da pesquisa jurídica. 15. ed. São Paulo: Saraiva, 2017. ISBN: 9788547220037.

BOND, Robert M. et al. A 61-million-person experiment in social influence and political mobilization. Nature, n. 489, p. 295-298, set. 2012. DOI: https://doi.org/10.1038/nature11421. Disponível em: https://www.nature.com/articles/nature11421. Acesso em: 8 jan. 2019.

BRASIL. Presidência da República. Casa Civil. Subchefia para Assuntos Jurídicos. Constituição da República Federativa do Brasil de 1988. Portal da Legislação. Disponível em: http://www.planalto.gov.br/ccivil_03/constituicao/constituicao.htm. Acesso em: 10 mai. 2019.

BRASIL. Presidência Da República. Casa Civil. Subchefia Para Assuntos Jurídicos. Lei Nº 9.504, de 30 de setembro de 1997. Lei da Eleições. Portal da Legislação. Disponível em: http://www.planalto.gov.br/ccivil_03/leis/l9504.htm Acesso em: 10 mai. 2019.

BRASIL. Presidência Da República. Casa Civil. Subchefia Para Assuntos Jurídicos. Lei Nº 4.737, de 15 de julho de 1965. Código Eleitoral. Portal da Legislação. Disponível em: http://www.planalto.gov.br/ccivil_03/leis/l4737.htm Acesso em: 22 out. 2019.

BRASIL. Tribunal Superior Eleitoral. Diálogos para a construção da Sistematização das Normas Eleitorais. 2019. Disponível em: http://www.tse.jus.br/legislacao/sne/arquivos/gt-iii-propaganda-estudos-preliminares. Acesso: em: 12 ago. 2019.

BRASIL. Tribunal Superior Eleitoral. Legislação. 2019a. Disponível em: http://www.tse.jus.br/legislacao/compilada/prt/2019/portaria-no-115-de-13-de-fevereiro-de-2019 Acesso: em: 12 ago. 2019.

BRASIL. Tribunal Superior Eleitoral. Portal da Comunicação TSE. 2019b. Disponível em: http://www.tse.jus.br/imprensa/noticias-tse/2019/Setembro/enfrentamento-a-desinformacao-tse-veicula-serie-de-cinco-videos-sobre-o-tema?fbclid=IwAR2JRU6Yu0u-gRV1-wACl3K4Eic8l-jtllgIjG64kpTVwW1so6Xi8NSx2yY. Acesso em: 21 out. 2019.

BRASIL. Tribunal Superior Eleitoral. Portal da Comunicação TSE. 2019c. Disponível em: http://www.tse.jus.br/imprensa/noticias-tse/2019/Outubro/google-facebook-twitter-e-whatsapp-aderem-ao-programa-de-enfrentamento-a-desinformacao-do-tse. Acesso em: 30 out. 2019.BRASIL. Tribunal Superior Eleitoral. Portal da Comunicação TSE. 2019d. Disponível em: http://www.tse.jus.br/imprensa/noticias-tse/2019/Outubro/grupo-gestor-do-programa-de-enfrentamento-a-desinformacao-recebe-representante-do-twitter-para-alinhar-estrategias-conjuntas. Acesso em: 30 out. 2019.

BRASIL. Tribunal Superior Eleitoral. Portal da Comunicação TSE. 2019e. Disponível em: http://www.tse.jus.br/imprensa/noticias-tse/2019/Agosto/tse-lanca-programa-de-enfrentamento-a-desinformacao-com-foco-nas-eleicoes-2020. Acesso em: 30 out. 2019.

BRASIL. Tribunal Superior Eleitoral. Seminário Internacional sobre Fake News e Eleições. 2019f. Disponível em: http://www.tse.jus.br/hotsites/seminario-internacional-fake-news-eleicoes/. Acesso: em: 12 ago. 2019.

CADWALLADR, Carole. Revealed: 50 million Facebook profiles harvested for Cambridge Analytica in major data breach. The Guardian, 17 mar. 2018. Disponível em: https://www.theguardian.com/news/2018/mar/17/cambridge-analytica-facebook-influence-us-election Acesso em: 26 abr. 2019.

CADWALLADR, Carole. Facebook’s role in Brexit — and the threat to democracy. TED Ideas worth spreading, Abr, 2019. Disponível em: https://www.ted.com/talks/carole_cadwalladr_facebook_s_role_in_brexit_and_the_threat_to_democracy/transcript?language=en. Acesso em: 4 ago. 2019.

CALDAS, Camilo O. L.; CALDAS, Pedro N. L. Estado, democracia e tecnologia: conflitos políticos e vulnerabilidade no contexto do big-data, das fake news e das shitstorms. Perspectivas em Ciência da Informação, Belo Horizonte, v.24, n. 2, abr./jun. 2019. Disponível em: http://www.scielo.br/scielo.php?script=sci_arttext&pid=S1413-99362019000200196&tlng=pt. Acesso em: 20 out. 2019.

Congresso derruba veto e mantém pena para “fake news” eleitoral. Exame, ago. 2019. Disponível em: https://exame.abril.com.br/brasil/congresso-mantem-veto-a-prestacao-de-assistencia-odontologica-obrigatoria/. Acesso em: 22 out. 2019.

FERRARA, Emilio, et al. The Rise of Social Bots. Communications of the ACM, New York, v. 59 n. 7, jul. 2016. Disponível em: https://cacm.acm.org/magazines/2016/7/204021-the-rise-of-social-bots/fulltext#R24. Acesso em: 20 out. 2019.

GRASSI, Amaro. Et al. Robôs, redes sociais e política no Brasil: estudo sobre interferências ilegítimas no debate público na web, riscos à democracia e processo eleitoral de 2018. FGV DAPP, Rio de Janeiro, 20 ago 2017. Disponível em: http://hdl.handle.net/10438/18695. Acesso em: 12 jan. 2019.

HALE, Scott et al. How digital design shapes political participation: A natural experiment with social information. PLoS One, 27 abr. 2018. DOI: 10.1371/journal.pone.0196068. Disponível em: https://journals.plos.org/plosone/article?id=10.1371/journal.pone.0196068. Acesso em: 8 jan. 2019.

HOUSE OF COMMONS (Reino Unido). Disinformation and ‘fake news’: Final Report. Londres: House of Commons, 2019, 111 p. Disponível em: https://publications.parliament.uk/pa/cm201719/cmselect/cmcumeds/1791/1791.pdf. Acesso em: 19 fev. 2019.

MONTEIRO, Cláudia S.; MEZZAROBA, Orides. Manual de metodologia da pesquisa no Direito. 7. ed. São Paulo: Saraiva, 2017. ISBN: 9788547218720.

MUNGER, Kevin. Influence? In this economy? Tech-savvy young people take internet literacy for granted, and that can cause all kinds of problems. The Outline, 17 fev. 2018. Disponível em: https://theoutline.com/post/3443/devumi-twitter-bots-savviness-gap. Acesso em: 14 jan. 2019.

NETTO, Paulo R. WhatsApp confirma ação de empresas em disparo de mensagens durante eleições. O Estado de São Paulo, 8 out. 2019. Disponível em: https://politica.estadao.com.br/blogs/estadao-verifica/whatsapp-confirma-acao-de-empresas-em-disparo-de-mensagens-durante-eleicoes/. Acesso em: 2 nov. 2019.

PRIVACIDADE Hackeada. Direção: Karim Amer, Jehane Noujaim. Produção: Karim Amer, Pedro Kos, Geralyn Dreyfous, Judy Korin. Intérpretes: Brittany Kaiser, Carole Cadwalladr, David Carrol e outros. Roteiro: Karim Amer, Pedro Kos, Erin Barnett. Estados Unidos: Netflix, 2019 (113 min). Produzido por Netflix. Disponível em: https://www.netflix.com Acesso em: 4 ago. 2019.

PUPO, Amanda; PIRES, Breno. TSE abre ação sobre compra de mensagens anti-PT no WhatsApp. O Estado de São Paulo, 19 out. 2019. Disponível em: https://politica.estadao.com.br/noticias/eleicoes,tse-abre-acao-sobre-compra-de-mensagens-anti-pt-no-whatsapp,70002555142. Acesso em: 2 nov. 2019.

RAMAYANA, Marcos. Direito Eleitoral. 16. Edição. Niterói: Impetus, 2018. ISBN: 9788576269601.

ROSENBERG, Matthew; CONFESSORE, Nicholas; CADWALLADR, Carole. How Trump consultants exploited the Facebook data of millions. The New York Times, 17 mar. 2018. Disponível em: https://www.nytimes.com/2018/03/17/us/politics/cambridge-analytica-trump-campaign.html. Acesso em: 20 dez. 2018.

RUEDIGER, Marco A. O estado da desinformação: Eleições 2018. FGV DAPP, Rio de Janeiro, 18 set 2018. Disponível em http://hdl.handle.net/10438/25743. Acesso em: 3 jan. 2019.

RUEDIGER, Marco A.; GRASSI, Amaro. Redes sociais nas eleições 2018. FGV DAPP, Rio de Janeiro, 5 out 2018. Disponível em http://hdl.handle.net/10438/25737. Acesso em: 3 jan. 2019.

RUEDIGER, Marco A.; GRASSI, Amaro. Desinformação na era digital: amplificações e panorama das Eleições 2018. FGV DAPP, Rio de Janeiro, 30 nov 2018a. Disponível em http://hdl.handle.net/10438/25742. Acesso em: 3 jan. 2019.

RUEDIGER, Marco A.; GRASSI, Amaro. Bots e o Direito Eleitoral Brasileiro nas Eleições de 2018. FGV DAPP, Rio de Janeiro, 15 jan 2019. Disponível em http://hdl.handle.net/10438/26227. Acesso em 17 fev. 2019.

SHALDERS, André. Eleições 2018 estreia na TV com força em cheque. BBC News Brasil, 18 ago. 2018. Disponível em: https://www.bbc.com/portuguese/brasil-45364384 Acesso em: 18 ago. 2019.

SILVA, Carla A. et al. Uso de redes sociais e softwares para disseminação e combate de fake news nas eleições. In: CONGRESSO NACIONAL UNIVERSIDADE, EAD E SOFTWARE LIVRE, 2018, Belo Horizonte. Anais […]. Belo Horizonte: UFMG, 2018. Disponível em: http://www.periodicos.letras.ufmg.br/index.php/ueadsl/article/view/14413. Acesso em: 4 jan. 2019.

STELLA, Massimo; FERRARA, Emilio; DOMENICO, Manlio. Bots increase exposure to negative and inflammatory content in online social systems. Proceedings of the National Academy of Sciences of the United States of America, v. 115, p. 12435–12440, dez. 2018. DOI: 10.1073/pnas.1803470115. Disponível em: https://www.pnas.org/content/115/49/12435. Acesso em: 8 jan. 2019.

SUNSTEIN, Robert C. #Republic: Divided democracy in the age of social media. Princeton University Press, 2017. ISBN: 9780691175515.

TÖRNBERG, Petter. Echo chambers and viral misinformation: Modeling fake news as complex contagion. PLoS One, 20 set. 2018. DOI: 10.1371/journal.pone.0203958. Disponível em: https://journals.plos.org/plosone/article?id=10.1371/journal.pone.0203958. Acesso em: 13 jan. 2019.

TWITTER vai banir todo tipo de propaganda política, o que pressiona Facebook. O Globo, 30 out. 2019. Disponível em: https://oglobo.globo.com/mundo/twitter-vai-banir-todo-tipo-de-propaganda-politica-que-pressiona-facebook-24051553. Acesso em: 31 out. 2019.

VELLOSO, Carlos M. D. S.; AGRA, Walber D. M. Elementos de direito eleitoral. 5. ed. São Paulo: Saraiva, 2016. ISBN: 9788547208073.

APÉNDICE – REFERENCIAS A LA NOTA AL PIE