ARTICOLO ORIGINALE

BONATO, Isabelle Emy [1], GRANADO, Karina [2]

BONATO, Isabelle Emy. GRANADO, Karina. La responsabilità della giustizia elettorale di fronte agli annunci elettorali sulle piattaforme digitali. Revista Científica Multidisciplinar Núcleo do Conhecimento. Anno 05, Ed. 03, Vol. 02, pp. 85-120. marzo 2020. ISSN: 2448-0959, collegamento di accesso: https://www.nucleodoconhecimento.com.br/legge/pubblicita-elettorale

RIEPILOGO

Lo studio mette in discussione l’affidabilità delle piattaforme di social media digitali nella pubblicità elettorale e la responsabilità della giustizia elettorale in questo contesto. Analizza la necessità della giustizia elettorale di regolamentare l’uso di queste piattaforme e chiede se l’uso dei social network come piattaforma di propaganda elettorale danneggi la democrazia. È noto nei media di tutto il mondo che ci sono mezzi digitali per ottenere informazioni personali e indirizzare le informazioni, vere o meno, a un pubblico specifico. Pertanto, l’uso dei social media come piattaforma pubblicitaria elettorale potrebbe non essere sicuro e può essere facilmente manipolato e, pertanto, il presente studio analizza se la Corte Elettorale Superiore dovrebbe regolare l’uso di esso osservando il Principio di morbidezza delle elezioni che garantisce la libera formazione della volontà edelle e l’uguaglianza tra i candidati, garantendo la democrazia brasiliana.

Parole chiave: Democrazia, social media, elezioni.

1. INTRODUZIONE

Recentemente si è parlato molto dell’importanza della democrazia. Alcuni parlano di “colpi di stato” e scendono in piazza chiedendo la difesa della democrazia, altri credono che non c’è nulla da temere, poiché con le elezioni presidenziali del 2018, il processo democratico è rimasto intatto. Tuttavia, è stata sollevata una nuova questione: l’affidabilità dell’uso delle piattaforme digitali negli annunci elettorali che è stato autorizzato dal TSE – Tribunale elettorale superiore per queste elezioni. Quando si tratta di una questione così importante come la democrazia, è importante conoscere il funzionamento dei social network e i metodi esistenti di manipolazione dei dati e di indirizzare l’informazione per riflettere sulla libertà di voto e la difesa e la protezione della democrazia.

Nel marzo 2018, il New York Times ha pubblicato alcuni degli scandali di Facebook. Insieme a The Observer of London, il giornale ha esaminato una società di consulenza politica chiamata Cambrigde Analytica e ha rivelato una potenziale nuova arma utilizzata dalla società di consulenza. Secondo il giornale americano, quest’arma è un software in grado di mappare i tratti della personalità in base a ciò che le persone amano su Facebook. Cambridge ha avuto accesso ai dati personali di milioni di utenti di questa rete, essendo in grado di prevedere, tra le altre caratteristiche personali, la capacità ricettiva di ciascuno, la visione politica, Il QI, la soddisfazione personale, se la persona è sospetta o meno, se è aperta o meno ecc. Questa società è stata responsabile della campagna elettorale di Donald Trump nel 2016 e ha sollevato la questione della sicurezza dei dati personali sui social network (ROSENBERG; CONFESSORE; CADWALLADR, 2018). In un altro rapporto, parliamo dell’esistenza di bot[3] nel mondo informatico, in grado di indirizzare informazioni specifiche a gruppi specifici, influenzando un’elezione (PATTERSON, 2018). Con queste informazioni, cresce la preoccupazione per la scorrevolezza nelle elezioni in tutto il mondo. In Brasile, per esempio, c’è stato lo scandalo dell’uso di un dispositivo chiamato “servizio di potenziamento dei contenuti” che sarebbe stato utilizzato dall’allora candidato presidenziale Jair Bolsonaro nella diffusione di Fake News (PERON; MARTINS, 2018), un altro argomento che sarà esplorato in questo lavoro.

Un principio inerente allo Stato democratico del diritto è il Principio di Lisura Elettorale, definito da Ramayana (2015, p.31) come: “La garanzia della scorrevolezza delle elezioni nutre uno speciale senso di protezione dei diritti fondamentali della cittadinanza (cittadino-elettore), così come trova un fondamento giuridico-costituzionale nelle arti. 1, voce II e 14 x9 della Legge Fondamentale.” Questo principio costituzionale mira a garantire la partecipazione dei cittadini alla scelta dei loro rappresentanti liberamente e sinceramente. La Giustizia Elettorale ha il responsabile di consentire l’espressione della volontà degli elettori, rendendo operative tutte le procedure elettorali in modo che si sviluppino in armonia e trasparenza, senza essere ostacolati dalla sovranità del popolo (VELLOSO; AGRA, 2016). Pertanto, è estremamente importante esplorare i mezzi di manipolazione dei dati esistenti nelle attuali piattaforme digitali in modo che possa riflettere sulla responsabilità della giustizia elettorale nell’uso dei social network per la propaganda politica. A tal fine, saranno studiati articoli recenti che discuteranno varie forme di manipolazione dei dati e dei loro risultati nelle elezioni e su come altri paesi stanno discutendo questo argomento al fine di riflettere sull’affidabilità delle piattaforme digitali per l’uso nella pubblicità politica.

Il lavoro inizierà dall’esposizione di articoli e materiali scientifici come libri e relazioni, che mostrano la manipolazione dei dati personali nel mondo virtuale, al fine di mostrare l’esistenza di meccanismi in grado di indirizzare informazioni specifiche a un pubblico di destinazione con la possibilità di influenzare il risultato nelle elezioni, ferendo così la garanzia costituzionale fondamentale del diritto alla libera scelta del voto. Sulla base di premesse di base come la Democrazia, i principi costituzionali della legge elettorale e le funzioni della giustizia elettorale brasiliana, la nuova formulazione data all’arte. 57-C di legge n. 9.504/1997 (Formulazione data dalla legge n. 13.488, 2017) che ha permesso l’uso di piattaforme digitali nella pubblicità elettorale nelle ultime elezioni, consentendo la riflessione sulla responsabilità della giustizia elettorale nell’uso delle piattaforme digitali e le conseguenze per le campagne elettorali e la democrazia brasiliana.

2. PIATTAFORME DIGITALI E I LORO DANGERS

Le piattaforme digitali sono emerse con la promessa di riunire le persone e promuovere più “modi egualitari per incontrarsi e discutere[qualquer assunto]”. I media online hanno cambiato profondamente il modo in cui le persone comunicano, discutono e formano opinioni. Le piattaforme digitali sono organizzate attraverso complessi processi a cascata. Così, la notizia si diffonde come “fuoco selvaggio sui social network” attraverso connessioni dirette tra lettori e produttori di notizie, rendendo sempre più difficile distinguere tra di loro. Tuttavia, questo fenomeno ha cambiato il modo in cui la società compone le sue narrazioni sul mondo comune (TÖRNBERG, 2018, p.1).

Peter Törnberg, del dipartimento di sociologia dell’Università di Amsterdam, spiega:

Nonostante l’iniziale ottimismo su questo luogo di incontro apparentemente decentralizzato e democratico, il mondo online sembra sempre meno un tavolo comune che ci unisce per discutere e identificare liberamente i problemi della società in un nuovo tipo di sfera pubblica. Invece, sembra portare il peggio degli istinti umani: ci uniamo in tribù che ci confortano con riaffermazione, e ci proteggono dai disaccordi; sono camere echo chambers[4] la prospettiva esistente e favoriscono i pregiudizi di conferma. La tecnologia che è stata fatta per contribuire a tessere ulteriormente i legami tra gli esseri umani sembra aver portato a una rimessa e nello strappo del nostro tessuto sociale mentre siamo divisi in gruppi sociali con visioni del mondo separate. (TÖRNBERG, 2018, p.1).

Internet è emerso come una fonte di conoscenza facilmente accessibile, ma nel corso del tempo, la qualità e la credibilità delle informazioni sta riducendo drasticamente. Sempre più spesso, c’è “un clima di informazione caratterizzato da narrazioni pregiudiziali, notizie false, teorie cospirative, sfiducia e paranoia” (TÖRNBERG, 2018, p.2). Il mondo digitale è diventato un terreno fertile per la crescita della disinformazione. Gli studi dimostrano che le notizie false si diffondono più velocemente e più lontano di notizie vere sui social network. Secondo la città, questo fenomeno può influenzare aspetti rilevanti della vita di un cittadino in tutti i settori. Così, questa disinformazione può anche compromettere l’esito di un’elezione, essendo un rischio non solo per la società umana, come afferma l’autore, ma una minaccia per la democrazia di un paese.

Apparentemente, c’è un legame tra camere di echo chambers e la diffusione della disinformazione come questi gruppi omogenei di utenti, con una preferenza per l’auto-conferma, sembrano fornire serre per il cambiamento di voci e disinformazione per diffondere. Con uno spazio digitale polarizzato, gli utenti tendono a promuovere le loro narrazioni preferite, formando gruppi polarizzati e resistendo a informazioni che non sono conformi alle loro convinzioni (TÖRNBERG, 2018, p.2). Così formando eserciti di sostenitori di determinati prodotti o marchi e anche eserciti di presidenti (o candidati a) che sono rapidamente mobilitati. Questo può significare che le camere echo chambers rendono le notizie false più virali, dal momento che le informazioni che risuonano con gruppi di utenti di parte hanno maggiori probabilità di diffondersi in una rete (TÖRNBERG, 2018, p.3).

Lo studio di Törnberg suggerisce nella sua conclusione che il semplice raggruppamento di utenti con la stessa visione del mondo è sufficiente a influenzare la viralità dell’informazione. Questo suggerisce che non sono solo gli algoritmi a filtrare le notizie, che le interessano, ma il fatto che i social media permettano questa dinamica dei raggruppamenti, cambia anche la dinamica della viralità. Questo è parte della grande questione di come i social media hanno influenzato i processi politici e sociali (T-RNBERG, 2018, p.16-17).

2.1 INTELLIGENZA ARTIFICIALE SULLE PIATTAFORME DIGITALI

Ci sono molti modi di utilizzare l’intelligenza artificiale, tra cui due sono più appropriati per questo lavoro, che cerca di analizzare l’affidabilità delle piattaforme: software che identifica il profilo dell’utente e bot che interagiscono nel mondo virtuale.

2.1.1 IDENTIFICAMENTO DEL PROFILO UTENTE

Nell’era dell’algoritmo, Facebook stesso e Google fanno selezioni da parte di persone, sia legate alla scelta di prodotti, viaggi o candidati presidenziali. Gli algoritmi sanno molto sui loro utenti, e con l’emergere dell’intelligenza artificiale, tendono a migliorare immensamente. Imparano e imparano molto su ciascuno di essi e saranno, se non lo sono più, in grado di sapere cosa vuole ogni persona o cosa vorrà, meglio di loro. Conosceranno anche le loro emozioni e potranno imitare le emozioni umane da soli (SUNSTEIN, 2017, p. 13). Attualmente, un algoritmo che impara un po ‘su una persona può scoprire e dire ciò che le persone come loro tendono a come. Robert Sunstein, professore alla Harvard University’s Law School, spiega:

In realtà, questo sta accadendo ogni giorno. Se l’algoritmo sa che ti piacciono alcuni tipi di musica, può sapere, con alta probabilità, quali tipi di film e libri ti piacciono e quali candidati politici ti piaceranno. E se sai quali siti web visiti, puoi sapere quali prodotti è probabile acquistare e cosa pensi del cambiamento climatico e dell’immigrazione. Un piccolo esempio: Facebook probabilmente conosce le tue convinzioni politiche e può informare gli altri, inclusi i candidati per la carica pubblica. Egli classifica i suoi utenti come molto conservatore, conservatore, moderato, liberale e molto liberale (SUNSTEIN, 2017, p. 13).

Sunstein spiega che Facebook categorizza i suoi utenti politicamente vedendo le pagine che gli piacciono e afferma che è facile creare un profilo politico quando l’utente ama certe opinioni, ma non di altri. Se l’utente menziona alcuni candidati favorevolmente o sfavorevolmente, la categorizzazione è ancora più facile. E la cosa più spaventosa è che Facebook non nasconde quello che sta facendo. “Nella pagina Preferenze annunci su Facebook, puoi cercare ‘Interessi’, quindi ‘Altro’, ‘Stile di vita e cultura’, e infine ‘Politica degli Stati Uniti[5], e apparirà la categorizzazione” (SUNSTEIN, 2017, p. 13). L’apprendimento automatico può essere utilizzato per produrre distinzioni raffinate, dice il professore, come l’opinione degli utenti su questioni con la sicurezza pubblica, l’ambiente, l’immigrazione e l’uguaglianza. Eaggiunge: “Per usare un eufemismo, queste informazioni possono essere utili ad altri – gestori di campagne, inserzionisti, raccolte fondi e bugiardi, compresi gli estremisti politici” (SUNSTEIN, 2017, p. 13).

Inoltre, gli hashtag possono essere considerati: #elenão, #partiu, #tbt, #lulalivre, #foratemer, #elesim #EuApoioaLavaJato. Puoi trovare un gran numero di elementi che interessano l’utente o che si adattano (e addirittura rafforzano) le loro convinzioni. “L’idea dell’hashtag è quella di permettere alle persone di trovare tweet e informazioni che li interessano. Si tratta di un meccanismo di classificazione semplice e veloce” (SUNSTEIN, 2017, p. 14). C’è una grande performance dei cosiddetti ‘imprenditori dell ‘hashtag‘; che creano o diffondono hashtag come un modo per promuovere idee, prospettive, prodotti, persone o fatti presunti. Questo aumenta la convenienza, l’apprendimento e l’intrattenimento. Dopo tutto, quasi nessuno vuole vedere annunci per i prodotti che non li interessano. Tuttavia, l’architettura di questo controllo presenta un grave svantaggio, sollevando questioni fondamentali sulla libertà e la democrazia (SUNSTEIN, 2017, p. 14). Di questo, il professore si chiede quali sarebbero i presupposti sociali per la libertà individuale e per un sistema democratico per funzionare bene:

La semplice possibilità potrebbe essere importante, anche se gli utenti non lo vogliono? Un universo di comunicazione perfettamente controllato – un feed personalizzato – potrebbe essere una sorta di distopia stessa? In che modo i social media, l’esplosione delle opzioni di comunicazione, l’apprendimento automatico e l’intelligenza artificiale possono cambiare la capacità dei cittadini di governarsi da soli? (SUNSTEIN, 2017, 14().

Sunstein conclude che questi problemi sono strettamente correlati e sostiene un’architettura digitale di serendipity. Chance impedirebbe all’intelligenza artificiale di utilizzare i dati personali degli utenti per migliorare la loro esperienza online. Non ottenendo queste informazioni orientate al marketing, non ci saranno dati personali da utilizzare per manipolare gli interessi politici. Questa misura sarebbe “a beneficio delle vite individuali, dei comportamenti di gruppo e della democrazia stessa” (SUNSTEIN, 2017, p. 16). Nella misura in cui i provider sono in grado di creare qualcosa come esperienze personalizzate o comunità chiuse per ogni utente, o argomenti preferiti e gruppi preferiti, è importante che venga esercitata cautela. “L’isolamento e la personalizzazione sono soluzioni ad alcuni problemi reali, ma diffondono anche falsità e promuovono la polarizzazione e la frammentazione” (SUNSTEIN, 2017, p. 17). Si tratta di un chiarimento importante quando si analizza la natura della libertà, sia personale che politica, e il tipo di comunicazione digitale che meglio soddisfa un ordine democratico.

2.1.2 INTERAZIONE CON L’UTENTE

In un altro studio, condotto presso il Centro para Informação e Tecnologia da Comunicação da fundação Bruno Kessler in Italia, è stato analizzato, “a livello microscopico, come le interazioni sociali possono portare a fenomeni globali emergenti come la segregazione sociale, la diffusione dell’informazione e del comportamento” (STELLA; FERRARA; DOMENICO, 2018, p.1). Gli autori sostengono che i sistemi digitali non sono popolati solo da esseri umani, ma anche da bot, che sono agenti software controllati per scopi specifici che vanno dall’invio di messaggi automatizzati per anche assumere specifici comportamenti sociali o antisociali. Così, i bot possono influenzare la struttura e la funzione di un sistema sociale (STELLA; FERRARA, NUOVO 2010. DOMENICO, 2018, p.1).

Ma come possono i bot interagire con gli utenti? Grassi Amaro, phD professor presso FGV spiega:

I robot vengono utilizzati sui social network per propagare false informazioni dannose o generare un dibattito artificiale. Per fare questo, hanno bisogno di avere il maggior numero possibile di seguaci (GRASSI et al., 2017, p.12[…]). In questo modo, i robot aggiungono un gran numero di persone allo stesso tempo e seguono pagine reali di personaggi famosi, oltre a seguire ed essere seguiti da un gran numero di robot, in modo che finiscano per creare comunità miste – che includono profili reali e falsi (FERRARA et al., 2016 apud GRASSI et al., 2017, p.12).

Alcuni bot hanno meccanismi per imitare il comportamento umano, per essere riconosciuti come tali, sia dagli utenti che da altri bot. Altri mirano solo a distogliere l’attenzione su un determinato tema (GRASSI et al., 2017, p.12). Con l’apprendimento automatico, il sistema è in grado di identificare gli esseri umani e i robot attraverso il comportamento del profilo, ad esempio tenendo conto “del fatto che gli utenti reali trascorrono più tempo sulla rete scambiando messaggi e visitando il contenuto di altri utenti, come foto e video, mentre gli account robot trascorrono il tempo alla ricerca di profili e all’invio di richieste di amicizia” (GRASSI et al. , 2017, p.14).

Conoscendo il profilo di ogni utente e sapendo come interagire con loro, i bot possono essere utilizzati per influenzare pensieri, azioni e persino avviare movimenti sociali e politici. È quindi importante comprendere il ruolo dell’intelligenza artificiale negli affari politici e, di conseguenza, nel processo elettorale democratico.

2.2 FAKE NEWS

Fake News è già diventato un termine noto in Brasile, tuttavia, è importante evidenziare la sua definizione e spiegazione. Secondo Ruediger e Grassi:

Fake News, o fake news in portoghese, è diventata un’espressione comunemente adottata per identificare la divulgazione di informazioni false, soprattutto su internet. Tuttavia, le evoluzioni di questo fenomeno nella società in rete hanno dimostrato che il termine non è in grado di spiegare la complessità delle sue pratiche, diventando, più volte, strumento di un discorso politico che beneficia di tale semplificazione. (RUEDIGER; GRASSI, 2018a, p.8)

In Brasile, lo studio di FGV DAPP mostra che i bot “cercano di creare discussioni contraffatte e interferiscono nei dibattiti” creando disinformazione che può interferire nei processi elettorali e democratici. Lo studio mostra che l’emergere di conti automatizzati ha permesso strategie di manipolazione attraverso voci e diffamazione. Oltre ai robot, sono stati identificati anche cyborg (conti parzialmente automatizzati) (RUEDIGER; GRASSI, 2018, p.12).

Studi sull’influenza delle Fake News nelle elezioni statunitensi hanno indicato che una persona su quattro è stata esposta a false voci. Tuttavia, queste notizie rappresentavano solo il 2,6% dell’universo delle notizie e il 60% delle visite a questi rapporti sono state trasmesse all’elettorato con un pregiudizio più conservatore, che costituiva il 10% dell’elettorato. Anche se le fake news non hanno un numero significativo all’interno del corpus delle notizie elettorali, sono state in grado di influenzare il sistema politico e accentuare la polarizzazione politica. L’uso di fake news fabbricate è un fenomeno antico, ma i social network e i progressi tecnologici hanno portato la disinformazione ad un livello mai visto prima (DELMAO; VALENTE, 2018 apud RUEDIGER; GRASSI, 2018, p.13).

Fake news ha un potere devastante, e ha già attirato l’attenzione della Giustizia Elettorale, che preferisce usare il termine “disinformazione”. Tuttavia, le notizie false, soprattutto nei periodi elettorali, si sono sempre verificate. Il pericolo maggiore sta nel software e nei programmi che identificano gli obiettivi ideali per ricevere questa disinformazione. Così come i bot, che aiutano nella formazione di camere echo chambers consentono una maggiore diffusione di fake news.

3. L’INTELLIGENZA ARTIFICIALE E IL SUO RUOLO INFLUENTE NELLE ELEZIONI

Secondo un esperimento condotto all’Università di Oxford, in collaborazione con l’Alan Turing Institute e il Dipartimento di Economia Politica della Kings University di Londra nel 2017, il comportamento politico avviene sempre più sulle piattaforme digitali, dove alle persone vengono presentate una varietà di informazioni sociali. (HALE et al, 2017, p.1).

Questo esperimento ha cercato di capire come l'”informazione sociale” fornisca la partecipazione politica degli elettori. Egli spiega che l’informazione sociale è ciò che le persone stanno facendo, o hanno fatto, sia nel mondo digitale che nel mondo reale e ha una lunga storia in Psicologia Sociale. Tuttavia, è difficile osservare ciò che un gran numero di persone stanno facendo offline. D’altra parte, nel mondo digitale, “molte piattaforme online indicano chiaramente quante persone hanno apprezzato, seguito, ritwittato, firmato petizioni, o altrimenti preso varie azioni.” (HALE et al, 2017, p.2)

Lo studio conclude che la struttura delle piattaforme digitali può avere effetti significativi sui comportamenti politici degli utenti. Allo stesso modo, lo studio suggerisce che le informazioni sociali possono “esacerbare le turbolenze nella mobilitazione politica” (HALE et al, 2017, p.16).

Nel 2012, un altro studio è stato pubblicato dal Dipartimento di Scienze Politiche presso l’Università della California (USA). L’esperimento è stato condotto in modo controllato attraverso messaggi di mobilitazione politica consegnati a 61 milioni di utenti di Facebook durante le elezioni del Congresso degli Stati Uniti del 2010. (BOND, 2012, p.1):

“I risultati mostrano che i messaggi hanno influenzato direttamente l’espressione di sé politica, la ricerca di informazioni e il comportamento di voto reale di milioni di persone. Inoltre, i messaggi hanno influenzato non solo gli utenti che li hanno ricevuti, ma anche gli amici degli utenti e gli amici degli amici. L’effetto della trasmissione sociale sul voto nel mondo reale è stato maggiore dell’effetto diretto dei messaggi stessi, e quasi l’intera trasmissione si è verificata tra gli “amici intimi” che avevano maggiori probabilità di avere un rapporto faccia a faccia. Questi risultati suggeriscono che forti legami sono fondamentali per diffondere il comportamento online e reale sui social network umani.” (BOND, 2012, p.1).

I risultati di questo studio hanno molte implicazioni. La mobilitazione politica nella rete opera provocando l’espressione di sé politica e inducendo anche la raccolta di informazioni sociali. È stato anche dimostrato che la mobilitazione sociale nelle reti online è significativamente più efficace della mobilitazione informativa. Il fatto che le informazioni viste online da volti familiari può migliorare notevolmente l’efficacia di un messaggio di mobilitazione. Oltre agli effetti diretti della mobilitazione online, è stata dimostrata l’importanza dell’influenza sociale per influenzare il cambiamento nel comportamento degli utenti (BOND, 2012, p.5).

Così, quando si cerca di influenzare il comportamento di un utente al di fuori del mondo digitale, si deve prestare attenzione “non solo per l’effetto che un messaggio avrà su coloro che lo ricevono, ma anche alla probabilità che il messaggio e il comportamento che stimola si diffonderà da persona a persona attraverso il social network”. (BOND, 2012, p.5). Questo esperimento suggerisce che la messaggistica online può influenzare una varietà di comportamenti offline e i suoi autori erano già interessati nel 2012 a comprendere il ruolo dei social media nella società. Ricordando che:

Le società sono sistemi complessi che tendono a polarizzarsi in sottogruppi di individui con prospettive drammaticamente opposte. Questo fenomeno si riflette – e spesso amplificato – nei social network online, dove, tuttavia, gli esseri umani non sono più gli unici partecipanti e coesistono con i bot sociali – cioè account controllati dal software (STELLA; FERRARA; DOMENICO, 2018, p.1,)

I dati hanno consolidato le informazioni ottenute da quasi 4 milioni di messaggi Twitter generati da quasi 1 milione di utenti. In questa analisi, sono stati identificati i due gruppi polarizzati di Indipendenti e Costituzionalisti e sono stati quantificati i ruoli strutturali ed emotivi dei bot sociali. È stato dimostrato che i bot agiscono in aree del sistema sociale per attaccare esseri umani influenti di entrambi i gruppi. In questo referendum, gli indipendenti sono stati bombardati da contenuti violenti, aumentando la loro esposizione a narrazioni negative e infiammatorie, esacerbando i conflitti sociali online. (SUNSTEIN, 2017, p. 7; STELLA; FERRARA; DOMENICO, 2018, p.1). Questi risultati sottolineano l’importanza di sviluppare misure per smascherare queste forme di manipolazione sociale automatizzata, poiché i social media possono influenzare profondamente il comportamento di voto di milioni di persone:

Interferendo nello sviluppo di dibattiti sui social network, i robot influenzano direttamente i processi politici e democratici attraverso l’influenza dell’opinione pubblica. La sua azione può, ad esempio, produrre un’opinione artificiale, o una dimensione irreale di una determinata opinione o figura pubblica, condividendo versioni di un dato tema, che si diffondono nella rete come se ci fosse, tra la parte della società rappresentata lì, un’opinione molto forte su un dato argomento (Davis et al., 2016 apud GRASSI et al., 2017, p.14).

È possibile che il lettore pensi che la loro opinione su un particolare candidato non cambierà a causa dell’influenza dei messaggi prodotti dai bot. Tuttavia, l’obiettivo di questo hacking sociale sono gli elettori indecisi. Come spiega Grassi et al., la condivisione coordinata di una certa opinione, gli conferisce “un volume irre[…]ale che influenza gli utenti indecisi sull’argomento e rafforza gli utenti più radicali nel dibattito organico, data la più frequente posizione dei robot ai poli del dibattito politico”. (2017, p.14)

3.1 CONSEGUENZE PER LE CAMPAIGNI DI ELECTION

Fake News, bot e camere eco possono cambiare il corso di un’elezione, come è stato ampiamente discusso e mostrato nel capitolo precedente. Cambridge Analytics stessa ha utilizzato la seguente riga in una presentazione di vendita dei suoi servizi: “Siamo un’agenzia di cambiamento di comportamento. Il Santo Graal delle comunicazioni è quando si inizia a cambiare il comportamento [das pessoas]”. (PRIVACIDADE…, 2019)

Echo Chambers può portare le persone a credere nelle falsità, e può essere difficile o impossibile correggerle. Un’illustrazione, fatta dal professor Sunstein, è la convinzione che il presidente Barack Obama non sia nato negli Stati Uniti. Come falsità, questo non è il più dannoso, ma riflessa e contribuito a una politica di sospetto, sfiducia e talvolta odio.

Un altro esempio, più dannoso, è l’insieme delle falsità che hanno contribuito a produrre il voto per la “Brexit“[6] nel 2016. Le notizie false sul fatto che la Turchia presumibilmente faccia parte dell’Unione europea e di conseguenza l’apertura del Regno Unito all’immigrazione di massa dei turchi nel paese sono state essenziali per l’esito del referendum. Nella campagna presidenziale del 2016 negli Stati Uniti, le falsità si diffondono rapidamente su Facebook e sono ancora ovunque. (SUNSTEIN, 2017, p.20; PRIVACIDADE…, 2019). Secondo Sunstein, “a quel giorno, i social media non hanno contribuito a produrre una guerra civile, ma quel giorno probabilmente arriverà. Hanno già contribuito a prevenire un colpo di stato in Turchia nel 2016” (SUNSTEIN, 2017, p.20):

C’è una domanda sulla libertà individuale. Quando le persone hanno più opzioni e la libertà di scegliere tra di loro, hanno libertà di scelta, e questo è estremamente importante. La libertà richiede certe condizioni di fondo, permettendo alle persone di espandere i propri orizzonti e imparare ciò che è vero. Implica non solo la soddisfazione di eventuali preferenze e valori che le persone hanno, ma anche circostanze favorevoli alla libera formazione di preferenze e valori. Ma se le persone si qualificano in comunità che la pensano allo stesso modo, la loro libertà è a rischio. Vivono in una prigione di loro creazione. (SUNSTEIN, 2017, p.20).

Quando gli elettori indecisi non sanno ciò che è vero, le loro scelte possono essere compromesse durante il processo elettorale, che influenzerebbe direttamente la democrazia e il diritto di scegliere di votare, e possono anche cambiare l’esito di un’elezione.

3.2 CONSEGUENZE IN BRASILE

Il processo elettorale che si è verificato nel 2018 costituisce un lasso di tempo per comprendere l’uso delle piattaforme digitali per la propaganda elettorale e per combattere la diffusione della disinformazione.

3.2.1 INTERAZIONE CON BOTS

La Direzione dell’analisi delle politiche pubbliche della FGV[7] (FGV-DAPP) ha fatto alcuni casi di studio per analizzare la presenza di bot in importanti situazioni politiche in Brasile, come: il dibattito di Rede Globo il 2 ottobre 2014 con i candidati alla presidenza al primo turno delle elezioni; il dibattito di Rede Globo il 24 ottobre 2014 con le candidature presidenziali Dilma Rousseff e Aécio Neves, che erano in lizza per il secondo turno delle elezioni; le manifestazioni pro-impeachment tenutesi il 13 marzo 2016; il dibattito di Rede Globo con i candidati a sindaco di San Paolo il 29 settembre 2016; lo sciopero generale del 28 aprile 2017 e il voto sulla riforma del lavoro al Senato l’11 luglio 2017 (GRASSI et al., 2017, p.16)

Il professore FGV spiega come vengono raccolti i dati:

Le masse di dati raccolte da FGV/DAPP sono composte da metadati – informazioni sui dati stessi – e attraverso di essi, esploriamo le possibilità di identificare i conti che hanno agito automaticamente durante i periodi delle analisi. Così, abbiamo identificato che i metadati denominati generator si riferisce alla piattaforma che genera il contenuto del tweet, che è molto utile per rilevare i robot. (GRASSI et al., 2017, p.16)

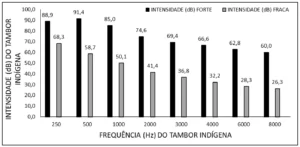

Per illustrare il funzionamento dei robot in questione, la FGV ha elaborato un grafico (FIG. 1), con i risultati ottenuti dall’analisi effettuata durante il voto sulla riforma del lavoro al Senato. Nel grafico, i puntini rosa rappresentano account che utilizzano generatori sospetti (GRASSI et al., 2017, p.17) e punti verdi, account che hanno generato almeno due dopindi tweet consecutivi in meno di un secondo (p.18). In questo caso, come negli altri, i robot sono presenti ad entrambe le estremità del dibattito, “essere in questa analisi in numero maggiore al polo contrario alla riforma” (p. 23).

Figura 1: Voto di riforma del lavoro

Queste analisi mostrano che le azioni automatizzate dei bot sono state efficaci nello svolgimento del dibattito pubblico, “sempre più presenti nelle reti, influenzando direttamente i momenti di inflessione e determinanti per il futuro”. (GRASSI et al., 2017, p.26).

Grazie al successo di questo studio, chiamato Robôs, Redes Sociais e Política al Brazil, che ha rilevato la presenza di robot su Twitter (GRASSI et al., 2017), FGV DAPP è stato invitato a partecipare al Consiglio consultivo su Internet e le elezioni[9] del Tribunale Elettorale Superiore (TSE). (RUEDIGER; GRASSI, 2018, p.4). Nel luglio 2018 è stata lanciata la Sala de Democracia Digital a Rio de Janeiro, che[10] mirava a “monitorare il dibattito pubblico sul web e a identificare le azioni di disinformazione, minacce e interventi illegittimi nel processo politico, con la pubblicazione di analisi giornaliere e settimanali”. FGV DAPP, attraverso un hotsite[11] e un’applicazione #observa2018, sezionato l’analisi delle reti. (RUEDIGER; GRASSI, 2018, p.5).

Tra queste pubblicazioni, un’analisi condotta durante la settimana dell’8-13 agosto 2018, FGV DAPP “rilevato, attraverso la propria metodologia di identificazione del robot, la presenza di 5.932 conti automatizzati nel dibattito sulle elezioni e candidati alla presidenza. Questi profili hanno generato 19.826 pubblicazioni” (RUEDIGER, 2018, p.4) solo sul social network Twiter:

Nel 2018, Facebook ha annunciato azioni per proteggere le elezioni in Brasile. Tra gli impegni vi era la lotta contro la disinformazione; maggiore trasparenza degli annunci sulla piattaforma; la rimozione degli account impostori; e la rimozione dei santinhos digitais utilizzati per ingannare gli elettori mettendo la foto di un candidato e il numero di partito di un altro. Queste e altre misure sono state adottate per garantire l’autenticità dei contenuti pubblicati sulla piattaforma (RUEDIGER; GRASSI, 2018a, p.16)

Ma non sembra che sia abbastanza. L’analisi Fgv-DAPP durante le campagne elettorali del 2018 mostra che “le interferenze promosse dai robot si sono verificate spesso in modo articolato e sincronizzato, da botnet (reti robot)” (RUEDIGER; GRASSI, 2018a, p.27). Di seguito sono riportati i risultati dell’analisi eseguita:

Nel periodo pre-campagna, almeno tre reti di robot sono state responsabili della pubblicazione di 1.589 tweet in una settimana. I messaggi cercavano, in generale, di aumentare e/o smobilitare le candidacies, specialmente nei centri di una maggiore polarizzazione: Jair Bolsonaro-Lula/Haddad.

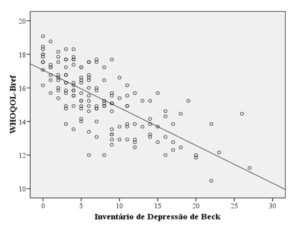

Le basi pro-Bolsonaro e pro-Fernando Haddad sono state anche quelle che hanno presentato la maggior parte delle interferenze dei robot durante il periodo della campagna. Dal 12 al 18 settembre, ad esempio, sono stati raccolti 7.465.611 tweet e 5.285.575 retuiti riguardanti i candidati. All’interno di questo database, la metodologia di rilevamento dei robot di FGV DAPP ha trovato 3.198 account automatizzati, che hanno generato 681.980 interazioni, il 12,9% del totale dei retweet del grafico sottostante.

A destra, gli account automatizzati rappresentavano il 17,8% dei retweet del gruppo favorevoli al deputato federale del PSL; a sinistra, rappresentavano il 13,2% delle interazioni allineate con la candidatura PT e, in misura minore, la candidatura di Guilherme Boulos del PSol. (RUEDIGER; GRASSI, 2018a, p.28)

Figura 2: Interazioni con i robot alle elezioni del 2018

WhatsApp ha una natura di comunicazione privata e non poteva essere analizzato da FGV-DAPP, tuttavia, ha notato quanto segue:

Date le particolarità della piattaforma, come la natura della comunicazione privata, di portata sociale ridotta (famiglia, amici, collaboratori), e la minore interazione diretta tra influencer e cittadini comuni, c’era un fenomeno diverso di dispersione e viralizzazione dei contenuti politici rispetto a quanto osservato in altri scenari recenti (nazionali e internazionali), in cui Facebook e Twitter erano in maggiore importanza. I numerosi social network ormai popolari tra i brasiliani, ampiamente utilizzati per discutere le elezioni e la congiunzione politica, presentano particolarità riguardanti il processo di produzione e di interazione con i contenuti. Tutte le strategie di propagazione delle informazioni, tuttavia, sono adattate alle proprietà di ogni piattaforma, e con questo sono più modi di manifestare disinformazione e la condivisione di informazioni false. Non solo da link o pagine che simulano attività giornalistiche, ma con un uso intenso di video, tutorial, blog, memi, testi apocrifi e pubblicazioni sensazionali; vari sottotipi di Fake News, quindi. (RUEDIGER; GRASSI, 2018a, p.29)

Anche se non è stato dimostrato che le interazioni con i bot o la diffusione di notizie false hanno alterato l’esito delle elezioni presidenziali del 2018 in Brasile, è necessario essere consapevoli di questa possibilità. Come è già stato dimostrato, l’ormai defunta società Cambridge Analytics è riuscita a eleggere il candidato dell’agenzia della campagna che l’ha assunta alle elezioni presidenziali statunitensi del 2016.

L’attuale Presidente della Repubblica è stato eletto con un piccolo periodo di propaganda elettorale in TV, il che dimostra che sarebbe stato eletto con la sua campagna sulle piattaforme sociali. C’è stato un “cambiamento strutturale nel modo in cui sono state organizzate campagne di successo – i social network sono diventati l’asse principale del dialogo tra elettori e funzionari eletti” (RUEDIGER; GRASSI, 2018a, p.29).

D’altra parte, Ruediger e Grassi riportano conseguenze positive in questo scenario digitale. Tra loro spiccano:

1) la maggiore richiesta di trasparenza nelle relazioni istituzionali della politica; 2) la capacità di agire rapidamente e interferire nel processo decisionale degli agenti statali e dei rappresentanti eletti, attraverso il contatto diretto con loro su Internet;

3) e l’espansione del potenziale ruolo che il cittadino può svolgere nella conduzione delle politiche pubbliche e degli atti che lo interessano. Anche il feedback accelerato e la velocità di trasmissione, condivisione e produzione di contenuti, i miglioramenti nel modo in cui l’attività giornalistica e il dibattito politico rispondono a questi nuovi paradigmi (2018a, p.29-30) diventano imperativi.

3.2.2 DIFFUSIONE DI NOTIZIE FALSE

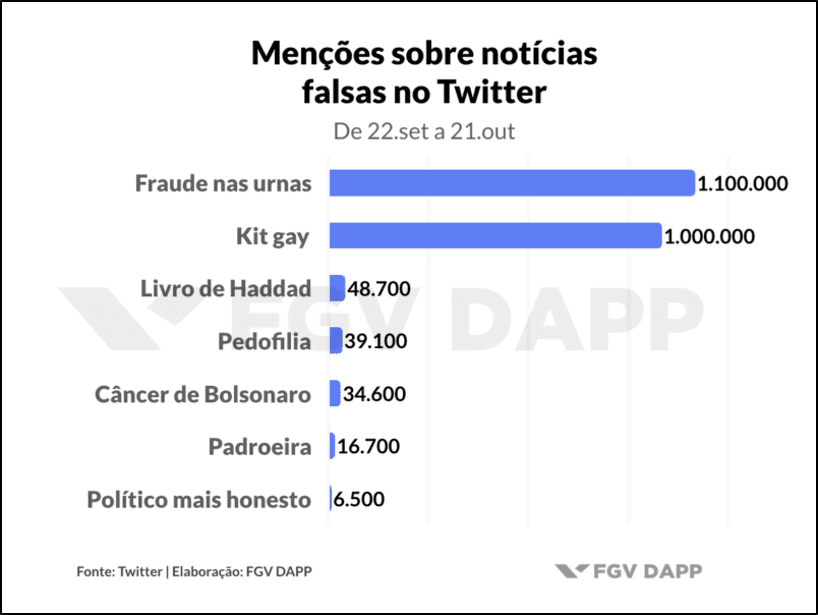

L’analisi FGV-DAPP condotta durante il periodo elettorale 2018 ha concluso che non c’era “nessuna distribuzione automatizzata e di massa di notizie false”. Essa afferma che la disinformazione era presente, “ma i robot non erano i più responsabili della sua diffusione”. Nella settimana dell’attacco di coltello contro Bolsonaro, per esempio, solo lo 0,9% delle interazioni sono state automatizzate dai robot (RUEDIGER; GRASSI, 2018a, p.29). Secondo l’analisi le notizie false che si distinguevano di più erano quelli correlati in fico. 3:

Figura 3: Notizie false

3.3 CONSEGUENZE PER DEMOCRAZIA

Nel 2016, le elezioni presidenziali statunitensi hanno richiamato l’attenzione su nuovi modi di fare politica e campagne politiche attraverso piattaforme digitali. Le elezioni hanno coinvolto casi di fake news che hanno avuto ripercussioni in tutto il mondo, come “la presunta influenza di hacker russi che attraverso Internet Research Agency avrebbe generato contenuti falsi” e raggiunto milioni di elettori attraverso Facebook e Twitter. (RUEDIGER; GRASSI, 2018, p.12)

Prima di allora nel Regno Unito si è svolto un referendum sul suo ritiro dall’Unione europea. Nelle indagini condotte nel periodo dal 2017 all’inizio del 2019 è stato dimostrato che la società Cambrigde Analytics insieme ad altre agenzie ha influenzato il risultato delle votazioni, indirizzando i loro falsi messaggi a un certo gruppo di persone. L’azienda è stata in grado di profilare gli elettori utilizzando i dati utente di Facebook. Lo scandalo di Facebook è stato segnalato in tutto il mondo all’inizio del 2018 con la pubblicazione dei dati trovati dalla giornalista britannica Carole Cadwalladr (ROSENBERG; CONFESSORE; CADWALLADR, 2018) che da allora ha parlato di questa nuova minaccia alla democrazia. Il Parlamento ha infine chiuso le sue indagini e ha pubblicato una relazione all’inizio del 2019. Vale la pena evidenziare alcune conclusioni sull’uso di queste piattaforme:

La legge elettorale non è adatta allo scopo e deve essere modificata per riflettere i cambiamenti nelle tecniche di campagn[…]a. Ci deve essere: assoluta trasparenza delle campagne politiche online, compresi i segni chiari e persistenti su tutti gli annunci e i video politici a pagamento, che indicano la fonte e l’inserzionista; una categoria introdotta per la spesa digitale per le campagne; e regole esplicite relative al ruolo e alle responsabilità dei sostenitori designati.

Gli elementi pubblicitari politici devono essere accessibili al pubblico in un repository ricercabile, ovvero chi paga gli annunci, quali organizzazioni sponsorizzano l’annuncio, che sono presi di mira dagli annunci, in modo che i membri del pubblico possano comprendere il comportamento dei singoli inserzionisti. Deve essere gestito indipendentemente dall’industria pubblicitaria e dai partiti politici. (HOUSE…, 2019, p.24)

Si osserva che “le società democratiche di tutto il mondo hanno sperimentato negli ultimi anni l’emergere di un nuovo attore della comunicazione per plasmare con successo, con successo o meno, l’opinione pubblica nei dibattiti politici, le elezioni, i referendum e le crisi nazionali: la disinformazione” (RUEDIGER; GRASSI, 2018a, p.4). La diffusione di campagne false basate sulle notizie attraverso le piattaforme digitali nei momenti chiave della società, insieme all’azione dell’intelligenza artificiale nel controllo dei bot di account automatizzati, “è diventata uno strumento chiave nella strategia di alcuni gruppi per attirare il traffico digitale, coinvolgere o addirittura influenzare dibattiti, smobilitare gli avversari e generare falso sostegno politico” (RUEDIGER; GRASSI, 2018a, p.4) diventando una grave minaccia per le democrazie di tutto il mondo.

Un altro pericolo che le piattaforme digitali presentano alla democrazia è la facilità che esiste per la formazione di camere di echi, già discusse in questo lavoro. Gruppi isolati aumentano la polarizzazione politica e l’odio, dando ancora più carburante al funzionamento dei bot e alla diffusione di notizie false.

Ma la questione unificante nella misura massima saranno i vari problemi per una società democratica che possono essere creati dal potere di filtrare. Le democrazie possono o non possono essere fragili, ma la polarizzazione può essere un problema serio, ed è aumentata se le persone risiedono in diversi universi di comunicazione – come, infatti, a volte sembrano fare negli Stati Uniti, nel Regno Unito, in Francia, in Germania e altrove. Non c’è dubbio che il moderno ambiente di comunicazione, compresi i social media, contribuisce all’aumento della partigianeria. (SUNSTEIN, 2018, p.36)

Qualsiasi gruppo estremista, terrorista o partito politico che abbia i mezzi per controllare le piattaforme dei social media avrebbe quindi il potere di governare dopo aver influito su un’elezione teoricamente democratica, che presenterebbe una serie di minacce al sistema democratico.

In questo senso, Carole Cadwalladr, nel documentario Privacidade Hackeada, fa un appello commovente per riflettere su come i social network possono essere utilizzati per diffondere il male e l’odio, paesi polarizzanti:

Sembra che stiamo entrando in una nuova era. Possiamo vedere che i governi autoritari sono in aumento. E stanno usando questa politica di odio e paura su Facebook. Guardate il Brasile. C’è questo estremista di destra che è stato eletto e sappiamo che WhatsApp, che fa parte di Facebook, era chiaramente implicato nella diffusione di Fake News. E guarda cos’è successo in Myanmar. Ci sono prove che Facebook è stato usato per incitare all’odio razziale che ha causato il genocidio. Sappiamo anche che il governo russo stava usando Facebook negli Stati Uniti. Ci sono prove che i russi hanno creato falsi memi Di vita nera, e quando la gente ha cliccato su di loro è stato diretto a pagine in cui sono stati effettivamente invitati a proteste che sono state organizzate dal governo russo. E allo stesso tempo stavano creando pagine che miravano a gruppi opposti, come Blue Lives Matter. Il problema è alimentare la paura e l’odio per rivoltare il paese contro se stesso. Dividi e conquista. Queste piattaforme che sono state create per connetterci sono ora usate come armi ed è impossibile sapere cosa sta succedendo sulle stesse piattaforme in cui parliamo con i nostri amici o condividiamo foto di bambini. Niente è quello che sembra” (PRIVACIDADE …, 2019, 96 min)

4. GIUSTIZIA ELETTORALE IN BRASILE

La Giustizia Elettorale ha come scopo di realizzare la “verità elettorale”, per la realizzazione della democrazia (VELLOSO, 1996, p.9 apud VELLOSO; AGRA, 2016), ciò significa che la Giustizia Elettorale è responsabile di “consentire l’espressione della volontà degli elettori, rendendo operative tutte le procedure elettorali in modo che si sviluppino in armonia e trasparenza, senza essere disturbati dalla sovranità popolare” (VELLOSO; AGRA, 2016).

La Giustizia Elettorale è responsabile della disciplina e dell’esercizio del suffragio al fine di realizzare la sovranità popolare. È attraverso le elezioni che viene garantita la libera formazione della volontà degli elettori e l’uguaglianza tra i candidati, garantendo la democrazia brasiliana.

Arte. 105 della Legge elettorale (9.504/97) afferma che la Corte Elettorale Superiore ha una funzione normativa. “Puoi impartire tutte le istruzioni necessarie per la tua fedele esecuzione, ascoltate in anticipo, in un’audizione pubblica, i delegati o i rappresentanti dei partiti politici.” Così, la TSE può modificare le regole per controllare l’uso delle piattaforme digitali per le campagne elettorali.

4.1 RESPONSABILITÀ DELLA GIUSTIZIA ELETTORALE NELL’USO DELLE PIATTAFORME DIGITALI

Nel 2017, il TSE ha modificato la legge n. 9.504/1997 (Formulazione n. 13.488, 2017), dando una nuova formulazione all’arte. 57 in modo che le piattaforme digitali come Facebook, Twitter e altri potrebbero essere utilizzati nelle campagne elettorali dall’agosto dell’anno elettorale. Così, durante la campagna per le elezioni presidenziali nel 2018 molto è stato detto a favore di questo metodo che con poco investimento finanziario, genera più risultati.

La grande analisi dei media, post-contabilità dei sondaggi, si è concentrata su come il candidato presidenziale con il tempo più lungo in TV (SHALDERS, 2018), Geraldo Alckmin (PSDB) non è stato nemmeno eletto al secondo turno, mentre il candidato eletto, Jair Bolsonaro (PSL), che aveva solo 8 secondi in fase elettorale ha ottenuto risultati molto più alti. Il Presidente stesso ha spesso usato il suo spazio sui social network per lodare il fatto che la sua campagna elettorale è costata molto meno di quella di altri candidati di alto peso. Allo stesso modo, il candidato João Amoedo (partido NOVO), finora sconosciuto alla maggior parte della popolazione brasiliana, ha anche ottenuto risultati espressivi senza partecipare ad alcun dibattito promosso dai canali televisivi e facendo uso dei social media, arrivando al quinto posto al primo turno, davanti ad altri candidati più noti. Così, le elezioni del 2018 hanno rispecchiato i cambiamenti nello scenario della campagna politica che da quel momento in poi si sono verificati anche attraverso le piattaforme digitali.

Tuttavia, dopo lo scandalo di Facebook e l’ormai defunta società britannica Cambridge Analytica, il mondo si rese conto di quanto possa essere redditizio il mercato dei dati personali. In Brasile, ci sono leggi che vietano e criminalizzano l’acquisto di voti[15], ma queste leggi non contengono più l’attuale realtà delle campagne elettorali. Puoi spendere qualsiasi somma di denaro per le inserzioni su Facebook, Google o YouTube, e nessuno lo saprà, perché quei dati sono inaccessibili. Quello che hai è la responsabilità con il TSE, che ti permetterebbe di sapere quanto è stato speso per questi annunci, ma il contenuto dello stesso non sarà mai rivelato. Carole Cadwalladr, nella sua presentazione a una conferenza TED nell’aprile di quest’anno, afferma:

… ciò che accade su Facebook rimane su Facebook, perché solo noi vediamo il contenuto della nostra pagina, che poi scompare. È impossibile cercare qualcosa. Non abbiamo idea di chi abbia visto quali annunci, quale sia stato il loro impatto o quali dati sono stati utilizzati per scegliere il pubblico di destinazione. Nemmeno chi ha piazzato gli annunci, quanti soldi sono stati spesi, o che nazionalità erano. (CADWALLADR, 2019)

Il numero sorprendente di studi e dati esistenti che mostrano il rapporto tra l’interazione dei bot che influenzano gli utenti durante i periodi elettorali, mostrano quanto “piattaforme dovrebbero essere attenti al rispetto del quadro giuridico per le campagne elettorali sui social network” (RUEDIGER; GRASSI, 2018, p.25). A tal fine, il TSE dovrebbe creare standard che monitorino meglio se le piattaforme sono conformi ai limiti già previsti dalla legge. È responsabilità della Corte garantire il regolarità delle elezioni e proteggere la democrazia. Ruediger suggerisce inoltre:

… il sorprendente volume di interazioni di candidature, su Twitter, Facebook, YouTube e Instagram, indicano che le piattaforme devono essere attente al rispetto del quadro giuridico per le campagne elettorali sui social network per mantenere, in parallelo, le chiamate degli utenti alle loro politiche e agli standard (RUEDIGER; GRASSI, 2018, p.25).

Il TSE non dovrebbe consentire campagne elettorali su queste piattaforme che sono inaccessibili e impossibili da monitorare. Non è possibile monitorare la possibile manipolazione di un determinato pubblico di destinazione da parte degli annunci a questo scopo. Occorre quindi mettere in atto norme che costringano le piattaforme sociali a fare ciò che è stato suggerito dalla relazione del Parlamento britannico citata in precedenza, individuando gli autori di pubblicazioni con contenuto elettorale.

Caldas e Caldas spiegano ciò che è stato fatto, in relazione a questo tema, in altre parti del mondo:

In questo senso, l’Unione europea ha creato il 25 maggio 2018 il regolamento generale sulla protezione dei dati (EUROPEAN COMMISSION, 2018) dopo studi che indicano che la diffusione di notizie false è stata fatta dall’analisi dei dati degli utenti (MARTENS et al., 2018 apud CALDAS; CALDAS, p.214, 2019). In questa direzione, l’11 giugno 2018, il Consiglio Nazionale dei Diritti Umani ha approvato la Raccomandazione n. 04 dell’11 giugno 2018, che si occupa “di misure per combattere le fake news e la garanzia del diritto alla libertà di espressione” (BRASIL, 2018b apud CALDAS; CALDAS, p.214, 2019), che raccomanda l’approvazione di un disegno di legge finalizzato alla protezione dei dati personali (BRASIL, 2018a apud CALDAS; CALDAS, p.214, 2019), considerando che “la produzione e il targeting delle cosiddette fake news oggi sono direttamente correlati alla massiccia e indiscriminata raccolta e trattamento dei dati personali” (BRASIL, 2018b apud CALDAS; CALDAS, p.214, 2019) (CALDAS; CALDAS, p.214, 2019).

5. COME IL TSE HA AFFRONTATO QUESTO PROBLEMA SINCE THE 2018 ELECTIONS

Nel maggio 2019, la TSE ha tenuto un seminario internazionale sulle notizie false e le elezioni insieme all’Unione europea. Il seminario si è svolto a Brasilia e ha avuto diversi oratori: il ministro Rosa Weber, il presidente della Corte Superiore Elettorale (TSE), il Ministro Luiz Fux, il Vicepresidente della Corte Suprema (STF) e il Ministro Sergio Moro, Ministro della Giustizia e della Pubblica Sicurezza.

Secondo il sito web TSE sul seminario:

Nel corso dell’anno 2018, il Consiglio consultivo per Internet ed elezioni, istituito dal Tribunale Elettorale Superiore (TSE) il 7 dicembre 2017, ha sviluppato numerose attività legate all’influenza di Internet nelle elezioni, in particolare per quanto riguarda il rischio di Fake News e l’uso di robot nella diffusione delle informazioni, azioni che hanno contribuito all’espansione della conoscenza della giustizia elettorale di fronte al tema , non solo per prevenire ma anche per facilitare il confronto del grave problema legato alla diffusione di notizie false durante le elezioni generali del 2018. (BRASIL, 2019f).

Sempre nel Seminario, la TSE riconosce la sua responsabilità primaria nel proteggere la democrazia brasiliana quando afferma:

Considerando la complessa equazione del fenomeno noto come Fake News, in tutti i rami della società, sia in Brasile che all’estero, spetta alla Giustizia Elettorale tenere d’occhio il problema, orientato a trovare modi più efficaci per affrontare le future elezioni. (BRASIL, 2019f).

L’obiettivo principale del seminario era quello di sollevare modi per prevenire o ridurre al minimo la diffusione di notizie false nelle elezioni comunali del 2020, tenendo conto dell’esperienza acquisita durante le elezioni del 2018. Così, era destinato a raccogliere i dati, condividere esperienze, suggerimenti di benvenuto, discutere di misure valide per combattere le notizie false, nonché promuovere una fonte di studi e proposte da inoltrare alla Corte Elettorale e al Congresso Nazionale (BRASIL, 2019f).

Nel febbraio di quest’anno, l’ordinanza n. 115 è stata pubblicata sul portale TSE, che “istituisce un gruppo di lavoro incaricato di condurre studi per identificare i conflitti nell’attuale norma derivanti dalle riforme elettorali e proporre la rispettiva sistematizzazione” (BRASIL, 2019a). Da questa ordinanza sono nati Diálogos para a construção da Sistematização das Normas Eleitorais, studi preliminari con l’obiettivo di:

… individuare e sistematizzare la legislazione pertinente, evidenziando incoerenze, o sovraregolamentazione, con la Costituzione federale come parametro e dai testi legislativi, dalle risoluzioni e persino dalle discussioni giurisprudenziali, al fine di avere come risultato un testo più conciso, coerente e completo all’attuale realtà della democrazia brasiliana.” (BRASIL, 2019, p.3).

Sottolinea inoltre la necessità di “un’attenzione particolare, ad esempio, a questioni che richiedono una convergenza tra legge elettorale, tecnologia e marketing digitale”, citando anche la “possibilità di potenziamenti, utilizzata per la prima volta alle elezioni generali del 2018” (BRASIL, 2019, p.3). Attraverso questo studio si può vedere che il TSE sta già analizzando il problema di boost e bot utilizzati dai social media.

Legge 9.504/97, che ha subito una mini-riforma nel 2017 che autorizza l’uso di piattaforme digitali nella pubblicità elettorale, presenta ancora diverse incongruenze. Secondo la legge, la spinta è vietata agli individui e limitata a candidati o coalizioni. Così, Caldas e Caldas (p. 213, 2019) stato:

… gli esperti di legge elettorale valutano:

Con la spinta pagata, si aprono scappatoie per abuso illecito di potere economico, abuso di potere politico, abuso dei media, propaganda proibita (effettuata da chiese, sindacati e persone giuridiche in generale),fake news, tra gli altri possibili atti illeciti. Alcuni di questi clandestini possono portare all’impeachment della registrazione della domanda, al diploma (se eletto) e alla perdita del mandato. (ALMEIDA; LOURA JUNIOR, 2018 apud CALDAS e CALDAS)

Il testo originale aveva nella sua arte. 57-B, n. 6 disposizione che prevedeva misure più efficaci per inibire le fake news durante le elezioni. Tuttavia, lo stesso è stato messo il veto dall’allora Presidente della Repubblica Michel Temer. Il testo del n. 6 originariamente previsto per (CALDAS e CALDAS, p. 213, 2019):

La denuncia dell’incitamento all’odio, la diffusione di informazioni false o il reato a scapito di una parte o di un candidato, effettuata dall’utente di una domanda o di un social network su Internet, attraverso il canale reso disponibile a tale scopo nel fornitore stesso, comporterà una sospensione massima della pubblicazione segnalata per un massimo di ventiquattro ore fino a quando il fornitore non si assicurerà che l’identificazione personale dell’utente sia stata pubblicata , senza fornire alcun dato dal segnalato all’informatore, ad eccezione dell’ordine del tribunale. (BRASIL, 2017, Grifo nosso apud CALDAS e CALDAS).

La giustificazione del veto, secondo Caldas e Caldas è l’esistenza di “paura che una legislazione per reprimere le notizie false possa generare una restrizione alla libertà di espressione” soprattutto in uno scenario di “intensa polarizzazione politica, in cui le passioni politiche fanno svanire il confine tra verità, punto oggettivo e soggettivo”. (CALDAS e CALDAS, p. 214, 2019)

Concludi Caldas e Caldas che, nonostante Art. 25 di risoluzione n. 23,551/2017 TSE contengono “dispositivo per cercare di prevenire la diffusione di fake news… la velocità della giustizia probabilmente non sarà sufficiente a prevenire questo verificarsi… proprio perché la sua caratteristica è la velocità di propagazione.” (CALDAS e CALDAS, p. 214, 2019).

Si rende conto che trovare una soluzione plausibile non sarà facile. Qualsiasi misura più drastica di inibire le notizie false o prevenire certi modi di utilizzare piattaforme digitali potrebbe affrontare la libertà di espressione. Un paradosso difficile da risolvere. Tuttavia, la Corte ha adottato alcune misure.

Il portale TSE e le sue pagine sui social network, hanno video illustrativi ed educativi sui “miti nelle elezioni” e anche consigli per gli elettori di non perdere il titolo di elettore. Tuttavia, non c’era nessun video fino a settembre di quest’anno, allertando e sensibilizzando gli elettori sul pericolo di fake news. Il TSE ha poi iniziato a trasmettere all’inizio di settembre, sul suo canale YouTube [16], la serie video Affrontare la disinformazione[17]” (BRASIL, 2019b). Questa serie, ad oggi (21 ottobre 2019), ha 6 video che spiegano quanto sia stata efficace e veloce la TSE nel risolvere la questione delle fake news sul funzionamento delle macchine per il voto elettronico, e anche insegnare all’elettore a non usare il termine fake news, per avere un senso peggiorativo e non concreto, secondo gli esperti intervistati nei video. Inoltre, secondo loro il termine è ambiguo, impreciso e squalifica la stampa, utilizzata dai politici a questo scopo. Pertanto, si consiglia di utilizzare il termine “disinformazione”.

Come si può vedere, i video prodotti dalla TSE elogiano la stessa corte affermando quanto rapidamente la Corte abbia agito nella lotta contro la disinformazione, oltre a spiegare perché l’uso del termine fake news è sbagliato. Anche se hanno alcuni secondi di suggerimenti su come ridurre la disinformazione, i video non sono puntuali nel chiarire all’elettore l’esistenza di account automatizzati con potenziale influencer nell’opinione pubblica, spiegando ad esempio il funzionamento dei bot. In nessun momento i video prodotti dalla Corte chiariscono l’elettore sulle conseguenze che la disinformazione può portare all’esito di un’elezione. Oltre a non essere disponibile in un luogo di facile conoscenza dell’elettore. Quanti elettori guarderanno questi video? Finora, non ci sono nemmeno 500 visualizzazioni su di loro.

In un altro tentativo di inibire la diffusione di fake news, quest’anno 2019, il ramo legislativo ha aggiunto l’arte. 326-A alla Legge 4.737/65 (Codice Elettorale) in verbosa:

Art. 326a. Dare motivo all’avvio di indagini di polizia, procedimenti giudiziari, indagini amministrative, indagini civili o cattiva condotta amministrativa, attribuendo a qualcuno la commissione di un reato o un’infrazione di cui conosce innocenti, a scopo elettorale:

Pena – reclusione, da 2 (due) a 8 (otto) anni, e multa.

N. 1 – La penalità viene aumentata dalla sesta parte, se l’agente utilizza l’anonimato o il nome presunto.

2 – La sanzione è ridotta della metà, se l’imputazione è una pratica reato.

3 – Le stesse sanzioni di questo articolo sono inademperrate da coloro che, dimostrato di essere a conoscenza dell’innocenza dell’imputato e a fini elettorali, rivelano o propongono, con qualsiasi mezzo o forma, l’atto o il fatto che gli era falsamente attribuito[18]. (BRASIL, 1965)

Il Presidente della Repubblica ha messo il veto al 3o stesso che “la condotta di calunnia con scopo elettorale è già caratterizzata da un’altra disposizione della pena del [com] codice elettorale da sei mesi a due anni”, ferendo così il “principio di proporzionalità”. Tuttavia, il veto è stato annullato dal Congresso nell’agosto 2019, caratterizzando l’ennesimo crimine elettorale. (Congresso…, 2019).

Sempre in agosto, il TSE ha lanciato il Programa de Enfrentamento à Desinformação com Foco nas Eleições 2020. Come spiegato sul sito web della Corte:

Il programma è stato organizzato in sei assi tematici. La prima, “Organizzazione interna”, mira all’integrazione e al coordinamento tra i livelli e le aree che compongono la struttura organizzativa della Giustizia Elettorale e la definizione delle rispettive attribuzioni contro la disinformazione.

Un altro asse su cui si lavorerà è “Media and Information Literacy”, che mira a consentire alle persone di identificare e controllare una disinformazione, oltre a stimolare la comprensione del processo elettorale.

Sul tema “Contenimento alla disinformazione”, l’idea è quella di istituire misure concrete per scoraggiare le azioni di proliferazione di informazioni false. Con l’asse “Identificazione e verifica della disinformazione”, il TSE intende cercare il miglioramento e nuovi metodi per identificare le possibili pratiche di diffusione dei contenuti fallaci.

Anche gli assi “Miglioramento del Sistema Legale” e “Miglioramento delle Risorse Tecnologiche” fanno parte del programma lanciato dalla TSE.

Prima della firma del termine di adesione, il ministro Rosa Weber ha annunciato il lancio di un sito web che raccoglierà[19] informazioni sulla disinformazione e anche un libro che è il risultato dei dibattiti che si sono svolti presso il Seminario Internazionale Fake News and Elections, tenutosi nel maggio di quest’anno, nel TSE. Il lavoro è disponibile sul portale giudiziario[20]. (BRASIL, 2019e)

Il 22 ottobre di quest’anno, Google, Facebook, Twitter e WhatsApp hanno aderito al programma. A quel tempo, il ministro Rosa Weber “ha classificato come dannoso l’effetto causato dalla disinformazione alla democrazia, al processo elettorale e alla società in generale”. E ha detto che l’obiettivo del programma “è quello di provocare il coinvolgimento di tutte le sfere sociali nella lotta contro la diffusione di informazioni fuorvianti su Internet.” (BRASIL, 2019c). Ha anche detto che queste aziende hanno la capacità di migliorare le tecnologie che identificano “l’uso improprio di bot e altri strumenti di diffusione di contenuti automatizzati.” Il Presidente della TSE ha concluso il suo discorso con il seguente desiderio:

Spero che riusciremo a raggiungere la fine delle elezioni del 2020, convinti che il processo elettorale non abbia subito maggiori influenze dal fenomeno della disinformazione e che ciò fosse dovuto, e molto, al contributo dei partner del nostro programma. (BRASIL, 2019c).

Il programma della Corte sembra portare già alcuni risultati dalle piattaforme stesse che vi hanno aderito. Il 29 ottobre 2019, il social network Twiter ha incontrato il gruppo di gestione del programma per “allineare strategie congiunte” (BRASIL, 2019d). Il giorno dopo, la stampa ha annunciato che il social network ha deciso di vietare tutti i tipi di propaganda politica (TWITER…, 2019). Tuttavia, sembra che la preoccupazione della giustizia elettorale abbia lo scopo di combattere solo la disinformazione, nulla menziona la capacità che aziende come l’ormai defunta Cambridge Analytics debbano classificare i profili politici attraverso gli utenti dei social media dei dati degli elettori.

6. CONCLUSIONE

L’analisi dei social network come influencer del dibattito politico è fondamentale per comprendere la fase in cui le democrazie si incontrano (RUEDIGER; GRASSI, 2018) e riflettono sul futuro elettorale brasiliano.

Pertanto, affinché i social network rimangano uno spazio democratico di opinione e di informazione, è necessario comprendere l’organicità dei dibattiti, individuando i responsabili di azioni coordinate per stimolare i messaggi. Le reti devono diventare più trasparenti, cercando di comprendere gli interessi dietro l’assunzione di questi servizi di automazione e diffondere la disinformazione. Espandere la capacità di identificare e reprimere l’automazione dannosa dei profili dei social media dovrebbe essere una priorità. (GRASSI et al., 2017).

Nel frattempo, la Corte elettorale dovrebbe promuovere politiche di sensibilizzazione per gli elettori che utilizzano piattaforme digitali, sui meccanismi utilizzati per la manipolazione, dalla formazione di camere di echo chambers, all’uso di intelligenza artificiale e bot, che intenzionalmente indirizzano i loro messaggi a destinatari specifici. Questo permette alle persone di filtrare ciò che vedono, e anche essere in grado di limitare la crescente potenza dei fornitori di selezionare ogni utente individualmente, analizzandoli in base alle informazioni sociali acquisite nei loro profili su queste piattaforme.

Cass Sunstein ha ragione quando insiste sul fatto che, in una società diversificata, il sistema di libertà di espressione e il diritto alla privacy richiedono molto di più delle restrizioni alla censura governativa e del rispetto delle scelte individuali. Mentre la censura è una minaccia per la democrazia e la libertà, un sistema di libertà di espressione ben funzionante deve soddisfare due requisiti distinti: in primo luogo, le persone dovrebbero essere esposte a materiali che non avrebbero scelto in anticipo, evitando così la formazione di camere echo chambers. In secondo luogo, le questioni dovrebbero riguardare argomenti e opinioni che gli utenti delle piattaforme digitali non hanno cercato, e possono anche non essere d’accordo, ma che sono importanti per evitare la polarizzazione e l’estremismo. Il professore di Harvard spiega che non suggerisce che il governo costringa le persone a vedere le cose che vogliono evitare. Ma dice che gli incontri non pianificati e imprevisti sono al centro della democrazia, facendo così il suo appello per la serendipità (SUNSTEIN, 2017).

Secondo Caldas e Caldas (2019), le fake news, o disinformazione, si diffondono rapidamente e lascia conseguenze per lungo tempo. Affrontare questo fenomeno richiede misure efficienti e rapide per ridurne la diffusione e gli effetti, poiché questa diffusione può interferire nel processo democratico brasiliano, come si vede in questo lavoro. È inoltre necessario creare strumenti per identificare gli agenti responsabili di questi episodi e strumenti per misurare i possibili danni causati in un’elezione. Oltre alle misure che consentono un maggiore controllo dell’accesso ai dati utente, poiché il targeting dei contenuti dipende dall’identificazione dei profili di un gruppo di destinatari.

È estremamente urgente e importante che la Giustizia Elettorale insieme al Ramo Legislativo, crei mezzi di protezione dei dati digitali, al fine di evitare che emergano nuovi Cambridge Analytics e utilizzino la loro analisi dei profili per indirizzare i messaggi agli obiettivi scelti al fine di interferire nel processo democratico delle elezioni.

Fino a quando queste misure non saranno adottate, gli elettori dovrà essere informati. Il Brasile vive l’era della polarizzazione politica. È un dato di fatto. Non fa differenza se l’individuo è a favore di una politica di sinistra o di destra. La tendenza di questo non è quella di sostenere un’idea che è sorta da un partito contrario alla sua visione, anche se è d’accordo con essa. In questo modo, sembra facile manipolare un gruppo bersaglio in modo che l’odio e il caos si diffondano. E come si vede in questo documento, sarebbe anche possibile cambiare l’esito di un’elezione.

Pertanto, è inteso che l’azione della giustizia elettorale è timida in considerazione del ritaglio portato in questo dibattito, cioè per educare gli elettori che utilizzano queste piattaforme sui pericoli della manipolazione dei dati nei social network, oltre all’attenzione che è stata data alla consapevolezza della disinformazione.

Le Fake news sono sempre esistite, contrariamente alla capacità che alcuni software devono analizzare il profilo di ogni utente elettore. Questa capacità è una novità di questa era digitale e ha un immenso potenziale per indirizzare un particolare gruppo e può anche manipolare l’esito di un processo elettorale.

La giustizia elettorale deve apprezzare il regolarità delle elezioni. Pertanto, è necessario sensibilizzare la popolazione su questi mezzi di manipolazione. Educare le persone a proteggere i loro dati e le informazioni sulle domande che ricevono, in particolare sui social network. Chissà, questa polarizzazione diminuisce un giorno, e con essa, il potenziale di manipolazione esistente nelle piattaforme sociali.

RIFERIMENTI

BECKER, Lauro. Site, blog, landing page, hotsite ou e-commerce? Entenda a diferença! Orgânica Digital, jul. 2016. Disponível em: https://www.organicadigital.com/blog/site-blog-landing-page-hotsite-ou-e-commerce-entenda-a-diferenca/. Acesso em: 20 out. 2019.

BITTAR, Eduardo C. B. Metodologia da pesquisa jurídica. 15. ed. São Paulo: Saraiva, 2017. ISBN: 9788547220037.

BOND, Robert M. et al. A 61-million-person experiment in social influence and political mobilization. Nature, n. 489, p. 295-298, set. 2012. DOI: https://doi.org/10.1038/nature11421. Disponível em: https://www.nature.com/articles/nature11421. Acesso em: 8 jan. 2019.

BRASIL. Presidência da República. Casa Civil. Subchefia para Assuntos Jurídicos. Constituição da República Federativa do Brasil de 1988. Portal da Legislação. Disponível em: http://www.planalto.gov.br/ccivil_03/constituicao/constituicao.htm. Acesso em: 10 mai. 2019.

BRASIL. Presidência Da República. Casa Civil. Subchefia Para Assuntos Jurídicos. Lei Nº 9.504, de 30 de setembro de 1997. Lei da Eleições. Portal da Legislação. Disponível em: http://www.planalto.gov.br/ccivil_03/leis/l9504.htm Acesso em: 10 mai. 2019.

BRASIL. Presidência Da República. Casa Civil. Subchefia Para Assuntos Jurídicos. Lei Nº 4.737, de 15 de julho de 1965. Código Eleitoral. Portal da Legislação. Disponível em: http://www.planalto.gov.br/ccivil_03/leis/l4737.htm Acesso em: 22 out. 2019.

BRASIL. Tribunal Superior Eleitoral. Diálogos para a construção da Sistematização das Normas Eleitorais. 2019. Disponível em: http://www.tse.jus.br/legislacao/sne/arquivos/gt-iii-propaganda-estudos-preliminares. Acesso: em: 12 ago. 2019.

BRASIL. Tribunal Superior Eleitoral. Legislação. 2019a. Disponível em: http://www.tse.jus.br/legislacao/compilada/prt/2019/portaria-no-115-de-13-de-fevereiro-de-2019 Acesso: em: 12 ago. 2019.

BRASIL. Tribunal Superior Eleitoral. Portal da Comunicação TSE. 2019b. Disponível em: http://www.tse.jus.br/imprensa/noticias-tse/2019/Setembro/enfrentamento-a-desinformacao-tse-veicula-serie-de-cinco-videos-sobre-o-tema?fbclid=IwAR2JRU6Yu0u-gRV1-wACl3K4Eic8l-jtllgIjG64kpTVwW1so6Xi8NSx2yY. Acesso em: 21 out. 2019.

BRASIL. Tribunal Superior Eleitoral. Portal da Comunicação TSE. 2019c. Disponível em: http://www.tse.jus.br/imprensa/noticias-tse/2019/Outubro/google-facebook-twitter-e-whatsapp-aderem-ao-programa-de-enfrentamento-a-desinformacao-do-tse. Acesso em: 30 out. 2019.BRASIL. Tribunal Superior Eleitoral. Portal da Comunicação TSE. 2019d. Disponível em: http://www.tse.jus.br/imprensa/noticias-tse/2019/Outubro/grupo-gestor-do-programa-de-enfrentamento-a-desinformacao-recebe-representante-do-twitter-para-alinhar-estrategias-conjuntas. Acesso em: 30 out. 2019.

BRASIL. Tribunal Superior Eleitoral. Portal da Comunicação TSE. 2019e. Disponível em: http://www.tse.jus.br/imprensa/noticias-tse/2019/Agosto/tse-lanca-programa-de-enfrentamento-a-desinformacao-com-foco-nas-eleicoes-2020. Acesso em: 30 out. 2019.

BRASIL. Tribunal Superior Eleitoral. Seminário Internacional sobre Fake News e Eleições. 2019f. Disponível em: http://www.tse.jus.br/hotsites/seminario-internacional-fake-news-eleicoes/. Acesso: em: 12 ago. 2019.

CADWALLADR, Carole. Revealed: 50 million Facebook profiles harvested for Cambridge Analytica in major data breach. The Guardian, 17 mar. 2018. Disponível em: https://www.theguardian.com/news/2018/mar/17/cambridge-analytica-facebook-influence-us-election Acesso em: 26 abr. 2019.

CADWALLADR, Carole. Facebook’s role in Brexit — and the threat to democracy. TED Ideas worth spreading, Abr, 2019. Disponível em: https://www.ted.com/talks/carole_cadwalladr_facebook_s_role_in_brexit_and_the_threat_to_democracy/transcript?language=en. Acesso em: 4 ago. 2019.

CALDAS, Camilo O. L.; CALDAS, Pedro N. L. Estado, democracia e tecnologia: conflitos políticos e vulnerabilidade no contexto do big-data, das fake news e das shitstorms. Perspectivas em Ciência da Informação, Belo Horizonte, v.24, n. 2, abr./jun. 2019. Disponível em: http://www.scielo.br/scielo.php?script=sci_arttext&pid=S1413-99362019000200196&tlng=pt. Acesso em: 20 out. 2019.

Congresso derruba veto e mantém pena para “fake news” eleitoral. Exame, ago. 2019. Disponível em: https://exame.abril.com.br/brasil/congresso-mantem-veto-a-prestacao-de-assistencia-odontologica-obrigatoria/. Acesso em: 22 out. 2019.

FERRARA, Emilio, et al. The Rise of Social Bots. Communications of the ACM, New York, v. 59 n. 7, jul. 2016. Disponível em: https://cacm.acm.org/magazines/2016/7/204021-the-rise-of-social-bots/fulltext#R24. Acesso em: 20 out. 2019.

GRASSI, Amaro. Et al. Robôs, redes sociais e política no Brasil: estudo sobre interferências ilegítimas no debate público na web, riscos à democracia e processo eleitoral de 2018. FGV DAPP, Rio de Janeiro, 20 ago 2017. Disponível em: http://hdl.handle.net/10438/18695. Acesso em: 12 jan. 2019.

HALE, Scott et al. How digital design shapes political participation: A natural experiment with social information. PLoS One, 27 abr. 2018. DOI: 10.1371/journal.pone.0196068. Disponível em: https://journals.plos.org/plosone/article?id=10.1371/journal.pone.0196068. Acesso em: 8 jan. 2019.

HOUSE OF COMMONS (Reino Unido). Disinformation and ‘fake news’: Final Report. Londres: House of Commons, 2019, 111 p. Disponível em: https://publications.parliament.uk/pa/cm201719/cmselect/cmcumeds/1791/1791.pdf. Acesso em: 19 fev. 2019.

MONTEIRO, Cláudia S.; MEZZAROBA, Orides. Manual de metodologia da pesquisa no Direito. 7. ed. São Paulo: Saraiva, 2017. ISBN: 9788547218720.

MUNGER, Kevin. Influence? In this economy? Tech-savvy young people take internet literacy for granted, and that can cause all kinds of problems. The Outline, 17 fev. 2018. Disponível em: https://theoutline.com/post/3443/devumi-twitter-bots-savviness-gap. Acesso em: 14 jan. 2019.

NETTO, Paulo R. WhatsApp confirma ação de empresas em disparo de mensagens durante eleições. O Estado de São Paulo, 8 out. 2019. Disponível em: https://politica.estadao.com.br/blogs/estadao-verifica/whatsapp-confirma-acao-de-empresas-em-disparo-de-mensagens-durante-eleicoes/. Acesso em: 2 nov. 2019.

PRIVACIDADE Hackeada. Direção: Karim Amer, Jehane Noujaim. Produção: Karim Amer, Pedro Kos, Geralyn Dreyfous, Judy Korin. Intérpretes: Brittany Kaiser, Carole Cadwalladr, David Carrol e outros. Roteiro: Karim Amer, Pedro Kos, Erin Barnett. Estados Unidos: Netflix, 2019 (113 min). Produzido por Netflix. Disponível em: https://www.netflix.com Acesso em: 4 ago. 2019.

PUPO, Amanda; PIRES, Breno. TSE abre ação sobre compra de mensagens anti-PT no WhatsApp. O Estado de São Paulo, 19 out. 2019. Disponível em: https://politica.estadao.com.br/noticias/eleicoes,tse-abre-acao-sobre-compra-de-mensagens-anti-pt-no-whatsapp,70002555142. Acesso em: 2 nov. 2019.

RAMAYANA, Marcos. Direito Eleitoral. 16. Edição. Niterói: Impetus, 2018. ISBN: 9788576269601.

ROSENBERG, Matthew; CONFESSORE, Nicholas; CADWALLADR, Carole. How Trump consultants exploited the Facebook data of millions. The New York Times, 17 mar. 2018. Disponível em: https://www.nytimes.com/2018/03/17/us/politics/cambridge-analytica-trump-campaign.html. Acesso em: 20 dez. 2018.

RUEDIGER, Marco A. O estado da desinformação: Eleições 2018. FGV DAPP, Rio de Janeiro, 18 set 2018. Disponível em http://hdl.handle.net/10438/25743. Acesso em: 3 jan. 2019.

RUEDIGER, Marco A.; GRASSI, Amaro. Redes sociais nas eleições 2018. FGV DAPP, Rio de Janeiro, 5 out 2018. Disponível em http://hdl.handle.net/10438/25737. Acesso em: 3 jan. 2019.

RUEDIGER, Marco A.; GRASSI, Amaro. Desinformação na era digital: amplificações e panorama das Eleições 2018. FGV DAPP, Rio de Janeiro, 30 nov 2018a. Disponível em http://hdl.handle.net/10438/25742. Acesso em: 3 jan. 2019.

RUEDIGER, Marco A.; GRASSI, Amaro. Bots e o Direito Eleitoral Brasileiro nas Eleições de 2018. FGV DAPP, Rio de Janeiro, 15 jan 2019. Disponível em http://hdl.handle.net/10438/26227. Acesso em 17 fev. 2019.

SHALDERS, André. Eleições 2018 estreia na TV com força em cheque. BBC News Brasil, 18 ago. 2018. Disponível em: https://www.bbc.com/portuguese/brasil-45364384 Acesso em: 18 ago. 2019.

SILVA, Carla A. et al. Uso de redes sociais e softwares para disseminação e combate de fake news nas eleições. In: CONGRESSO NACIONAL UNIVERSIDADE, EAD E SOFTWARE LIVRE, 2018, Belo Horizonte. Anais […]. Belo Horizonte: UFMG, 2018. Disponível em: http://www.periodicos.letras.ufmg.br/index.php/ueadsl/article/view/14413. Acesso em: 4 jan. 2019.

STELLA, Massimo; FERRARA, Emilio; DOMENICO, Manlio. Bots increase exposure to negative and inflammatory content in online social systems. Proceedings of the National Academy of Sciences of the United States of America, v. 115, p. 12435–12440, dez. 2018. DOI: 10.1073/pnas.1803470115. Disponível em: https://www.pnas.org/content/115/49/12435. Acesso em: 8 jan. 2019.

SUNSTEIN, Robert C. #Republic: Divided democracy in the age of social media. Princeton University Press, 2017. ISBN: 9780691175515.

TÖRNBERG, Petter. Echo chambers and viral misinformation: Modeling fake news as complex contagion. PLoS One, 20 set. 2018. DOI: 10.1371/journal.pone.0203958. Disponível em: https://journals.plos.org/plosone/article?id=10.1371/journal.pone.0203958. Acesso em: 13 jan. 2019.

TWITTER vai banir todo tipo de propaganda política, o que pressiona Facebook. O Globo, 30 out. 2019. Disponível em: https://oglobo.globo.com/mundo/twitter-vai-banir-todo-tipo-de-propaganda-politica-que-pressiona-facebook-24051553. Acesso em: 31 out. 2019.

VELLOSO, Carlos M. D. S.; AGRA, Walber D. M. Elementos de direito eleitoral. 5. ed. São Paulo: Saraiva, 2016. ISBN: 9788547208073.

APPENDIX – RIFERIMENTI FOOTNOTE

3. Un bot sociale è un algoritmo informatico che produce automaticamente contenuti e interagisce con gli esseri umani sui social media, cercando di imitare e possibilmente alterare il loro comportamento. (FERRARA, 2016). 4. Le camere eco o Echo Chambers sono ambienti in cui una persona trova solo credenze o opinioni che coincidono con le proprie, in modo che le loro opinioni esistenti siano rafforzate e non vengano prese in considerazione idee alternative (CAMBRIDGE, 2019) 5. Questo articolo non esiste nella versione brasiliana della pagina Facebook. 6. L’uscita del Regno Unito dall’Unione europea 7. Centro per la ricerca sociale applicata che ha la missione di promuovere l’innovazione per le politiche pubbliche. 8. Disponibile in: http://hdl.handle.net/10438/18695. Accesso effettuato il: 12 gen. 2019.

9. Creato nel dicembre 2017, per discutere il potenziale impatto delle notizie false e l’uso dei robot durante le elezioni brasiliane del 2018. (RUEDIGER; GRASSI, 2018, p.4)