ARTIGO ORIGINAL

BONATO, Isabelle Emy [1], GRANADO, Karina [2]

BONATO, Isabelle Emy. GRANADO, Karina. A responsabilidade da justiça eleitoral frente às propagandas eleitorais em plataformas digitais. Revista Científica Multidisciplinar Núcleo do Conhecimento. Ano 05, Ed. 03, Vol. 02, pp. 85-120. Março de 2020. ISSN: 2448-0959, Link de acesso:

RESUMO

O estudo questiona a confiabilidade das plataformas digitais de mídias sociais nas propagandas eleitorais e a responsabilidade da Justiça Eleitoral neste contexto. Analisa sobre a necessidade da Justiça Eleitoral em regulamentar o uso dessas plataformas e indaga se o uso das redes sociais como plataforma de propaganda eleitoral fere a Democracia. É notório nos veículos da mídia em todo o mundo que existem meios digitais de se obter informações pessoais e de se direcionar informações, verdadeiras ou não, a públicos específicos. Desta forma, o uso de mídia social como plataforma de propaganda eleitoral pode não ser seguro, podendo ser facilmente manipulado e, portanto, o presente estudo analisa se o Tribunal Superior Eleitoral deveria regulamentar o uso da mesma observando o Princípio da Lisura das Eleições que garante a livre formação da vontade do eleitor e a igualdade entre os candidatos, zelando pela democracia brasileira.

Palavras-chave: Democracia, mídia social, eleições.

1. INTRODUÇÃO

Recentemente, muito tem-se falado sobre a importância da democracia. Uns falam em “golpes” e vão às ruas clamando pela defesa da democracia, outros acreditam que não há o que temer, visto que com as eleições Presidenciais de 2018, o processo democrático manteve-se intacto. No entanto, uma nova questão foi levantada: a confiabilidade do uso de plataformas digitais nas propagandas Eleitorais que foi autorizado pelo TSE – Tribunal Superior Eleitoral para essas eleições. Em se tratando de um tema tão importante como a democracia, é importante conhecer o funcionamento das redes sociais e os métodos existentes de manipulação de dados e direcionamento de informações para assim, refletir sobre a liberdade do voto e a defesa e proteção da democracia.

Em março de 2018, o jornal The New York Times publicou uns dos escândalos do Facebook. Juntamente com o The Observer of London, o jornal examinou uma empresa de consultoria Política chamada Cambrigde Analytica e revelou uma nova arma em potencial usada pela empresa de consultoria. Segundo o jornal americano, essa arma é um software capaz de mapear traços de personalidade baseado no que as pessoas curtem no Facebook. A Cambridge teve acesso a dados pessoais de milhões de usuários desta rede, podendo prever, dentre outras características pessoais, a capacidade receptiva de cada um, a visão política, QI, satisfação pessoal, se a pessoa é desconfiada ou não, se é aberta ou não etc. Essa empresa foi responsável pela campanha eleitoral de Donald Trump em 2016 e levantou-se a questão da segurança de dados pessoais nas redes sociais (ROSENBERG; CONFESSORE; CADWALLADR, 2018). Em uma outra reportagem, fala-se sobre a existência de bots[3] no mundo cibernético, capazes de direcionar informações específicas a grupos específicos, influenciando uma Eleição (PATTERSON, 2018). Com essas informações é crescente a preocupação com relação à lisura nas Eleições em todo o mundo. No Brasil, por exemplo, houve o escândalo do uso de um dispositivo chamado “serviço de impulsionamento de conteúdo” que teria sido usado pelo então candidato à Presidência Jair Bolsonaro na disseminação de Fake News (PERON; MARTINS, 2018), outro assunto que será explorado neste trabalho.

Um princípio inerente ao Estado Democrático de Direito, é o Princípio da Lisura Eleitoral, definido por Ramayana (2015, p.31) como: “A garantia da lisura das eleições nutre especial sentido de proteção aos direitos fundamentais da cidadania (cidadão-eleitor), bem como encontra alicerce jurídico-constitucional nos arts. 1º, inciso II e 14 §9º da Lei Fundamental.” Este princípio constitucional visa garantir a participação do povo na escolha de seus representantes de forma livre e verdadeira. A Justiça Eleitoral é responsável por possibilitar a expressão da vontade dos eleitores, operacionalizando todos os procedimentos eleitorais para que se desenvolvam em harmonia e transparência, sem que estorvos possam desviar a soberania popular (VELLOSO; AGRA, 2016). Dessa forma, é de extrema importância que sejam explorados os meios de manipulação de dados existentes nas plataformas digitais atuais para que se possa refletir sobre a responsabilidade da Justiça Eleitoral no uso de redes sociais para propaganda política. Para tanto, serão estudados artigos recentes que discutem diversas formas de manipulação de dados e seus resultados em eleições e como outros países estão discutindo este assunto com o objetivo de refletir sobre a confiabilidade das plataformas digitais para o uso em propagandas políticas.

O trabalho partirá da exposição de artigos científicos e materiais como livros e reportagens, que demostram a manipulação de dados pessoais no mundo virtual, com o intuito de mostrar a existência de mecanismos capazes de direcionar informações específicas para um público alvo com o potencial de influenciar o resultado em Eleições, ferindo assim, a garantia constitucional fundamental do direito à livre escolha do voto. A partir de premissas básicas como a Democracia, os princípios constitucionais do Direito Eleitoral e as funções da Justiça Eleitoral brasileira, será analisada a nova redação dada ao art. 57-C da Lei nº 9.504/1997 (Redação dada pela Lei nº 13.488, de 2017) que permitiu o uso de plataformas digitais em propagandas eleitorais nas últimas eleições, possibilitando a reflexão sobre a Responsabilidade da Justiça Eleitoral no uso de plataformas digitais e as consequências para as campanhas eleitorais e para a democracia brasileira.

2. PLATAFORMAS DIGITAIS E SEUS PERIGOS

As plataformas digitais surgiram com a promessa de aproximar as pessoas e de promover formas mais “igualitárias de se encontrar e discutir [qualquer assunto]”. A mídia on-line mudou profundamente a maneira como as pessoas se comunicam, debatem e formam opiniões. As plataformas digitais são organizadas através de processos complexos em cascata. Assim, as notícias se espalham como “fogo selvagem nas redes sociais” através de conexões diretas entre os leitores e os produtores de notícias, tornando cada vez mais difícil fazer a distinção entre eles. No entanto, esse fenômeno mudou a forma como a sociedade compõe suas narrativas sobre o mundo comum (TÖRNBERG, 2018, p.1).

Peter Törnberg, do departamento de sociologia da Universidade de Amsterdam, explica:

Apesar do otimismo inicial sobre este local de encontro ostensivamente descentralizado e democrático, o mundo on-line parece cada vez menos uma mesa comum que nos reúne para discutir e identificar livremente os problemas da sociedade em um novo tipo de esfera pública. Em vez disso, parece trazer o pior dos instintos humanos: nos agrupamos em tribos que nos confortam com reafirmação, e nos protegem de desacordos; são echo chambers[4] que reforçam a perspectiva existente e fomentam vieses de confirmação. A tecnologia que foi feita para ajudar a tecer mais os laços entre os seres humanos, parece ter levado a um desgaste de nosso tecido social, à medida que somos divididos em grupos sociais com visões de mundo separadas. (TÖRNBERG, 2018, p.1).

A internet surgiu como fonte de conhecimento de fácil acesso, mas ao longo do tempo, a qualidade e a credibilidade das informações estão reduzindo drasticamente. Cada vez mais tem-se “um clima de informação caracterizado por narrativas preconceituosas, notícias falsas, teorias conspiratórias, desconfiança e paranoia” (TÖRNBERG, 2018, p.2). O mundo digital tornou-se um solo fértil para o crescimento da desinformação. Estudos mostram que notícias falsas se difundem mais rápido e mais longe que notícias verdadeiras em redes sociais. De acordo com Törnberg, esse fenômeno pode afetar aspectos relevantes da vida um cidadão em todas as áreas. Deste modo, essa desinformação pode comprometer, até mesmo, o resultado de uma eleição, sendo um risco não só para a sociedade humana, como afirma o autor, mas uma ameaça à democracia de um país.

Aparentemente, existe uma ligação entre as echo chambers e a disseminação de desinformação já que estes grupos homogêneos de usuários, com preferência por autoconfirmação, parecem fornecer estufas para que a muda de rumores e desinformação se espalhe. Com um espaço digital polarizado, os usuários tendem a promover suas narrativas favoritas, formando grupos polarizados e resistindo às informações que não se conformam com suas crenças (TÖRNBERG, 2018, p.2). Formando assim, exércitos de apoiadores de determinados produtos ou marcas e até mesmo exércitos de presidentes (ou candidatos a) que são rapidamente mobilizados. Isso pode significar que as echo chambers tornam as notícias falsas mais virais, uma vez que informações que ressoam com grupos de usuários tendenciosos tem uma probabilidade maior de espalhar-se através de uma rede (TÖRNBERG, 2018, p.3).

O estudo de Törnberg sugere em sua conclusão, que o simples agrupamento de usuários com a mesma visão de mundo é suficiente para afetar a viralidade da informação. Isso sugere que não são apenas os algoritmos que filtram as notícias, afetando-as, mas o fato de a mídia social permitir essa dinâmica de agrupamentos, acaba por alterar também a dinâmica da viralidade. Isso faz parte da grande questão de como a mídia social tem afetado os processos políticos e sociais (TÖRNBERG, 2018, p.16-17).

2.1 INTELIGÊNCIA ARTIFICIAL NAS PLATAFORMAS DIGITAIS

Existem muitas formas de uso de inteligência artificial, dentre elas duas são mais apropriadas a este trabalho, que busca analisar a confiabilidade das plataformas: os softwares que identificam o perfil do usuário e os bots que interagem no mundo virtual.

2.1.1 IDENTIFICANDO O PERFIL DO USUÁRIO

Na era do algoritmo, o próprio Facebook e o Google fazem seleções pelas pessoas, seja relacionada a escolha de produtos, viagens ou candidatos à Presidência. Os algoritmos sabem muito sobre seus usuários e, com o surgimento da inteligência artificial, eles tendem a melhorar imensamente. Eles aprendem e aprenderão muito sobre cada um e serão, se já não o forem, capazes de conhecer o que cada pessoa quer ou o que desejará, melhor do que elas próprias. Saberão até mesmo suas emoções e serão capazes de imitar emoções humanas por conta própria (SUNSTEIN, 2017, p. 13). Atualmente, um algoritmo que aprende um pouco sobre uma pessoa pode descobrir e dizer o que pessoas como ela tendem a gostar. Robert Sunstein, professor da Faculdade de Direito na Universidade de Harvard explica:

Na verdade, isso está acontecendo todos os dias. Se o algoritmo sabe que você gosta de certos tipos de música, ele pode saber, com alta probabilidade, de quais tipos de filmes e livros você gosta e quais candidatos políticos vão agradar a você. E, se souber quais sites você visita, pode saber quais produtos você provavelmente comprará e o que pensa sobre a mudança climática e a imigração. Um pequeno exemplo: o Facebook provavelmente conhece suas convicções políticas e pode informar outros, incluindo candidatos a cargos públicos. Ele categoriza seus usuários como muito conservadores, conservadores, moderados, liberais e muito liberais (SUNSTEIN, 2017, p. 13).

Sunstein explica que o Facebook categoriza seus usuários politicamente, vendo as páginas que eles gostam e afirma que é fácil criar um perfil político quando o usuário gosta de certas opiniões, mas não de outras. Se o usuário mencionar alguns candidatos de maneira favorável ou desfavorável, a categorização é ainda mais fácil. E o mais assustador é que o Facebook não esconde o que está fazendo. “Na página Preferências de anúncios no Facebook, você pode procurar em ‘Interesses’, depois em ‘Mais’, em ‘Estilo de vida e cultura e, finalmente, em ‘Política dos EUA[5]’, e a categorização aparecerá” (SUNSTEIN, 2017, p. 13). O aprendizado de máquina (machine learning) pode ser usado para produzir distinções refinadas, afirma o professor, como por exemplo, a opinião do usuário sobre questões com a segurança pública, o meio ambiente, imigração e igualdade. E acrescenta: “Para dizer o mínimo, essa informação pode ser útil para os outros – gerentes de campanha, anunciantes, angariadores de fundos e mentirosos, incluindo extremistas políticos” (SUNSTEIN, 2017, p. 13).

Além disso, pode-se considerar as hashtags: #elenão, #partiu, #tbt, #lulalivre, #foratemer, #elesim #EuApoioaLavaJato. É possível encontrar um grande número de itens que interessem o usuário ou que se encaixem (e até mesmo fortaleça) em suas convicções. “A ideia da hashtag é permitir que as pessoas encontrem tuites e informações que lhes interessem. É um mecanismo de classificação simples e rápido” (SUNSTEIN, 2017, p. 14). Existe uma atuação grande dos chamados ‘empreendedores da hashtag’; que criam ou disseminam hashtags como uma forma de promover ideias, perspectivas, produtos, pessoas ou supostos fatos. Isso aumenta a conveniência, o aprendizado e o entretenimento. Afinal, quase ninguém quer ver anúncios de produtos que não lhes interessam. No entanto, a arquitetura desse controle tem uma séria desvantagem, levantando questões fundamentais sobre liberdade e democracia (SUNSTEIN, 2017, p. 14). Dessa foram, o professor questiona quais seriam as pré-condições sociais para a liberdade individual e para que um sistema democrático funcione bem:

O mero acaso poderia ser importante, mesmo que os usuários não o queiram? Um universo de comunicações perfeitamente controlado – um feed personalizado – poderia ser um tipo próprio de distopia? Como as mídias sociais, a explosão de opções de comunicação, o aprendizado de máquina e a inteligência artificial podem alterar a capacidade dos cidadãos de se governarem? (SUNSTEIN, 2017, p. 14,).

Sunstein conclui que estas questões estão intimamente relacionadas e defende uma arquitetura digital de serendipidade. O acaso impediria a inteligência artificial de usar dados pessoais dos usuários para melhorar a experiência on-line dos mesmos. Não obtendo essas informações voltadas para o marketing, não haverá dados pessoais a serem usados para manipular interesses políticos. Essa medida seria “em prol de vidas individuais, comportamentos de grupo e a própria democracia” (SUNSTEIN, 2017, p. 16). Na medida em que os provedores são capazes de criar algo como experiências personalizadas ou comunidades fechadas para cada usuário, ou tópicos favoritos e grupos preferidos, é importante que haja cautela. “O autoisolamento e a personalização são soluções para alguns problemas genuínos, mas também disseminam falsidades e promovem a polarização e a fragmentação” (SUNSTEIN, 2017, p. 17). Esse é um esclarecimento importante quando se analisa a natureza da liberdade, tanto pessoal como política, e o tipo de comunicação digital que melhor atende uma ordem democrática.

2.1.2 INTERAGINDO COM O USUÁRIO

Em um outro estudo, realizado no Centro para Informação e Tecnologia da Comunicação da Fundação Bruno Kessler na Itália, foi analisado, “em um nível microscópico, como as interações sociais podem levar a fenômenos globais emergentes, como a segregação social, a disseminação de informações e o comportamento” (STELLA; FERRARA; DOMENICO, 2018, p.1). Os autores afirmam que os sistemas digitais não são povoados apenas por seres humanos, mas também por bots, que são agentes controlados por software com fins específicos que vão desde o envio de mensagens automatizadas a até mesmo assumir comportamentos sociais ou antissociais específicos. Assim, os bots podem afetar a estrutura e a função de um sistema social (STELLA; FERRARA; DOMENICO, 2018, p.1).

Mas como os bots conseguem interagir com os usuários? Grassi Amaro, professor doutor da FGV explica:

Robôs são usados nas redes sociais para propagar informações falsas, maliciosas, ou gerar um debate artificial. Para isso, precisam ter o maior número possível de seguidores (GRASSI et al., 2017, p.12) […]. Dessa maneira, os robôs adicionam um grande número de pessoas ao mesmo tempo e seguem páginas reais de pessoas famosas, além de seguir e serem seguidos por um grande número de robôs, de forma que acabam criando comunidades mistas – que incluem perfis reais e falsos (FERRARA et al., 2016 apud GRASSI et al., 2017, p.12).

Alguns bots possuem mecanismos para imitar o comportamento humano, para serem reconhecidos como tal, tanto pelos usuários como por outros bots. Outros tem apenas o objetivo de desviar a atenção para determinado tema (GRASSI et al., 2017, p.12). Com o aprendizado de máquinas (machine learning), o sistema consegue identificar humanos e robôs através do comportamento do perfil, como por exemplo, levando em conta “que usuários reais passam mais tempo na rede trocando mensagens e visitando o conteúdo de outros usuários, como fotos e vídeos, enquanto contas robôs passam o tempo pesquisando perfis e enviando solicitações de amizade” (GRASSI et al., 2017, p.14).

Conhecendo o perfil de cada usuário e sabendo interagir com os mesmos, os bots podem ser usados para influenciar pensamentos, ações e até iniciar movimentos sociais e políticos. Assim é importante entender o papel da inteligência artificial nos assuntos políticos, e consequentemente, no processo democrático eleitoral.

2.2 FAKE NEWS

Fake News já se tornou um termo conhecido no Brasil, no entanto, é importante destacar sua definição e explicação. De acordo com Ruediger e Grassi:

Fake News, ou notícias falsas em português, tornou-se expressão comumente adotada para identificar a divulgação de informações falsas, sobretudo na internet. Entretanto, as evoluções deste fenômeno na sociedade em rede têm evidenciado que o termo não é capaz de explicar a complexidade de suas práticas, tornando-se, inúmeras vezes, instrumento de um discurso político que se beneficia de tal simplificação. (RUEDIGER; GRASSI, 2018a, p.8)

No Brasil, o estudo da FGV DAPP mostra que os bots “buscam criar discussões forjadas e interferir em debates” criando desinformações que podem interferir em processos eleitorais e democráticos. O estudo mostra que o surgimento de contas automatizadas permitiu estratégias de manipulação por meio de boatos e difamação. Além dos robôs, também foram identificados ciborgues (as contas parcialmente automatizadas) (RUEDIGER; GRASSI, 2018, p.12).

Estudos sobre a influência das Fake News na eleição dos EUA apontaram que uma a cada quatro pessoas foi exposta a boatos falsos. No entanto, essas notícias representaram apenas 2,6% do universo de notícias e 60% das visitas a essas reportagens foram veiculadas ao eleitorado com viés mais conservador, que compunha 10% do eleitorado. Mesmo que as notícias falsas não tenham um número significativo dentro do corpus das notícias sobre as eleições, elas tiveram capacidade de influenciar o sistema político e acentuar polarizações políticas. O uso de notícias falsas fabricadas é fenômeno antigo, mas as redes sociais e os avanços tecnológicos levaram a desinformação a um patamar nunca visto antes (DELMAZO; VALENTE, 2018 apud RUEDIGER; GRASSI, 2018, p.13).

As fake news possuem um poder devastador, e já chamou a atenção da Justiça Eleitoral, que prefere usar o termo “Desinformação”. Todavia, as notícias falsas, principalmente em períodos eleitorais, sempre ocorreram. O perigo maior está nos softwares e programas que identificam os alvos ideais para receber essa desinformação. Assim como os bots, que auxiliam na formação das echo chambers possibilitando uma maior disseminação das fake news.

3. A INTELIGÊNCIA ARTIFICIAL E SEU PAPEL INFLUENCIADOR NAS ELEIÇÕES

De acordo com um experimento realizado na Universidade de Oxford, em conjunto com o Instituto Alan Turing e o Departamento de Economia Política da Universidade Kings em Londres, em 2017, o comportamento político acontece cada vez mais em plataformas digitais, onde as pessoas são apresentadas com uma variedade de informações sociais. (HALE et al, 2017, p.1).

Este experimento buscou entender como a “informação social” molda a participação política dos eleitores. Explica que, a informação social é aquela sobre o que as pessoas estão fazendo, ou já fizeram, tanto no mundo digital como no mundo real e tem uma longa história em Psicologia Social. No entanto, é difícil observar o que um grande número de pessoas está fazendo off-line. Em contrapartida, no mundo digital, “muitas plataformas on-line indicam claramente quantas pessoas já curtiram, seguiram, retuitaram, assinaram petições, ou de outra forma realizaram várias ações”. (HALE et al, 2017, p.2)

O estudo conclui que a estrutura das plataformas digitais pode ter efeitos significativos nos comportamentos políticos dos usuários. Da mesma forma, o estudo sugere que informações sociais podem “exacerbar a turbulência na mobilização política” (HALE et al, 2017, p.16).

Já em 2012 foi publicado um outro estudo feito pelo departamento de Ciências Políticas da Universidade da Califórnia (EUA). O experimento foi realizado de forma controlada através de mensagens de mobilização política entregue a 61 milhões de usuários do Facebook durante as eleições do Congresso dos EUA em 2010. (BOND, 2012, p.1):

“Os resultados mostram que as mensagens influenciaram diretamente a auto expressão política, a busca de informações e o comportamento de voto no mundo real de milhões de pessoas. Além disso, as mensagens influenciaram não apenas os usuários que as receberam, mas também os amigos dos usuários e os amigos dos amigos. O efeito da transmissão social na votação no mundo real foi maior do que o efeito direto das próprias mensagens, e quase toda a transmissão ocorreu entre “amigos íntimos” que tinham mais probabilidade de ter um relacionamento face a face. Esses resultados sugerem que laços fortes são fundamentais para disseminar o comportamento on-line e do mundo real em redes sociais humanas”. (BOND, 2012, p.1).

Os resultados deste estudo têm muitas implicações. A mobilização política na rede funciona provocando a autoexpressão política, e também induzindo a coleta de informações sociais. Também foi mostrado que a mobilização social em redes on-line é significativamente mais efetiva que a mobilização informacional. O fato de as informações vistas on-line partirem de rostos familiares pode melhorar drasticamente a eficácia de uma mensagem de mobilização. Além dos efeitos diretos da mobilização on-line, foi mostrada a importância da influência social para efetivar a mudança de comportamento dos usuários (BOND, 2012, p.5).

Dessa maneira, ao tentar influenciar o comportamento de um usuário fora do mundo digital é preciso atentar-se “não apenas ao efeito que uma mensagem terá sobre aqueles que a recebem, mas também à probabilidade de que a mensagem e o comportamento que ela estimula se espalhem de pessoa para pessoa através da rede social”. (BOND, 2012, p.5). Esse experimento sugere que as mensagens on-line podem influenciar uma variedade de comportamentos off-line, e seus autores já se preocupavam, em 2012, em compreender o papel das mídias sociais na sociedade. Lembrando que:

As sociedades são sistemas complexos, que tendem a polarizar-se em subgrupos de indivíduos com perspectivas dramaticamente opostas. Esse fenômeno é refletido – e muitas vezes amplificado – nas redes sociais on-line, onde, no entanto, os seres humanos não são mais os únicos participantes e coexistem com os bots sociais – ou seja, as contas controladas por softwares (STELLA; FERRARA; DOMENICO, 2018, p.1,).

Os dados consolidavam informações obtidas por quase 4 milhões de mensagens no Twitter geradas por quase 1 milhão de usuários. Nessa análise, foram identificados os dois grupos polarizados de Independentes e Constitucionalistas e quantificados os papéis estruturais e emocionais jogados por bots sociais. Foi mostrado que os bots atuam em áreas do sistema social para atacar seres humanos influentes de ambos os grupos. Neste referendo, os independentes foram bombardeados com conteúdo violentos, aumentando sua exposição às narrativas negativas e inflamatórias, exacerbando os conflitos sociais on-line. (SUNSTEIN, 2017, p. 7; STELLA; FERRARA; DOMENICO, 2018, p.1). Essas descobertas enfatizam a importância de desenvolver medidas para desmascarar essas formas de manipulação social automatizada, já que as mídias sociais podem afetar profundamente o comportamento de voto de milhões de pessoas:

Ao interferir em debates em desenvolvimento nas redes sociais, robôs estão atingindo diretamente os processos políticos e democráticos através da influência da opinião pública. Sua ação pode, por exemplo, produzir uma opinião artificial, ou dimensão irreal de determinada opinião ou figura pública, ao compartilhar versões de determinado tema, que se espalham na rede como se houvesse, dentre a parcela da sociedade ali representada, uma opinião muito forte sobre determinado assunto (Davis et al., 2016 apud GRASSI et al., 2017, p.14).

É possível que o leitor pense que sua opinião sobre determinado candidato não mudará por influência de mensagens produzidas por bots. No entanto, o alvo desse hacking social são os eleitores indecisos. Conforme explica Grassi et al., o compartilhamento coordenado de certa opinião, dá a ela “um volume irreal […] influenciando os usuários indecisos sobre o tema e fortalecendo os usuários mais radicais no debate orgânico, dada a localização mais frequente dos robôs nos polos do debate político”. (2017, p.14)

3.1 CONSEQUÊNCIAS PARA AS CAMPANHAS ELEITORAIS

Fake News, bots, e echo chambers podem mudar o rumo de uma eleição, como já foi exaustivamente discutido e mostrado no capítulo anterior. A própria Cambridge Analytics utilizou a seguinte fala em uma apresentação de vendas de seus serviços: “Nós somos uma agência de mudança de comportamento. O santo graal das comunicações é quando você começa a alterar o comportamento [das pessoas]”. (PRIVACIDADE…, 2019)

Echo Chambers podem levar as pessoas a acreditar em falsidades, e pode ser difícil ou impossível corrigi-las. Uma ilustração, feita pelo professor Sunstein, é a crença de que o presidente Barack Obama não nasceu nos Estados Unidos. Como falsidades, esta não é a mais danosa, mas refletiu e contribuiu para uma política de suspeita, desconfiança e, às vezes, ódio.

Um outro exemplo, mais prejudicial, é o conjunto de falsidades que ajudou a produzir o voto em favor do “Brexit”[6] em 2016. Notícias falsas sobre a Turquia supostamente fazer parte da União Europeia e consequentemente abrir o Reino Unido para uma imigração em massa de turcos para o país, foram essenciais para o resultado do referendo. Na campanha presidencial de 2016 nos Estados Unidos, falsidades se espalharam rapidamente no Facebook e ainda estão por toda parte. (SUNSTEIN, 2017, p.20; PRIVACIDADE…, 2019). De acordo com Sunstein “até hoje, as mídias sociais não ajudaram a produzir uma guerra civil, mas provavelmente esse dia chegará. Eles já ajudaram a evitar um golpe na Turquia em 2016” (SUNSTEIN, 2017, p.20):

Há uma questão sobre a liberdade individual. Quando as pessoas têm múltiplas opções e a liberdade de escolher entre elas, elas têm liberdade de escolha, e isso é extremamente importante. A liberdade requer certas condições de fundo, permitindo que as pessoas expandam seus próprios horizontes e aprendam o que é verdadeiro. Implica não apenas satisfação de quaisquer preferências e valores que as pessoas tenham, mas também circunstâncias favoráveis à livre formação de preferências e valores. Mas se as pessoas estão classificando-se em comunidades de tipos afins, sua própria liberdade está em risco. Elas estão vivendo em uma prisão de sua própria criação. (SUNSTEIN, 2017, p.20).

Quando os eleitores indecisos não sabem o que é verdadeiro, suas escolhas podem ser comprometidas durante o processo eleitoral, o que afetaria diretamente a democracia e o direito de escolha de voto, podendo mudar, até mesmo, o resultado de uma eleição.

3.2 CONSEQUÊNCIAS NO BRASIL

O processo eleitoral ocorrido no ano de 2018 constitui um marco temporal para o entendimento do uso de plataformas digitais para a propaganda eleitoral bem como o combate à disseminação de desinformação.

3.2.1 INTERAÇÃO COM BOTS

A Diretoria de Análise de Políticas Públicas da FGV[7] (FGV-DAPP) fez alguns estudos de casos para analisar a presença de bots em situações políticas importantes no Brasil, como por exemplo: o debate da Rede Globo no dia 2 de outubro de 2014 com os presidenciáveis no primeiro turno das eleições; o debate da Rede Globo no dia 24 de outubro de 2014 com os presidenciáveis Dilma Rousseff e Aécio Neves, que disputavam o segundo turno das eleições; as manifestações pró-impeachment realizadas no dia 13 de março de 2016; o debate da Rede Globo com os candidatos a prefeito de São Paulo no dia 29 de setembro de 2016; a greve geral no dia 28 de abril de 2017 e a votação da Reforma Trabalhista no Senado, no dia 11 de julho de 2017 (GRASSI et al., 2017, p.16)

O professor da FGV explica como os dados são coletados:

As massas de dados coletadas pela FGV/DAPP são compostas por metadados — informações a respeito dos dados em si — e, por meio deles, exploramos as possibilidades de identificação de contas que tenham atuado automaticamente durante os períodos das análises. Assim, identificamos que o metadado nomeado generator se refere à plataforma que gera o conteúdo do tuite, o que é muito útil para a detecção de robôs. (GRASSI et al., 2017, p.16)

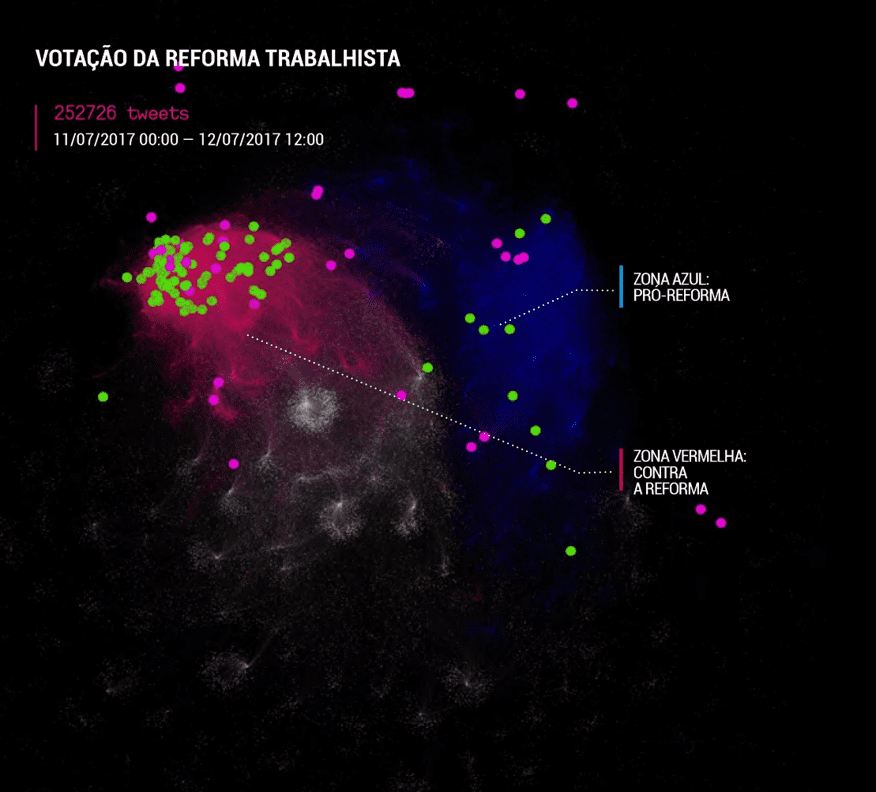

Com o intuito de ilustrar o funcionamento dos robôs em questão, a FGV elaborou gráfico (FIG. 1), com os resultados obtidos da análise feita durante a votação da Reforma Trabalhista no Senado. No gráfico, os pontos rosas representam contas que usaram geradores suspeitos (GRASSI et al., 2017, p.17) e os pontos verdes, contas que geraram pelo menos duas vezes dois tuites consecutivos em menos de um segundo (p.18). Neste caso, assim como nos outros, os robôs estão presentes nos dois extremos do debate, “estando nessa análise em maior número no polo contrário à reforma” (p. 23).

Figura 1: Votação da Reforma Trabalhista

Essas análises mostram que ações automatizadas de bots tem tido eficácia em conduzir o debate público, “cada vez mais presente nas redes, influenciando diretamente em momentos de inflexão e determinantes para o futuro”. (GRASSI et al., 2017, p.26).

Devido ao sucesso desse estudo, chamado Robôs, Redes Sociais e Política No Brasil, que detectou a presença de robôs no Twitter (GRASSI et al., 2017), a FGV DAPP foi convidada a participar do Conselho Consultivo sobre Internet e Eleições[9] do Tribunal Superior Eleitoral (TSE). (RUEDIGER; GRASSI, 2018, p.4). Em julho de 2018, foi lançada no Rio de Janeiro, a Sala de Democracia Digital[10] que tinha como objetivo “monitorar o debate público na web e identificar ações de desinformação, ameaças e intervenções ilegítimas no processo político, com a publicação de análises diárias e semanais”. A FGV DAPP, por meio de um hotsite[11] e um aplicativo #observa2018, divulgou as análises das redes. (RUEDIGER; GRASSI, 2018, p.5).

Dentre essas publicações, uma análise realizada durante a semana de 08 a 13 de agosto de 2018, a FGV DAPP “detectou, através de uma metodologia própria de identificação de robôs, a presença de 5.932 contas automatizadas no debate sobre as eleições e os presidenciáveis. Estes perfis geraram 19.826 publicações” (RUEDIGER, 2018, p.4) somente na rede social Twiter:

Em 2018, o Facebook divulgou ações para proteger as eleições no Brasil. Entre os compromissos estavam o combate à desinformação; maior transparência de anúncios na plataforma; a remoção de contas impostoras; e a retirada de santinhos digitais ‒ usados para enganar os eleitores ao colocar a foto de um candidato e o número do partido de outro. Essas e outras medidas foram tomadas para garantir a autenticidade do conteúdo publicado na plataforma (RUEDIGER; GRASSI, 2018a, p.16)

Mas isso não parece ser o suficiente. Análise da FGV-DAPP durante as campanhas eleitorais de 2018 mostra que “as interferências promovidas por robôs ocorreram muitas vezes de forma articulada e sincronizada, a partir de botnets (redes de robôs)” (RUEDIGER; GRASSI, 2018a, p.27). Segue resultados da análise realizada:

No período de pré-campanha, ao menos três redes de robôs foram responsáveis por publicar, em uma semana, 1.589 tuites. As mensagens buscavam, de forma geral, impulsionar e/ou desmobilizar candidaturas, principalmente nos núcleos de maior polarização: Jair Bolsonaro-Lula/Haddad.

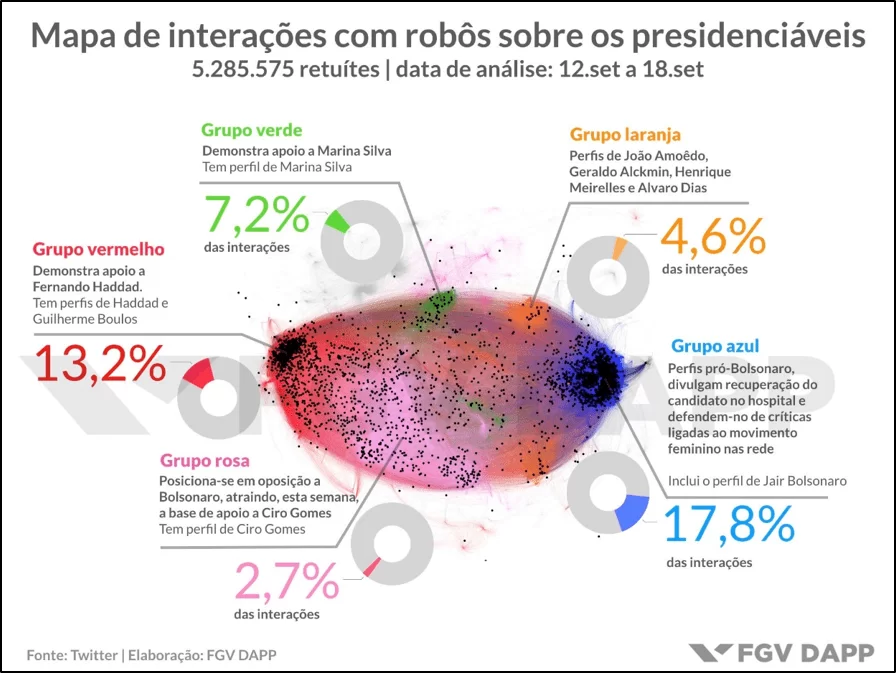

As bases pró-Bolsonaro e pró-Fernando Haddad também foram as que mais apresentaram interferência de robôs no período de campanha. De 12 a 18 de setembro, por exemplo, foram coletados 7.465.611 tuites e 5.285.575 retuites a respeito dos candidatos. Dentro desta base, a metodologia de detecção de robôs da FGV DAPP encontrou 3.198 contas automatizadas, que geraram 681.980 interações — 12,9% do total de retuites do grafo abaixo.

À direita, contas automatizadas responderam por 17,8% dos retuites do grupo favorável ao deputado federal do PSL; à esquerda, responderam por 13,2% das interações alinhadas à candidatura petista e, em menor escala, à candidatura de Guilherme Boulos, do PSol. (RUEDIGER; GRASSI, 2018a, p.28)

Figura 2: Interações com robôs nas Eleições 2018

O WhatsApp tem natureza de comunicação privada e não pôde ser analisado pela FGV-DAPP, no entanto, a mesma observou o seguinte:

Dadas as particularidades da plataforma, como a natureza de comunicação privada, de escopo social reduzido (familiares, amigos, colegas de trabalho), e a menor interação direta entre influenciadores e cidadãos comuns, viu-se diferente fenômeno de dispersão e viralização de conteúdos políticos do observado em outros cenários (nacional e internacionais) recentes, em que Facebook e Twitter estiveram em maior proeminência. As muitas redes sociais hoje populares entre brasileiros, usadas amplamente para debater as eleições e a conjuntura política, apresentam particularidades quanto ao processo de produção e interação com conteúdo. Todas as estratégias de propagação de informações, no entanto, são adaptadas às propriedades de cada plataforma, e com isso são múltiplas as formas de se manifestar a desinformação e o compartilhamento de informações falsas. Não somente a partir de links ou páginas que simulem a atividade jornalística, mas com intenso uso de vídeos, tutoriais, blogs, memes, textos apócrifos e publicações sensacionalistas; diversos subtipos de Fake News, portanto. (RUEDIGER; GRASSI, 2018a, p.29)

Embora, não tenha ficado provado que as interações com bots ou a propagação de notícias falsas tenham alterado o resultado da Eleição Presidencial de 2018 no Brasil, é preciso ficar atento a essa possibilidade. Como já foi demonstrado, a extinta empresa Cambridge Analítica obteve sucesso em eleger o candidato da agência de campanha que a contratou na Eleição Presidencial de 2016 nos EUA.

O atual Presidente da República foi eleito com um tempo ínfimo de propaganda eleitoral na TV, o que demostra que ele teria sido eleito por sua campanha nas plataformas sociais. Houve uma “mudança estrutural na forma como as campanhas bem-sucedidas foram organizadas — as redes sociais converteram-se em eixo principal de interlocução entre eleitores e eleitos” (RUEDIGER; GRASSI, 2018a, p.29).

Por outro lado, Ruediger e Grassi relatam consequências positivas nesse cenário digital. Dentre elas destacam-se:

1) a maior demanda por transparência nas relações institucionais da política; 2) a capacidade de rápida atuação e interferência no processo decisório de agentes do Estado e representantes eleitos, por intermédio do contato direto com estes pela internet;

3) e a ampliação do papel potencial que o cidadão pode desempenhar na condução das políticas e atos públicos que lhe interessam. Acelerados o feedback e a velocidade de transmissão, compartilhamento e produção de conteúdo, tornam-se igualmente imperativos aperfeiçoamentos na forma como a atividade jornalística e o debate político respondem a esses novos paradigmas (2018a, p.29-30).

3.2.2 DISSEMINAÇÃO DE FAKE NEWS

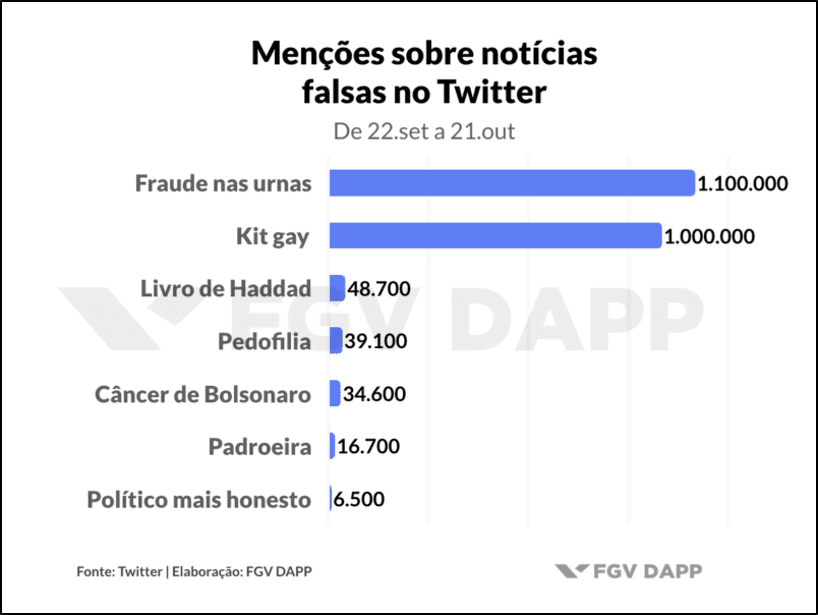

A Análise da FGV-DAPP realizada durante o período eleitoral de 2018 concluiu que não houve “uma distribuição automatizada e em massa de notícias falsas”. Afirma que, a desinformação esteve presente, “mas não foram os robôs os maiores responsáveis por sua disseminação”. Na semana do ataque a faca contra Bolsonaro, por exemplo, apenas 0,9% das interações foram automatizadas, oriundas de robôs (RUEDIGER; GRASSI, 2018a, p.29). Segundo a análise as notícias falsas que mais se destacaram foram as relacionadas na FIG. 3:

Figura 3: Fake News

3.3 CONSEQUÊNCIAS PARA A DEMOCRACIA

Em 2016, as eleições presidenciais nos EUA, despertaram atenção para as novas formas de se fazer política e campanhas políticas através das plataformas digitas. As eleições envolveram casos de fake news que tiveram repercussões mundiais, como “a suposta influência de hackers russos que por meio da agência Internet Research Agency teria gerado conteúdos falsos” e chegaram a milhões de eleitores através de Facebook e do Twitter. (RUEDIGER; GRASSI, 2018, p.12)

Antes disso houve o referendo no Reino Unido sobre a saída do mesmo da União Europeia. Em investigações realizadas no período de 2017 a início de 2019 ficou provada que a empresa Cambrigde Analytics em conjunto com outras agências influenciou no resultado dos votos, direcionando suas mensagens falsas para um determinado grupo de pessoas. A empresa conseguiu traçar o perfil dos eleitores através de dados de usuários do Facebook. O escândalo do Facebook foi noticiado no mundo todo no início de 2018 com a publicação de dados encontrados pela jornalista britânica Carole Cadwalladr (ROSENBERG; CONFESSORE; CADWALLADR, 2018) que desde então vem falando sobre essa nova ameaça à democracia. O Parlamento finalmente encerrou suas investigações e publicou um relatório no início de 2019. Vale destacar algumas conclusões sobre o uso dessas plataformas:

A lei eleitoral não é adequada ao propósito e precisa ser mudada para refletir as mudanças nas técnicas de campanha […]. É preciso haver: absoluta transparência das campanhas políticas on-line, incluindo marcas claras e persistentes em todos os anúncios e vídeos políticos pagos, indicando a fonte e o anunciante; uma categoria introduzida para gastos digitais em campanhas; e regras explícitas em torno do papel e das responsabilidades dos defensores designados.

Os itens de propaganda política devem estar publicamente acessíveis em um repositório pesquisável – quem está pagando pelos anúncios, quais organizações patrocinam o anúncio, quem está sendo segmentado pelos anúncios – para que os membros do público possam entender o comportamento de anunciantes individuais. Deve ser executado independentemente da indústria da publicidade e dos partidos políticos. (HOUSE…, 2019, p.24)

Nota-se que “sociedades democráticas ao redor do mundo vivenciaram nos últimos anos a emergência de um novo ator comunicacional a moldar, com sucesso ou não, a opinião pública em debates políticos, eleições, referendos e crises nacionais: a desinformação” (RUEDIGER; GRASSI, 2018a, p.4). A propagação de campanhas baseadas em fake news através das plataformas digitais em momentos essenciais da vida em sociedade, juntamente com a ação da inteligência artificial no controle de bots de contas automatizadas, “se tornou um instrumento primordial na estratégia de determinados grupos para atrair tráfego digital, engajar ou até mesmo influenciar debates, desmobilizar opositores e gerar falso apoio político” (RUEDIGER; GRASSI, 2018a, p.4) tornando-se uma grande ameaça às democracias do mundo todo.

Outro perigo que as plataformas digitais apresentam à democracia é a facilidade que existe para a formação de echo chambers, já discutida nesse trabalho. Os grupos isolados aumentam a polarização política e ódio, dando ainda mais combustível para o funcionamento dos bots e para a disseminação de notícias falsas.

Mas a questão unificadora em toda a extensão será os vários problemas para uma sociedade democrática que pode ser criada pelo poder de filtrar. As democracias podem ou não ser frágeis, mas a polarização pode ser um problema sério, e é aumentada se as pessoas residirem em diferentes universos de comunicação – como, de fato, às vezes parecem fazer nos Estados Unidos, no Reino Unido, na França, na Alemanha e em outros lugares. Não há dúvida de que o ambiente de comunicação moderno, incluindo as mídias sociais, contribui para a ascensão do partidarismo. (SUNSTEIN, 2018, p.36)

Qualquer grupo extremista, terrorista, ou qualquer partido político que tenha os meios de controlar as plataformas de mídias sociais teria então, o poder de governar após influenciar um pleito teoricamente democrático, o que apresentaria uma série ameaça ao sistema democrático.

Nesse sentido, Carole Cadwalladr, no documentário Privacidade Hackeada, faz um comovente apelo à reflexão sobre como as redes sociais podem ser usadas para disseminar o mau e o ódio, polarizando os países:

Parece que estamos entrando em uma nova era. Podemos ver que os governos autoritários estão em ascensão. E estão usando essa política de ódio e medo no Facebook. Veja o Brasil. Há esse extremista de direita que foi eleito e sabemos que WhatsApp, que faz parte do Facebook, estava claramente implicado na divulgação de Fake News. E olha o que aconteceu em Myanmar. Há evidência que o Facebook foi usado para incitar ódio racial que causou um genocídio. Também sabemos que o governo russo estava usando o Facebook nos EUA. Há evidência que os russos criaram memes falsos do Vidas Negras Importam, e quando as pessoas clicavam neles era direcionada para páginas onde eles eram, na verdade, convidados para protestos que foram organizados pelo governo russo. E ao mesmo tempo estavam configurando páginas que tinham como alvo grupos adversários, como Vidas Azuis Importam. A questão é alimentar o medo e o ódio para virar o país contra si mesmo. Dividir e Conquistar. Essas plataformas que foram criadas para nos conectar, agora são usadas como armas e é impossível saber o que é o quê porque está acontecendo nas mesmas plataformas onde conversamos com nossos amigos ou compartilhamos fotos de bebês. Nada é o que parece” (PRIVACIDADE …, 2019, 96 min)

4. JUSTIÇA ELEITORAL NO BRASIL

A Justiça Eleitoral tem como escopo realizar a “verdade eleitoral”, para a efetivação da democracia (VELLOSO, 1996, p.9 apud VELLOSO; AGRA, 2016), isso significa que a Justiça Eleitoral é responsável por “possibilitar a expressão da vontade dos eleitores, operacionalizando todos os procedimentos eleitorais para que se desenvolvam em harmonia e transparência, sem que estorvos possam desviar a soberania popular” (VELLOSO; AGRA, 2016).

A Justiça Eleitoral é responsável por disciplinar e organizar o exercício do sufrágio com a finalidade de concretizar a soberania popular. É através das eleições que se garante a livre formação da vontade do eleitor e a igualdade entre os candidatos, zelando pela democracia brasileira.

O art. 105 da Lei das Eleições (9.504/97) diz que Tribunal Superior Eleitoral possui função normativa. “Poderá expedir todas as instruções necessárias para sua fiel execução, ouvidos, previamente, em audiência pública, os delegados ou representantes dos partidos políticos”. Assim, o TSE pode editar normas de controle do uso de plataformas digitais para campanhas eleitorais.

4.1 RESPONSABILIDADE DA JUSTIÇA ELEITORAL NO USO DAS PLATAFORMAS DIGITAIS

Em 2017, o TSE alterou a Lei nº 9.504/1997 (Redação dada pela Lei nº 13.488, de 2017), dando nova redação ao art. 57 para que as plataformas digitais como Facebook, Twitter e outras pudessem ser usadas em campanhas eleitorais a partir do mês de agosto do ano eleitoral. Assim, durante a campanha para as Eleições Presidenciais em 2018 muito se falou a favor desse método que com pouco investimento financeiro, gera mais resultados.

A grande análise da mídia, pós contabilização das urnas, focou em como o candidato à presidência com o maior tempo na TV (SHALDERS, 2018), Geraldo Alckmin (PSDB) sequer foi eleito para o segundo turno, enquanto que o candidato eleito, Jair Bolsonaro (PSL), que tinha apenas 8 segundos no horário eleitoral obteve resultados muito maiores. O próprio Presidente da República, inúmeras vezes usou seu espaço nas redes sociais para enaltecer o fato de que sua campanha eleitoral custou bem menos que a de outros candidatos de peso. Da mesma forma, o candidato João Amoedo (partido NOVO), até então desconhecido da maior parte da população brasileira, também obteve resultados expressivos sem a participação em nenhum debate promovido pelos canais de televisão e fazendo uso das mídias sociais, ficando em 5º lugar no primeiro turno, a frente de outros candidatos mais conhecidos. Assim, as eleições de 2018 refletiram nas mudanças no cenário de campanhas políticas que a partir desse momento passou a acontecer também através das plataformas digitais.

No entanto, após o escândalo do Facebook e da extinta empresa britânica Cambridge Analytica, o mundo percebeu o quão rentável o mercado de dados pessoais pode ser. No Brasil, existem leis que proíbem e criminalizam a compra de votos[15], mas essas leis não comportam mais a atual realidade das campanhas eleitorais. Pode-se gastar qualquer quantia em dinheiro nos anúncios no Facebook, Google ou YouTube, e ninguém saberá, porque esses dados são inacessíveis. O que se tem são prestações de contas junto ao TSE, o que permitiria saber quanto foi gasto com esses anúncios, mas o conteúdo do mesmo nunca será revelado. Carole Cadwalladr, em sua apresentação numa conferência TED em abril deste ano, afirma:

… o que acontece no Facebook fica no Facebook, porque só nós vemos o conteúdo de nossa página, que depois desaparece. É impossível pesquisar qualquer coisa. Não temos ideia de quem viu quais anúncios, qual foi o impacto deles, ou quais dados foram usados para escolher o público-alvo. Nem mesmo quem colocou os anúncios, quanto dinheiro foi gasto, nem de qual nacionalidade eram. (CADWALLADR, 2019)

O surpreendente número de estudos e dados existentes mostrando a relação entre a interação de bots influenciando usuários durante períodos eleitorais, demostram o quanto “as plataformas devem estar atentas para o cumprimento do marco legal para campanhas eleitorais nas redes sociais” (RUEDIGER; GRASSI, 2018, p.25). Para tanto, o TSE deveria criar normas que fiscalizassem melhor se as plataformas estão cumprindo os limites já previstos em lei. É responsabilidade do Tribunal zelar pela lisura das eleições e proteger a democracia. Ruediger ainda sugere:

… o surpreendente volume de interações das candidaturas, no Twitter, no Facebook, no YouTube e no Instagram, indicam que as plataformas devem estar atentas para o cumprimento do marco legal para campanhas eleitorais nas redes sociais para, em paralelo, manter os atendimentos dos usuários a suas políticas e normas (RUEDIGER; GRASSI, 2018, p.25).

O TSE não deveria permitir campanhas eleitorais nessas plataformas que são inacessíveis e impossível de serem fiscalizadas. Não há como fiscalizar a possível manipulação de um determinado público-alvo por parte de anúncios com essa finalidade. Assim, é necessário que sejam criadas normas que obriguem as plataformas sociais a fazerem o que foi sugerido pelo relatório do Parlamento Britânico citado anteriormente, identificando os autores das publicações com conteúdo eleitoral.

Caldas e Caldas explicam o que tem sido feito, com relação a essa temática, em outras partes do mundo:

Nesse sentido, a União Europeia criou em 25 de maio de 2018 o Regulamento Geral sobre a Proteção de Dados (COMISSÃO EUROPEIA, 2018) após estudos que indicavam que a propagação de fake news era feita a partir da análise de dados de usuários (MARTENS et al., 2018 apud CALDAS; CALDAS, p.214, 2019). Caminhando nesse sentido, em 11 de junho de 2018, o Conselho Nacional de Direitos Humanos aprovou a Recomendação nº 04, de 11 de junho de 2018, que trata “sobre medidas de combate às fake news (notícias falsas) e a garantia do direito à liberdade de expressão” (BRASIL, 2018b apud CALDAS; CALDAS, p.214, 2019), que recomenda a aprovação de Projeto de Lei voltado para proteção de dados pessoais (BRASIL, 2018ª apud CALDAS; CALDAS, p.214, 2019), considerando que “a produção e direcionamento das chamadas fake news hoje estão diretamente relacionadas com a coleta e tratamento massivos e indiscriminados de dados pessoais” (BRASIL, 2018b apud CALDAS; CALDAS, p.214, 2019) (CALDAS; CALDAS, p.214, 2019).

5. COMO O TSE TEM LIDADO COM ESSA QUESTÃO DESDE ÀS ELEIÇÕES 2018

Em maio de 2019, o TSE realizou um Seminário Internacional sobre fake news e Eleições em conjunto com a União Europeia. O seminário aconteceu em Brasília e contou com diversos palestrantes, dentre eles: a Ministra Rosa Weber, Presidente do Tribunal Superior Eleitoral (TSE), o Ministro Luiz Fux, Vice-Presidente do Supremo Tribunal Federal (STF) e o Ministro Sergio Moro, Ministro da Justiça e Segurança Pública.

De acordo com o site do TSE sobre o seminário:

No decorrer do ano de 2018, o Conselho Consultivo sobre Internet e Eleições, instituído pelo Tribunal Superior Eleitoral (TSE) em 7 de dezembro de 2017, desenvolveu inúmeras atividades relacionadas à influência da Internet nas eleições, em especial quanto ao risco das Fake News e ao uso de robôs na propagação de informações, ações estas que contribuíram para a ampliação do conhecimento da Justiça Eleitoral frente ao tema, de modo a não somente prevenir como também a facilitar o enfrentamento do grave problema relativo à disseminação de notícias falsas durante as eleições gerais de 2018. (BRASIL, 2019f).

Ainda sobre o Seminário, o TSE reconhece sua responsabilidade primordial em proteger a Democracia brasileira quando afirma:

Considerando o complexo equacionamento do fenômeno conhecido como Fake News, em todos os ramos da sociedade, tanto no Brasil como no exterior, cumpre à Justiça Eleitoral manter-se atenta ao problema, orientada a encontrar meios de enfrentamento mais eficazes em eleições futuras. (BRASIL, 2019f).

O seminário teve como objetivo principal suscitar formas de impedir ou minimizar a divulgação de notícias falsas nas eleições municipais de 2020, levando em conta a experiência adquirida durante o pleito de 2018. Dessa forma, almejou-se compilar os dados, compartilhar experiências, acolher sugestões, discutir sobre medidas viáveis de enfrentamento às notícias falsas, bem como promover fonte de estudos e propostas a serem encaminhadas à Justiça Eleitoral e ao Congresso Nacional (BRASIL, 2019f).

Em fevereiro deste ano, foi publicada no portal do TSE, a portaria nº 115 que “institui grupo de trabalho incumbido de realizar estudos para identificar os conflitos na norma vigente decorrentes das reformas eleitorais e propor a respectiva sistematização” (BRASIL, 2019a). Dessa portaria nasceu Diálogos para a construção da Sistematização das Normas Eleitorais, estudos preliminares com o intuito de:

…identificar e sistematizar a legislação pertinente, apontando incoerências, omissões e/ou excesso de regulamentação, tendo a Constituição Federal como parâmetro e a partir dos textos legislativos, das resoluções e até mesmo das discussões jurisprudenciais, de modo a ter como resultado um texto mais conciso, coerente e abrangente à atual realidade da democracia brasileira.” (BRASIL, 2019, p.3).

Destaca-se ainda a necessidade de “uma especial atenção, por exemplo, aos temas que exigem uma convergência entre direito eleitoral, tecnologia e marketing digital”, citando ainda a “possibilidade dos impulsionamentos, utilizados pela primeira vez nas eleições gerais de 2018” (BRASIL, 2019, p.3). Através desse estudo pode-se perceber que o TSE já está analisando o problema dos impulsionamentos e bots usados pelas mídias sociais.

A Lei 9.504/97, que sofreu uma minirreforma em 2017 autorizando o uso das plataformas digitais em propagandas eleitorais, ainda apresenta várias inconsistências. Conforme a lei, o impulsionamento é vedado às pessoas físicas e limitado a candidatos ou coligações. Assim, afirmam Caldas e Caldas (p. 213, 2019):

… especialistas da área de direito eleitoral avaliam:

Com o impulsionamento pago, abrem-se brechas para os ilícitos de abuso de poder econômico, abuso de poder político, abuso dos meios de comunicação social, propaganda vedada (realizada por igrejas, sindicatos e pessoas jurídicas em geral), fake news, entre outros possíveis ilícitos. Alguns desses ilícitos podem levar à cassação do registro de candidatura, diploma (caso eleito) e perda do mandato. (ALMEIDA; LOURA JUNIOR, 2018 apud CALDAS e CALDAS)

O texto original trazia em seu art. 57-B, §6º dispositivo que previa medidas mais efetivas para inibição de fake news durante as eleições. No entanto, o mesmo foi vetado pelo então Presidente da República Michel Temer. O texto do §6º previa originalmente (CALDAS e CALDAS, p. 213, 2019):

A denúncia de discurso de ódio, disseminação de informações falsas ou ofensa em desfavor de partido ou candidato, feita pelo usuário de aplicativo ou rede social na internet, por meio do canal disponibilizado para esse fim no próprio provedor, implicará suspensão, em no máximo vinte e quatro horas, da publicação denunciada até que o provedor certifique-se da identificação pessoal do usuário que a publicou, sem fornecimento de qualquer dado do denunciado ao denunciante, salvo por ordem judicial. (BRASIL, 2017, Grifo nosso apud CALDAS e CALDAS).

A justifica para o veto, segundo Caldas e Caldas é a existência do “receio de que uma legislação de repressão às fake news possa gerar cerceamento à liberdade de expressão” principalmente num cenário “intensa polarização política, no qual as paixões políticas fazem com que a fronteira entre a verdade, do ponto objetivo e subjetivo, se esmaeça.” (CALDAS e CALDAS, p. 214, 2019)

Concluem Caldas e Caldas que, apesar de O Art. 25 da Resolução nº 23.551/2017 TSE conter “dispositivo para tentar evitar a propagação de fake news… a celeridade da justiça provavelmente não será suficiente para impedir essa ocorrência… justamente porque sua característica é a velocidade na propagação.” (CALDAS e CALDAS, p. 214, 2019).

Percebe-se que encontrar uma solução plausível não será fácil. Qualquer medida mais drástica de inibição de fake news ou impedimento de certas maneiras de usar plataformas digitais, confrontará, possivelmente, a liberdade de expressão. Um paradoxo difícil de ser resolvido. Porém o Tribunal tem tomado algumas medidas.

O portal do TSE e suas páginas nas redes sociais, possuem vídeos ilustrativos e educativos sobre “os mitos nas eleições” e até mesmo dicas para os eleitores não perderem o título de eleitor. No entanto, não havia nenhum vídeo, até o mês de setembro deste ano, alertando e conscientizando os eleitores sobre o perigo das fake news. O TSE começou então a veicular no início do mês de setembro, em seu canal no YouTube[16], a série de vídeos Enfrentamento à Desinformação[17]” (BRASIL, 2019b). Esta série, até a presente data (21 de outubro de 2019), possui 6 vídeos explicando o quanto o TSE foi efetivo e rápido ao resolver a questão das notícias falsas sobre o funcionamento das urnas eletrônicas, e também ensinando o eleitor a não usar o termo fake news, por ter um sentido pejorativo e não concreto, segundo os especialistas entrevistados nos vídeos. Além disso, segundo eles o termo é ambíguo, impreciso e desqualifica a imprensa, sendo utilizado por políticos com esse objetivo. Assim, recomenda-se o uso do termo “Desinformação”.

Como se pode ver, os vídeos produzidos pelo TSE enaltecem o próprio tribunal afirmando o quão rápido o Tribunal tem agido no combate a desinformação, além de explicar o porquê do uso do termo fake news ser errado. Embora tenham alguns segundos de dicas em como diminuir a desinformação, os vídeos não são pontuais em esclarecer ao eleitor sobre a existência de contas automatizadas com potencial influenciador na opinião pública, explicando por exemplo, o funcionamento dos bots. Em momento nenhum os vídeos produzidos pelo Tribunal esclarecem o eleitor sobre a consequência que a desinformação pode trazer para o resultado de uma eleição. Além de não estarem disponíveis em um lugar de fácil conhecimento do eleitor. Quantos eleitores assistirão esses vídeos? Até o momento, não há sequer 500 visualizações dos mesmos.

Em uma outra tentativa de inibir a disseminação de fake news, neste ano de 2019, o Poder Legislativo acrescentou o art. 326-A à Lei 4.737/65 (Código Eleitoral) in verbis:

Art. 326-A. Dar causa à instauração de investigação policial, de processo judicial, de investigação administrativa, de inquérito civil ou ação de improbidade administrativa, atribuindo a alguém a prática de crime ou ato infracional de que o sabe inocente, com finalidade eleitoral:

Pena – reclusão, de 2 (dois) a 8 (oito) anos, e multa.

§ 1º A pena é aumentada de sexta parte, se o agente se serve do anonimato ou de nome suposto.

§ 2º A pena é diminuída de metade, se a imputação é de prática de contravenção.

§ 3º Incorrerá nas mesmas penas deste artigo quem, comprovadamente ciente da inocência do denunciado e com finalidade eleitoral, divulga ou propala, por qualquer meio ou forma, o ato ou o fato que lhe foi falsamente atribuído[18]. (BRASIL, 1965)

O Presidente da República vetou o § 3º alegando que “a conduta de calúnia com objetivo eleitoral já está tipificada em outro dispositivo do Código Eleitoral [com] pena de seis meses a dois anos”, ferindo assim o “princípio da proporcionalidade.” No entanto o veto foi derrubado pelo Congresso em agosto de 2019, tipificando assim mais um crime eleitoral. (Congresso…, 2019).

Também em agosto, o TSE lançou o Programa de Enfrentamento à Desinformação com Foco nas Eleições 2020. Segundo explicação no sítio eletrônico do Tribunal:

O programa foi organizado em seis eixos temáticos. O primeiro, “Organização interna”, visa à integração e à coordenação entre os níveis e as áreas que compõem a estrutura organizacional da Justiça Eleitoral e a definição das respectivas atribuições contra a desinformação.

Outro eixo que será trabalhado é a “Alfabetização Midiática e Informacional”, que tem o objetivo de capacitar as pessoas para identificar e checar uma desinformação, além de estimular a compreensão sobre o processo eleitoral.

Sobre o tópico “Contenção à Desinformação”, a ideia é instituir medidas concretas para desestimular ações de proliferação de informações falsas. Já com o eixo “Identificação e Checagem de Desinformação”, o TSE pretende buscar o aperfeiçoamento e novos métodos de identificação de possíveis práticas de disseminação de conteúdos falaciosos.

Os eixos “Aperfeiçoamento do Ordenamento Jurídico” e “Aperfeiçoamento de Recursos Tecnológicos” também fazem parte do programa lançado pelo TSE.

Antes da assinatura do termo de adesão, a ministra Rosa Weber anunciou o lançamento de uma página na internet[19] que reunirá informações sobre a desinformação e, também, de um livro que é fruto do resultado dos debates ocorridos no Seminário Internacional Fake News e Eleições, realizado em maio deste ano, no TSE. A obra está disponível no Portal do Tribunal[20]. (BRASIL, 2019e)

No dia 22 de outubro deste ano, Google, Facebook, Twitter e WhatsApp aderiram ao programa. Na ocasião, a ministra Rosa Weber “classificou como nefasto o efeito causado pela desinformação à democracia, ao processo eleitoral e à sociedade de forma geral.” E afirmou que o foco do programa “é provocar o envolvimento de todas as esferas sociais no combate à disseminação de informações enganosas na internet.” (BRASIL, 2019c). Afirmou ainda, que essas empresas possuem capacidade para melhorar tecnologias que identificam “o uso abusivo de bots e de outras ferramentas automatizadas de divulgação de conteúdos.” A presidente do TSE concluiu sua fala com o seguinte anseio:

Espero que possamos chegar ao término das Eleições de 2020 convencidos de que o processo eleitoral não sofreu maiores influências do fenômeno da desinformação e de que isso se deveu, e muito, à contribuição dos parceiros do nosso programa. (BRASIL, 2019c).

O programa do Tribunal parece já estar trazendo alguns resultados por parte das próprias plataformas que o aderiram. No dia 29 de outubro de 2019, a rede social Twiter se reuniu com grupo gestor do programa para “alinhar estratégias conjuntas” (BRASIL, 2019d). No dia seguinte, a imprensa anunciou que a rede social decidiu banir todo tipo de propaganda política (TWITER…, 2019). No entanto, parece que a preocupação da Justiça Eleitoral está direcionada a combater a desinformação somente, nada mencionando a capacidade que empresas como a extinta Cambridge Analytics têm de classificar perfis políticos através de dados de eleitores usuários de mídia social.

6. CONCLUSÃO

Analisar as redes sociais como influenciadoras do debate político é fundamental para o entendimento do estágio em que as democracias se encontram (RUEDIGER; GRASSI, 2018) e refletir sobre o porvir eleitoral brasileiro.

Dessa maneira, para que as redes sociais continuem sendo um espaço democrático de opinião e informação, é necessário entender a organicidade dos debates, identificando os responsáveis pelas ações coordenadas de impulsionamento de mensagens. É preciso que as redes se tornem mais transparentes, buscando-se compreender os interesses por trás da contratação destes serviços de automatização e propagação de desinformação. Ampliar a capacidade de identificar e reprimir a automatização maliciosa de perfis nas redes sociais deve ser uma prioridade. (GRASSI et al., 2017).

Enquanto isso, a Justiça Eleitoral deveria fomentar políticas conscientizadoras aos eleitores usuários de plataformas digitais, sobre os mecanismos usados para manipulação, desde a formação das echo chambers, até o uso de inteligência artificial e bots, que direcionam suas mensagens intencionalmente para destinatários específicos. Dessa forma, permitindo-se a possibilidade de as pessoas poderem filtrar o que veem, e poderem também limitar o poder crescente dos provedores para selecionar cada usuário individualmente, analisando-os com base nas informações sociais adquiridas em seus perfis nessas plataformas.

Cass Sunstein está correto quando insiste que, em uma sociedade diversa, o sistema de liberdade de expressão e direito à privacidade, exige muito mais do que restrições à censura do governo e respeito pelas escolhas individuais. Embora a censura seja uma ameaça à democracia e à liberdade, um sistema de livre expressão que funcione bem deve atender a dois requisitos distintos: Em primeiro lugar, as pessoas devem estar expostas a materiais que não teriam escolhido antecipadamente, evitando assim a formação das echo chambers. E em segundo lugar assuntos devem envolver tópicos e pontos de vista que os usuários das plataformas digitais não procuraram, e talvez sequer concordem, mas que são importantes para evitar a polarização e o extremismo. O professor de Harvard esclarece que não sugere que o governo force as pessoas a verem coisas que desejam evitar. Mas afirma que encontros não planejados e imprevistos são centrais para a democracia, fazendo assim seu apelo por serendipidade (SUNSTEIN, 2017).

Conforme Caldas e Caldas (2019), as fake news, ou Desinformação, espalham-se rapidamente e deixam consequências por muito tempo. Lidar com esse fenômeno requer medidas eficientes e rápidas para diminuir a sua propagação e efeitos, já que essa disseminação pode interferir no processo democrático brasileiro como visto neste trabalho. Faz-se necessária ainda, a criação de instrumentos para identificar os agentes responsáveis por estes episódios e ferramentas para medir os possíveis danos causados em uma eleição. Além de medidas que possibilitem um maior controle de acesso aos dados de usuários, já que os direcionamentos de conteúdo dependem da identificação dos perfis de um público alvo.

É de extrema urgência e importância que a Justiça Eleitoral juntamente com o Poder Legislativo, crie meios de proteção de dados digitais, de forma a impedir que novas Cambridge Analytics surjam e usem suas análises de perfis para direcionar mensagens a alvos escolhidos com o objetivo de interferir no processo democrático das eleições.

Até que essas medidas sejam tomadas, os eleitores precisam ser conscientizados. O Brasil vive a era da polarização política. É fato posto. Não faz diferença se o indivíduo é a favor de uma política de esquerda ou de direita. A tendência deste é não apoiar uma ideia que tenha surgido de um partido contrário à sua visão, mesmo que ele concorde com ela. Dessa forma, parece fácil manipular um grupo alvo, para que o ódio e o caos sejam disseminados. E como visto neste trabalho, seria possível até mesmo, mudar o resultado de uma eleição.

Assim, entende-se que a ação da Justiça Eleitoral é tímida diante do recorte trazido no presente debate, ou seja, o de educar os eleitores usuários dessas plataformas, sobre os perigos da manipulação de dados nas redes sociais, além do enfoque que tem sido dado à conscientização quanto desinformação.

As Fake news sempre existiram, ao contrário da aptidão que alguns softwares possuem de analisar o perfil de cada usuário eleitor. Essa capacidade é uma novidade dessa era digital e possui imenso potencial de escolher como alvo um determinado grupo podendo inclusive, manipular o resultado de um processo eleitoral.

A Justiça Eleitoral deve prezar pela lisura nas eleições. Dessa forma, é preciso conscientizar a população destes meios de manipulação. Educar as pessoas a protegerem seus dados e a questionarem informações recebidas, principalmente nas redes sociais. Quem sabe assim, essa polarização diminua um dia, e com ela, o potencial de manipulação existente nas plataformas sociais.

REFERÊNCIAS

BECKER, Lauro. Site, blog, landing page, hotsite ou e-commerce? Entenda a diferença! Orgânica Digital, jul. 2016. Disponível em: https://www.organicadigital.com/blog/site-blog-landing-page-hotsite-ou-e-commerce-entenda-a-diferenca/. Acesso em: 20 out. 2019.

BITTAR, Eduardo C. B. Metodologia da pesquisa jurídica. 15. ed. São Paulo: Saraiva, 2017. ISBN: 9788547220037.

BOND, Robert M. et al. A 61-million-person experiment in social influence and political mobilization. Nature, n. 489, p. 295-298, set. 2012. DOI: https://doi.org/10.1038/nature11421. Disponível em: https://www.nature.com/articles/nature11421. Acesso em: 8 jan. 2019.

BRASIL. Presidência da República. Casa Civil. Subchefia para Assuntos Jurídicos. Constituição da República Federativa do Brasil de 1988. Portal da Legislação. Disponível em: http://www.planalto.gov.br/ccivil_03/constituicao/constituicao.htm. Acesso em: 10 mai. 2019.

BRASIL. Presidência Da República. Casa Civil. Subchefia Para Assuntos Jurídicos. Lei Nº 9.504, de 30 de setembro de 1997. Lei da Eleições. Portal da Legislação. Disponível em: http://www.planalto.gov.br/ccivil_03/leis/l9504.htm Acesso em: 10 mai. 2019.

BRASIL. Presidência Da República. Casa Civil. Subchefia Para Assuntos Jurídicos. Lei Nº 4.737, de 15 de julho de 1965. Código Eleitoral. Portal da Legislação. Disponível em: http://www.planalto.gov.br/ccivil_03/leis/l4737.htm Acesso em: 22 out. 2019.

BRASIL. Tribunal Superior Eleitoral. Diálogos para a construção da Sistematização das Normas Eleitorais. 2019. Disponível em: http://www.tse.jus.br/legislacao/sne/arquivos/gt-iii-propaganda-estudos-preliminares. Acesso: em: 12 ago. 2019.

BRASIL. Tribunal Superior Eleitoral. Legislação. 2019a. Disponível em: http://www.tse.jus.br/legislacao/compilada/prt/2019/portaria-no-115-de-13-de-fevereiro-de-2019 Acesso: em: 12 ago. 2019.

BRASIL. Tribunal Superior Eleitoral. Portal da Comunicação TSE. 2019b. Disponível em: http://www.tse.jus.br/imprensa/noticias-tse/2019/Setembro/enfrentamento-a-desinformacao-tse-veicula-serie-de-cinco-videos-sobre-o-tema?fbclid=IwAR2JRU6Yu0u-gRV1-wACl3K4Eic8l-jtllgIjG64kpTVwW1so6Xi8NSx2yY. Acesso em: 21 out. 2019.

BRASIL. Tribunal Superior Eleitoral. Portal da Comunicação TSE. 2019c. Disponível em: http://www.tse.jus.br/imprensa/noticias-tse/2019/Outubro/google-facebook-twitter-e-whatsapp-aderem-ao-programa-de-enfrentamento-a-desinformacao-do-tse. Acesso em: 30 out. 2019.BRASIL. Tribunal Superior Eleitoral. Portal da Comunicação TSE. 2019d. Disponível em: http://www.tse.jus.br/imprensa/noticias-tse/2019/Outubro/grupo-gestor-do-programa-de-enfrentamento-a-desinformacao-recebe-representante-do-twitter-para-alinhar-estrategias-conjuntas. Acesso em: 30 out. 2019.

BRASIL. Tribunal Superior Eleitoral. Portal da Comunicação TSE. 2019e. Disponível em: http://www.tse.jus.br/imprensa/noticias-tse/2019/Agosto/tse-lanca-programa-de-enfrentamento-a-desinformacao-com-foco-nas-eleicoes-2020. Acesso em: 30 out. 2019.

BRASIL. Tribunal Superior Eleitoral. Seminário Internacional sobre Fake News e Eleições. 2019f. Disponível em: http://www.tse.jus.br/hotsites/seminario-internacional-fake-news-eleicoes/. Acesso: em: 12 ago. 2019.

CADWALLADR, Carole. Revealed: 50 million Facebook profiles harvested for Cambridge Analytica in major data breach. The Guardian, 17 mar. 2018. Disponível em: https://www.theguardian.com/news/2018/mar/17/cambridge-analytica-facebook-influence-us-election Acesso em: 26 abr. 2019.

CADWALLADR, Carole. Facebook’s role in Brexit — and the threat to democracy. TED Ideas worth spreading, Abr, 2019. Disponível em: https://www.ted.com/talks/carole_cadwalladr_facebook_s_role_in_brexit_and_the_threat_to_democracy/transcript?language=en. Acesso em: 4 ago. 2019.

CALDAS, Camilo O. L.; CALDAS, Pedro N. L. Estado, democracia e tecnologia: conflitos políticos e vulnerabilidade no contexto do big-data, das fake news e das shitstorms. Perspectivas em Ciência da Informação, Belo Horizonte, v.24, n. 2, abr./jun. 2019. Disponível em: http://www.scielo.br/scielo.php?script=sci_arttext&pid=S1413-99362019000200196&tlng=pt. Acesso em: 20 out. 2019.

Congresso derruba veto e mantém pena para “fake news” eleitoral. Exame, ago. 2019. Disponível em: https://exame.abril.com.br/brasil/congresso-mantem-veto-a-prestacao-de-assistencia-odontologica-obrigatoria/. Acesso em: 22 out. 2019.

FERRARA, Emilio, et al. The Rise of Social Bots. Communications of the ACM, New York, v. 59 n. 7, jul. 2016. Disponível em: https://cacm.acm.org/magazines/2016/7/204021-the-rise-of-social-bots/fulltext#R24. Acesso em: 20 out. 2019.

GRASSI, Amaro. Et al. Robôs, redes sociais e política no Brasil: estudo sobre interferências ilegítimas no debate público na web, riscos à democracia e processo eleitoral de 2018. FGV DAPP, Rio de Janeiro, 20 ago 2017. Disponível em: http://hdl.handle.net/10438/18695. Acesso em: 12 jan. 2019.

HALE, Scott et al. How digital design shapes political participation: A natural experiment with social information. PLoS One, 27 abr. 2018. DOI: 10.1371/journal.pone.0196068. Disponível em: https://journals.plos.org/plosone/article?id=10.1371/journal.pone.0196068. Acesso em: 8 jan. 2019.

HOUSE OF COMMONS (Reino Unido). Disinformation and ‘fake news’: Final Report. Londres: House of Commons, 2019, 111 p. Disponível em: https://publications.parliament.uk/pa/cm201719/cmselect/cmcumeds/1791/1791.pdf. Acesso em: 19 fev. 2019.

MONTEIRO, Cláudia S.; MEZZAROBA, Orides. Manual de metodologia da pesquisa no Direito. 7. ed. São Paulo: Saraiva, 2017. ISBN: 9788547218720.

MUNGER, Kevin. Influence? In this economy? Tech-savvy young people take internet literacy for granted, and that can cause all kinds of problems. The Outline, 17 fev. 2018. Disponível em: https://theoutline.com/post/3443/devumi-twitter-bots-savviness-gap. Acesso em: 14 jan. 2019.

NETTO, Paulo R. WhatsApp confirma ação de empresas em disparo de mensagens durante eleições. O Estado de São Paulo, 8 out. 2019. Disponível em: https://politica.estadao.com.br/blogs/estadao-verifica/whatsapp-confirma-acao-de-empresas-em-disparo-de-mensagens-durante-eleicoes/. Acesso em: 2 nov. 2019.

PRIVACIDADE Hackeada. Direção: Karim Amer, Jehane Noujaim. Produção: Karim Amer, Pedro Kos, Geralyn Dreyfous, Judy Korin. Intérpretes: Brittany Kaiser, Carole Cadwalladr, David Carrol e outros. Roteiro: Karim Amer, Pedro Kos, Erin Barnett. Estados Unidos: Netflix, 2019 (113 min). Produzido por Netflix. Disponível em: https://www.netflix.com Acesso em: 4 ago. 2019.

PUPO, Amanda; PIRES, Breno. TSE abre ação sobre compra de mensagens anti-PT no WhatsApp. O Estado de São Paulo, 19 out. 2019. Disponível em: https://politica.estadao.com.br/noticias/eleicoes,tse-abre-acao-sobre-compra-de-mensagens-anti-pt-no-whatsapp,70002555142. Acesso em: 2 nov. 2019.

RAMAYANA, Marcos. Direito Eleitoral. 16. Edição. Niterói: Impetus, 2018. ISBN: 9788576269601.

ROSENBERG, Matthew; CONFESSORE, Nicholas; CADWALLADR, Carole. How Trump consultants exploited the Facebook data of millions. The New York Times, 17 mar. 2018. Disponível em: https://www.nytimes.com/2018/03/17/us/politics/cambridge-analytica-trump-campaign.html. Acesso em: 20 dez. 2018.

RUEDIGER, Marco A. O estado da desinformação: Eleições 2018. FGV DAPP, Rio de Janeiro, 18 set 2018. Disponível em http://hdl.handle.net/10438/25743. Acesso em: 3 jan. 2019.

RUEDIGER, Marco A.; GRASSI, Amaro. Redes sociais nas eleições 2018. FGV DAPP, Rio de Janeiro, 5 out 2018. Disponível em http://hdl.handle.net/10438/25737. Acesso em: 3 jan. 2019.

RUEDIGER, Marco A.; GRASSI, Amaro. Desinformação na era digital: amplificações e panorama das Eleições 2018. FGV DAPP, Rio de Janeiro, 30 nov 2018a. Disponível em http://hdl.handle.net/10438/25742. Acesso em: 3 jan. 2019.

RUEDIGER, Marco A.; GRASSI, Amaro. Bots e o Direito Eleitoral Brasileiro nas Eleições de 2018. FGV DAPP, Rio de Janeiro, 15 jan 2019. Disponível em http://hdl.handle.net/10438/26227. Acesso em 17 fev. 2019.

SHALDERS, André. Eleições 2018 estreia na TV com força em cheque. BBC News Brasil, 18 ago. 2018. Disponível em: https://www.bbc.com/portuguese/brasil-45364384 Acesso em: 18 ago. 2019.

SILVA, Carla A. et al. Uso de redes sociais e softwares para disseminação e combate de fake news nas eleições. In: CONGRESSO NACIONAL UNIVERSIDADE, EAD E SOFTWARE LIVRE, 2018, Belo Horizonte. Anais […]. Belo Horizonte: UFMG, 2018. Disponível em: http://www.periodicos.letras.ufmg.br/index.php/ueadsl/article/view/14413. Acesso em: 4 jan. 2019.

STELLA, Massimo; FERRARA, Emilio; DOMENICO, Manlio. Bots increase exposure to negative and inflammatory content in online social systems. Proceedings of the National Academy of Sciences of the United States of America, v. 115, p. 12435–12440, dez. 2018. DOI: 10.1073/pnas.1803470115. Disponível em: https://www.pnas.org/content/115/49/12435. Acesso em: 8 jan. 2019.

SUNSTEIN, Robert C. #Republic: Divided democracy in the age of social media. Princeton University Press, 2017. ISBN: 9780691175515.

TÖRNBERG, Petter. Echo chambers and viral misinformation: Modeling fake news as complex contagion. PLoS One, 20 set. 2018. DOI: 10.1371/journal.pone.0203958. Disponível em: https://journals.plos.org/plosone/article?id=10.1371/journal.pone.0203958. Acesso em: 13 jan. 2019.

TWITTER vai banir todo tipo de propaganda política, o que pressiona Facebook. O Globo, 30 out. 2019. Disponível em: https://oglobo.globo.com/mundo/twitter-vai-banir-todo-tipo-de-propaganda-politica-que-pressiona-facebook-24051553. Acesso em: 31 out. 2019.

VELLOSO, Carlos M. D. S.; AGRA, Walber D. M. Elementos de direito eleitoral. 5. ed. São Paulo: Saraiva, 2016. ISBN: 9788547208073.

APÊNDICE – REFERÊNCIAS DE NOTA DE RODAPÉ

3. Um bot social é um algoritmo de computador que produz conteúdo automaticamente e interage com humanos nas mídias sociais, tentando imitar e possivelmente alterar seu comportamento. (FERRARA, 2016).

4. Echo chambers ou Câmaras de eco são ambientes em que uma pessoa encontra apenas crenças ou opiniões que coincidem com as suas próprias, de modo que suas visões existentes sejam reforçadas e ideias alternativas não sejam consideradas (CAMBRIDGE, 2019)

5. Esse item não existe na versão brasileira da página do Facebook.

6. A saída do Reino Unido da União Européia

7. Centro de pesquisa social aplicada que tem a missão de promover a inovação para políticas públicas.

8. Disponível em: http://hdl.handle.net/10438/18695. Acesso em: 12 jan. 2019.

9. Criado em dezembro de 2017, para discutir o impacto potencial de fake news e uso de robôs durante as eleições brasileiras de 2018. (RUEDIGER; GRASSI, 2018, p.4)

10. A Sala conta ainda com um grupo de Observadores da Democracia Digital que acompanham as análises geradas. Integram esse grupo, pesquisadores do Department of Communication Studies/Northwestern University,do Centro de Estudios sobre Medios Y Sociedad en Argentina, da Universidad San Andrés, José Maurício Domingues – Instituto de Estudos Sociais e Políticos/Universidade do Estado do Rio de Janeiro, da Escola de Comunicações e Arte/USP, Luciano Floridi – Oxford Internet Institute/Oxford, da University, e da Universidade de Brasília. (RUEDIGER; GRASSI, out 2018, p.5)

11. “O hotsite é uma página ou um site de menor proporção criado para situações específicas e por um determinado período de tempo.” (BECKER, 2016)

12. Disponível em http://hdl.handle.net/10438/25742. Acesso em: 3 jan. 2019.

13. Disponível em https://www1.folha.uol.com.br/poder/2019/08/tse-ouve-testemunha-em-acao-sobre-mensagens-pro-bolsonaro-no-whatsapp.shtml. Acesso em: 22 ago. 2019

14. Disponível em http://hdl.handle.net/10438/25742. Acesso em: 3 jan. 2019.

15. Art. 41-A, caput da Lei nº 9.504/97 (Lei das Eleições): Ressalvado o disposto no art. 26 e seus incisos, constitui captação de sufrágio, vedada por esta Lei, o candidato doar, oferecer, prometer, ou entregar, ao eleitor, com o fim de obter-lhe o voto, bem ou vantagem pessoal de qualquer natureza, inclusive emprego ou função pública, desde o registro da candidatura até o dia da eleição, inclusive, sob pena de multa de mil a cinquenta mil Ufir, e cassação do registro ou do diploma, observado o procedimento previsto no art. 22 da Lei Complementar no 64, de 18 de maio de 1990.

Art. 299, caput da Lei nº 4.737/1965 (Código Eleitoral): Dar, oferecer, prometer, solicitar ou receber, para si ou para outrem, dinheiro, dádiva, ou qualquer outra vantagem, para obter ou dar voto e para conseguir ou prometer abstenção, ainda que a oferta não seja aceita: Pena – reclusão até quatro anos e pagamento de cinco a quinze dias-multa.

16. O canal do TSE no Youtube pode ser encontrado no endereço eletrônico: www.youtube.com/tse

17. A Série pode ser encontrada no endereço eletrônico: https://www.youtube.com/watch?v=1fSmN6BQvt0&list=PLljYw1P54c4zazS2rQVEneIyvTlSh27bo

18. Art. 326-A acrescido pelo art. 2º da Lei nº 13.834/2019

19. http://www.justicaeleitoral.jus.br/desinformacao/#

20. http://www.justicaeleitoral.jus.br/desinformacao/arquivos/livro-fake%20news-miolo-web.pdf