ARTICLE ORIGINAL

BONATO, Isabelle Emy [1], GRANADO, Karina [2]

BONATO, Isabelle Emy. GRANADO, Karina. La responsabilité de la justice électorale face aux publicités électorales sur les plateformes numériques. Revista Científica Multidisciplinar Núcleo do Conhecimento. An 05, Ed. 03, vol. 02, p. 85 à 120. En mars 2020. ISSN: 2448-0959, Lien d’accès: https://www.nucleodoconhecimento.com.br/droit/annonces-electorales

RÉSUMÉ

L’étude remet en question la fiabilité des plateformes numériques de médias sociaux dans les publicités électorales et la responsabilité de la justice électorale dans ce contexte. Il analyse la nécessité pour la justice électorale de réglementer l’utilisation de ces plateformes et demande si l’utilisation des réseaux sociaux comme plate-forme de propagande électorale nuit à la démocratie. Il est notoire dans les médias du monde entier qu’il existe des moyens numériques d’obtenir des renseignements personnels et de diriger des informations, vraies ou non, à des auditoires spécifiques. Ainsi, l’utilisation des médias sociaux comme plate-forme de publicité électorale peut ne pas être sûre, et peut être facilement manipulée et, par conséquent, la présente étude analyse si la Cour électorale supérieure devrait réglementer l’utilisation de celui-ci en respectant le principe de douceur des élections qui garantit la libre formation de la volonté de l’électeur et l’égalité entre les candidats, assurant la démocratie brésilienne.

Mots clés: Démocratie, médias sociaux, élections.

1. INTRODUCTION

Récemment, on a beaucoup parlé de l’importance de la démocratie. Certains parlent de « coup d’État » et prennent la rue pour réclamer la défense de la démocratie, d’autres estiment qu’il n’y a rien à craindre, car avec les élections présidentielles de 2018, le processus démocratique est resté intact. Toutefois, une nouvelle question a été soulevée : la fiabilité de l’utilisation des plateformes numériques dans les publicités électorales autorisées par la TSE – Cour électorale supérieure pour ces élections. Lorsqu’il s’agit d’une question aussi importante que la démocratie, il est important de connaître le fonctionnement des réseaux sociaux et les méthodes existantes de manipulation des données et d’orientation de l’information pour réfléchir sur la liberté de vote et la défense et la protection de la démocratie.

En mars 2018, le The New York Times a publié certains des scandales Facebook. Avec The Observer of London, le journal a examiné une société de conseil politique appelée Cambrigde Analytica et a révélé une nouvelle arme potentielle utilisée par le cabinet de conseil. Selon le journal américain, cette arme est un logiciel capable de cartographier les traits de personnalité en fonction de ce que les gens aiment sur Facebook. Cambridge a eu accès aux données personnelles de millions d’utilisateurs de ce réseau, étant en mesure de prédire, entre autres caractéristiques personnelles, la capacité de réceptivité de chacun, la vision politique, QI, satisfaction personnelle, si la personne est suspecte ou non, si elle est ouverte ou non, etc. Cette société a été responsable de la campagne électorale de Donald Trump en 2016 et a soulevé la question de la sécurité des données personnelles sur les réseaux sociaux (ROSENBERG; CONFESSORE; CADWALLADR, 2018). Dans un autre rapport, nous parlons de l’existence de bots dans[3] le cybermonde, capables de diriger des informations spécifiques vers des groupes spécifiques, influençant une élection (PATTERSON, 2018). Avec cette information, on s’inquiète de plus en plus de la douceur des élections dans le monde. Au Brésil, par exemple, il y a eu le scandale de l’utilisation d’un dispositif appelé « ervice de renforcement du conten » qui aurait été utilisé par le candidat à la présidence de l’époque, Jair Bolsonaro, dans la diffusion de Fake News (PERON; MARTINS, 2018), un autre sujet qui sera exploré dans ce travail.

Un principe inhérent à l’État démocratique de droit est le principe de lisura électorale, défini par Ramayana (2015, p.31) comme : « La garantie de la douceur des élections nourrit un sentiment particulier de protection des droits fondamentaux de la citoyenneté (citoyen-électeur), ainsi que trouve un fondement juridique-constitutionnel dans les arts. 1, point II et 14 §9 de la Loi fondamentale. » Ce principe constitutionnel vise à assurer la participation du peuple au choix de ses représentants librement et honnêtement. La justice électorale est chargée de permettre l’expression de la volonté des électeurs, d’opérationnaliser toutes les procédures électorales afin qu’elles se développent en harmonie et en transparence, sans être entravées par la souveraineté du peuple (VELLOSO; AGRA, 2016). Il est donc extrêmement important d’explorer les moyens de manipulation des données existants dans les plates-formes numériques actuelles afin qu’il puisse réfléchir à la responsabilité de la justice électorale dans l’utilisation des réseaux sociaux à des fins de propagande politique. À cette fin, des articles récents seront étudiés qui traitent de diverses formes de manipulation des données et de leurs résultats aux élections et de la façon dont d’autres pays discutent de ce sujet afin de réfléchir à la fiabilité des plates-formes numériques pour les publicités politiques.

L’œuvre partira de l’exposition d’articles et de documents scientifiques tels que des livres et des rapports, qui montrent la manipulation des données personnelles dans le monde virtuel, afin de montrer l’existence de mécanismes capables de diriger des informations spécifiques vers un public cible susceptible d’influencer le résultat des élections, ce qui porterait atteinte à la garantie constitutionnelle fondamentale du droit au libre choix du vote. Basé sur des prémisses de base telles que la démocratie, les principes constitutionnels de la loi électorale et les fonctions de la justice électorale brésilienne, la nouvelle formulation donnée à l’art. 57-C de la loi n° 9 504/1997 (formulation donnée par la loi n° 13 488, 2017) qui a permis l’utilisation de plates-formes numériques dans les publicités électorales lors des dernières élections, permettant une réflexion sur la responsabilité de la justice électorale dans l’utilisation des plateformes numériques et les conséquences pour les campagnes électorales et la démocratie brésilienne.

2. LES PLATEFORMES NUMÉRIQUES ET LEURS DANGERS

Les plateformes numériques ont vu le jour avec la promesse de rassembler les gens et de promouvoir des « façons plus égalitaires de se rencontrer et de discuter [qualquer assunto] ». Les médias on-line ont profondément changé la façon dont les gens communiquent, débattent et forment des opinions. Les plateformes numériques sont organisées par des processus complexes en cascade. Ainsi, l’actualité se répand comme un « feu sauvage sur les réseaux sociaux » grâce à des connexions directes entre les lecteurs et les producteurs d’information, ce qui rend de plus en plus difficile la distinction entre eux. Cependant, ce phénomène a changé la façon dont la société compose ses récits sur le monde commun (TÖRNBERG, 2018, p.1).

Peter Törnberg, du département de sociologie de l’Université d’Amsterdam, explique :

Malgré l’optimisme initial à l’égard de ce lieu de rencontre apparemment décentralisé et démocratique, le monde on-line semble de moins en moins être une table commune qui nous rassemble pour discuter et identifier librement les problèmes de la société dans un nouveau type de sphère publique. Au lieu de cela, il semble apporter le pire des instincts humains: nous nous groupons en tribus qui nous réconfortent avec réaffirmation, et nous protéger des désaccords; sont des echo chambers[4] qui renforcent la perspective existante et favorisent les biais de confirmation. La technologie qui a été faite pour aider à tisser davantage les liens entre les êtres humains semble avoir conduit à une usure de notre tissu social que nous sommes divisés en groupes sociaux avec des visions du monde distinctes. (TÖRNBERG, 2018, p.1).

L’Internet est apparu comme une source de connaissances facilement accessibles, mais au fil du temps, la qualité et la crédibilité de l’information est considérablement réduite. Il existe de plus en plus « un climat d’information caractérisé par des récits préjudiciables, de fausses nouvelles, des théories du complot, de la méfiance et de la paranoïa » (TÖRNBERG, 2018, p.2). Le monde numérique est devenu un terrain fertile pour la croissance de la désinformation. Des études montrent que les fausses nouvelles se propagent plus vite et plus loin que les vraies nouvelles sur les réseaux sociaux. Selon M. Törnberg, ce phénomène peut affecter des aspects pertinents de la vie d’un citoyen dans tous les domaines. Ainsi, cette désinformation peut même compromettre le résultat d’une élection, étant un risque non seulement pour la société humaine, comme l’affirme l’auteur, mais une menace pour la démocratie d’un pays.

Apparemment, il ya un lien entre les echo chambers et la propagation de la désinformation que ces groupes homogènes d’utilisateurs, avec une préférence pour l’auto-confirmation, semblent fournir des serres pour le changement de rumeurs et de désinformation à se propager. Avec un espace numérique polarisé, les utilisateurs ont tendance à promouvoir leurs récits préférés, formant des groupes polarisés et résistant à l’information qui n’est pas conforme à leurs croyances (TÖRNBERG, 2018, p.2). Formant ainsi des armées de partisans de certains produits ou marques et même des armées de présidents (ou de candidats à) qui sont rapidement mobilisés. Cela peut signifier que les echo chambers rendent les fausses nouvelles plus virales, puisque les informations qui résonnent avec les groupes d’utilisateurs biaisés sont plus susceptibles de se propager sur un réseau (TÖRNBERG, 2018, p.3).

L’étude de Törnberg suggère dans sa conclusion que le simple regroupement d’utilisateurs ayant la même vision du monde est suffisant pour affecter la viralité de l’information. Cela suggère que ce ne sont pas seulement les algorithmes qui filtrent les nouvelles, les affectant, mais le fait que les médias sociaux permet cette dynamique de regroupements, change également la dynamique de la viralité. Cela fait partie de la grande question de savoir comment les médias sociaux ont affecté les processus politiques et sociaux (TÖRNBERG, 2018, p.16-17).

2.1 INTELLIGENCE ARTIFICIELLE SUR LES PLATEFORMES NUMÉRIQUES

Il existe de nombreuses façons d’utiliser l’intelligence artificielle, dont deux sont plus appropriés à ce travail, qui cherche à analyser la fiabilité des plates-formes: softwares qui identifie le profil de l’utilisateur et les bots qui interagissent dans le monde virtuel.

2.1.1 IDENTIFICATION DU PROFIL DE L’UTILISATEUR

À l’ère de l’algorithme, Facebook lui-même et Google font des sélections par les gens, qu’ils soient liés au choix des produits, des voyages ou des candidats à la présidence. Les algorithmes en savent beaucoup sur leurs utilisateurs, et avec l’émergence de l’intelligence artificielle, ils ont tendance à s’améliorer énormément. Ils apprennent et apprennent beaucoup sur chacun et seront, s’ils ne sont plus, en mesure de savoir ce que chaque personne veut ou ce qu’ils voudront, mieux qu’eux-mêmes. Ils connaîtront même leurs émotions et pourront imiter les émotions humaines par eux-mêmes (SUNSTEIN, 2017, p. 13). Actuellement, un algorithme qui apprend un peu sur une personne peut découvrir et dire ce que les gens comme eux ont tendance à aimer. Robert Sunstein, professeur à la Faculté de droit de l’Université Harvard, explique :

En fait, ça arrive tous les jours. Si l’algorithme sait que vous aimez certains types de musique, il peut savoir, avec une forte probabilité, quels types de films et de livres que vous aimez et quels candidats politiques vous s’il vous plaît. Et si vous savez quels sites Web vous visitez, vous pouvez savoir quels produits vous êtes susceptible d’acheter et ce que vous pensez du changement climatique et de l’immigration. Un petit exemple : Facebook connaît probablement vos convictions politiques et peut en informer d’autres, y compris les candidats à une charge publique. Il classe ses utilisateurs comme très conservateurs, conservateurs, modérés, libéraux et très libéraux (SUNSTEIN, 2017, p. 13).

Sunstein explique que Facebook classe ses utilisateurs politiquement en voyant les pages qu’ils aiment et déclare qu’il est facile de créer un profil politique lorsque l’utilisateur aime certaines opinions, mais pas des autres. Si l’utilisateur mentionne certains candidats favorablement ou défavorablement, la catégorisation est encore plus facile. Et le plus effrayant, c’est que Facebook ne cache pas ce qu’il fait. « Sur la page Préférences publicitaires sur Facebook, vous pouvez rechercher ‘Interests’, puis ‘Plus’, ‘Style de vie et culture’, et enfin ‘U.S. Politics’, et la[5] catégorisation apparaîtra » (SUNSTEIN, 2017, p. 13). L’apprentissage automatique peut être utilisé pour produire des distinctions raffinées, dit le professeur, comme l’opinion des utilisateurs sur les questions de sécurité publique, l’environnement, l’immigration et l’égalité. Il ajoute : « Pour le dire doucement, cette information peut être utile à d’autres – directeurs de campagne, annonceurs, collecteurs de fonds et menteurs, y compris les extrémistes politiques » (SUNSTEIN, 2017, p. 13).

En outre, les hashtags peuvent être considérés: #elenão, #partiu, #tbt, #lulalivre, #foratemer, #elesim #EuApoioaLavaJato. Vous pouvez trouver un grand nombre d’articles qui intéressent l’utilisateur ou qui correspondent (et même renforcer) leurs convictions. « ‘idée du hashtag est de permettre aux gens de trouver des tweets et des informations qui les intéressent. Il s’agit d’un mécanisme de classification simple et rapide » (SUNSTEIN, 2017, p. 14). Il y a une grande performance des soi-disant « entrepreneurs du hashtag » ; qui créent ou diffusent des hashtags comme un moyen de promouvoir des idées, des perspectives, des produits, des personnes ou des faits supposés. Cela augmente la commodité, l’apprentissage et le divertissement. Après tout, presque personne ne veut voir des annonces pour les produits qui ne les intéressent pas. Cependant, l’architecture de ce contrôle a un sérieux désavantage, soulevant des questions fondamentales sur la liberté et la démocratie (SUNSTEIN, 2017, p. 14). De ce nombre, le professeur s’interroge sur les conditions sociales préalables à la liberté individuelle et au bon fonctionnement d’un système démocratique :

Le simple hasard pourrait-il être important, même si les utilisateurs n’en veulent pas ? Un univers de communication parfaitement contrôlé – un feed personnalisé – pourrait-il être une sorte de dystopie elle-même ? Comment les médias sociaux, l’explosion des options de communication, l’apprentissage automatique et l’intelligence artificielle peuvent-ils changer la capacité des citoyens à se gouverner eux-mêmes ? (SUNSTEIN, 2017, p. 14,).

Sunstein conclut que ces questions sont étroitement liées et préconise une architecture numérique de sérendipité. Le hasard empêcherait l’intelligence artificielle d’utiliser les données personnelles des utilisateurs pour améliorer leur expérience on-line. En n’obtenant pas ces informations axées sur le marketing, il n’y aura pas de données personnelles à utiliser pour manipuler les intérêts politiques. Cette mesure serait « au bénéfice de la vie individuelle, des comportements de groupe et de la démocratie elle-même » (SUNSTEIN, 2017, p. 16). Dans la mesure où les fournisseurs sont en mesure de créer quelque chose comme des expériences personnalisées ou des communautés fermées pour chaque utilisateur, ou des sujets préférés et des groupes préférés, il est important que la prudence soit exercée. « L’auto-isolation et la personnalisation sont des solutions à certains problèmes réels, mais elles diffusent aussi des mensonges et favorisent la polarisation et la fragmentation » (SUNSTEIN, 2017, p. 17). Il s’agit d’une clarification importante lors de l’analyse de la nature de la liberté, à la fois personnelle et politique, et le type de communication numérique qui répond le mieux à un ordre démocratique.

2.1.2 INTERAGIR AVEC L’UTILISATEUR

Dans une autre étude, menée au Center for Information and Communication Technology de la Fondation Bruno Kessler en Italie, elle a été analysée, « u niveau microscopique, comment les interactions sociales peuvent conduire à de nouveaux phénomènes mondiaux tels que la ségrégation sociale, la diffusion de l’information et du comportemen »(STELLA; FERRARA; DOMENICO, 2018, p.1). Les auteurs affirment que les systèmes numériques ne sont pas seulement peuplés par des humains, mais aussi par des bots, qui sont des agents contrôlés par des logiciels à des fins spécifiques allant de l’envoi de messages automatisés à même la prise de comportements sociaux ou antisociaux spécifiques. Ainsi, les bots peuvent affecter la structure et la fonction d’un système social (STELLA; FERRARA; DOMENICO, 2018, p.1).

Mais comment les bots peuvent-ils interagir avec les utilisateurs ? Grassi Amaro, ph.d., professeur à FGV explique :

Les bots sont utilisés sur les réseaux sociaux pour propager des informations fausses et malveillantes, ou générer un débat artificiel. Pour ce faire, ils doivent avoir le plus d’adeptes possible (GRASSI et al., 2017, p.12)[…]. De cette façon, les robots ajoutent un grand nombre de personnes en même temps et suivent de vraies pages de personnes célèbres, en plus de suivre et d’être suivis par un grand nombre de bots, de sorte qu’ils finissent par créer des communautés mixtes – qui comprennent des profils réels et faux (FERRARA et al., 2016 apud GRASSI et al., 2017, p.12).

Certains bots ont des mécanismes pour imiter le comportement humain, pour être reconnu comme tel, à la fois par les utilisateurs et d’autres bots. D’autres ne visent qu’à détourner l’attention sur un thème donné (GRASSI et al., 2017, p.12). Avec l’apprentissage automatique, le système peut identifier les humains et les robots par le biais du comportement de profil, comme en tenant compte « que les utilisateurs réels passent plus de temps sur le réseau d’échanger des messages et de visiter le contenu d’autres utilisateurs, tels que des photos et des vidéos, tandis que les comptes robot passer du temps à rechercher des profils et l’envoi de demandes d’amis » (GRASSI et al. , 2017, p.14).

Connaissant le profil de chaque utilisateur et sachant comment interagir avec eux, les bots peuvent être utilisés pour influencer les pensées, les actions et même initier des mouvements sociaux et politiques. Il est donc important de comprendre le rôle de l’intelligence artificielle dans les affaires politiques, et par conséquent dans le processus électoral démocratique.

2.2 FAKE NEWS

Fake News est déjà devenu un terme connu au Brésil, cependant, il est important de mettre en évidence sa définition et son explication. Selon Ruediger et Grassi:

Fake News, ou notícias falsas en portugais, est devenu une expression couramment adoptée pour identifier la divulgation de fausses informations, en particulier sur Internet. Cependant, les évolutions de ce phénomène dans la société en réseau ont montré que le terme n’est pas en mesure d’expliquer la complexité de ses pratiques, devenant, à de nombreuses reprises, un instrument d’un discours politique qui bénéficie d’une telle simplification. (RUEDIGER; GRASSI, 2018a, p.8)

Au Brésil, l’étude de fgv dapp montre que les bots ” cherchent à créer de fausses discussions et à s’immiscer dans les débats ” en créant de la désinformation qui peut interférer dans les processus électoraux et démocratiques. L’étude montre que l’émergence de comptes automatisés a permis des stratégies de manipulation par le biais de rumeurs et de diffamation. En plus des robots, des cyborgs (comptes partiellement automatisés) (RUEDIGER) ont également été identifiés; GRASSI, 2018, p.12).

Des études sur l’influence de Fake News dans l’élection américaine ont indiqué qu’une personne sur quatre a été exposée à de fausses rumeurs. Cependant, ces nouvelles ne représentaient que 2,6% de l’univers de l’information et 60% des visites à ces rapports ont été transmises à l’électorat avec un parti pris plus conservateur, qui représentait 10% de l’électorat. Même si les fausses nouvelles n’ont pas un nombre significatif dans le corpus des nouvelles électorales, elles ont été en mesure d’influencer le système politique et d’accentuer la polarisation politique. L’utilisation de fausses nouvelles fabriquées est un phénomène ancien, mais les réseaux sociaux et les progrès technologiques ont porté la désinformation à un niveau jamais vu auparavant (DELMAZO; VALENTE, 2018 apud RUEDIGER; GRASSI, 2018, p.13).

Les Fake News ont un pouvoir dévastateur, et a déjà attiré l’attention de la justice électorale, qui préfère utiliser le terme de « désinformation ». Cependant, les fausses nouvelles, surtout en période électorale, ont toujours eu lieu. Le plus grand danger réside dans les logiciels et les programmes qui identifient les cibles idéales pour recevoir cette désinformation. Ainsi que les bots, qui aident à la formation de echo chambers permettant une plus grande diffusion de Fake News.

3. L’INTELLIGENCE ARTIFICIELLE ET SON RÔLE INFLUENT DANS LES ÉLECTIONS

Selon une expérience menée à l’Université d’Oxford, en collaboration avec l’Alan Turing Institute et le Département d’économie politique de l’Université Kings à Londres en 2017, le comportement politique se produit de plus en plus sur les plateformes numériques, où les gens sont présentés avec une variété d’informations sociales. (HALE et al, 2017, p.1).

Cette expérience visait à comprendre comment l’« information sociale » façonne la participation politique des électeurs. Il explique que l’information sociale est ce que les gens font, ou ont fait, à la fois dans le monde numérique et dans le monde réel et a une longue histoire en psychologie sociale. Cependant, il est difficile d’observer ce qu’un grand nombre de personnes font off-line. D’autre part, dans le monde numérique, « de nombreuses plateformes on-line indiquent clairement combien de personnes ont aimé, suivi, retweeté, signé des pétitions ou pris diverses mesures ». (HALE et al, 2017, p.2)

L’étude conclut que la structure des plates-formes numériques peut avoir des effets significatifs sur les comportements politiques des utilisateurs. De même, l’étude suggère que l’information sociale peut « exacerber les turbulences de la mobilisation politique » (HALE et al, 2017, p.16).

En 2012, une autre étude a été publiée par le Département de science politique de l’Université de Californie (États-Unis). L’expérience a été menée de manière contrôlée à travers des messages de mobilisation politique livrés à 61 millions d’utilisateurs de Facebook lors des élections du Congrès américain de 2010. (BOND, 2012, p.1):

« Les résultats montrent que les messages ont directement influencé l’expression politique de soi, la recherche d’informations et le comportement électoral réel de millions de personnes. En outre, les messages ont influencé non seulement les utilisateurs qui les ont reçus, mais aussi les amis des utilisateurs et les amis d’amis. L’effet de la transmission sociale sur le vote réel était plus grand que l’effet direct des messages eux-mêmes, et presque toute la diffusion s’est produite parmi des « amis proches » qui étaient plus susceptibles d’avoir une relation en face-à-face. Ces résultats suggèrent que des liens forts sont essentiels à la diffusion des comportements on-line et du monde réel sur les réseaux sociaux humains. (BOND, 2012, p.1).

Les résultats de cette étude ont de nombreuses implications. La mobilisation politique dans le réseau fonctionne en provoquant l’expression politique de soi, et aussi en induisant la collecte d’informations sociales. Il a également été démontré que la mobilisation sociale dans les réseaux on-line est nettement plus efficace que la mobilisation informationnelle. Le fait que l’information vue on-line à partir de visages familiers peut considérablement améliorer l’efficacité d’un message de mobilisation. Outre les effets directs de la mobilisation on-line, il a été démontré que l’importance de l’influence sociale a eu pour effet de modifier le comportement des utilisateurs (BOND, 2012, p.5).

Ainsi, en essayant d’influencer le comportement d’un utilisateur en dehors du monde numérique, il faut prêter attention « non seulement à l’effet qu’un message aura sur ceux qui le reçoivent, mais aussi à la probabilité que le message et le comportement qu’il stimule se propagent d’une personne à l’autre à travers le réseau social ». (BOND, 2012, p.5). Cette expérience suggère que la messagerie on-line peut influencer une variété de comportements off-line, et ses auteurs étaient déjà préoccupés en 2012 par la compréhension du rôle des médias sociaux dans la société. En se souvenant que :

Les sociétés sont des systèmes complexes qui ont tendance à se polariser en sous-groupes d’individus ayant des perspectives radicalement opposées. Ce phénomène se reflète – et souvent amplifié – dans les réseaux sociaux en on-line, où, cependant, les humains ne sont plus les seuls participants et coexistent avec les bots sociaux – c’est-à-dire les comptes contrôlés par logiciel (STELLA; FERRARA; DOMENICO, 2018, p.1,).

Les données ont consolidé les informations obtenues par près de 4 millions de messages Twitter générés par près d’un million d’utilisateurs. Dans cette analyse, les deux groupes polarisés d’indépendants et de constitutionnalistes ont été identifiés et les rôles structurels et émotionnels joués par les bots sociaux ont été quantifiés. Il a été démontré que les bots agissent dans des secteurs du système social pour attaquer les êtres humains influents des deux groupes. Lors de ce référendum, les indépendants ont été bombardés de contenus violents, augmentant leur exposition à des récits négatifs et incendiaires, exacerbant les conflits sociaux on-line. (SUNSTEIN, 2017, p. 7; STELLA; FERRARA; DOMENICO, 2018, p.1). Ces résultats soulignent l’importance de développer des mesures pour démasquer ces formes de manipulation sociale automatisée, car les médias sociaux peuvent profondément affecter le comportement électoral de millions de personnes :

En interférant dans le développement des débats sur les réseaux sociaux, les robots affectent directement les processus politiques et démocratiques par l’influence de l’opinion publique. Son action peut, par exemple, produire une opinion artificielle, ou une dimension irréelle d’une opinion donnée ou d’une personnalité publique, en partageant des versions d’un thème donné, qui se propagent dans le réseau comme s’il y avait, parmi la partie de la société représentée là-bas, une opinion très forte sur un sujet donné (Davis et al., 2016 apud GRASSI et al., 2017, p.14).

Il est possible que le lecteur pense que leur opinion sur un candidat particulier ne changera pas en raison de l’influence des messages produits par les bots. Cependant, la cible de ce hacking social sont des électeurs indécis. Comme l’explique Grassi et al., le partage coordonné d’une certaine opinion, il lui donne « un volume irréel influençant […] les utilisateurs indécis sur le sujet et renforçant les utilisateurs les plus radicaux dans le débat organique, étant donné l’emplacement plus fréquent des bots aux pôles du débat politique ». (2017, p.14)

3.1 CONSÉQUENCES POUR LES CAMPAGNES ÉLECTORALES

Les Fake News, les bots et les echo chambers peuvent changer le cours d’une élection, comme cela a été largement discuté et montré dans le chapitre précédent.Cambridge Analytics elle-même a utilisé la ligne suivante dans une présentation des ventes de ses services: « Nous sommes une agence de changement de comportement. Le Saint Graal des communications, c’est quand vous commencez à changer de comportement [das pessoas]. (PRIVACIDADE…, 2019)

Echo Chambers peut amener les gens à croire aux mensonges, et il peut être difficile ou impossible de les corriger. Une illustration, faite par le professeur Sunstein, est la croyance que le président Barack Obama n’est pas né aux États-Unis. En tant que mensonges, ce n’est pas le plus dommageable, mais reflète et contribue à une politique de suspicion, de méfiance et parfois de haine.

Un autre exemple, plus dommageable, est l’ensemble des mensonges qui ont contribué à produire le vote pour le « Brexit » [6] en 2016. Les fausses nouvelles sur la Turquie soi-disant faire partie de l’Union européenne et par conséquent l’ouverture du Royaume-Uni à l’immigration massive de Turcs dans le pays était essentielle à l’issue du référendum. Lors de la campagne présidentielle de 2016 aux États-Unis, les mensonges se répandent rapidement sur Facebook et sont encore partout. (SUNSTEIN, 2017, p.20; PRIVACIDADE…, 2019). Selon Sunstein , « à ce jour, les médias sociaux n’ont pas contribué à produire une guerre civile, mais ce jour viendra probablement. Ils ont déjà contribué à empêcher un coup d’État en Turquie en 2016 » (SUNSTEIN, 2017, p.20):

Il y a une question sur la liberté individuelle. Lorsque les gens ont de multiples options et la liberté de choisir entre eux, ils ont la liberté de choix, et c’est extrêmement important. La liberté exige certaines conditions de base, permettant aux gens d’élargir leurs propres horizons et d’apprendre ce qui est vrai. Elle implique non seulement la satisfaction de toutes les préférences et valeurs que les gens ont, mais aussi des circonstances favorables à la libre formation des préférences et des valeurs. Mais si les gens se qualifient dans des communautés aux vues similaires, leur propre liberté est menacée. Ils vivent dans une prison de leur propre création. (SUNSTEIN, 2017, p.20).

Lorsque les électeurs indécis ne savent pas ce qui est vrai, leurs choix peuvent être compromis pendant le processus électoral, ce qui affecterait directement la démocratie et le droit de choisir de voter, et peut même changer le résultat d’une élection.

3.2 CONSÉQUENCES AU BRÉSIL

Le processus électoral qui a eu lieu en 2018 constitue un calendrier pour comprendre l’utilisation des plateformes numériques pour la propagande électorale ainsi que pour lutter contre la diffusion de la désinformation.

3.2.1 INTERACTION AVEC LES BOTS

La Direction de l’analyse des politiques publiques[7] de la FGV (FGV-DAPP) a fait quelques études de cas pour analyser la présence de bots dans des situations politiques importantes au Brésil, telles que: le débat de Rede Globo le 2 octobre 2014 avec les candidats à la présidentielle au premier tour des élections; le débat de Rede Globo le 24 octobre 2014 avec les candidats à la présidence Dilma Rousseff et Aécio Neves, en lice pour le second tour des élections; les manifestations pro-impeachment tenues le 13 mars 2016; le débat de Rede Globo avec les candidats à la mairie de São Paulo le 29 septembre 2016; la grève générale du 28 avril 2017 et le vote sur la réforme du travail au Sénat le 11 juillet 2017 (GRASSI et al., 2017, p.16)

Le professeur FGV explique comment les données sont collectées :

Les masses de données recueillies par FGV/DAPP sont composées de métadonnées — informations sur les données elles-mêmes — et à travers elles, nous explorons les possibilités d’identifier les comptes qui ont agi automatiquement pendant les périodes des analyses. Ainsi, nous avons identifié que les métadonnées nommées générateur se réfère à la plate-forme qui génère le contenu du tweet, qui est très utile pour détecter les bots. (GRASSI et al., 2017, p.16)

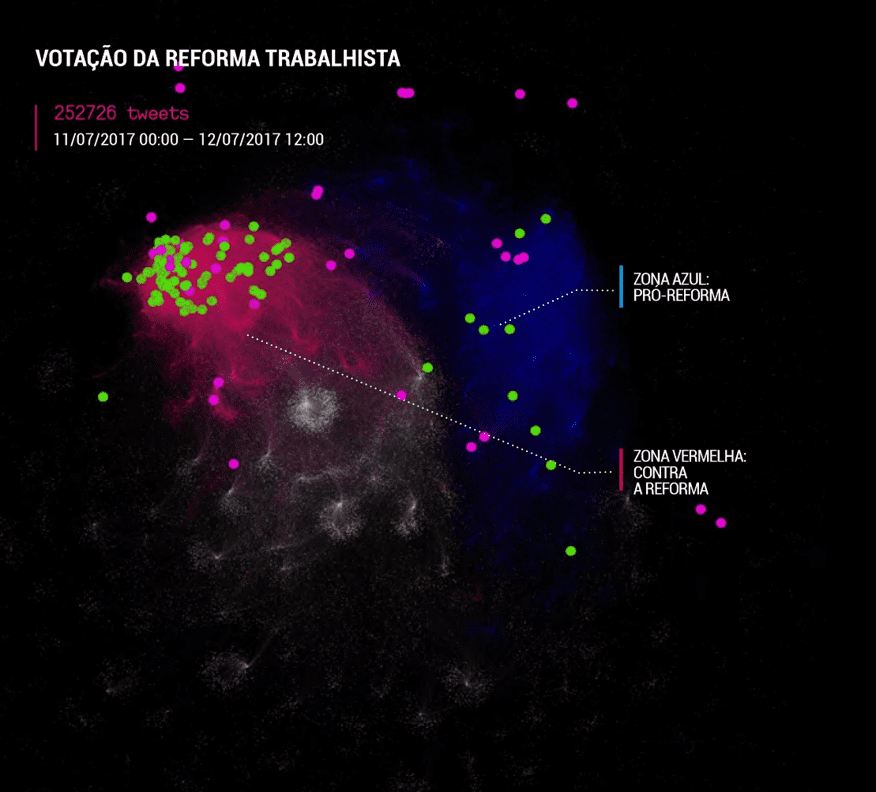

Afin d’illustrer le fonctionnement des robots en question, FGV a élaboré un graphique (FIG. 1), avec les résultats obtenus de l’analyse faite lors du vote sur la réforme du travail au Sénat. Dans le graphique, les points roses représentent des comptes qui ont utilisé des générateurs suspects (GRASSI et coll., 2017, p.17) et des points verts, des comptes qui ont généré au moins deux fois deux tweets consécutifs en moins d’une seconde (p.18). Dans ce cas, comme dans les autres, les robots sont présents aux deux extrémités du débat, « étant dans cette analyse en plus grand nombre au pôle contrairement à la réforme » (p. 23).

Figure 1 : Vote sur la réforme du travail

Ces analyses montrent que les actions automatisées des bots ont été efficaces dans la conduite du débat public, « de plus en plus présents dans les réseaux, influençant directement les moments d’inflexion et les déterminants pour l’avenir ». (GRASSI et al., 2017, p.26).

En raison du succès de cette étude, intitulée Robôs, Redes Sociais e Política No Brasil, qui a détecté la présence de bots sur Twitter (GRASSI et al., 2017), FGV DAPP a été invité à participer au Conseil consultatif sur Internet et les élections[9] de la Cour électorale supérieure (TSE). (RUEDIGER; GRASSI, 2018, p.4). En juillet 2018, la Salle de la démocratie numérique a été lancée à Rio de Janeiro, qui[10] visait à « surveiller le débat public sur le web et identifier les actions de désinformation, de menaces et d’interventions illégitimes dans le processus politique, avec la publication d’analyses quotidiennes et hebdomadaires ». FGV DAPP, à travers un hotsite[11] #observa2018, a disséqué l’analyse des réseaux. (RUEDIGER; GRASSI, 2018, p.5).

Parmi ces publications, une analyse réalisée dans la semaine du 8 au 13 août 2018, FGV DAPP « a détecté, grâce à sa propre méthodologie d’identification robotisée, la présence de 5 932 comptes automatisés dans le débat sur les élections et les candidats à la présidentielle. Ces profils ont généré 19 826 publications » (RUEDIGER, 2018, p.4) uniquement sur le réseau social Twiter:

En 2018, Facebook a annoncé des mesures pour protéger les élections au Brésil. Parmi les engagements figuraient la lutte contre la désinformation; transparence accrue de l’annonce sur la plate-forme; la suppression des comptes d’imposteurs; et la santinhos digitais numériques utilisés pour tromper les électeurs en plaçant la photo d’un candidat et le numéro de parti d’un autre. Ces mesures et d’autres ont été prises pour assurer l’authenticité du contenu publié sur la plate-forme (RUEDIGER; GRASSI, 2018a, p.16)

Mais cela ne semble pas suffisant. L’analyse Fgv-DAPP lors des campagnes électorales de 2018 montre que « les interférences promues par les robots se sont souvent produites de manière articulée et synchronisée, à partir de botnets (réseaux de robots) » (RUEDIGER; GRASSI, 2018a, p.27). Voici les résultats de l’analyse effectuée :

Au cours de la période précédant la campagne, au moins trois réseaux de robots ont été chargés de publier 1 589 tweets en une semaine. Les messages cherchaient, en général, à stimuler et/ou à démobiliser les candidatures, en particulier dans les centres d’une plus grande polarisation : Jair Bolsonaro-Lula/Haddad.

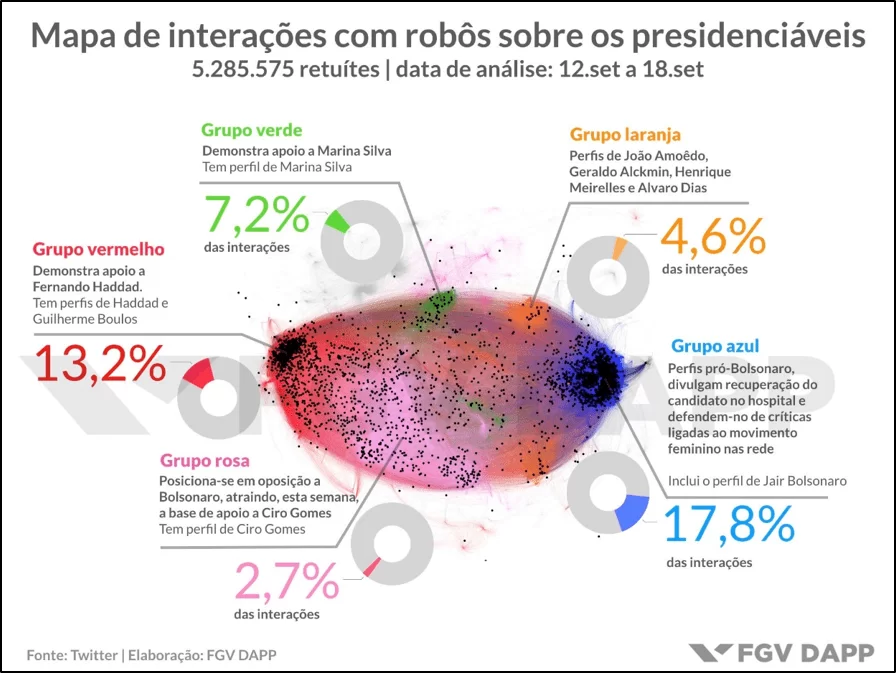

Les bases pro-Bolsonaro et pro-Fernando Haddad ont également été celles qui ont présenté le plus d’interférences de robots pendant la période de campagne. Du 12 au 18 septembre, par exemple, 7 465 611 tweets et 5 285 575 demandes ont été recueillies concernant les candidats. Dans cette base de données, la méthodologie de détection des robots de FGV DAPP a trouvé 3 198 comptes automatisés, ce qui a généré 681 980 interactions, soit 12,9 % du total des retweets graphiques ci-dessous.

A droite, les comptes automatisés représentaient 17,8% des retweets du groupe favorables au député fédéral de la LFP; a gauche, ils représentaient 13,2% des interactions alignées avec la candidature du PT et, dans une moindre mesure, la candidature de Guilherme Boulos du PSol. (RUEDIGER; GRASSI, 2018a, p.28)

Figure 2 : Interactions avec les robots lors des élections de 2018

WhatsApp a une nature de communication privée et n’a pas pu être analysé par FGV-DAPP, cependant, il a noté ce qui suit:

Compte tenu des particularités de la plate-forme, telles que la nature de la communication privée, d’une portée sociale réduite (famille, amis, collègues) et de l’interaction directe plus faible entre les influenceurs et les citoyens ordinaires, il y a eu un phénomène différent de dispersion et de viralisation du contenu politique que celui observé dans d’autres scénarios récents (nationaux et internationaux), dans lesquels Facebook et Twitter étaient plus importants. Les nombreux réseaux sociaux aujourd’hui populaires parmi les Brésiliens, largement utilisés pour débattre des élections et de la conjoncture politique, présentent des particularités concernant le processus de production et d’interaction avec le contenu. Toutefois, toutes les stratégies de propagation de l’information sont adaptées aux propriétés de chaque plate-forme, et avec cela, il existe de multiples façons de manifester la désinformation et le partage de fausses informations. Non seulement à partir de liens ou de pages qui simulent l’activité journalistique, mais avec une utilisation intensive de vidéos, tutoriels, blogs, mèmes, textes apocryphes et publications sensationnelles; différents sous-types de Fake News, par conséquent. (RUEDIGER; GRASSI, 2018a, p.29)

Bien qu’il n’ait pas été prouvé que les interactions avec les bots ou la propagation de fausses nouvelles ont modifié le résultat de l’élection présidentielle de 2018 au Brésil, il est nécessaire d’être conscient de cette possibilité. Comme cela a déjà été démontré, la défunte société Cambridge Analytics a réussi à élire le candidat de l’agence de campagne qui l’a embauché lors de l’élection présidentielle américaine de 2016.

L’actuel président de la République a été élu avec un petit temps de propagande électorale à la télévision, ce qui montre qu’il aurait été élu par sa campagne sur les plateformes sociales. Il y a eu un « changement structurel dans la façon dont les campagnes réussies ont été organisées — les réseaux sociaux sont devenus le principal axe de dialogue entre les électeurs et les élus » (RUEDIGER; GRASSI, 2018a, p.29).

D’autre part, Ruediger et Grassi font état de conséquences positives dans ce scénario numérique. Parmi eux se distinguent:

1) la plus grande demande de transparence dans les relations institutionnelles de la politique; 2) la capacité d’agir rapidement et d’interférer dans le processus décisionnel des agents de l’État et des représentants élus, par le biais d’un contact direct avec eux sur Internet;

3) et l’élargissement du rôle potentiel que le citoyen peut jouer dans la conduite des politiques publiques et des actes qui l’intéressent. L’accélération de la rétroaction et la rapidité de transmission, de partage et de production de contenu, l’amélioration de l’activité journalistique et du débat politique répondent à ces nouveaux paradigmes (2018a, p.29-30) deviennent également impératives.

3.2.2 DIFFUSION DE FAKE NEWS

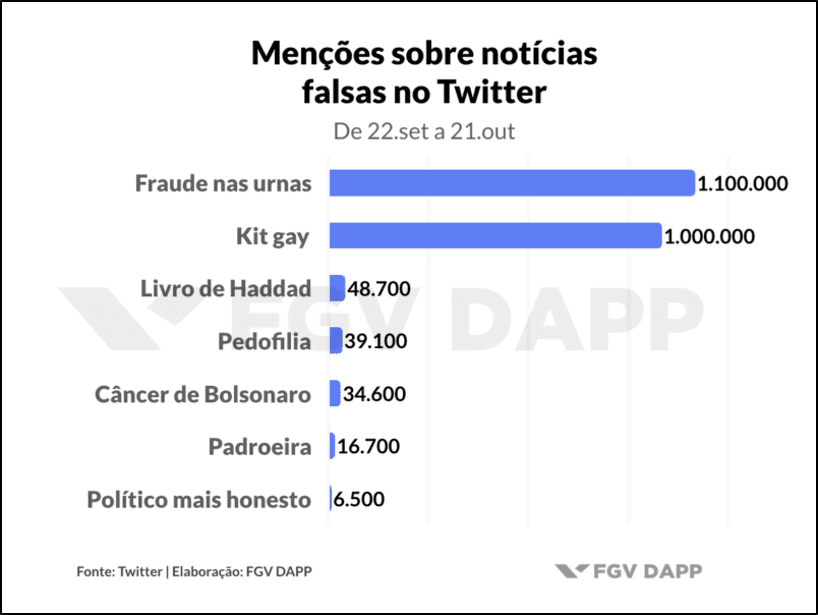

L’analyse FGV-DAPP réalisée pendant la période électorale de 2018 a conclu qu’il n’y avait « pas de distribution automatisée et massive de fausses nouvelles ». Il affirme que la désinformation était présente, « mais les robots n’étaient pas les plus responsables de sa diffusion ». Dans la semaine de l’attaque au couteau contre Bolsonaro, par exemple, seulement 0,9% des interactions ont été automatisées à partir de robots (RUEDIGER; GRASSI, 2018a, p.29). Selon l’analyse les fausses nouvelles qui se sont démarquées le plus étaient celles liées à la figue. 3:

Figure 3 : Fake News

3.3 CONSÉQUENCES POUR LA DÉMOCRATIE

En 2016, l’élection présidentielle américaine a attiré l’attention sur de nouvelles façons de faire de la politique et des campagnes politiques à travers les plateformes numériques. Les élections ont impliqué des cas de fake news qui ont eu des répercussions dans le monde entier, tels que « l’influence présumée de hackers informatiques russes qui, par l’intermédiaire de l’Internet Research Agency aurait généré de faux contenus » et atteint des millions d’électeurs via Facebook et Twitter. (RUEDIGER; GRASSI, 2018, p.12)

Avant cela, il y avait un référendum au Royaume-Uni sur son retrait de l’Union européenne. Dans les enquêtes menées entre 2017 et début 2019, il a été prouvé que la société Cambrigde Analytics et d’autres agences ont influencé le résultat des votes, orientant leurs faux messages vers un certain groupe de personnes. L’entreprise a pu profiler les électeurs à l’aide des données des utilisateurs de Facebook. Le scandale Facebook a été signalé dans le monde entier début 2018 avec la publication de données trouvées par la journaliste britannique Carole Cadwalladr (ROSENBERG; CONFESSORE; CADWALLADR, 2018) qui a depuis parlé de cette nouvelle menace pour la démocratie. Le Parlement a finalement clos ses enquêtes et publié un rapport début 2019. Il convient de souligner quelques conclusions sur l’utilisation de ces plates-formes:

La loi électorale n’est pas adaptée à son objet et doit être modifiée pour tenir compte des changements apportés aux techniques de campagne […] . Il doit y avoir : transparence absolue des campagnes politiques on-line, y compris des marques claires et persistantes sur toutes les annonces et vidéos politiques payées, indiquant la source et l’annonceur ; une catégorie introduite pour les dépenses numériques dans les campagnes; et des règles explicites concernant le rôle et les responsabilités des avocats désignés.

Les articles publicitaires politiques doivent être accessibles au public dans un référentiel consultable – qui paie pour les annonces, quelles organisations parrainent l’annonce, qui est ciblée par des annonces – afin que les membres du public puissent comprendre le comportement des annonceurs individuels. Il doit être géré indépendamment de l’industrie de la publicité et des partis politiques. (HOUSE…, 2019, p.24)

Il est à noter que « es sociétés démocratiques du monde entier ont connu ces dernières années l’émergence d’un nouvel acteur de la communication pour façonner avec succès, avec succès ou non, l’opinion publique dans les débats politiques, les élections, les référendums et les crises nationales: la désinformatio » (RUEDIGER; GRASSI, 2018a, p.4). La diffusion de campagnes de fake news sur les plateformes numériques à des moments clés de la société, ainsi que l’action de l’intelligence artificielle dans le contrôle des bots de compte automatisés, « est devenue un outil clé dans la stratégie de certains groupes pour attirer le trafic numérique, engager ou même influencer les débats, démobiliser les opposants et générer un faux soutien politique » (RUEDIGER; GRASSI, 2018a, p.4) devenant une menace majeure pour les démocraties du monde entier.

Un autre danger que les plates-formes numériques présentent à la démocratie est la facilité qui existe pour la formation de echo chambers, déjà discutées dans ce travail. Les groupes isolés augmentent la polarisation politique et la haine, donnant encore plus de carburant au fonctionnement des bots et à la propagation des fausses nouvelles.

Mais la question unificatrice sera dans toute la mesure des différents problèmes d’une société démocratique qui peut être créée par le pouvoir de filtrer. Les démocraties sont peut-être fragiles ou non, mais la polarisation peut être un problème grave, et elle est accrue si les gens résident dans différents univers de communication – comme, en fait, ils semblent parfois le faire aux États-Unis, au Royaume-Uni, en France, en Allemagne et ailleurs. Il ne fait aucun doute que l’environnement de communication moderne, y compris les médias sociaux, contribue à la montée de la partisanerie. (SUNSTEIN, 2018, p.36)

Tout groupe extrémiste, terroriste ou tout parti politique qui a les moyens de contrôler les plateformes de médias sociaux aurait alors le pouvoir de gouverner après avoir influencé une élection théoriquement démocratique, ce qui présenterait une série de menaces pour le système démocratique.

En ce sens, Carole Cadwalladr, dans le documentaire Privacidade Hackeada, lance un appel émouvant pour réfléchir sur la façon dont les réseaux sociaux peuvent être utilisés pour répandre le mal et la haine, polarisant les pays:

On dirait qu’on entre dans une nouvelle ère. Nous pouvons voir que les gouvernements autoritaires sont à la hausse. Et ils utilisent cette politique de haine et de peur sur Facebook. Regardez le Brésil. Il y a cet extrémiste de droite qui a été élu et nous savons que WhatsApp, qui fait partie de Facebook, a clairement été impliqué dans la diffusion de Fake News. Et regardez ce qui s’est passé au Myanmar. Il y a des preuves que Facebook a été utilisé pour inciter à la haine raciale qui a causé le génocide. Nous savons aussi que le gouvernement russe utilisait Facebook aux États-Unis. Il y a des preuves que les Russes ont créé de faux mèmes Black Lives Matter, et quand les gens ont cliqué dessus, il a été dirigé vers des pages où ils ont été effectivement invités à des manifestations qui ont été organisées par le gouvernement russe. Et en même temps, ils mettaient en place des pages qui ciblaient des groupes opposés, tels que Blue Lives Matter. Il s’agit de nourrir la peur et la haine pour retourner le pays contre lui-même. Diviser et conquérir. Ces plates-formes qui ont été créées pour nous connecter sont maintenant utilisées comme armes et il est impossible de savoir ce qui se passe sur les mêmes plates-formes où nous parlons à nos amis ou de partager des photos de bébés. Rien n’est ce qu’il semble » (PRIVACIDADE…, 2019, 96 min)

4. JUSTICE ÉLECTORALE AU BRÉSIL

La Justice électorale a pour champ d’application la « érité électoral », pour la réalisation de la démocratie (VELLOSO, 1996, p.9 apud VELLOSO; AGRA, 2016), cela signifie que la justice électorale est chargée de « permettre l’expression de la volonté des électeurs, d’opérationnaliser toutes les procédures électorales afin qu’elles se développent en harmonie et en transparence, sans être perturbées par la souveraineté populaire » (VELLOSO; AGRA, 2016).

La justice électorale est responsable de la discipline et de l’organisation de l’exercice du suffrage afin de réaliser la souveraineté populaire. C’est par les élections que la libre formation de la volonté de l’électeur et l’égalité entre les candidats sont garanties, assurant ainsi la démocratie brésilienne.

Art. 105 de la Loi électorale (9.504/97) dit que la Cour électorale supérieure a une fonction normative. « ous pouvez émettre toutes les instructions nécessaires à votre exécution fidèle, entendu, à l’avance, lors d’une audience publique, les délégués ou les représentants des partis politiques. » Ainsi, le TSE peut modifier des règles pour contrôler l’utilisation des plates-formes numériques pour les campagnes électorales.

4.1 RESPONSABILITÉ DE LA JUSTICE ÉLECTORALE DANS L’UTILISATION DES PLATEFORMES NUMÉRIQUES

En 2017, la TSE a modifié la loi no 9 504/1997 (libellée par la loi no 13 488, 2017), donnant une nouvelle formulation à l’art. 57 afin que les plateformes numériques telles que Facebook, Twitter et d’autres puissent être utilisées dans les campagnes électorales à partir du mois d’août de l’année électorale. Ainsi, pendant la campagne pour les élections présidentielles de 2018, beaucoup de choses ont été dites en faveur de cette méthode qui, avec peu d’investissements financiers, génère plus de résultats.

La grande analyse des médias, post-comptabilité des sondages, a porté sur la façon dont le candidat à la présidentielle ayant le plus de temps à la télévision (SHALDERS, 2018), Geraldo Alckmin (PSDB) n’a même pas été élu au second tour, tandis que le candidat élu, Jair Bolsonaro (PSL), qui n’avait que 8 secondes d’élection, a obtenu des résultats beaucoup plus élevés. Le président lui-même a souvent utilisé son espace sur les réseaux sociaux pour louer le fait que sa campagne électorale a coûté beaucoup moins cher que celle des autres candidats de haut niveau. De même, le candidat João Amoedo (partido NOVO), jusqu’ici inconnu de la plupart de la population brésilienne, a également obtenu des résultats expressifs sans participation à aucun débat promu par les chaînes de télévision et en faisant usage des médias sociaux, arrivant à la 5ème place au premier tour, devant d’autres candidats plus connus. Ainsi, les élections de 2018 ont reflété les changements dans le scénario de la campagne politique qui, à partir de ce moment, s’est également produit par le biais des plateformes numériques.

Cependant, après le scandale de Facebook et la défunte société britannique Cambridge Analytica, le monde a réalisé à quel point le marché des données personnelles peut être rentable. Au Brésil, il existe des lois qui interdisent et criminalisent l’achat de [15]votes, mais ces lois ne contiennent plus la réalité actuelle des campagnes électorales. Vous pouvez dépenser n’importe quelle somme d’argent sur les annonces sur Facebook, Google ou YouTube, et personne ne le saura, parce que ces données sont inaccessibles. Ce que vous avez, c’est la responsabilité avec la TSE, qui vous permettrait de savoir combien a été dépensé sur ces annonces, mais le contenu de la même ne sera jamais révélé. Carole Cadwalladr, dans sa présentation lors d’une conférence TED en avril de cette année, déclare :

… ce qui se passe sur Facebook reste sur Facebook, car nous seuls voyons le contenu de notre page, qui disparaît ensuite. Il est impossible de rechercher quoi que ce soit. Nous n’avons aucune idée de qui a vu quelles annonces, quel était leur impact, ou quelles données ont été utilisées pour choisir le public cible. Pas même qui a placé les annonces, combien d’argent a été dépensé, ou quelle nationalité ils étaient. (CADWALLADR, 2019)

Le nombre surprenant d’études et de données existantes montrant la relation entre l’interaction des bots influençant les utilisateurs pendant les périodes électorales montrent combien « les plates-formes devraient être attentives au respect du cadre juridique des campagnes électorales sur les réseaux sociaux » (RUEDIGER; GRASSI, 2018, p.25). À cette fin, la TSE devrait créer des normes qui devraient mieux surveiller si les plates-formes respectent les limites déjà prévues par la loi. Il incombe à la Cour d’assurer la douceur des élections et de protéger la démocratie. Ruediger suggère en outre:

… le volume surprenant d’interactions de candidatures, sur Twitter, Facebook, YouTube et Instagram, indique que les plates-formes doivent être attentives au respect du cadre juridique des campagnes électorales sur les réseaux sociaux pour, en parallèle, maintenir les appels des utilisateurs à leurs politiques et normes (RUEDIGER; GRASSI, 2018, p.25).

Le TSE ne devrait pas autoriser les campagnes électorales sur ces plates-formes inaccessibles et impossibles à surveiller. Il n’y a aucun moyen de surveiller la manipulation possible d’un public cible particulier par des annonces à cette fin. Ainsi, des règles doivent être mises en place pour forcer les plates-formes sociales à faire ce qui a été suggéré par le rapport du Parlement britannique cité ci-dessus, en identifiant les auteurs de publications ayant un contenu électoral.

Caldas e Caldas expliquent ce qui a été fait, par rapport à ce thème, dans d’autres parties du monde:

En ce sens, l’Union européenne a créé le 25 mai 2018 le Règlement général sur la protection des données (COMMISSION EUROPÉENNE, 2018) à la suite d’études indiquant que la propagation des fake news a été faite à partir de l’analyse des données des utilisateurs (MARTENS et al., 2018 apud CALDAS; CALDAS, p.214, 2019). En ce sens, le 11 juin 2018, le Conseil national des droits de l’homme a approuvé la recommandation no 04 du 11 juin 2018, qui traite « des mesures de lutte contre les fausses nouvelles et la garantie du droit à la liberté d’expression » (BRASIL, 2018b apud CALDAS; CALDAS, p.214, 2019), qui recommande l’approbation d’un projet de loi visant à la protection des données à caractère personnel (BRASIL, 2018e apud CALDAS; CALDAS, p.214, 2019), considérant que « la production et le ciblage de soi-disant fake news aujourd’hui sont directement liés à la collecte et au traitement massifs et aveugles des données personnelles » (BRASIL, 2018b apud CALDAS; CALDAS, p.214, 2019) (CALDAS; CALDAS, p.214, 2019).

5. COMMENT LE TSE TRAITE CETTE QUESTION DEPUIS LES ÉLECTIONS DE 2018

En mai 2019, le TSE a organisé un séminaire international sur les fake news et les élections en collaboration avec l’Union européenne. Le séminaire s’est tenu à Brasilia et a eu plusieurs orateurs, parmi eux: la ministre Rosa Weber, président de la Cour électorale supérieure (TSE), le ministre Luiz Fux, vice-président de la Cour fédérale suprême (STF) et le ministre Sergio Moro, ministre de la Justice et de la Sécurité publique.

Selon le site web de la TSE sur le séminaire:

Au cours de l’année 2018, le Conseil consultatif sur l’Internet et les élections, créé par la Cour électorale supérieure (TSE) le 7 décembre 2017, a développé de nombreuses activités liées à l’influence d’Internet dans les élections, notamment en ce qui concerne le risque de fake news et l’utilisation de robots dans la diffusion de l’information, actions qui ont contribué à l’expansion de la connaissance de la justice électorale face au thème , afin non seulement d’empêcher mais aussi de faciliter la confrontation du grave problème lié à la diffusion de fausses nouvelles lors des élections générales de 2018. (BRASIL, 2019f).

Toujours sur le Séminaire, le TSE reconnaît sa responsabilité première dans la protection de la démocratie brésilienne lorsqu’elle déclare :

Compte tenu de l’équation complexe du phénomène connu sous le nom de Fake News, dans toutes les branches de la société, tant au Brésil qu’à l’étranger, il appartient à la Justice électorale de garder un œil sur le problème, orienté pour trouver des moyens plus efficaces de faire face aux prochaines élections. (BRASIL, 2019f).

L’objectif principal du séminaire était de trouver des moyens de prévenir ou de minimiser la diffusion de fausses nouvelles aux élections municipales de 2020, en tenant compte de l’expérience acquise lors des élections de 2018. Ainsi, il était destiné à compiler les données, partager des expériences, des suggestions bienvenues, discuter des mesures viables pour lutter contre les fausses nouvelles, ainsi que de promouvoir une source d’études et de propositions à transmettre à la Cour électorale et au Congrès national (BRASIL, 2019f).

En février de cette année, l’ordonnance no 115 a été publiée sur le portail de l’EST, qui « établit un groupe de travail chargé de mener des études pour identifier les conflits dans la norme actuelle découlant des réformes électorales et proposer la systématisation respective » (BRASIL, 2019a). De cette ordonnance est née Diálogos para a construção da Sistematização das Normas Eleitorais, estudos preliminares dans le but de:

… identifier et systématiser la législation pertinente, en soulignant les incohérences, les omissions et/ou la surréglementation, avec la Constitution fédérale comme paramètre et à partir des textes législatifs, résolutions et même discussions jurisprudentielles, afin d’avoir en conséquence un texte plus concis, cohérent et plus complet à la réalité actuelle de la démocratie brésilienne. » (BRASIL, 2019, p.3).

Il souligne également la nécessité d’une « attention particulière, par exemple, aux questions qui nécessitent une convergence entre la loi électorale, la technologie et le marketing numérique », citant également la « possibilité de coups de pouce, utilisés pour la première fois aux élections générales de 2018 » (BRASIL, 2019, p.3). Grâce à cette étude, on peut voir que le TSE est déjà en train d’analyser le problème des boosts et des bots utilisés par les médias sociaux.

La loi 9.504/97, qui a fait l’objet d’une mini-réforme en 2017 autorisant l’utilisation des plateformes numériques dans les publicités électorales, présente encore plusieurs incohérences. Selon la loi, le coup de pouce est interdit aux individus et limité aux candidats ou aux coalitions. Ainsi, caldas e Caldas (p. 213, 2019) état:

… les experts en droit électoral évaluent :

Avec le coup de pouce payé, des échappatoires sont ouvertes pour les abus illicites de pouvoir économique, l’abus de pouvoir politique, les abus des médias, la propagande interdite (menée par les églises, les syndicats et les personnes morales en général), les fake news, entre autres actes illicites possibles. Certains de ces illégaux peuvent entraîner la destitution de l’enregistrement de la demande, le diplôme (s’il est élu) et la perte du mandat. (ALMEIDA; LOURA JUNIOR, 2018 apud CALDAS e CALDAS)

Le texte original avait dans son art. 57-B, §6 disposition qui prévoyait des mesures plus efficaces pour empêcher les fake news pendant les élections. Cependant, le même a été opposé par le président de la République de l’époque Michel Temer. Le texte du §6 initialement prévu (CALDAS e CALDAS, p. 213, 2019) :

La dénonciation de propos haineux, la diffusion de fausses informations ou d’infractions au détriment d’un parti ou d’un candidat, faite par l’utilisateur d’une application ou d’un réseau social sur Internet, par le biais du canal mis à disposition à cette fin dans le fournisseur lui-même, entraînera une suspension maximale de la publication déclarée d’un maximum de vingt-quatre heures jusqu’à ce que le fournisseur s’assure que l’identification personnelle de l’utilisateur a été publiée , sans fournir de données provenant du dénonciateur signalé, sauf par ordonnance du tribunal. (BRASIL, 2017, Grifo nosso apud CALDAS e CALDAS).

La justification du veto, selon Caldas e Caldas, est l’existence de « la crainte qu’une législation pour sévir contre les fausses nouvelles puisse générer une restriction à la liberté d’expression », en particulier fake news un scénario « polarisation politique intense, dans laquelle les passions politiques font disparaître la frontière entre la vérité, le point objectif et le point subjectif ». (CALDAS et CALDAS, p. 214, 2019)

Conclure Caldas et Caldas que, malgré l’art. 25 de la résolution n° 23 551/2017 de l’EST contiennent « un dispositif pour tenter d’empêcher la propagation de fausses nouvelles… la rapidité de la justice ne suffira probablement pas à prévenir cet événement… précisément parce que sa caractéristique est la vitesse de propagation. (CALDAS et CALDAS, p. 214, 2019).

On se rend compte qu’il ne sera pas facile de trouver une solution plausible. Toute mesure plus drastique d’inhiber les fake news ou d’empêcher certaines façons d’utiliser les plateformes numériques sera éventuellement confrontée à la liberté d’expression. Un paradoxe difficile à résoudre. Toutefois, la Cour a pris certaines mesures.

Le portail TSE et ses pages sur les réseaux sociaux, ont des vidéos illustratives et éducatives sur « les mythes dans les élections » et même des conseils pour les électeurs de ne pas perdre le titre d’électeur. Cependant, il n’y a pas eu de vidéo jusqu’en septembre de cette année, alertant et sensibilisant les électeurs au danger des fake news. La TSE a ensuite commencé à diffuser début septembre, sur sa chaîne YouTube,[16] la série vidéo Coping with Disinformation »[17] (BRASIL, 2019b). Cette série, à ce jour (21 octobre 2019), a 6 vidéos expliquant l’efficacité et la rapidité avec laquelle le TSE a été en résolution de la question des fake news sur le fonctionnement des machines à voter électroniques, et aussi apprendre à l’électeur de ne pas utiliser le terme fake news, pour avoir un sens péjoratif et non concret, selon les experts interrogés dans les vidéos. En outre, selon eux, le terme est ambigu, imprécis et disqualifie la presse, étant utilisé par les politiciens à cette fin. Il est donc recommandé d’utiliser le terme « désinformation ».

Comme on peut le voir, les vidéos produites par le TSE félicitent le tribunal lui-même en indiquant à quelle vitesse la Cour a agi dans la lutte contre la désinformation, en plus d’expliquer pourquoi l’utilisation du terme fake news est erronée. Bien qu’ils aient quelques secondes de conseils sur la façon de réduire la désinformation, les vidéos ne sont pas ponctuelles en clarifiant à l’électeur sur l’existence de comptes automatisés avec influenceur potentiel dans l’opinion publique, expliquant par exemple, le fonctionnement des bots. À aucun moment, les vidéos produites par la Cour ne précisent l’électeur sur les conséquences que la désinformation peut apporter au résultat d’une élection. En plus de ne pas être disponible dans un endroit de connaissance facile de l’électeur. Combien d’électeurs regarderont ces vidéos? Jusqu’à présent, il n’y a même pas 500 vues d’entre eux.

Dans une autre tentative d’empêcher la propagation des fake news, cette année 2019, le Pouvoir législatif a ajouté de l’art. 326-A à la loi 4.737/65 (Code électoral) en verbis:

Art. 326a. Donner lieu à l’ouverture d’une enquête policière, d’une procédure judiciaire, d’une enquête administrative, d’une enquête civile ou d’une inconduite administrative, attribuant à quelqu’un la commission d’un crime ou d’une infraction dont il est innocent, à des fins électorales:

Peine – emprisonnement, de 2 (deux) à 8 (huit) ans, et amende.

§ 1 – La pénalité est augmentée à partir de la sixième partie, si l’agent utilise l’anonymat ou le nom supposé.

§ 2 – La peine est réduite de moitié, si l’imputation est une pratique de délit.

§ 3 – Les mêmes sanctions de cet article sont imposées par ceux qui, prouvés être conscients de l’innocence de l’accusé et à des fins électorales, divulguent ou proposent, par quelque moyen ou forme que ce soit, l’acte ou le fait qui lui a été attribué à tor[18]t. (BRASIL, 1965)

Le Président de la République a opposé son veto au § 3 en affirmant que « la conduite de la calomnie dans un but électoral est déjà caractérisée par une autre disposition [com] du Code électoral de six mois à deux ans », ce qui porter atteinte au « principe de proportionnalité ». Cependant, le veto a été annulé par le Congrès en août 2019, ce qui a caractérisé un autre crime électoral. (Congresso…, 2019).

Toujours en août, le TSE a lancé le Programa de Enfrentamento à Desinformação com Foco nas Eleições 2020. Comme expliqué sur le site Web de la Cour :

Le programme a été organisé en six axes thématiques. La première, « organisation interne », vise l’intégration et la coordination entre les niveaux et les domaines qui composent la structure organisationnelle de la justice électorale et la définition des attributions respectives contre la désinformation.

Un autre axe sur lequel sera travaillé est « l’éducation aux médias et à l’information », qui vise à donner aux gens les moyens d’identifier et de vérifier une désinformation, en plus de stimuler la compréhension du processus électoral.

Sur le thème « Confinement à la désinformation », l’idée est d’instituer des mesures concrètes pour décourager les actions de prolifération de fausses informations. Avec l’axe ” Identification et vérification de la désinformation « , le TSE entend rechercher l’amélioration et de nouvelles méthodes d’identification des pratiques possibles de diffusion de contenus fallacieux.

Les axes « Amélioration du système juridique » et « Amélioration des ressources technologiques » font également partie du programme lancé par la TSE.

Avant la signature du mandat d’adhésion, la ministre Rosa Weber a annoncé le lancement d’un site Web qui recueillera[19] des informations sur la désinformation et aussi un livre qui est le résultat des débats qui ont eu lieu au Séminaire international Fake News and Elections, qui s’est tenu en mai de cette année, dans le TSE. Les travaux sont disponibles sur le portail de la Cou[20]r. (BRASIL, 2019e)

Le 22 octobre de cette année, Google, Facebook, Twitter et WhatsApp ont rejoint le programme. À l’époque, la ministre Rosa Weber « a qualifié de nuisible l’effet causé par la désinformation à la démocratie, au processus électoral et à la société en général ». Et il a déclaré que l’objectif du programme « est de provoquer l’implication de toutes les sphères sociales dans la lutte contre la diffusion d’informations trompeuses sur Internet. » (BRASIL, 2019c). Il a également déclaré que ces entreprises ont la capacité d’améliorer les technologies qui identifient « ‘utilisation abusive de bots et d’autres outils automatisés de diffusion de contenu. » Le Président de la TSE a conclu son discours par le désir suivant :

J’espère que nous pourrons atteindre la fin des élections de 2020, convaincus que le processus électoral n’a pas subi de plus grandes influences du phénomène de la désinformation et que cela était dû, et beaucoup, à la contribution des partenaires de notre programme. (BRASIL, 2019c).

Le programme de la Cour semble déjà apporter des résultats des plates-formes elles-mêmes qui l’ont rejointe. Le 29 octobre 2019, le réseau social Twiter a rencontré le groupe de gestion du programme pour ” aligner les stratégies communes ” (BRASIL, 2019d). Le lendemain, la presse annonçait que le réseau social avait décidé d’interdire toute propagande politique (TWITER…, 2019). Cependant, il semble que la préoccupation de la justice électorale vise à lutter contre la désinformation seulement, rien ne mentionne la capacité que des entreprises comme le défunt Cambridge Analytics ont à classer les profils politiques à travers les données des électeurs utilisateurs des médias sociaux.

6. CONCLUSION

L’analyse des réseaux sociaux en tant qu’influenceurs du débat politique est fondamentale pour comprendre le stade où les démocraties se rencontrent (RUEDIGER; GRASSI, 2018) et réfléchir à l’avenir électoral brésilien.

Ainsi, pour que les réseaux sociaux restent un espace démocratique d’opinion et d’information, il est nécessaire de comprendre l’organique des débats, en identifiant les responsables d’actions coordonnées pour stimuler les messages. Les réseaux doivent devenir plus transparents, cherchant à comprendre les intérêts derrière l’embauche de ces services d’automatisation et à répandre la désinformation. L’élargissement de la capacité d’identifier et de sévir contre l’automatisation malveillante des profils de médias sociaux devrait être une priorité. (GRASSI et al., 2017).

En attendant, la Cour électorale devrait promouvoir des politiques de sensibilisation pour les électeurs utilisant des plateformes numériques, sur les mécanismes utilisés pour la manipulation, de la formation de echo chambers, à l’utilisation de l’intelligence artificielle et des bots, qui dirigent intentionnellement leurs messages vers des destinataires spécifiques. Cela permet aux gens de filtrer ce qu’ils voient, et aussi être en mesure de limiter le pouvoir croissant des fournisseurs de sélectionner chaque utilisateur individuellement, en les analysant sur la base des informations sociales acquises dans leurs profils sur ces plates-formes.

Cass Sunstein a raison lorsqu’il insiste sur le fait que, dans une société diversifiée, le système de liberté d’expression et le droit à la vie privée exige beaucoup plus que des restrictions à la censure gouvernementale et au respect des choix individuels. Alors que la censure est une menace pour la démocratie et la liberté, un système de libre expression qui fonctionne bien doit répondre à deux exigences distinctes : premièrement, les gens doivent être exposés à des matériaux qu’ils n’auraient pas choisis à l’avance, évitant ainsi la formation de echo chambers. Et deuxièmement, les questions devraient impliquer des sujets et des points de vue que les utilisateurs de plates-formes numériques n’ont pas cherché, et peut-être même pas d’accord avec, mais qui sont importants pour éviter la polarisation et l’extrémisme. Le professeur de Harvard explique qu’il ne suggère pas que le gouvernement force les gens à voir des choses qu’ils veulent éviter. Mais il affirme que des réunions imprévues et imprévues sont au cœur de la démocratie, faisant ainsi son appel à la sérendipité (SUNSTEIN, 2017).

Selon Caldas e Caldas (2019), les fake news, ou désinformation, se propagent rapidement et enserrissent les conséquences pendant longtemps. Pour faire face à ce phénomène, il faut des mesures efficaces et rapides pour réduire sa propagation et ses effets, car cette diffusion peut interférer dans le processus démocratique brésilien tel qu’il est vu dans ce travail. Il est également nécessaire de créer des instruments pour identifier les agents responsables de ces épisodes et outils pour mesurer les dommages possibles causés lors d’une élection. En plus des mesures qui permettent un meilleur contrôle d’accès aux données utilisateur, puisque le ciblage du contenu dépend de l’identification des profils d’un public cible.

Il est extrêmement urgent et important que la justice électorale, en collaboration avec le Pouvoir législatif, crée des moyens de protection des données numériques, afin d’empêcher l’émergence de nouvelles Cambridge Analytics et d’utiliser leur analyse des profils pour diriger les messages vers des cibles choisies afin d’interférer dans le processus démocratique des élections.

Jusqu’à ce que ces mesures soient prises, les électeurs doivent être sensibilisés. Le Brésil vit l’ère de la polarisation politique. C’est un fait mis. Il ne fait aucune différence si l’individu est en faveur d’une politique de gauche ou de droite. La tendance n’est pas de soutenir une idée née d’un parti contraire à sa vision, même s’il est d’accord avec elle. De cette façon, il semble facile de manipuler un groupe cible afin que la haine et le chaos se propagent. Et comme on le voit dans ce document, il serait même possible de changer le résultat d’une élection.

Ainsi, il est entendu que l’action de la justice électorale est timide compte tenu de la coupure apportée dans ce débat, c’est-à-dire d’éduquer les électeurs utilisant ces plates-formes sur les dangers de la manipulation des données dans les réseaux sociaux, en plus de l’accent qui a été donné à la sensibilisation à la désinformation.

Les Fake news ont toujours existé, contrairement à la capacité que certains logiciels doivent analyser le profil de chaque utilisateur de l’électeur. Cette capacité est une nouveauté de cette ère numérique et a un immense potentiel pour cibler un groupe particulier et peut même manipuler le résultat d’un processus électoral.

La justice électorale doit apprécier la douceur des élections. Il est donc nécessaire de sensibiliser la population à ces moyens de manipulation. Éduquer les gens à protéger leurs données et les informations de questions qu’ils reçoivent, en particulier sur les réseaux sociaux. Qui sait, cette polarisation diminue un jour, et avec elle, le potentiel de manipulation existant dans les plates-formes sociales.

RÉFÉRENCES

BECKER, Lauro. Site, blog, landing page, hotsite ou e-commerce? Entenda a diferença! Orgânica Digital, jul. 2016. Disponível em: https://www.organicadigital.com/blog/site-blog-landing-page-hotsite-ou-e-commerce-entenda-a-diferenca/. Acesso em: 20 out. 2019.

BITTAR, Eduardo C. B. Metodologia da pesquisa jurídica. 15. ed. São Paulo: Saraiva, 2017. ISBN: 9788547220037.

BOND, Robert M. et al. A 61-million-person experiment in social influence and political mobilization. Nature, n. 489, p. 295-298, set. 2012. DOI: https://doi.org/10.1038/nature11421. Disponível em: https://www.nature.com/articles/nature11421. Acesso em: 8 jan. 2019.

BRASIL. Presidência da República. Casa Civil. Subchefia para Assuntos Jurídicos. Constituição da República Federativa do Brasil de 1988. Portal da Legislação. Disponível em: http://www.planalto.gov.br/ccivil_03/constituicao/constituicao.htm. Acesso em: 10 mai. 2019.

BRASIL. Presidência Da República. Casa Civil. Subchefia Para Assuntos Jurídicos. Lei Nº 9.504, de 30 de setembro de 1997. Lei da Eleições. Portal da Legislação. Disponível em: http://www.planalto.gov.br/ccivil_03/leis/l9504.htm Acesso em: 10 mai. 2019.

BRASIL. Presidência Da República. Casa Civil. Subchefia Para Assuntos Jurídicos. Lei Nº 4.737, de 15 de julho de 1965. Código Eleitoral. Portal da Legislação. Disponível em: http://www.planalto.gov.br/ccivil_03/leis/l4737.htm Acesso em: 22 out. 2019.

BRASIL. Tribunal Superior Eleitoral. Diálogos para a construção da Sistematização das Normas Eleitorais. 2019. Disponível em: http://www.tse.jus.br/legislacao/sne/arquivos/gt-iii-propaganda-estudos-preliminares. Acesso: em: 12 ago. 2019.

BRASIL. Tribunal Superior Eleitoral. Legislação. 2019a. Disponível em: http://www.tse.jus.br/legislacao/compilada/prt/2019/portaria-no-115-de-13-de-fevereiro-de-2019 Acesso: em: 12 ago. 2019.

BRASIL. Tribunal Superior Eleitoral. Portal da Comunicação TSE. 2019b. Disponível em: http://www.tse.jus.br/imprensa/noticias-tse/2019/Setembro/enfrentamento-a-desinformacao-tse-veicula-serie-de-cinco-videos-sobre-o-tema?fbclid=IwAR2JRU6Yu0u-gRV1-wACl3K4Eic8l-jtllgIjG64kpTVwW1so6Xi8NSx2yY. Acesso em: 21 out. 2019.

BRASIL. Tribunal Superior Eleitoral. Portal da Comunicação TSE. 2019c. Disponível em: http://www.tse.jus.br/imprensa/noticias-tse/2019/Outubro/google-facebook-twitter-e-whatsapp-aderem-ao-programa-de-enfrentamento-a-desinformacao-do-tse. Acesso em: 30 out. 2019.BRASIL. Tribunal Superior Eleitoral. Portal da Comunicação TSE. 2019d. Disponível em: http://www.tse.jus.br/imprensa/noticias-tse/2019/Outubro/grupo-gestor-do-programa-de-enfrentamento-a-desinformacao-recebe-representante-do-twitter-para-alinhar-estrategias-conjuntas. Acesso em: 30 out. 2019.

BRASIL. Tribunal Superior Eleitoral. Portal da Comunicação TSE. 2019e. Disponível em: http://www.tse.jus.br/imprensa/noticias-tse/2019/Agosto/tse-lanca-programa-de-enfrentamento-a-desinformacao-com-foco-nas-eleicoes-2020. Acesso em: 30 out. 2019.

BRASIL. Tribunal Superior Eleitoral. Seminário Internacional sobre Fake News e Eleições. 2019f. Disponível em: http://www.tse.jus.br/hotsites/seminario-internacional-fake-news-eleicoes/. Acesso: em: 12 ago. 2019.

CADWALLADR, Carole. Revealed: 50 million Facebook profiles harvested for Cambridge Analytica in major data breach. The Guardian, 17 mar. 2018. Disponível em: https://www.theguardian.com/news/2018/mar/17/cambridge-analytica-facebook-influence-us-election Acesso em: 26 abr. 2019.

CADWALLADR, Carole. Facebook’s role in Brexit — and the threat to democracy. TED Ideas worth spreading, Abr, 2019. Disponível em: https://www.ted.com/talks/carole_cadwalladr_facebook_s_role_in_brexit_and_the_threat_to_democracy/transcript?language=en. Acesso em: 4 ago. 2019.

CALDAS, Camilo O. L.; CALDAS, Pedro N. L. Estado, democracia e tecnologia: conflitos políticos e vulnerabilidade no contexto do big-data, das fake news e das shitstorms. Perspectivas em Ciência da Informação, Belo Horizonte, v.24, n. 2, abr./jun. 2019. Disponível em: http://www.scielo.br/scielo.php?script=sci_arttext&pid=S1413-99362019000200196&tlng=pt. Acesso em: 20 out. 2019.

Congresso derruba veto e mantém pena para “fake news” eleitoral. Exame, ago. 2019. Disponível em: https://exame.abril.com.br/brasil/congresso-mantem-veto-a-prestacao-de-assistencia-odontologica-obrigatoria/. Acesso em: 22 out. 2019.

FERRARA, Emilio, et al. The Rise of Social Bots. Communications of the ACM, New York, v. 59 n. 7, jul. 2016. Disponível em: https://cacm.acm.org/magazines/2016/7/204021-the-rise-of-social-bots/fulltext#R24. Acesso em: 20 out. 2019.

GRASSI, Amaro. Et al. Robôs, redes sociais e política no Brasil: estudo sobre interferências ilegítimas no debate público na web, riscos à democracia e processo eleitoral de 2018. FGV DAPP, Rio de Janeiro, 20 ago 2017. Disponível em: http://hdl.handle.net/10438/18695. Acesso em: 12 jan. 2019.

HALE, Scott et al. How digital design shapes political participation: A natural experiment with social information. PLoS One, 27 abr. 2018. DOI: 10.1371/journal.pone.0196068. Disponível em: https://journals.plos.org/plosone/article?id=10.1371/journal.pone.0196068. Acesso em: 8 jan. 2019.

HOUSE OF COMMONS (Reino Unido). Disinformation and ‘fake news’: Final Report. Londres: House of Commons, 2019, 111 p. Disponível em: https://publications.parliament.uk/pa/cm201719/cmselect/cmcumeds/1791/1791.pdf. Acesso em: 19 fev. 2019.

MONTEIRO, Cláudia S.; MEZZAROBA, Orides. Manual de metodologia da pesquisa no Direito. 7. ed. São Paulo: Saraiva, 2017. ISBN: 9788547218720.

MUNGER, Kevin. Influence? In this economy? Tech-savvy young people take internet literacy for granted, and that can cause all kinds of problems. The Outline, 17 fev. 2018. Disponível em: https://theoutline.com/post/3443/devumi-twitter-bots-savviness-gap. Acesso em: 14 jan. 2019.

NETTO, Paulo R. WhatsApp confirma ação de empresas em disparo de mensagens durante eleições. O Estado de São Paulo, 8 out. 2019. Disponível em: https://politica.estadao.com.br/blogs/estadao-verifica/whatsapp-confirma-acao-de-empresas-em-disparo-de-mensagens-durante-eleicoes/. Acesso em: 2 nov. 2019.

PRIVACIDADE Hackeada. Direção: Karim Amer, Jehane Noujaim. Produção: Karim Amer, Pedro Kos, Geralyn Dreyfous, Judy Korin. Intérpretes: Brittany Kaiser, Carole Cadwalladr, David Carrol e outros. Roteiro: Karim Amer, Pedro Kos, Erin Barnett. Estados Unidos: Netflix, 2019 (113 min). Produzido por Netflix. Disponível em: https://www.netflix.com Acesso em: 4 ago. 2019.

PUPO, Amanda; PIRES, Breno. TSE abre ação sobre compra de mensagens anti-PT no WhatsApp. O Estado de São Paulo, 19 out. 2019. Disponível em: https://politica.estadao.com.br/noticias/eleicoes,tse-abre-acao-sobre-compra-de-mensagens-anti-pt-no-whatsapp,70002555142. Acesso em: 2 nov. 2019.

RAMAYANA, Marcos. Direito Eleitoral. 16. Edição. Niterói: Impetus, 2018. ISBN: 9788576269601.

ROSENBERG, Matthew; CONFESSORE, Nicholas; CADWALLADR, Carole. How Trump consultants exploited the Facebook data of millions. The New York Times, 17 mar. 2018. Disponível em: https://www.nytimes.com/2018/03/17/us/politics/cambridge-analytica-trump-campaign.html. Acesso em: 20 dez. 2018.

RUEDIGER, Marco A. O estado da desinformação: Eleições 2018. FGV DAPP, Rio de Janeiro, 18 set 2018. Disponível em http://hdl.handle.net/10438/25743. Acesso em: 3 jan. 2019.

RUEDIGER, Marco A.; GRASSI, Amaro. Redes sociais nas eleições 2018. FGV DAPP, Rio de Janeiro, 5 out 2018. Disponível em http://hdl.handle.net/10438/25737. Acesso em: 3 jan. 2019.

RUEDIGER, Marco A.; GRASSI, Amaro. Desinformação na era digital: amplificações e panorama das Eleições 2018. FGV DAPP, Rio de Janeiro, 30 nov 2018a. Disponível em http://hdl.handle.net/10438/25742. Acesso em: 3 jan. 2019.

RUEDIGER, Marco A.; GRASSI, Amaro. Bots e o Direito Eleitoral Brasileiro nas Eleições de 2018. FGV DAPP, Rio de Janeiro, 15 jan 2019. Disponível em http://hdl.handle.net/10438/26227. Acesso em 17 fev. 2019.

SHALDERS, André. Eleições 2018 estreia na TV com força em cheque. BBC News Brasil, 18 ago. 2018. Disponível em: https://www.bbc.com/portuguese/brasil-45364384 Acesso em: 18 ago. 2019.