ARTICLE ORIGINAL

CHAGAS, Edgar Thiago de Oliveira [1]

CHAGAS, Edgar Thiago de Oliveira. Intelligence artificielle, calcul quantique, robotique et Blockchain. Quelle est la réalité de ces technologies dans les temps actuels et futurs?. Revista Científica Multidisciplinar Núcleo do Conhecimento. 04 année, Ed. 06, vol. 09, p. 72-95. juin 2019. ISSN: 2448-0959

RÉSUMÉ

Dans des domaines tels que l'intelligence artificielle, il est nécessaire d'utiliser d'autres types d'ordinateurs et d'architectures. Par exemple, dans les algorithmes de reconnaissance d'images ou de traitement de la parole, l'exécution séquentielle et le stockage de l'architecture Von Neumann (très efficace pour d'autres applications) devient une limitation qui limite les performances de ces systèmes. Dans cette prémisse, le présent travail a cherché à analyser l'intelligence artificielle, le calcul quantique, la robotique et la blockchain, afin de réfléchir sur la réalité de ces technologies dans les temps actuels et futurs.

Mots-clés: Intelligence artificielle, calcul quantique, robotique, Blockchain.

1. INTRODUCTION

Cet article vise à réfléchir sur les concepts liés au calcul classique et au calcul quantique. De cette façon, le travail propose d'analyser les ordinateurs actuels ainsi que leurs limites et perceptions sur l'avenir. Les concepts de base de l'architecture von Neumann et le calcul quantique seront introduits pour une telle analyse. L'objectif est de discuter de la signification de ces concepts axés sur l'informatique. En ce sens, la recherche décrit l'histoire du développement de microprocesseurs à partir d'un aperçu du calcul quantique. L'accent est mis sur la distinction entre les principales caractéristiques de l'informatique traditionnelle et le calcul quantique. Enfin, nous proposons une réflexion sur les principales difficultés techniques rencontrées dans la construction d'ordinateurs quantiques ainsi que dans certaines recherches dans ce domaine.

2. INFORMATIQUE CLASSIQUE

Aujourd'hui, les ordinateurs effectuent une variété d'activités qui nécessitent un temps de traitement et d'exécution considérable. La recherche de réduction du temps d'exécution de ces activités a conduit les chercheurs à développer des machines de plus en plus rapidement. Cependant, il viendra un moment où les limites physiques empêcheront la création d'appareils plus rapides. Dans ce contexte, les lois de la physique imposent une limite à la miniaturisation des circuits. De cette façon, à l'avenir, les transistors seront si petits que les composants de silicium seront presque de taille moléculaire. À des distances microscopiques, les lois de la mécanique quantique ont un effet, ce qui fait sauter les électrons d'un point à l'autre sans traverser l'espace entre eux, causant de nombreux problèmes.

Les ordinateurs actuels sont basés sur l'architecture de Von Neumann. Il était un mathématicien hongrois d'origine juive, mais naturalisé américain. Von Neumann a contribué au développement de la théorie conjointe, de l'analyse fonctionnelle, de la théorie érodique, de la mécanique quantique, de l'informatique, de l'économie, de la théorie des jeux, de l'analyse numérique, de l'hydrodynamique des explosions, Statistiques et autres domaines des mathématiques. Il est considéré comme l'un des mathématiciens les plus importants du XEXe siècle. Un ordinateur basé sur l'architecture Von Neumann distingue clairement les éléments de traitement de l'information et de stockage, c'est-à-dire qu'il dispose d'un processeur et d'une mémoire séparés par un bus de communication. Dans l'ordinateur de von Neumann, deux aspects sont apparus : l'organisation de la mémoire et du traitement.

Les ordinateurs modernes ont les mêmes normes qu'ils sont basés sur l'architecture de Von Neumann. Cette solution divise le matériel informatique en trois composants principaux : la mémoire, le processeur et les périphériques d'entrée et de sortie. Instructions et données du programme Memory Stores; Le processeur est responsable de l'extraction des instructions et des données de la mémoire, de leur exécution, puis du stockage des valeurs obtenues dans les périphériques de mémoire et d'entrée (comme le clavier, la souris et le microphone) et les périphériques de sortie (tels que moniteur, haut-parleurs et imprimante) Autoriser l'interaction de l'utilisateur, l'affichage, pour les deux, des données et des instructions liées au traitement des résultats. Les mots stockés dans la mémoire peuvent contenir des instructions et des données. À son tour, le traitement est séquentiel et peut inclure des déviations conditionnelles ou inconditionnelles.

La présence de compteurs de programmes (incrémentés par chaque instruction) et de mémoire principale (y compris les programmes exécutables et leurs fichiers de données) reflète ces caractéristiques. Ce sont deux des caractéristiques les plus importantes de l'architecture Von Neumann, car ils définissent non seulement l'ordinateur lui-même, mais aussi tout le contenu associé à partir d'algorithmes complexes pour résoudre certains des problèmes d'efficacité. Pour illustrer davantage l'importance de ces caractéristiques de l'architecture de Von Neumann, prenons l'exemple suivant. Lorsqu'un programmeur développe un logiciel, il écrit un algorithme (un ensemble d'instructions) pour résoudre le problème.

La façon dont la plupart des programmeurs conçoivent et mettent en œuvre cette solution est séquentielle, non seulement parce que les gens pensent dans l'ordre, mais parce que les ordinateurs construits et utilisés il ya 50 ans de travail dans l'ordre. La programmation (structurelle, logique ou fonctionnelle) et le traitement séquentiel sont des conséquences directes de l'architecture de Von Neumann. Même les nouveaux paradigmes de programmation, tels que l'orientation des objets, sont encore limités à ces concepts. Malgré certaines limitations, cette façon d'organiser les ordinateurs est très efficace pour la plupart des activités effectuées par les ordinateurs modernes. Il n'y a peut-être pas de meilleure façon de faire des calculs mathématiques, d'éditer du texte, de stocker des données ou d'accéder à Internet, car les ordinateurs von Neumann sont la meilleure machine pour ces tâches.

Toutefois, pour des domaines spécifiques de développement, tels que le chiffrement, un nouvel outil informatique peut être nécessaire ainsi qu'une nouvelle stratégie pour faire face aux problèmes et ainsi trouver des solutions. Les programmes de cryptage fonctionnent actuellement efficacement parce qu'ils ne sont pas adaptés à la décomposition en grandes quantités, possédant ainsi plus de quelques centaines et plus que la capacité des machines les plus modernes. La difficulté de décomposer une grande quantité ne peut être attribuée qu'aux matériaux. Cela peut être causé par des aspects liés aux logiciels et au matériel.

On ne peut pas dire que la tâche de la machine actuelle pour accomplir cette nature est inefficace parce que l'ordinateur actuel n'a pas la puissance ou la vitesse de traitement suffisantes. Le problème peut être le manque de connaissances (ou de créativité) dans la conception des algorithmes nécessaires. Par conséquent, les processeurs actuels peuvent même être suffisants pour résoudre le problème de la décomposition massive, cependant, les humains ne comprennent pas comment mettre en œuvre l'algorithme. D'autre part, l'absence d'un tel algorithme peut être le résultat d'un manque d'un ordinateur suffisamment puissant. La vérité est que la recherche n'est pas décisive, puisque la source du problème lié au matériel, logiciel ou les deux est inconnue.

2.1 L'AUTOMATISATION, LE CHEMIN VERS LE MONDE MODERNE

Dans le système capitaliste, la mondialisation prévacté sur les marchés du travail du monde, de sorte que l'automatisation fonctionne comme la base pour les entreprises de rester compétitifs. C'est déjà la réalité des industries, parce que la technologie est devenue un élément essentiel. Le thème proposé est également lié aux emplois générés face à l'automatisation inversement proportionnelle. L'automatisation est l'investissement nécessaire pour les grandes, moyennes et petites entreprises. Les machines obsolètes entravent la production et finissent par être un facteur prépondérant pour le retrait de nombreuses entreprises du marché. Dans ce contexte, les ordinateurs sont responsables de la rationalisation des services bureaucratiques ainsi que de la transmission d'informations précises et rapides aux entreprises ainsi qu'aux robots qui accélèrent également le marché.

Il est clair que la technologie a réduit le nombre d'emplois, mais a rendu les consommateurs plus exigeants, ainsi qu'une agilité et une compétitivité accrues dans le commerce. Avec cela, les dépenses des entreprises ont diminué et les bénéfices ont augmenté. L'obligation d'emploi génère un fardeau pour les entreprises dont les impôts sont payés sous les salariés, étant les machines d'investissements à coût élevé, mais qui cessent ou diminuent les dépenses avec celles-ci et apportent, rapidement, le rendement du capital investi. Les travailleurs devraient toujours recycler et se perfectionner par des cours et des formations, parce que le marché du travail est de plus en plus concurrentiel, de sorte que ceux qui ne se recyclent pas finissent par obtenir la marge d'évolution.

Il est de plus en plus, dans les pays capitalistes, le souci de l'évolution qui se produit dans les domaines de la biologie, de la microélectronique, entre autres. Destarte, la préoccupation atteint la race moderniste, parce qu'il ya un dépassement rapide des machines; Mais il a aussi l'objet de travailleurs qui perdent leur emploi. C'est souvent, dans les entreprises, le retour des anciens employés dans les banques scolaires. Cela démontre que les entreprises comptent sur la main-d'œuvre qualifiée et gagnent ainsi du dynamisme et de la qualité pour être compétitives.

2.2 AUTOMATISATION INDUSTRIELLE

L'histoire de l'automatisation industrielle a eu son chance avec la production des chaînes d'assemblage de caractère automobile. L'un des exemples les plus expressifs est Henry Ford. Cela a gagné de l'espace sur le marché dans la décennie de 1920. Depuis cette période, le progrès technologique a pris de l'ampleur dans les domaines les plus divers liés à l'automatisation, avec ainsi une augmentation significative de la qualité et de la quantité de production, donnant principalement la priorité à la réduction des coûts. Dans ce contexte, l'avancement de l'automatisation, en général, est lié à l'évolution de la microélectronique, qui a gagné en force et en espace ces dernières années. Un exemple de ce processus est la création du contrôleur logique programmable (PLCS).

Cet outil est apparu dans la décennie de 1960, avec l'objectif de remplacer les panneaux de cabine, car ils avaient des caractéristiques plus négatives que positives, principalement parce qu'ils occupaient un espace physique très expressif. Ainsi, à partir du moment où il a été nécessaire d'apporter des changements dans la programmation logique des processus effectués par des interconnexions électriques avec une logique fixe, il a fallu des interruptions dans le processus de production au détriment de la nécessité de reconnecter le Éléments de contrôle du panneau. Cette pratique a pris beaucoup de temps, il y avait donc une énorme perte de production ainsi qu'il y avait une forte consommation d'énergie.

Dans ce contexte, en 1968, dans la division Hidramatic de "General Motors Corporation", une expérience axée sur le contrôle logique a été réalisée. Il était prévu que la programmation des ressources liées au logiciel était liée à l'utilisation d'périphériques, étant en mesure d'effectuer des opérations d'entrée et de sortie à partir d'un micro-ordinateur avec une capacité de programmation. Cette expérience a considérablement réduit les coûts d'automatisation de l'époque. Ainsi, avec la création de microprocesseurs, il n'était plus nécessaire d'utiliser de grands ordinateurs. Ainsi, le PLC (nom donné à l'expérience), est devenu une unité isolée, recevant, pour cela, quelques ressources.

Ils sont l'interface de programmation et d'exploitation d'une manière facile à l'utilisateur; Instructions arithmétiques ainsi que manipulation de données; Capacités de communication des réseaux PLC et nouvelles possibilités de configuration spécifiques à chaque but à partir de modules interchangeables. En ce sens, d'une vue plus intégrée de l'usine avec l'environnement de l'entreprise, toutes les décisions organisationnelles liées au système de production ont commencé à être prises à travers les concepts votés sur la qualité, basé, Dans les données concrètes et actuelles proviennent de différentes unités de contrôle. De cette façon, les fabricants de CLP doivent comprendre l'inégalité fondamentale : les logiciels et le matériel pour la production de systèmes SCADA ainsi que pour d'autres systèmes spécialisés.

Ainsi, les logiciels SCADA prennent forme à partir de différentes tailles et systèmes d'exploitation ainsi que plusieurs fonctionnalités. Pour être présenté comme des outils complets, ajoutez au SLP pour concurrencer. Cependant, dans le domaine de l'instrumentation, cette révolution a pris plus lentement, car il était nécessaire d'équiper les instruments de plus d'intelligence ainsi que de les faire communiquer dans un réseau, c'est-à-dire, de sorte que la norme 4-20 mA pourrait transmettre des signaux analogiques, devrait Donnez leur place à la transmission numérique. Ce principe a été développé à partir d'un protocole qui a profité du câblage existant lui-même, transitant ainsi des signaux numériques sur les signaux analogiques 4-20 mA. Ce protocole (HART) n'était rien de plus qu'un palliatif, bien qu'il reste jusqu'à aujourd'hui dans son interinité.

Ce phénomène représente également une forme de réaction à l'avancement et à l'existence de nouvelles technologies, car, par la suite, un grand nombre de modèles et de protocoles ont été créés qui ont tenté de se montrer comme uniques et meilleurs. Dans un contexte actuel, les Plc sont utilisés, avant tout, pour la mise en place de panneaux de verrouillage séquentiels, pour le contrôle des mailles, pour les systèmes de contrôle cellulaire de fabrication, entre autres. On les trouve également dans les procédés liés à l'emballage, à l'embouteillage, à la mise en conserve, au transport et à la manutention des matériaux, à l'usinage, à la production d'électricité, aux systèmes de contrôle de la climatisation, aux systèmes de Sécurité, assemblage automatisé, lignes de peinture et systèmes de traitement de l'eau dans les secteurs de l'alimentation, des boissons, de l'automobile, de la chimie, des textiles, des plastiques, des pâtes et papiers, des produits pharmaceutiques, de l'acier et de la métallurgie.

3. HISTOIRE

En 1965, Gordon Moore, co-fondateur d'Intel, l'un des principaux fabricants de microprocesseurs, a fait une prédiction qui est devenue célèbre étant connu sous le nom de loi de Moore. Selon lui, le nombre de transistors d'un microprocesseur se plierait à des intervalles de temps à peu près constants entre un et trois ans. Cela signifie une avancée exponentielle dans l'évolution du traitement automatique. Dans ce contexte, il a été constaté que la loi était valide à partir de ce moment-là jusqu'à nos jours, période au cours de laquelle il a été observé que la puissance de traitement a doublé, environ, tous les 18 mois.

3.1 LA PROMISE DE QUANTUM PROCESSORS

Les processeurs quantiques semblent être l'avenir de l'informatique. L'architecture actuelle, y compris l'utilisation de transistors pour construire des processeurs, atteindra inévitablement ses limites d'ici quelques années. Ensuite, il sera nécessaire d'élaborer une architecture plus efficace. Pourquoi ne pas remplacer le transistor par un atome ? Les processeurs quantiques ont le potentiel d'être efficaces, et en quelques secondes, les processeurs actuels ne peuvent même pas être achevés en millions d'années.

3.2. POURQUOI QUANTUM PROCESSORS

En fait, le concepteur de microprocesseurs a fait un travail important. Au cours des trois dernières décennies, depuis l'avènement d'Intel 4004, la vitesse de traitement du premier microprocesseur au monde a augmenté de façon expressive. Pour se faire une idée, l'i8088 est le processeur utilisé dans le XT sorti en 79, il a une capacité de traitement estimée à seulement 0,25 meglops, soit seulement 250.000 opérations par seconde. Le Pentium 100 a traité 200 meglops et 200 millions d'opérations, tandis que le 1,1 GHz Athlon traite près de 10 gigaflops, 40 000 fois plus rapide que le 8088.

Le problème est que tous les processeurs actuels ont une limitation commune: ils se composent de transistors. La solution pour produire des puces plus rapides est de réduire la taille des transistors qui les produisent. Les premiers transistors apparus dans la décennie de 1960, sont approximativement de la taille d'une tête de phosphore, alors que les transistors actuels sont seulement 0.18 microns (1 micron – 0.001 mm). Cependant, il a approché les limites physiques de la question, afin d'aller de l'avant, vous devrez remplacer les transistors pour des structures plus efficaces. De cette façon, l'avenir des processeurs semble dépendre des processeurs quantiques.

3.3. LAW DE MOORE

L'un des concepts les plus connus du calcul est abordé par la loi dite Moore. Au milieu de 1965, Gordon E. Moore, alors président d'Intel, a prédit que le nombre de transistors de puces augmenterait de 60 %, au même coût, tous les 18 mois. Selon les prédictions de Moore, la vitesse des ordinateurs doublerait chaque année et demie. Cette loi est maintenue depuis la publication du premier PC1 en 1981. Le premier microprocesseur fabriqué par Intel Corporation était le 4004. Il avait un processeur 4 bits, avec "seulement" 2300 transistors. Sa vitesse de fonctionnement était de 400 KHz (kilohertz, pas mégahertz). La technologie de fabrication a atteint une densité de 10 microns. Fabriqué en 1971, il a été le premier microprocesseur dans une seule puce, ainsi que le premier disponible sur le marché. Conçu à l'origine pour être un composant de calculatrices, le 4004 a été utilisé de plusieurs façons.

Actuellement, le processeur le plus avancé d'Intel est le Core i7-3960X, avec six cœurs réels et douze segments de 3,3 GHz, jusqu'à 3,9 GHz, grâce à la technologie Turbo Boost. Ce processeur a 2,27 milliards de transistors de 22 nanomètres chacun, mille fois plus petit que le diamètre d'une mèche de cheveux; La puce est en silicium. Cependant, à un moment donné dans l'avenir- même les experts ne savent pas exactement quand- la frontière de silicium sera atteinte et la technologie ne sera pas en mesure d'avancer. Par conséquent, les fabricants de puces devront migrer vers un autre matériau. Cette journée est encore loin, mais les chercheurs explorent déjà des alternatives. Le graphène reçoit beaucoup d'attention en tant que successeur potentiel au silicium, mais OPEL Technologies croit que l'avenir est dans un composé appelé arsenide de gallium, également appelé la formule moléculaire GaAs.

Même si cette nouvelle technologie atteint ses limites et qu'une autre technologie réussit, elle finira par atteindre la limite atomique. À ce niveau, il est physiquement impossible de faire moins de choses. Cela nécessite la réalisation d'une analyse détaillée car elle conduit à l'une des conclusions les plus importantes sur les calculs numériques. Depuis l'avènement du premier ordinateur numérique, il n'y a pas eu de changements majeurs. Ce qui s'est passé au cours des 60 dernières années, c'est le développement de la technologie. Des ordinateurs plus petits et plus rapides sont arrivés. La valve se déplace vers le transistor et se déplace finalement vers la puce. En fait, il s'agit d'un exemple lié à l'évolution de la vitesse. Cependant, la vérité est qu'un ordinateur plus puissant n'a jamais été installé.

Dans ce contexte, tous les ordinateurs actuels sont XT (XT est l'un des premiers ordinateurs personnels d'IBM, équipé du nom de la puce 8086, le PC IBM d'origine est accompagné d'une version bon marché de la 8088, 8086). L'informatique s'est développée en termes de vitesse, mais pas en termes de puissance de calcul. Inévitablement, la technologie numérique atteindra ses limites tôt ou tard. D'un point de vue physique, il est impossible d'augmenter la vitesse du processeur. Pour ce faire, il faudra changer l'ordinateur lui-même ou découvrir de nouvelles technologies. À cette fin, il est nécessaire de modifier l'architecture de Von Neumann. Les changements architecturaux impliquent la réorganisation des composants informatiques afin d'améliorer la fonctionnalité de l'appareil.

De cette façon, certaines des limitations implicites par l'architecture de Von Neumann seront supprimées. Plusieurs solutions informatiques non conventionnelles sont à l'étude aujourd'hui. Certains impliquent même l'utilisation de molécules d'ADN (acide désoxyribonucléique). Parmi les différentes alternatives aux ordinateurs numériques à l'étude, les plus intéressantes et prometteuses sont les ordinateurs quantiques. La section suivante de cet article traite du développement de la connaissance quantique dans ce domaine de la connaissance humaine, donc, sera décrit les concepts de base liés à la génération, l'évolution, la portée, les perspectives futures et les défis inhérents à l'informatique de caractère quantique.

4. CALCUL QUANTIQUE

Les ordinateurs quantiques fonctionnent essentiellement à partir de règles liées à l'incertitude quantique. Quand il atteint le niveau d'une seule particule, rien n'est absolu (l'électron peut être tourné d'une manière ou d'une autre, mais un mélange de spins peut également être présent). Sur les ordinateurs quantiques, l'unité d'information de base est les bits quantiques (qubits). Qubits peuvent avoir des valeurs de 0 ou 1 ainsi que des bits réguliers (nombres binaires). La différence est que les qubits peuvent avoir des valeurs 0 et 1 en même temps. C'est dans cette propriété particulière qu'il y a toute la puissance de calcul des ordinateurs quantiques.

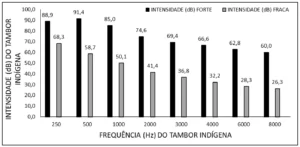

Figure 1 : Calcul quantique

Le calcul quantique explore les avantages d'une superposition d'état quantique cohérente pour atteindre le parallélisme quantique : simultanément, réaliser la même opération à différentes valeurs de qubits. Cela n'est possible qu'en raison de la différence fondamentale entre les qubits (les qubits sont connus) et les classiques: Alors que les bits classiques ne peuvent être que dans l'état 0 ou 1, les qubits peuvent être superposés dans ces états 0 et 1. Lorsqu'il y a deux qubits, les qubits peuvent exister comme une combinaison de tous les deux chiffres possibles. En ajoutant un troisième qubit, les trois numéros de bits possibles peuvent être combinés. Le système a connu une croissance exponentielle. Ainsi, une collection de qubits peut représenter une ligne de nombres et d'ordinateurs quantiques, en même temps, peut traiter toutes les entrées de données simultanément.

Le concept de calcul quantique n'est pas aussi complexe que l'unité de mesure de base est l'ordinateur classique. Cela peut prendre les valeurs 0 ou 1 bit. C'est cette particularité qui rend les structures quantiques si puissantes. Le prédécesseur décrit est le spin quantique, mais un automate est également proposé pour déplacer la structure quantique. L'unité de base de ce type d'ordinateur est composée de quatre cellules quantiques de points quantiques, de sorte que chaque unité a deux électrons qui cherchent à rester stationnaire. En d'autres termes, dans l'état qui consomme moins d'énergie, la formule Coulomb indique que la force répulsive est inversement proportionnelle à la distance du mécanisme de répulsion, de sorte que plus la force est proche, plus il est susceptible de repousser. Par conséquent, ils ont tendance à occuper des points quantiques aux deux extrémités de la cellule, ce qui équivaut à la rotation sur un ordinateur avec rotation quantique. Cependant, cette technique nécessite une température de fonctionnement très basse : 70 mg.

La cellule quantique est utilisée pour créer une structure formée par un quantum à partir de 5 cellules : trois cellules d'entrée, une cellule de « manipulation » et une sortie. Cette structure est appelée entrée d'arbre. Le fonctionnement de la structure de filament sous forme de base est le suivant: La répulsion des électrons maintient au moins la polarisation, de sorte que les cellules traitées sont incitées à assumer l'état de la plupart des unités d'entrée. Enfin, l'unité de sortie copie le résultat de sorte que la polarisation de l'unité n'affecte pas le calcul de l'unité de traitement.

Mais il ya encore quelques problèmes, non pas en termes d'architecture, mais dans le processus de construction d'ordinateurs quantiques, parce que l'une des raisons de l'erreur est l'environnement lui-même: l'impact sur l'environnement peut provoquer des changements dans les qubits, ce qui peut causer Incohérences dans le système, invalides. Une autre difficulté est que la physique quantique souligne qu'il est nécessaire de mesurer ou d'observer la superposition des états d'échec comportemental d'un système quantique. Autrement dit, si vous lisez les données tout en exécutant le programme sur un ordinateur quantique, tout le traitement sera perdu.

4.1. L'ALGORITHME SHOR

Le développement du calcul quantique a commencé dans la décennie de 1950, lorsque les lois de la physique et de la mécanique quantique appliquées à l'informatique ont été prises en considération. En 1981, une réunion a eu lieu au Massachusetts à l'Institute of Technology : le MIT a discuté de cette question. Lors de cette réunion, le physicien Richard Feynman a proposé l'utilisation de systèmes quantiques sur les ordinateurs, défendant qu'ils ont plus de puissance de traitement que les ordinateurs ordinaires. En 1985, David Deutsch, de l'Université d'Oxford, décrit le premier ordinateur quantique. C'est une machine de Turing quantique qui peut simuler un autre ordinateur quantique. Il n'y a pas eu de progrès significatifs dans la recherche sur le sujet, de sorte que près d'une décennie plus tard, Peter Shaw, un chercheur AT -T, a mené une étude de 1994 pour développer un algorithme pour factorer beaucoup plus rapidement que les ordinateurs traditionnels.

L'algorithme utilise les propriétés d'un ordinateur quantique pour effectuer la décomposition de grands entiers (environ 10 200 numéros) en temps polynomial. Cet algorithme, appelé algorithme Shor, est publié dans l'article "Quantum Computation algorithms: discret logarithms decomposition". L'algorithme utilise la propriété de superposition quantique pour réduire la complexité du problème de temps de solution de l'exponentiel au polynomial au moyen d'une fonction quantique spécifique. Comprendre les fonctions quantiques utilisées dans l'algorithme Shor nécessite une interprétation mathématique assez étendue et complexe qui dépasse le cadre de cet article.

L'application directe de l'algorithme Shor s'applique au domaine du chiffrement. La sécurité des systèmes cryptographiques clés publics dépend de la difficulté de décomposer un très grand nombre. La sécurité du système de cryptage est compromise par la mise en œuvre effective d'un ordinateur capable d'effectuer ces calculs rapidement. L'Agence spatiale américaine (NASA) et Google investissent dans l'informatique quantique pour l'avenir de l'informatique et se préparent à utiliser les dernières machines D-Wave.

4.2 L'ORDINATEUR QUANTIQUE DE D-WAVE

La nouvelle version de D-Wave, ordinateur quantique aidera dans la recherche de la NASA pour le monde extraterrestre avant la fin de 2013 agit principalement pour améliorer le service. D-Wave TWO Computer-1 512-bit ordinateurs-sera bientôt mis en service dans le nouveau laboratoire d'intelligence artificielle quantique créé par la NASA, Google et l'USRA (Space University Research Association). Le directeur de l'ingénierie Harmut Neven Google a publié une note sur le blog de l'entreprise décrivant les objectifs de l'Organisation. Il croit que le calcul quantique peut aider à résoudre les problèmes informatiques dans certains, en particulier dans le domaine de l'intelligence artificielle. L'intelligence artificielle est construite à partir des meilleurs modèles au monde pour faire des prédictions plus précises.

Pour guérir la maladie, il est nécessaire d'établir un modèle plus efficace des maladies ainsi que pour développer une politique environnementale plus efficace, il est nécessaire de développer de meilleurs modèles climatiques mondiaux. Pour construire un service de recherche plus utile, vous devez mieux comprendre les problèmes et le contenu disponibles sur Internet afin d'obtenir la meilleure réponse. Neven, selon le communiqué, rapporte que le nouveau laboratoire va transformer ces idées théoriques en pratique. De cette façon, le travail d'installation de la machine D-Wave a commencé à la NASA au Centre de recherche Ames, moffett champ en Californie. Siège de Google à Mountain View, en restant à quelques minutes.

Ce partenariat représente la dernière percée de D-Wave. Le D-Wave est une revendication, pour les deux, a été construit et vendu le premier ordinateur quantique commercial du monde par la société canadienne. De nombreux laboratoires universitaires travaillent à construire seulement un petit numéro d'ordinateur quantique qubit, les chercheurs impliqués avec D-Wave, travaillent de sorte que la machine peut laisser moins de doute. Il y a quelques années, de nombreux spécialistes connus de l'informatique quantique étaient sceptiques au sujet du spectre ieEE. En fait, D-Wave a réussi à conquérir quelques ex-comentaristas. La société permet à D-Wave d'accéder à des chercheurs indépendants. Dans au moins deux cas, cette ouverture a eu des répercussions sur les allégations de calcul quantique et de rendement de l'entreprise. D-Wave a gagné en crédibilité lorsqu'il a commercialisé Lockheed Martin pour la première fois en 2011.

Selon le représentant de Google, le nouveau laboratoire d'intelligence artificielle quantique a soumis le nouveau D-Wave Two à des tests rigoureux avant que la machine ne soit approuvée. En particulier, un test exige que l'ordinateur résolve certains problèmes d'optimisation, au moins 10 000 fois plus rapide que l'ordinateur classique. Dans un autre cas, la machine D-Wave a obtenu le meilleur score dans l'édition Standard du jeu SAT. Pendant des années, Google a utilisé le matériel D-Wave pour résoudre les problèmes d'apprentissage automatique. La société a développé un algorithme d'apprentissage automatique compact et efficace pour la reconnaissance des modèles-utile pour les dispositifs de limitation d'énergie tels que les smartphones ou les tablettes. Une autre machine similaire s'est avérée très appropriée lorsque, par exemple, un pourcentage élevé d'images dans les albums en ligne a été trié incorrectement pour résoudre la «pollution» des données.

La Nasa, quant à elle, espère que la technologie pourra accélérer la recherche de planètes lointaines autour du système solaire et soutenir les futurs centres de contrôle de mission spatiales, humaines ou robotiques. Les chercheurs de la NASA et de Google ne monopobe l'utilisation de la nouvelle machine de laboratoire D-Wave Twono. L'USRA a l'intention de fournir le système à la communauté universitaire américaine de recherche – une décision qui aidera D-Wave à surmonter les sceptiques. La nouvelle a été faite par la compagnie aérienne Lockheed Martin. Ainsi, pour 1 milliard de dollars, au début de 2013, a annoncé l'achat de la d-onde D deux peu de temps après, représentant la mise à niveau, par la suite, à la machine D-Wave One.

4.3 TEST: DIGITAL COMPUTER X QUANTUM COMPUTER

Pour la première fois, un ordinateur quantique a été mis en concurrence avec un PC commun et l'ordinateur quantique a remporté le différend avec Slack. Le terme calcul quantique est toujours associé à l'idée de « dans l'avenir », « quand ils deviennent réalité », « s'ils peuvent être construits » et des choses comme ça. Cette perception a commencé à changer en 2007, lorsque la société canadienne D-Wave a présenté un ordinateur qu'elle prétendait faire des calculs basés sur la mécanique quantique. Le scepticisme parmi les chercheurs et les chercheurs du thème était grand. Cependant, en 2011, la communauté scientifique a eu accès à l'équipement et pourrait atmore que le processeur quantique de D-Wave est vraiment quantique. Maintenant, Catherine McGeoch de l'Université d'Amherst aux États-Unis a été embauché e par D-Wave pour faire une comparaison entre D-Wave qui utilise le « calcul quantique adiabatique » et un PC commun. Selon la chercheuse, il s'agit de la première étude à faire une comparaison directe entre les deux plates-formes informatiques : « Ce n'est pas le dernier mot, mais plutôt un début pour tenter de découvrir ce que le processeur quantique peut ou ne peut pas faire. »

Le processeur quantique, formé par 439 qubits de bobines de niobium, a été 3 600 fois plus rapide que le PC commun dans l'exécution des calculs impliquant un problème d'optimisation combinatoire, qui est de minimiser la solution d'une équation en choisissant les valeurs de certaines variables. Les calculs de cette nature sont largement utilisés dans les algorithmes qui font la reconnaissance d'image, la vision machine et l'intelligence artificielle. L'ordinateur quantique de D-Wave a trouvé la meilleure solution en une demi-seconde, environ, tandis que l'ordinateur classique le plus efficace a eu besoin d'une demi-heure pour atteindre le même résultat.

Le chercheur reconnaît qu'il ne s'agissait pas d'un jeu complètement propre, puisque les ordinateurs génériques, en règle générale, ne font pas si bien contre les processeurs dédiés à la résolution d'un type spécifique de problème. Ainsi, selon elle, la prochaine étape de la comparaison sera de faire le différend entre le processeur quantique adiabatique et un processeur classique développé pour ce type de calcul – comme un GPU utilisé sur les cartes graphiques. Le chercheur a souligné le caractère spécialisé de l'ordinateur quantique, soulignant qu'il est excellent pour effectuer des calculs. Il affirme que ce type d'ordinateur n'est pas destiné à surfer sur Internet, mais résout ce type spécifique mais important de problème très rapidement.

4.4 TECHNOLOGIES

Chemins de données vers des applications possibles pour le traitement de l'information quantique, comment pouvez-vous les exécuter sur des systèmes physiques réels? Sur une échelle de quelques qubits, il existe de nombreuses propositions de travail pour les dispositifs de traitement de l'information quantique. Peut-être le moyen le plus facile de les atteindre est de techniques optiques, c'est-à-dire du rayonnement électromagnétique. Des dispositifs simples, tels que des miroirs et des diviseurs de faisceau, peuvent être utilisés pour effectuer des manipulations élémentaires dans les photons. Cependant, les chercheurs ont constaté qu'il est très difficile de produire des photons séparés successivement. Pour cette raison, ils ont choisi d'utiliser des schémas qui produisent des photons individuels "de temps en temps", au hasard.

Les expériences de cryptographie quantique, de codage Superdense et de téléportation quantique ont été réalisées à l'aide de techniques optiques. L'un des avantages de ces techniques est que les photons ont tendance à être des porteurs très stables d'informations provenant de la mécanique quantique. Un inconvénient est que les photons n'interagissent pas directement les uns avec les autres. L'interaction doit être médiée par un autre élément, comme à partir d'un atome, car elle introduit des complications supplémentaires qui causent du bruit à l'expérience. Une interaction efficace entre les deux photons se produit comme suit: Le nombre de photons interagit avec l'atome, qui, à son tour, interagit avec le deuxième photon, provoquant une interaction complète entre les deux photons.

Un autre schéma est basé sur des méthodes qui capturent différents types d'atomes: il ya le piège Ion, dans lequel un petit nombre d'atomes chargés sont piégés dans un espace confiné; Et des pièges ioniques neutres sont utilisés pour capturer les atomes non chargés dans cet espace confiné. Les systèmes de traitement de l'information quantique basés sur les pièges atomiques utilisent des atomes pour stocker les qubits. Le rayonnement électromagnétique apparaît également dans ces schémas (mais différemment de celui indiqué dans l'approche « optique » du traitement de l'information quantique). Dans ces schémas, les photons sont utilisés pour manipuler les informations stockées dans les atomes. Des portes quantiques uniques peuvent être exécutées en appliquant des impulsions de rayonnement électromagnétique appropriées à des atomes individuels.

Les atomes voisins peuvent interagir les uns avec les autres grâce, par exemple, à des forces dipolaires qui permettent l'exécution de portes quantiques. En outre, il est possible de modifier la nature exacte de l'interaction entre les atomes voisins, en appliquant des impulsions de rayonnement électromagnétique appropriées aux atomes, ce qui permet à l'expérimentateur de déterminer les ports exécutés dans le système. Enfin, la mesure quantique peut être effectuée sur ces systèmes à l'aide de la technique du saut quantique, qui met en œuvre avec précision les mesures basées sur le calcul utilisé dans le calcul quantique. Une autre classe de systèmes de traitement de l'information quantique est basée sur la résonance magnétique nucléaire, connue sous les initiales du terme anglais NMR. Ces schémas stockent l'information quantique dans les spins nucléaires des molécules atomiques et manipulent ces informations à l'aide du rayonnement électromagnétique.

Le traitement de l'information quantique par RMN fait face à trois difficultés particulières qui rendent cette technologie différente des autres systèmes de traitement de l'information quantique. Tout d'abord, les molécules sont préparées en les laissant en équilibre à température ambiante, ce qui est beaucoup plus élevé que les énergies de la rotation de rotation que les spins deviennent presque complètement aléatoirement orientées. Ce fait rend l'état initial particulièrement « bruyant » que souhaitable pour traiter l'information quantique. Un deuxième problème est que la classe de mesures qui peuvent être utilisées dans la RMN n'inclut pas toutes les mesures nécessaires pour effectuer le traitement de l'information quantique. Cependant, dans de nombreux cas de traitement de l'information quantique, la classe de mesures autorisées dans la RMN est suffisante.

Troisièmement, étant donné que les molécules ne peuvent pas être traitées individuellement dans la RMN, il est naturel d'imaginer comment les qubits individuels peuvent être traités de manière appropriée. Cependant, différents noyaux de la molécule peuvent avoir des propriétés diverses qui leur permettent d'être approchés individuellement ou du moins d'être traités à une échelle suffisamment granulaire pour permettre les opérations essentielles de l'informatique quantique. Le CENTRE de recherche IBM Almaden a produit d'excellents résultats : une machine quantique à sept atomes et NRM ont été construits avec succès et exécutés correctement l'algorithme Shor, avec factor 15. Cet ordinateur a utilisé cinq atomes de fluor et deux atomes de carbone.

4.5 PROBLÈMES

La principale difficulté rencontrée dans la construction d'ordinateurs quantiques est l'incidence élevée des erreurs. Une des raisons pour définir l'erreur elle-même est que l'influence du support sur l'ordinateur quantique peut conduire à une variante du qubit. En désactivant tous les calculs, ces erreurs peuvent provoquer des incohérences du système. Ainsi, une autre difficulté est la signification de la mécanique quantique, le principe qui rend les ordinateurs quantiques si intéressants. La physique quantique prétend que la mesure ou l'observation d'un système quantique peut détruire la superposition des états. Cela signifie que si votre programme lit des données pendant l'exécution sur un ordinateur quantique, tout le traitement sera perdu.

La plus grande difficulté est la capacité de corriger les erreurs sans réellement mesurer le système. Ceci est réalisé par la cohérence de phase. Cette technologie peut corriger les erreurs sans endommager le système. Pour ce faire, l'imagerie par résonance magnétique est utilisée pour reproduire un seul bit d'information quantique phonique à partir d'une molécule trinucléaire de trichloroéthylène. Fondamentalement, cette technique utilise des observations indirectes pour effectuer des incohérences et maintenir la cohérence du système. Compte tenu de toutes ces difficultés, l'importance de l'expérience d'IBM est évidente : les scientifiques peuvent surmonter tous ces revers et les mettre en pratique à partir de l'algorithme Shore sur les ordinateurs quantiques.

5. BLOCKCHAIN BLOCKCHAIN

La blockchain, ou "chaîne de blocs", est une sorte de base de données décentralisée contenue dans un logiciel spécifique qui fonctionne principalement pour vérifier l'authenticité des bitcoins et des transactions, où toutes les activités sont enregistrées Fabriqué avec des devises Bitcoin, de sorte qu'il est possible de vérifier l'intégrité de la monnaie et d'empêcher la contrefaçon. Fondamentalement, lorsqu'une transaction est effectuée, les informations générées dans elle sont ajoutées à la blockchain, fonctionnant comme un enregistrement. Lorsqu'une transaction doit être vérifiée, les clients chargés de vérifier le contenu des transactions liées au Bitcoin concerné, de sorte qu'en plus de la contrefaçon, la « double dépense » d'une même devise soit empêchée.

Les serveurs de horodatage servent à s'assurer qu'une certaine information existe ou existe dans un temps valide, pour s'assurer que, par la suite, les opérations qui en dépendent sont authentiques. Le problème avec cette vérification dans les bitcoins, c'est qu'il n'y a pas de serveur centralisé qui peut faire ces contrôles et assurer aux clients l'intégrité de l'information, de sorte que cette vérification est faite, la technique de preuve de travail a été adoptée. Il s'agit d'une technique qui valide une certaine quantité d'informations, et peut nécessiter beaucoup de temps de traitement pour être validé, en fonction de votre complexité.

Bitcoin utilise cette technique pour valider la génération de nouveaux blocs, basé sur le système Hashcash. Ainsi, pour qu'un bloc soit généré avec succès, un morceau de son code est publié sur le réseau, de sorte que d'autres blocs le valident et l'acceptent, devenant ainsi un bloc valide.

6. TYPES DE PROCESSORS

En raison de la structure dite de vide d'azote, les diamants ont été influencés par plusieurs équipes de scientifiques qui ont construit des processeurs quantiques. Maintenant, une équipe de recherche internationale a prouvé qu'il est non seulement possible de construire un diamant d'ordinateur quantique, mais aussi le protéger contre les résultats. Dans ce contexte, la cohérence est un type de bruit ou d'interférence qui perturbe la relation subtile entre les qubits. Quand il entre, les particules sont dans le point A et le point B en même temps, commence soudainement au point A ou juste au point B. Ainsi, une autre équipe a créé un processeur d'état solide quantique utilisant des matériaux semi-conducteurs. Étant donné que les systèmes à base de gaz et de liquides représentent la grande majorité des expériences informatiques quantiques d'aujourd'hui, les solides du processeur quantique ont l'avantage de pouvoir croître en nombre quantique sans complications substantielles.

Le diamant quantique est aussi simple que possible : il a deux qubits. Malgré le carbone complet, tous les diamants contiennent des impuretés, c'est-à-dire des atomes qui sont « perdus » dans leur structure atomique. Ce sont ces impuretés qui ont suscité l'intérêt des scientifiques qui pensent le domaine du calcul quantique. Le premier est le noyau d'azote, tandis que le second est un seul électron «errant», en raison d'un autre défaut dans la structure du diamant en fait, le bit est la rotation de chacun. L'électronique fonctionne mieux que les bits que les noyaux, car ils peuvent effectuer des calculs plus rapidement. D'autre part, ils sont les victimes les plus fréquentes de la cohérence.

6.1 DEMANDES

De l'énergie du processeur, ce traitement serait très utile pour la recherche scientifique, de sorte qu'il sera, bien sûr, lancé dans ces superordinateurs l'application commerciale de la réalité virtuelle et l'intelligence artificielle, comme il deviendra Une mode de ce siècle. Le jeu peut vraiment être suffisant pour contenir certains personnages qui interagissent avec le jeu. Vous pouvez parler et agir sur la base des actions du joueur, comme un RPG presque en temps réel. Un seul ordinateur quantique peut contrôler des centaines de ces caractères en temps réel. La reconnaissance des sons et des gestes est triviale. Il ne fait aucun doute qu'il y a eu des progrès expressifs dans divers domaines qui pensent à l'intelligence artificielle.

Avec l'avancement de la recherche, il y aura un code de cryptage sécurisé pour l'utilisation d'algorithmes intelligents pour les enquêtes de base de données de grande taille ainsi que pour la réalisation de l'intelligence artificielle de suivi presque immédiatement, et pourtant pour le Transfert de données rapidement. L'utilisation de fibres optiques et de téraoctets de haute densité par seconde et de routeurs mécaniquequantiques peuvent traiter cette information. Transformer internet en un monde virtuel suffit, car dans un monde virtuel, les gens peuvent s'intégrer aux avatars et se rapporter à la parole, aux gestes et même au toucher, comme dans le monde réel. Ce sera l'évolution des discussions en cours. La question la plus importante est de savoir quand. Personne ne sait vraiment à quelle vitesse cette recherche est. Il peut prendre une centaine d'années pour voir l'application en cours d'exécution ou seulement vingt ou trente ans.

6.2 COMMENT ILS FONCTIONNENT

Le premier ordinateur quantique est devenu une réalité, par exemple, IBM a lancé sa première puce quantique dans la 12e session de l'Université de Palo Alto cette année. Il s'agit encore d'un projet très basique avec seulement cinq qubits, seulement 215 Hz ainsi que nécessite de nombreux équipements pour fonctionner, cependant, il a été démontré qu'il s'agit d'un processeur quantique qui est actuellement possible. La première question de cette expérience est de savoir comment maintenir cette molécule stable. La solution actuellement utilisée est de la stocker dans une solution de refroidissement à haute température proche du zéro absolu. Cependant, ce système est très coûteux. Pour être commercialement viables, ils doivent surmonter cette limitation en créant des processeurs quantiques qui peuvent fonctionner à température ambiante.

Le deuxième problème est de savoir comment manipuler les atomes qui composent le processeur. Un atome peut changer d'état à un rythme alarmant, mais un atome ne peut pas deviner l'état qu'il veut prendre. Pour manipuler les atomes, utilisez des particules plus petites. La solution découverte par les concepteurs d'IBM est d'utiliser le rayonnement dans un système similaire à la résonance magnétique, mais plus précisément. Ce système a deux problèmes, le premier est le fait qu'il est très cher: un appareil, comme une feuille, n'est pas moins de 5 millions de dollars. Le deuxième problème est que la technique est très lente, ce qui prouve le fait que le prototype de la roue IBM est seulement 215 Hz, des millions de fois plus rapide que n'importe quel processeur actuel, qui est déjà dans la boîte Gigahertz. Un autre obstacle que Quantum doit surmonter est la viabilité commerciale.

6.3 NOUVEAUX ESPOIRS

Comme nous l'avons réitéré, les processeurs quantiques expérimentaux mis au point jusqu'à présent sont lents, car ils ont des technologies émergentes normales et nécessitent des équipements complexes et coûteux. Il n'est pas aussi facile à emballer que les processeurs Intel ou AMD et de travailler à température ambiante, soutenu par une glacière simple. Le prototype quantique actuel utilise le dispositif RmN pour manipuler l'état des atomes et des molécules pour rester stable à des températures proches du zéro absolu. Bien qu'il aide les scientifiques à étudier la mécanique quantique, ces systèmes ne sont jamais économiquement viables. Aujourd'hui, le développement des processeurs quantiques prend de l'ampleur. La première expérience a cherché à prouver qu'il s'agit d'une manipulation électronique très problématique car les électrons, en raison de sa faible qualité et de son exposition, sont très sensibles à toute influence extérieure.

Ils manipulent ensuite le noyau, ce qui simplifie considérablement le processus, parce que le noyau est plus élevé et l'idée est relativement isolée de l'environnement extérieur à travers la barrière électronique qui l'entoure. Mais ce n'est qu'une partie de la solution. Quoi qu'il en soit, vous avez encore besoin de développer une technique pour manipuler le noyau. Le premier groupe utilise l'IRM, un prototype technique très coûteux, mais il ya déjà des gens qui développent un moyen plus facile de le faire. Des scientifiques du Los Alamos National Laboratory aux États-Unis ont publié des expériences utilisant l'optique pour manipuler les protons. L'idée de cette nouvelle technologie est que les protons peuvent être utilisés sous forme de formes d'ondes (qui interagissent avec les atomes qui composent le système quantique) et peuvent être transportés par un système optique.

Avec cette nouvelle technologie, les protons ont pour fonction de manipuler les atomes qui composent le processeur quantique. Parce qu'il s'agit d'une particule, un proton peut être « jeté » contre un qubit, modifiant son mouvement et son impact. De même, les protons peuvent être émis pour sauter aux qubits. Ainsi, la trajectoire du proton est modifiée. Le grand balcon peut être utilisé pour récupérer ce proton à l'aide d'un photodétecteur qui détecte les protons dans la forme d'onde, pas les particules. En calculant la trajectoire du proton, les données enregistrées dans les bits peuvent être récupérées.

Un problème rencontré au cours de l'expérience était qu'il y avait beaucoup d'erreurs dans le système. Pour cela, les chercheurs travaillent sur des algorithmes de correction d'erreurs qui rendront le système fiable. Après tout ce travail, l'ordinateur quantique deviendra probablement plus viable que prévu. Il y a quinze ans, les ordinateurs quantiques n'étaient considérés que comme de la science-fiction. Aujourd'hui, certains prototypes sont déjà en service. La question est maintenant de savoir quand ces systèmes sont-ils viables? Les progrès que nous voyons peuvent être la réponse.

CONCLUSION

Pour effectuer la plupart des calculs mathématiques, modifier le texte ou naviguer sur Internet, la meilleure solution est d'utiliser l'ordinateur le plus proche (basé sur l'architecture Von Neumann). En fait, les processeurs d'aujourd'hui sont très efficaces dans l'exécution de ces tâches. Cependant, dans des domaines tels que l'intelligence artificielle, il est nécessaire d'utiliser d'autres types d'ordinateurs et d'architectures. Par exemple, dans les algorithmes de reconnaissance d'images ou de traitement de la parole, l'exécution séquentielle et le stockage de l'architecture Von Neumann (très efficace pour d'autres applications) devient une limitation qui limite les performances de ces systèmes.

Pour ce type d'application, il est plus intéressant d'avoir un ordinateur avec une capacité de traitement suffisante pour correspondre à l'identification de la forme (le principe commun de la résolution de ces problèmes). Parmi les différentes alternatives, les ordinateurs quantiques sont les plus prometteurs, précisément parce que le calcul quantique diffère de la structure de von Neumann en ayant une énorme puissance de traitement parallèle.

Par conséquent, on peut conclure que les ordinateurs quantiques seront utilisés pour résoudre efficacement les problèmes résolus par les ordinateurs classiques. Le calcul quantique sera appliqué aux problèmes où une solution efficace n'a pas été trouvée, comme l'intelligence artificielle et le cryptage. Le calcul quantique peut résoudre complètement les problèmes extrêmement complexes de l'informatique classique. Cependant, la difficulté de gérer ces phénomènes et surtout de mettre en œuvre l'architecture évolutive laisse beaucoup d'incertitude pour le succès de ces machines. De grandes entreprises comme IBM investissent dans la recherche dans ce domaine et créent déjà les premiers prototypes. Des algorithmes pour résoudre ce nouveau paradigme sont déjà en développement et même en développement des langages de programmation.

Il reste à savoir si le problème peut être résolu, s'il s'agit d'un problème d'investissement et de temps ou s'il existe une limite physique qui empêche la création d'une machine qui peut surmonter la machine actuelle. Si cela est possible, il peut y avoir un coprocesseur quantique qui, avec le processeur de silicium, constitue un futur ordinateur qui peut prédire plus précisément le temps et affiner le complexe.

RÉFÉRENCES BIBLIOGRAPHIQUES

ACM Computing Surveys, v. 32, n. 3, p. 300-335, 2000.

BECKET, P J. A. Para a arquitetura dos nanomateriais. In: 7ª Conferência Ásia-Pacífico sobre Arquitetura de Sistemas de Computação, Melbourne, Austrália – Conferência sobre Pesquisa e Prática em Tecnologia da Informação, 2002.

BONSOR, K; STRICKLAND, J. Como funcionam os computadores quânticos. Disponível em: http://informatica.hsw.uol.com.br/computadores-quanticos2.htm. Acesso em: 9 mai 2019.

CHACOS, B. Além da Lei de Moore: Como Fabricantes Estão Levando os Chips ao Próximo Nível. Disponível em http://pcworld.uol.com.br/noticias/2013/04/17/alem-da-lei-de-moore-como-fabricantes-estao-levando-os-chips-ao-proximo-nivel/. Acesso em: 10 mai 2019.

FREIVALDS, R. Como simular um livre arbítrio em um dispositivo de computação? AMC, 1999.

GERSHENFELD, N; WEST, J. O computador quântico. Scientific America, 2000.

HSU, J. Google e NASA estarão usando um novo computador D-Wave. Disponível em http://itweb.com.br/107695/google-e-nasa-to-use-new-d-wave/computer. Acesso em: 10 mai 2019.

KNILL, E. Quantum aleatório e não determinístico. Laboratório Nacional Los Alamos, 1996.

MELO, B. L. M; CHRISTOFOLETTI, T. V. D. Computação Quântica – Estado da arte. Disponível em http://www.inf.ufsc.br/~barreto/trabaluno/TCBrunoTulio.pdf . Acesso em: 10 mai 2019.

NAUVAX, P. Arquiteturas de computador especiais. Disponível em http://www.dct.ufms.br/~marco/cquantica/cquantica.pdf . Acesso em: 10 mai 2019.

NIEMIER, M.T; KOGGE, P. M. Exploração e exploração de dutos de nível de cabo Tecnologias emergentes. IEEE, 2001.

RESENDED, A. M. P; JÚNIOR, A. T. da. C. Projeto de Pesquisa PIBIC/CNPq. Disponível em http://www.ic.unicamp.br/~rocha/sci/qc/src/corpoProjeto.pdf . Acesso em: 11 mai 2019.

RIEFFEL, E; WOLFGANG, P. Introdução à computação quântica para não-físicos.

SARKAR, P. Uma breve história de autômatos celulares. ACM Computing Surveys, v. 32, n. 1, 2000.

SKADRON, K. O Papel da Arquitetura de Processador em Ciência da Computação. Comitê sobre os Fundamentos da Computação. Academia Nacional de Ciências, 2001.

WIKILIVROS. Breve introdução à computação quântica. Disponível em http://wikibooks.org/wiki/Breed_introduction_quantum_computation/Print . Acesso em: 10 mai 2019.

[1] Bachelor of Business Administration.

Soumis : mai 2019.

Approuvé : juin 2019.