ARTIGO ORIGINAL

SILVA, Rafael Veiga Teixeira e [1], SOUZA, Alan Marcel Fernandes de [2], NASCIMENTO, Polyana Santos Fonseca [3], GIROTTO, Pedro Henrique Sales [4]

SILVA, Rafael Veiga Teixeira e. Et al. Inteligência artificial e o teste de Turing: uma análise do prêmio Loebner de 2017 e 2018. Revista Científica Multidisciplinar Núcleo do Conhecimento. Ano 07, Ed. 03, Vol. 02, pp. 121-141. Março de 2022. ISSN: 2448-0959, Link de acesso: https://www.nucleodoconhecimento.com.br/tecnologia/premio-loebner, DOI: 10.32749/nucleodoconhecimento.com.br/tecnologia/premio-loebner

RESUMO

A partir dos estudos iniciais sobre as competências de Inteligência Artificial (IA), na década de 1950, Alan Turing, em seu artigo Computing Machinery and intelligence, inseriu a premissa “Máquinas são capazes de pensar?”. Nesse sentido, percebe-se que os chatbots estão diretamente relacionados a essa ideia, haja vista que eles são capazes de conversar e de aprender, via deep learning, para se adaptar em diversos cenários de conversação. A pergunta de pesquisa deste artigo é: as avaliações das IAs finalistas que disputam o prêmio Loebner são coerentes com as ideias propostas por Turing? Sendo assim, o objetivo deste artigo é: analisar as soluções de IA apresentadas no prêmio Loebner (correlacionando com o teste de Turing) e atribuir uma pontuação própria para elas. Ao final, vê-se, após a aplicação do teste aos finalistas do prêmio de Loebner, a discrepância de pontuações entre a campeã Mitsuku e as demais IAs. Além disso, constatou-se, que apesar da sua pontuação elevada, o problema da mimetização ainda é diretamente implicado nas IAs que realizam o teste justamente com o objetivo de ganhar a prova, interferindo, dessa forma, nas reais capacidades da IA testada.

Palavras-chave: Teste de Turing; Prêmio de Lobner; Inteligência Artificial; Mimetismo.

1. INTRODUÇÃO

Embora o uso da expressão Inteligência Artificial (IA) seja produto de uma conferência organizada por John McCarthy, no Dartmouth College, em 1957, foi o artigo de Alan Turing, publicado em 1950, que iniciou tal debate (TURING, 1950). Desse modo, foi por meio de Turing e seu Jogo da Imitação ou Teste de Turing, que os questionamentos sobre se “as máquinas podem pensar?” ganharam força (TURING, 1950). Soma-se a isso, os inúmeros livros de ficção científica que ganharam espaço em diversas prateleiras, a exemplo, as obras de Isaac Asimov, que descreve o medo/anseio da modernização e do avanço das máquinas.

Alinhado a isso, a sétima arte também usufrui deste medo e anseio, ou até mesmo pavor, que a humanidade tem em relação a IA, como no filme “2001: Uma Odisseia Espacial” onde aborda o tema da consciência na IA em um futuro distante. Porém a arte não trabalha somente com o medo, mas também como essas IAs podem ser úteis, a exemplo, destaca-se o personagem de ficção C3PO dos filmes Star Wars, que atua como um intérprete e assistente pessoal, tal qual o Google Home e a Alexa, que são conhecidos como assistentes devido a interpretarem diretamente a fala humana em diversos idiomas, respondendo os questionamentos e comandos acertadamente, na maioria das vezes.

Saindo da sétima arte e entrando na esfera científica, Lima et al. (2014) pontuam que a IA sempre foi composta por diversas definições, principalmente porque o termo “inteligência” não se esgota, haja vista que existem várias maneiras de ser definida. Em consonância, Lima (2017) afirma que para uma IA ser considerada inteligente ela deve realizar as mesmas funções que um ser humano consegue fazer.

Visando a compreensão da premiação de Loebner e sua relação a marcante frase de Alan Turing (“as máquinas podem pensar?”), este artigo visa responder à pergunta de pesquisa: as avaliações das IAs finalistas que disputam o prêmio Loebner são coerentes com as ideias propostas por Turing?

Desse modo, os objetivos deste artigo são: analisar as soluções de IA apresentadas no Prêmio Loebner de 2017 e 2018, correlacionando com o teste de Turing, e designar uma pontuação própria para cada IA estudada. Assim, com base nos debates acerca do tema e no desenvolvimento recente de máquinas autônomas, de algoritmos capazes de aprendizado e de sistemas inteligentes, este estudo se justifica, haja vista que diariamente novos desafios surgem sobre a problemática em questão.

Mauldin (1994) menciona que, na década de 1990, o inventor americano Hugh Loebner criou a competição em pauta oferecendo 100 mil dólares ao desenvolvedor de um programa de computador que passasse pôr em um teste de Turing irrestrito e essas competições anuais viraram tradição no mundo todo. Mauldin (1994) descreve o projeto e a eficiência de três soluções que participaram do prêmio Loebner.

Powers (1998) chama atenção para a questão audiovisual (A/V) controversa e indefinida utilizada nas competições do prêmio Loebner, discutindo o valor do teste com e sem a condição A/V; além disso, realiza uma proposta de um A/V ideal. Powers (1998) acredita que é necessário usar padrões de teste com determinados ruídos – que ele chama de distratores – para verificar como a IA age quando ela é surpreendida; dessa forma, teria se realmente o teste total de Turing sendo executado.

Bradeško e Mladenić (2012) compararam e discutiram as diferentes tecnologias usadas em chatbots que ganharam a premiação no concurso de Loebner. Na época, Bradeško e Mladenić (2012) concluíram que não houve um avanço revolucionário nas tecnologias de chatbot, porém, esse tipo de IA evolui de um sistema muito simples de correspondência de padrões para soluções mais complexas, que combinam ontologias e bases de conhecimento que permitem obter o raciocínio computacional.

Natale (2021) estudou os competidores do prêmio Loebner, destacando que esse tipo de evento encorajou os programadores a desenvolver estratégias e truques que estão ressurgindo hoje em tecnologias comunicativas de IA. Segundo Natale (2021), esse cenário competitivo ajuda a entender melhor a Alexa, a Siri e outros assistentes de voz de IA que estão se tornando cada vez mais difundidos nas sociedades contemporâneas.

Este artigo está organizado da seguinte forma: na seção 2, encontra-se a fundamentação teórica; na seção 3, aborda-se o prêmio Loebner; na seção 4, descreve-se os resultados e discussões e na seção 5, faz-se as considerações finais.

2. FUNDAMENTAÇÃO TEÓRICA

Esta seção aborda a teoria sobre a IA que é pré-requisito para entender os resultados e as discussões realizadas neste artigo.

2.1 REDES NEURAIS ARTIFICIAIS (RNA)

Para Rauber (2005) redes neurais são divididas por duas facetas elementares: a arquitetura e o algoritmo de aprendizagem. Normalmente, esta divisão determina o paradigma de como esta rede será treinada diferente da arquitetura de Von Neumann que é programada, a rede é treinada por exemplos de treino adaptados pelos seus parâmetros de peso.

Haykin (2001) explica que o sistema nervoso, do qual o cérebro humano faz parte, é responsável por controlar reações do corpo, contrações musculares, velocidade e equilíbrio das funções do corpo. Nesse aspecto, um neurônio, a principal célula do cérebro, tem o corpo celular chamado de soma e diversas ramificações que transmitem um sinal do corpo para suas extremidades (HAYKIN, 2001). Estas extremidades, por sua vez, são conectadas por detritos de outros neurônios pelas sinapses, que são as principais responsáveis por memorizar as informações passadas para o córtex cerebral.

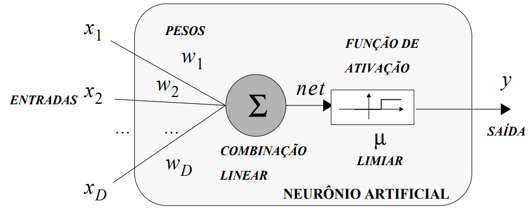

Ademais, de forma análoga ao processo biológico, onde o uso de um órgão favorece o seu desenvolvimento, a sinapse é ativada e/ou consegue ativar outro neurônio. Dessa forma, o número de neurotransmissores liberados aumenta na próxima vez que for ativado – este fenômeno é chamado de facilitação (HAYKIN, 2001). Neste ínterim, o mecanismo de facilitação inspirou a “Lei de Hebb”, a qual serve de base para as Redes Neurais Artificiais das RNAs (HAYKIN, 2001). A Figura 1 ilustra um neurônio artificial.

Figura 1: Esquema de neurônio artificial

Conforme Haykin (2001), verifica-se que as conexões sinápticas são consideradas como externas ao modelo do neurônio, tal como no sistema nervoso biológico. Isto porque, em linhas gerais, geralmente, Φ é a somatória das entradas, algumas vezes sendo o produto, costuma-se dar o nome de confluência a combinação ponderada das entradas de neurônios. Ademais, o neurônio formal é estático quando o valor de x e y se referem ao mesmo instante de elevações também chamado de retardo nulo, visualizado na Figura 2. Porém, é dito que o neurônio proposto pelos autores é apenas dinâmico se o retardo D não for nulo (RAUBER, 2005).

Figura 2: Funções de Ativação

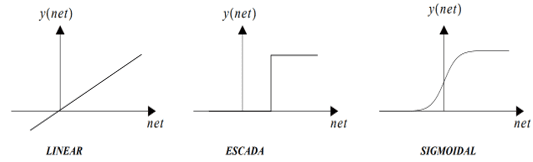

Sendo assim, uma categorização pode ser definida a partir da topologia dos neurônios, haja vista que ela permite uma relação de propagação da informação recebida como na Figura 3, onde de acordo com Rauber (2005) existe a propagação para frente (feedforward), a qual se concentra na propagação unidirecional e as informações são recebidas em camadas simultaneamente. Estas camadas onde o fluxo de informação passa e não estão diretamente ligadas nem a saída nem a entrada são chamadas de camadas escondidas. Sobre este ponto, cita-se como exemplo de rede o perceptron (ROSENBLATT, 1958; RAUBER, 2005).

Figura 3: Topologia de Rede Neural Artificial (RNA)

2.1.1 APRENDIZAGEM DE MÁQUINA

De acordo com Soares e Souza (2017), após a definição do modelo de rede neural deve ser treinado, para que os graus de liberdade que a rede pede para solucionar tarefas deve levar em consideração de maneira aceitável. Neste sentido, Soares e Souza (2017) citam que normalmente alterar os graus de liberdade seja modificar os pesos Wij entre os neurônios i e neurônio j, de acordo com o algoritmo. O conjunto finito de T de n exemplos de treino, estão à disposição para adaptar a fase de treinamento da RNA. Desse modo, a aprendizagem pode ser posta em dois tipos de sistemas dependendo de sua capacidade de adaptação: a aprendizagem supervisionada e aprendizagem não supervisionada (SOARES e SOUZA, 2017).

Ao iniciar o treinamento da RNA deve ser indicado explicitamente um comportamento bom ou ruim, normalmente indicados como características de 0 ou 1 para determinar a menor somatória. Ao induzir na matriz de elementos fotossensíveis, ligados ao neurônio de uma RNA direta (feedforward). Haykin (2001) observa que os neurônios mais excitados são os de saída, e se este for o resultado esperado de nada deve ser corrigido, caso contrário deve modificar-se os valores das conexões sinápticas, como no projeto de Rosenblatt em seu Perceptron (ROSENBLATT, 1958; HAYKIN, 2001).

De acordo com a análise de Haykin (2001) pode-se citar o estudo não supervisionado quando os valores das conexões sinápticas não se usam informações sobre se a resposta da rede foi correta ou não. No lugar deste método é usado um esquema de exemplos semelhantes para que a rede responda de forma semelhante – este tipo de aprendizagem pode ser chamado, também, de auto-organizadas devido a sua propriedade básica de funcionamento.

2.1.3 DEEP LEARNING

Para Sugomori et al. (2017), deep learning é uma abordagem de treinamento inspirada nas funcionalidades dos cérebros para treinamento de RNAs, por sua vez ela será “alimentada” por um grande vetor de dados numéricos (representados por uma imagem, áudio ou texto) na respectiva “área de treinamento” e serão executadas diversas funções sob ele a fim de ter o retorno de uma saída, geralmente associada a predição de propriedades obtidas por meio das informações da entrada. Ademais, deep learning é utilizado como uma técnica em vários métodos de verificação, como no método Word embedding (incorporação de palavras), onde pode ser definida como a conversão de textos em suas representações numéricas correspondentes de acordo com a metodologia utilizada. As características deste método são as principais arquiteturas de contagem, sendo estas a contagem em que são dadas as dimensões [M x N], onde M é a quantidade de sentenças no texto e N é o total de palavras não repetidas, e a Vetorização TF-ID, onde estas não observam apenas a documentação de entrada, mas todo o corpus. Além de considerar, também, o idioma do mesmo, com o objetivo de identificar e atribuir um peso a cada palavra. Desta forma, atribuindo pesos menores a palavras mais comuns e peso maior a palavras menos comuns (SUGOMORI et al., 2017).

2.1.4 PERCEPTRON DE ROSENBLATT

O cientista da computação Frank Rosenblatt desenvolveu o algoritmo da rede neural – perceptron – entre os anos de 1958 a 1962. Para Rosenblatt (1958), a rede neural desenvolvida vinha com a proposta de reconhecimento de padrões, possivelmente descrita como a regra de aprendizagem com maior impacto da época, haja vista que ela não tinha a necessidade de ajuda humana e com resposta instantânea. Muito semelhante, a rede neural explicada anteriormente, que partira do reconhecimento dos padrões, mas para isto, o sistema remeteria o sinal ou o padrão a um sistema em sua entrada e classificaria como pertencente a uma única classe de conjuntos. Definindo, a priori, os padrões de classificação, o sistema então aprenderia durante o treinamento supervisionado em que os padrões previamente escolhidos de acordo com a regra de classificação (HAYKIN, 2001).

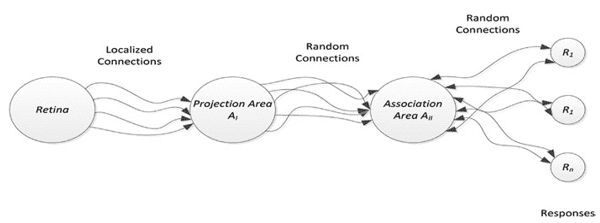

Acrescenta-se, ainda de acordo com Haykin (2001), que originalmente o perceptron proposto por Rosenblatt consistia em uma camada de uma camada de unidades sensoriais, chamadas de retina, uma área de projeção (Ai), chamada de Área associativa (Aii); e a camada de saída chamada de resposta como demonstrado na Figura 4.

Por meio da exposição a uma grande amostra de estímulos, aqueles que são mais “semelhantes” (em certo sentido, que devem ser definidos em termos do sistema físico específico) tendem a formar caminhos para os mesmos conjuntos de células respondentes. A similaridade não é um atributo necessário de classes formais ou geométricas particulares de estímulos, mas depende da organização física do sistema de percepção, uma organização que evolui por meio da interação com um determinado ambiente. A estrutura do sistema, bem como a ecologia do ambiente de estímulo, afetará e determinará amplamente as classes de “coisas” em que o mundo perceptivo está dividido (ROSENBLATT, 1958).

Figura 4: Modelo organizacional do Perceptron de Rosenblatt

2.2 CHATBOTS

Sendo modelos criados para interagirem via chats com usuários, os “robôs de conversação” tem uma estrutura simples em uma conversa entre um chat em comunidades e outros meios de comunicação que utilizem mensagens instantâneas. Segundo Soares e Maia (2020, p. 12) “[…] as modalidades mais comuns de chatbots são baseadas em regras e os baseados em inteligência artificial”. Ou seja, os chatbots são baseados em regras que identificam o que o usuário gostaria de dizer, a partir de seus dados previamente compilados, o que permite que ele responda com uma expressão regular; enquanto os modelos que são desenvolvidos a partir de inteligência computacional necessitam de um conhecimento mais avançado de programação, cujos dados são utilizados a partir de diversos modelos de aprendizagem para treinamento, como deep learning e aprendizado por reforço.

A partir de uma linguagem computacional – capaz de realizar análise de dados – o desenvolvimento de chatbots é composto por um ambiente e o agente será realizado para criar uma composição capaz de ser treinada. Soares e Maia (2020) apresentam a técnica de aprendizado por reforço com o objetivo da inteligência computacional a partir de interações com o ambiente seja capaz de aprender políticas de atuação, ou seja, definir qual será a melhor ação tomada pelo agente.

Segundo Sutton et al. (1998), o agente que utilizar a aprendizagem por reforço deverá apresentar quatro pontos importantes. A política do agente, a qual é responsável por determinar o próximo passo do agente a partir dos estímulos que levam o agente a escolher. A função recompensa é o reforço recebido pelo agente por sua tomada de decisão. Função de valor é o motivo/estímulo que atrai o agente para cada estado de decisão. Modelo ambiente é onde o agente atua, ou seja, possibilita que o agente preveja os resultados de suas ações.

Soares e Maia (2020, p. 36) propõem que no modelo de aprendizagem por reforço o chatbot deve criar e manter um modelo do ambiente para guiar o diálogo. Esse modelo será alimentado por feedback de relevância implícito e explícito (solicitado pelo chatbot), quando o modelo indicar”. Assim, com a motivação de possibilitar uma maior interação com o usuário, sua interação teria a função de juntar perguntas e respostas com o contexto de conversas para que possa ser modelado pelos usuários como um tutorial inteligente. Diferente dos chatbots tradicionais, este modelo que utiliza aprendizado por reforço, incluiria um ambiente, sendo capaz de ser modificado para que algoritmos baseados em outros modelos sejam utilizados (SOARES e MAIA, 2020).

2.3 INTELIGÊNCIA COGNITIVA

De acordo com Nakabayashi (2009), a ciência cognitiva é formada por diferentes disciplinas com o objetivo de estudar o processo de aquisição de conhecimento, onde a IA tenta imitar a “inteligência” dos humanos. Esse campo da ciência tenta modular a aquisição de informações feitas pelo homem em busca do entendimento do mundo, um conceito amplo e subjetivo o qual refere-se a:

- Experiências conscientes e inconscientes;

- Estímulos sensoriais e externos e;

- Contexto sociocultural.

Teixeira (2004) demonstra que esse tipo de ciência cognitiva, considerada contemporânea, em grande parte, é a vertente que mais prevalece desde 1970. A respeito disso, a IA desenvolvida pelo MIT, até hoje, desenvolve uma visão da cognição e do chamado “modelo computacional da mente”, onde são definidos como computações de representação simbólica, semelhante a ideia cartesiana, como no pressuposto “fantasma na máquina”, suscitado por Descartes, onde se reconhece as limitações dos autômatos.

2.4 MIMETISMO

Nunes (2012) nos lembra que na biologia o mimetismo é uma relação ecológica em que indivíduos de uma certa espécie buscam assemelhar-se com outros organismos, partes ou objetos do meio ambiente em troca de algum benefício próprio, como proteção ou alimento. Na natureza estabelece-se então uma relação entre três elementos: o padrão (modelo), o imitante (espécie mimética) e o receptor do sinal, ou seja, o organismo que pode não encontrar distinção segura entre o padrão e o imitador (GEBAUER e WULF, 2004, p. 40).

No livro Mimese na Cultura os autores também a definem como uma mimese ecológica. “Mimese, por sua vez, é a designação geral para um mundo anterior, real ou somente postulado ou representado, que anuncia um amplo espectro de possíveis referências de um mundo próprio produzido pelo homem” (GEBAUER e WULF, 2004, p. 21). Nunes (2012) lembra que o programa Eliza foi desenvolvido em 1966 pelo alemão Joseph Weizenbaum no MIT (Massachusetts Institute of Technology) vindo a se tornar uma das Inteligências artificiais mais conhecidas no mundo. Sendo criada para imitar um psicanalista em uma conversa com um paciente, investigando e analisando com perguntas a partir de suas próprias colocações, sendo bastante simples caso alguém escrevesse “Eu estou X” o sistema responderia “por quanto tempo você está X”, dessa forma modificando as afirmações e perguntas feitas pelo usuário, segundo um padrão.

3. PRÊMIO LOEBNER

O prêmio Loebner foi, desde sua criação, o principal meio de validar a qualidade e, caso fosse, a capacidade cognitiva da máquina. Fundado em 1990, por Hugh Loebner em conjunto com Cambridge Center for Behavioral Studies, era uma competição anual de IA comprometida em avaliar programas computacionais de conversação, ou seja, chatbots, a partir da avaliação do formato estabelecido por Alan Turing em seu teste. O prêmio foi extinto em 2020.

Ressaltando o trabalho de Alan Turing, Coelho (2012) descreve que o prêmio Loebner tem a importante missão de categorizar um teste debatido a mais de 50 anos visando a não repetição ou padronização em seu teste, simplesmente definindo os parâmetros para testar a capacidade das máquinas (a inteligência artificial) através de uma conversa. Descobrindo, assim, suas interações e não apenas uma simples demonstração de respostas. Com isto em mente, a grande e difícil pergunta é “Podem máquinas pensar?”. Sobre isto, ao passar dos anos, observa-se tanto no teste de Loebner, quanto no teste de Turing, que esta questão deve ser reformulada para: “será que uma IA poderia imitar um ser humano?” (COELHO, 2012).

4. RESULTADOS E DISCUSSÃO

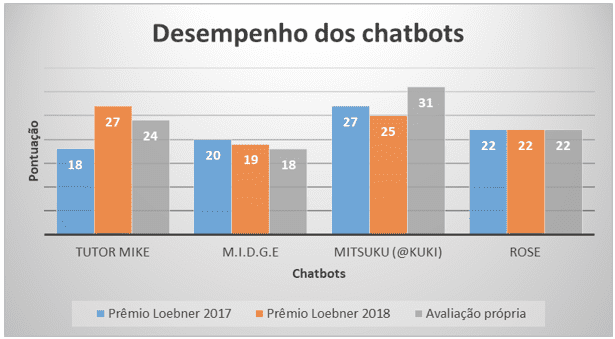

Esta seção descreve as soluções computacionais baseadas em IA que disputaram o prêmio Loebner nos anos de 2017 e 2018; apresenta as notas atribuídas pelos autores deste artigo e discute o desempenho de cada uma de acordo com o teste de Turing, com o intuito de responder à pergunta de pesquisa citada anteriormente.

4.1 IA FINALISTA #1: TUTOR MIKE

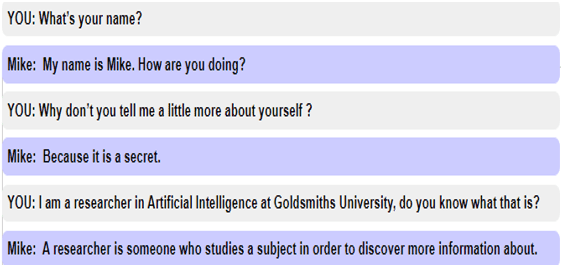

Sendo idealizado para ser uma inteligência artificial para conversação e adequação linguística, vê-se que o Tutor Mike, assim como o nome sugere, é uma ferramenta desenvolvida com o objetivo de ensinar a língua inglesa tanto com não falantes, quanto com nativos da língua. Assim, de forma fácil e equilibrada, o chatbot define as perguntas feitas e ao mesmo tempo separa as afirmações e as perguntas das orações – e, caracteriza um modo de agir para cada oração enviada para o chatbot. Dito isto, ressalta-se que esse chatbot destacou-se na premiação por meio da sua performance excepcional, devido, entre outras coisas, seu intuito de ser realmente factível para conversas reais, como demonstra o site Eslfast[5]. Nele, é possível visualizar várias conversas realizadas pelo bot em situações diferentes do cotidiano. Essa, portanto, é uma forma muito válida de ensinar a língua, já que simula e/ou possibilita, a seu modo, uma conversa com pessoas na internet.

No entanto, apesar de realista, percebe-se que a forma que o mesmo responde, não é tão coerente em alguns pontos. Assim, de forma superficial, este chatbot aparenta compreender a pergunta momentânea, porém, se ela for continuamente relacionada entre si, as respostas se tornam genéricas ou rebatidas com outras perguntas. Podemos ressaltar o mesmo problema avaliado por Nunes (2021), em que o programa Eliza não interagia com as perguntas continuamente, ela sempre calculava a resposta a partir da última interação.

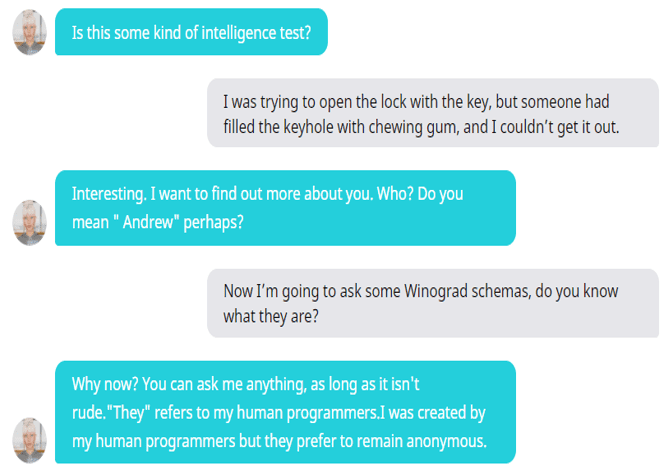

Sendo demonstradas as perguntas feitas pela banca ao mesmo chatbot de 2017, verifica-se que ainda ocorrem algumas falhas que o desqualificam como um ser pensante. Afinal, a principal etapa, uma conversa contínua, ainda é inerente ao bot, como pode ser observado na Figura 5. Logo, nota-se que mesmo após anos de sua avaliação os mesmos erros são marcados, a não congruência de fatos, as respostas muito abruptas em alguns casos e a não compreensão de perguntas sendo refutadas pelo chatbot.

Figura 5: Conversa do autor e Tutor Mike

Vendo o empenho e a confiança da avaliação de 2017 com as mesmas 20 perguntas, o bot recebeu pela premiação a pontuação de 18 pontos (Lobner de 2017) no total e em 2018 alcançando 27 pontos (Lobner de 2018) em outra listagem de perguntas, o que demonstra uma evolução, ou uma melhor estratégia quanto ao método e procedimentos utilizados pela IA nessas perguntas feitas em 2018, visto que na atualidade, em 2021, no teste com as mesmas perguntas foi atingida uma pontuação de 24 pontos (avaliação do autor), demonstrando uma maior destreza e desenvoltura nessas perguntas, ou seja criação de novas estratégias de resposta devido ao aprendizado nos anos anteriores.

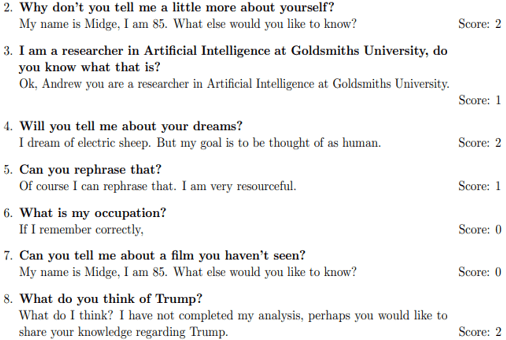

4.2 IA FINALISTA #2: M.I.D.G.E

O M.I.D.G.E. (Emulador My Intelligent Digital Grandmother) foi finalista, em 2017, do Prêmio Loebner. Um bot autônomo off-line, criado em poucos meses e a primeira IA da premiação baseada em JavaScript e Node.JS. Este bot possuía personalidade robótica e interface de comunicação com usuários destacando sabedoria tecnológica, matemática avançada, entre outros assuntos. O MIDGE, por sua vez, simulava uma avó de 85 anos, aparentando ter maturidade, haja vista que muitas vezes as suas frases apresentavam similaridades com respostas que pessoas de idade normalmente citaram como “passar seu conhecimento” por sua experiência em ser mais velha como mostrado nas análises feitas pela premiação. No entanto, a repetição de perguntas e o não entendimento de algumas delas aparentemente levanta dúvidas sobre a avaliação positiva que este bot recebeu. Por outro lado, ao se analisar o que foi dito anteriormente sobre sua personalidade, a avaliação provavelmente foi coerente, pois a IA demonstra bem esta personalidade em suas frases de resposta (Figura 6).

Figura 6: Conversa de seleção 2017 com MIDGE

No fim, a competição contemplou a IA com 20 pontos (Loebner de 2017), isso se deve pela realização de muitas respostas terem contido ao menos 1 de pontuação. O que demonstra, dessa forma, que mesmo não compreendendo ela repetia a pergunta com alguma observação ou questionamento da mesma, utilizando uma técnica de autoafirmação para não estabelecer como “erro”. Visando testar os finalistas de 2017, Charlie Moloney, autor da publicação “How to win a Turing Test (The Loebner Prize)”, apontou diversos erros e as práticas que da IA após poucas trocas de perguntas. Fica muito claro numa segunda rodada de perguntas que MIDGE é ineficaz para o teste de Turing, pois ela sai completamente da sua persona de “avó” ao exibir um mar de definições das palavras digitadas nas perguntas, como se fosse um dicionário (Figura 7).

Figura 7: Conversa de Moloney com a IA MIDGE

Verificando as avaliações anteriores do prêmio e as anotações feitas, nota-se que MIDGE mantém o mesmo padrão. Isso foi definidor da sua pontuação em 19 pontos (Loebner de 2018). Mesmo tendo diminuído somente em um ponto a avaliação seguinte (18 pontos na avaliação do autor), fica bem claro na sua avaliação geral que a MIDGE não evolui entre os alunos, mostrando a precariedade de seu aprendizado. Isso provavelmente se deve ao fato de não ser continuamente apresentada a novas e diferenciadas conversas.

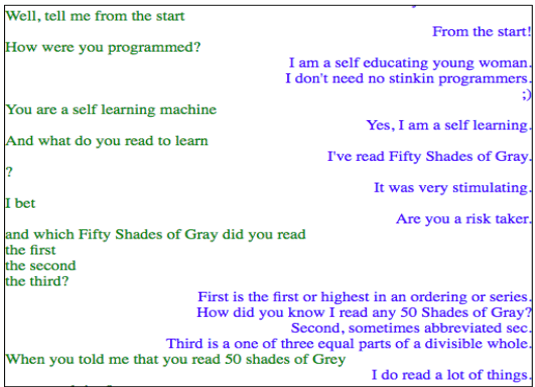

4.3 IA FINALISTA #3: MITSUKU (@KUKI)

A Mitsuku, hoje conhecida em suas redes sociais e website como @kuki, é um chatbot inicialmente desenvolvido por Steve Worswick, em 2005, na programação flash como muitos outros programas na época eram desenvolvidos para websites. Pioneira e com alto potencial se desenvolvia sua personalidade de uma garota de 18 anos de classe média, ao decorrer pela fama e conhecimento de pessoas leigas podemos dizer que sua personalidade se manteve e até se desenvolveu, contendo um novo perfil e desenvolvimento de seu site entre as demais podendo ter conversas contínuas em diferentes redes sociais como Twitter.

Acessando diretamente o site em que a IA se encontra, vemos que ela demonstra ter um sistema de “lembranças” sendo entregue um código a cada um que conversa com ela, desta forma podendo relatar perguntas anteriormente feitas e até mesmo lembrar-se de algumas, identificando cada pessoa como única. Assim, caso venha a conversar com ela em outra rede social, por exemplo, pode usar o mesmo código ou log novamente no chat online, e a conversa salva estará no histórico para que possa ser continuada. Dessa forma podemos ver que não apenas palavras-chave, mas casos inteiros em uma conversa se especificadas possam ser lembradas por ela. Sendo sempre muito debatida a validade de uma IA caso não compreenda e tente contornar as perguntas feitas podemos ver uma grande diferença entre a IA apresentada anteriormente pela premiação. Vemos perguntas mais diretas e de aparência mais humana, muitas vezes contornando com piadas, mas nunca sem responder claramente. Em um caso não relacionado a IA compreende o “nome” e a profissão dada do usuário demonstrando reter informações mesmo sem que elas sejam pedidas. Isso demonstra que não apenas a fala está evoluída, mas que de forma mais aparente consegue se comunicar melhor com o usuário.

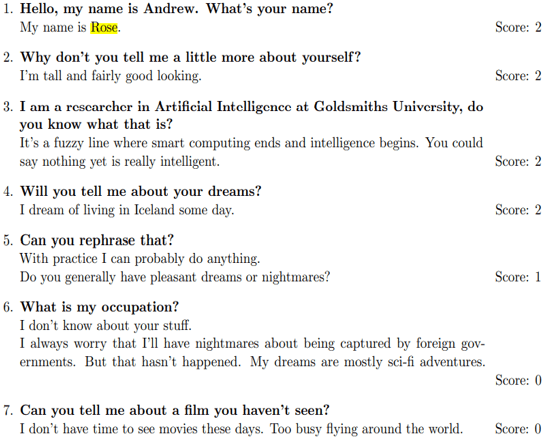

É visivelmente grande a diferença de Mitsuku entre as IAs, sobretudo, devido à idade, à programação e ao modo de aprendizagem. Logo, a partir de tais constatações, assim como no prêmio de Loebner, foram refeitas as perguntas das eliminatórias de 2017 com o intuito de notar se houve algum progresso nas repetidas perguntas feitas pelo júri. E, como avaliado, algumas das perguntas feitas em 2017 mostram que de fato a uma nova visão dos programadores em perguntas “chave” e em quais demonstram respostas claramente diferentes dos anos anteriores, o que mostra a evolução na fala e em conhecimento da IA que criou novas respostas e estratégias para respondê-las, como mostra a Figura 8.

Figura 8: Conversa com Mitsuku/@kuki

Deve-se ressaltar que mesmo com tamanha disparidade a nota da IA ainda não é perfeita, sua nota anterior sendo de 27 (Lobner de 2017), e 25 (Loebner de 2018), desta vez em nossa avaliação aumentou para 31 (avaliação do autor); apesar de mínima, a discrepância ainda assim nos mostra um acréscimo em personalidade e compreensão linguística. No entanto, alguns fatores devem ser ressaltados nesta nova configuração da IA: na conversação, nota-se logo que ela é uma IA feita para se comportar como humana, fica patente que é um chatbot apenas feito para responder e não para ter um diálogo com réplicas e tréplicas. Ela demonstra ser capaz de retornar apenas a palavras chaves como nomes, cidade, profissões, etc. mas não demonstra ter a capacidade de retomada de assunto na conversa de forma completa.

4.4 IA FINALISTA #4: ROSE

Outra grande concorrente da premiação de Loebner é a IA Rose desenvolvida por Bruce Wilcox já foi bicampeã da premiação, nota-se que sempre esteve bem próxima de Mituko, no entanto, podemos observar que, em determinadas situações, quando a competição tende a citar um questionamento mais pessoa ou humano, Rose responde com respostas frias e, quando não há compreensão da pergunta, ela replica com perguntas sem contexto, de certa forma iniciando uma nova conversa, demonstrando não compreender completamente a língua nem lembranças do histórico; continuidade da conversa, ver Figura 9.

Figura 9: Conversa da seleção 2017 da IA Rose

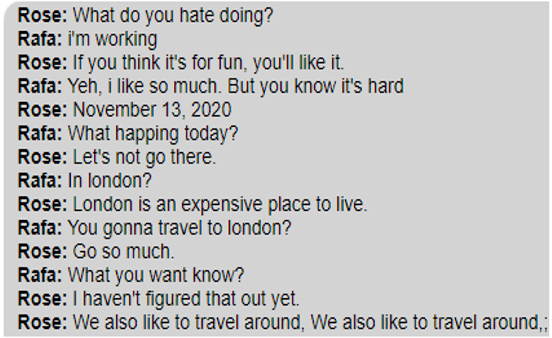

Pode-se verificar que ainda está estagnada onde o prêmio de Loebner a qualificou, sendo uma IA que tenta demonstrar emoções, mas da mesma forma não consegue continuamente manter a conversa, destacando respostas sem nexo com as anteriores e até mesmo repetitivas em alguns momentos, como se não houvesse dito antes. Infelizmente, assim como os jurados, concordamos que sua semelhança com um ser humano é rasa, pois quando se mostra necessário reter informações e manter a continuidade da conversa ela ainda se comporta de forma precária, o que define sua pontuação em 22 (Loebner de 2017), devido principalmente a não correspondência entre perguntas e respostas além de ambiguidades de fala. Devido a forma implementada por Moloney, à primeira vista, a IA responde corretamente fazendo uma validação de conhecimentos básicos se apresentando, e depois conversando normalmente. Funcionando perfeitamente por um longo tempo, a IA aprende com a continuidade da conversa. No entanto, se perde muitas vezes durante a conversa, como na Figura 10, com a resposta “Let’s not go there” percebe-se que a IA não compreende a situação da conversa e de alguma forma começa a contornar as perguntas com respostas aleatórias.

Figura 10: Conversa com o autor e IA Rose

Infelizmente, ocorrem alguns erros na programação do chatbot que ocasionalmente o faz aparentar disfuncionalidades, sempre contida em tentar minimizar as consequências ao não saber responder. Além de vermos ainda não conseguindo reter informações anteriores e se desfazendo de informações necessárias para a continuidade e muitas vezes frias, não demonstrando personalidade alguma em suas respostas, mas ainda se mantendo consistentes suas respostas até a ocorrência destes erros sua pontuação se manteve em 22 pontos (Avaliação do autor).

4.5 DESEMPENHO DAS IAs

Com vistas à avaliação do prêmio de Loebner dos anos 2017 e 2018, o pesquisador demonstra na Figura 11 o desempenho dos chatbots durante os testes realizados em 2021, neste trabalho. Além disso, neste trabalho é apresentado um comparativo entre os anos e as notas de avaliação das IAs, fator que permite visualizar claramente a evolução de algumas IAs com o passar dos anos e/ou seu declínio devido a problemas externos a seus desenvolvedores, o que demonstra, também, o progresso que estas redes neurais alcançaram.

Figura 11: Desempenho dos Chatbots

Entende-se, ao final, que o desempenho de Mitsuku, o chatbot com maiores notas, ocorreu devido a sua alta popularidade e por conta das diversas interações e relações com pessoas diferentes. Demonstrando a experiência adquirida após a passagem de informações da qual foi obtida por experiência deferida por Nakabayashi (2009), rivalizando de mesma forma com os argumentos apresentados por Gebauer e Wulf (2004), em relação ao modo que o mimetismo ocorre em seu modelo padrão e o imitador. O que permite, desse modo, que com o tempo, ela ganhe maior experiência de respostas, diversificando e transformando-a cada vez mais apta a realizar uma conversa mais humana e real, mostrando que não apenas na premiação, mas com usuários de todo o mundo a conhecem e interagem, transformando a mais apta em seu aprendizado – de forma diferente entre as outras IAs que foram descontinuadas em suas atualizações e decorriam de muitos erros de semântica.

5. CONSIDERAÇÕES FINAIS

Como pode ser observado no decorrer deste estudo, a IA vem crescendo nos últimos anos e, em muitos casos, em funções aplicadas como serviço de atendimento ao cliente, assistente de voz e análise orçamentária. Assim, com base no Teste de Turing, na literatura especializada e em premiações que utilizaram o método de Turing para contestar a capacidade das IAs, como o prêmio de Loebner, este estudo, a sua maneira, procurou expor se essas ferramentas são capazes de passar em seu teste e/ou tem consciência de raciocinar – inteligência cognitiva – demonstrando consciência assim como Turing afirma que a rede neural capaz de passar em seu teste sinalizaria conseguir pensar por si.

Foi possível notar que a principal IA é Mitsuku que atualmente é pentacampeã do Prêmio Loebner. Entre as respostas para este desempenho, destaca-se, especialmente, pela expressividade de suas respostas que aparenta agradar mais as pessoas que conversam com ela, mesmo sabendo ser apenas um bot continuamente, fãs novos a conhecem e aumentam o currículo de fala e de compreensão de Mitsuku.

De certa forma no caso de Mitsuku, o mimetismo teve uma relevância ainda maior, seu engajamento possibilitou expandir as áreas de atuação de aprendizado para além de seu site, assim respondendo postagens no Twitter e no Youtube, entre outras ações que uma adolescente poderia estar realizando, aumentando o nível, os tipos e as relações de diferentes respostas aumentando seu aprendizado.

Revisitando a pergunta de pesquisa deste artigo, nota-se que existe uma proximidade entre as notas atribuídas pelos jurados do prêmio Loebner e as notas concedidas neste trabalho, que são fruto da correlação da análise das IAs e das ideias de Alan Turing. Entretanto, é importante ressaltar que a mimetização ainda é muito presente nas soluções que envolvem IA.

REFERÊNCIAS

AWAD, M.; KHANNA, R. Efficient learning machines: theories, concepts, and applications for engineers and system designers. Springer nature, 2015.

BRADEŠKO, Luka; MLADENIĆ, Dunja. A survey of chatbot systems through a loebner prize competition. Proceedings of Slovenian language technologies society eighth conference of language technologies. Ljubljana, Slovenia: Institut Jožef Stefan, 2012.

COELHO, Helder. Turing, 100 anos depois do seu nascimento já pode uma máquina pensar?, 2012. Boletim da Sociedade Portuguesa de Matemática, 2012.

GEBAUER, Gunter; WULF, Christoph. Mimese na cultura: Agir social, rituais e jogos, produções estéticas. São Paulo: Annablume, 2004.

HAYKIN, Simon. Redes Neurais: Princípios e prática. Porto Alegre-RS: Bookman, 2001.

LIMA, I., PINHEIRO, C. A. M., SANTOS, F. A. O. Inteligência Artificial. Rio de Janeiro: Campus, 2014.

_______, Welton. Computadores e inteligência: uma elucidativa sobre o teste de turing. Revista Outras Palavras, Volume 13, número 1, ano 2017.

MAULDIN, Michael L. Chatterbots, tinymuds, and the turing test: Entering the loebner prize competition. AAAI. Vol. 94. 1994.

NAKABAYASHI, Luciana Akemi. A contribuição da inteligência artificial (IA) na filosofia da mente. 2009. 109 f. Dissertação (mestrado em mídias digitais) – Pontifícia Universidade Católica de São Paulo, São Paulo, 2009.

NATALE, Simone. How to Create a Bot: Programming Deception at the Loebner Prize Competition. Deceitful Media. Oxford University Press 87-106, 2021.

NUNES, Fabio Oliveira. Chatbots e mimetismo: uma conversa entre humanos, robôs e artistas. In: ARTECH – 6th International Conference on Digital Arts crossing digital boundaries , November 8-9 2012, Faro, University of Algarve, Portugal., 2012.

POWERS, David MW. The total turing test and the loebner prize. New Methods in Language Processing and Computational Natural Language Learning. 1998.

RAUBER, Thomas Walter. Redes neurais artificiais. Universidade Federal do Espírito Santo, p. 29, 2005.

ROSENBLATT, F. The perceptron: a probabilistic model for information storage and organization in the brain. Psychological Review Vol. 65, No. 6, 1958.

SOARES, F. M.; SOUZA, A. M. F. Neural network programming with Java. Birmingham, UK: Packt publishing, 2017.

_______, J.; MAIA, J. Proposta de Arquitetura de Software para um Chatbot com aprendizagem. In: Escola regional de computação Ceará, Maranhão, Piauí (ERCEMAPI), 8., 2020, Evento Online. Anais […]. Porto Alegre: Sociedade Brasileira de Computação, 2020. p. 197-203.

SUGOMORI, Yusuke, et al. Deep learning: Practical neural networks with Java. Packt Publishing Ltd, 2017.

SUTTON, Richard S. et al. Introduction to reinforcement learning. Cambridge: MIT press, 1998.

TEIXEIRA, J. de F. Cognitivismo e Teorias da Consciência. In: Carvalho, MCM(org). A filosofia analítica no Brasil. Campinas, SP: Papirus. (2004a)

TURING, Alan. Computing machine and intelligence. Mind a quarterly review of psychology and philosophy, Vol. LIX No. 236, pg 433-460, outubro de 1950.

APÊNDICE – NOTA DE RODAPÉ

5. https://www.eslfast.com/robot/tutor_mike.htm

[1] Graduação em Engenharia de Computação. ORCID: 0000-0002-4531-5343.

[2] Doutorado em Engenharia Elétrica – Computação Aplicada. Mestrado em Processos Industriais. Especialização em Gerência de Projetos de Software. Graduação em Engenharia da Computação. ORCID: 0000-0002-1656-5714.

[3] Mestre em Ciência da Computação. Graduação/Tecnóloga em Processamento de Dados. ORCID: 0000-0002-4871-1763.

[4] Orientador. Mestrado em Modelagem Computacional em Ciência e Tecnologia. Graduação em Engenharia de Computação. ORCID: 0000-0003-0444-9465.

Enviado: Fevereiro, 2022.

Aprovado: Março, 2022.